我用 Codex + Unity 6 ,做了一个「 Musk Escape Mars 」3D游戏

我用 Codex + Unity 6 ,做了一个「 Musk Escape Mars 」3D游戏当下,在Codex、Claude code等AI产品,对设计、代码等行业碾压过后,AI又对游戏这个复杂行业“降临”了。

搜索

搜索

当下,在Codex、Claude code等AI产品,对设计、代码等行业碾压过后,AI又对游戏这个复杂行业“降临”了。

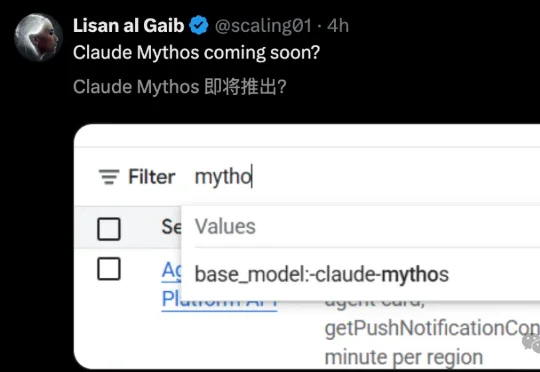

就在刚刚,被Anthropic视为「太危险」的绝密大模型Mythos,竟在谷歌云悄悄解禁。CMU最新实测爆出,它在真实漏洞攻防中,断层碾压GPT-5.5。

最近,创作者平台 Wirestock 宣布完成 2300 万美元 Series A 融资,由 Nava Ventures 领投,SBVP(Sheryl Sandberg 参与创立)、Formula VC 与 I2BF Ventures 参投,公司累计融资规模达到约 2600 万美元。

2022年10月,Elon Musk 以 440 亿美元收购 Twitter,第一件事就是解雇 CEO Parag Agrawal。这位被 Jack Dorsey 亲自提拔的印度裔工程师,在舆论场里几

如果只看这场 Meetup 的嘉宾名单,你大概会先想到海外芯片巨头,或者某家国际 AI 基础设施公司。

在MU Shanghai组织的ClawCon活动上,OpenClaw的社区核心成员自己飞过来,在阿里中心的会议室里,面对着从全国各地赶来的开发者、创业者和用户,和他们一线交流。我们拿到了两个独家对话的机会,受访者是OpenClaw核心维护者Josh,以及OpenClaw Foundation核心成员Vincent Koc。

OpenAI 前 CTO Mira Murati 和前应用研究负责人翁荔(Lilian Weng)创立的 Thinking Machines Lab,也就是 TML,刚刚发布了一个叫「Interaction Models」的研究

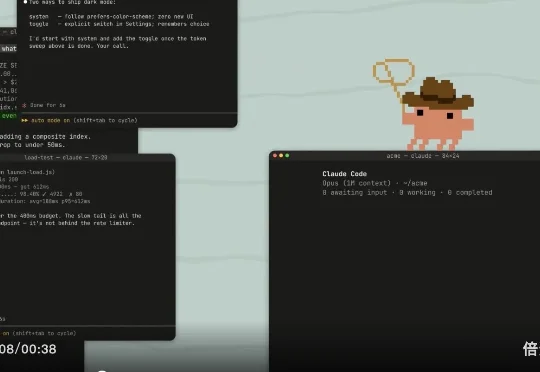

Claude Code今天正式推出Agent视图功能,让用户在一个界面里统一管理所有Claude Code会话。此前并行运行多个Agent时,开发者往往需要同时维护多个终端标签页、一个tmux网格,还得靠脑子记住每个任务的进度。

Mira Murati 用一年半时间证明了「人机协作」不是一句口号。 5 月 11 日,Thinking Machines Lab 发布了一段研究预览视频,展示了他们所谓的「交互模型」(Interaction Model)。

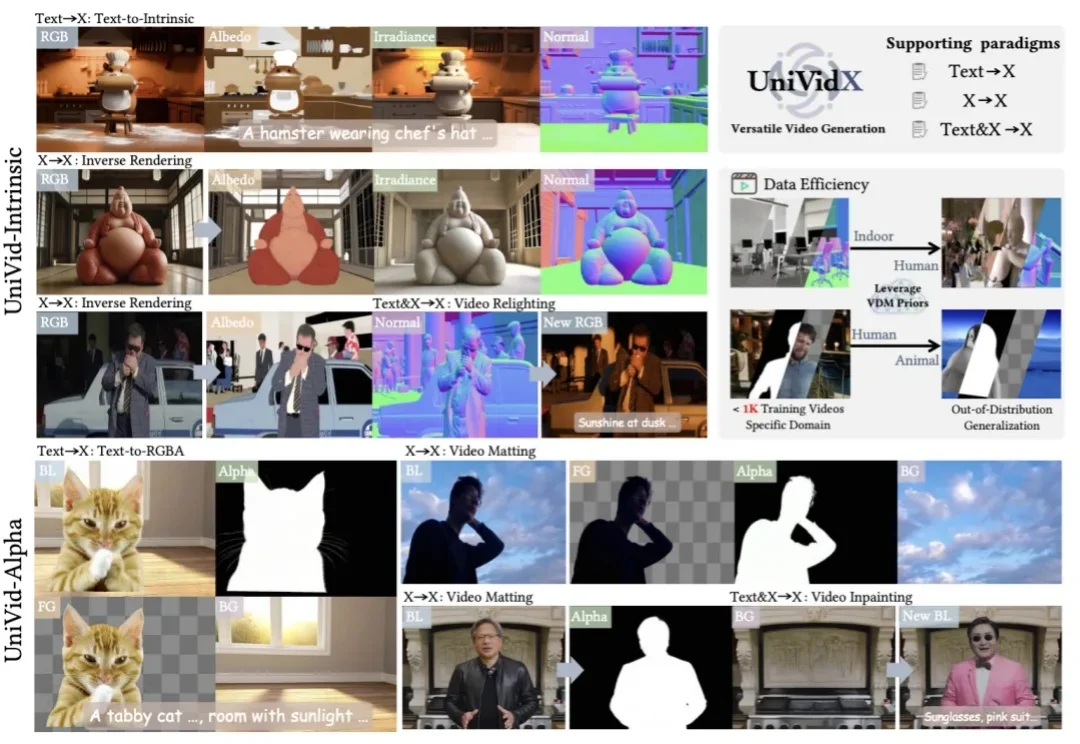

近日,由香港科技大学 MMLab 及合作团队完成的研究工作「UniVidX: A Unified Multimodal Framework for Versatile Video Generation via Diffusion Priors」被计算机图形学顶级会议 SIGGRAPH 2026 正式接收。