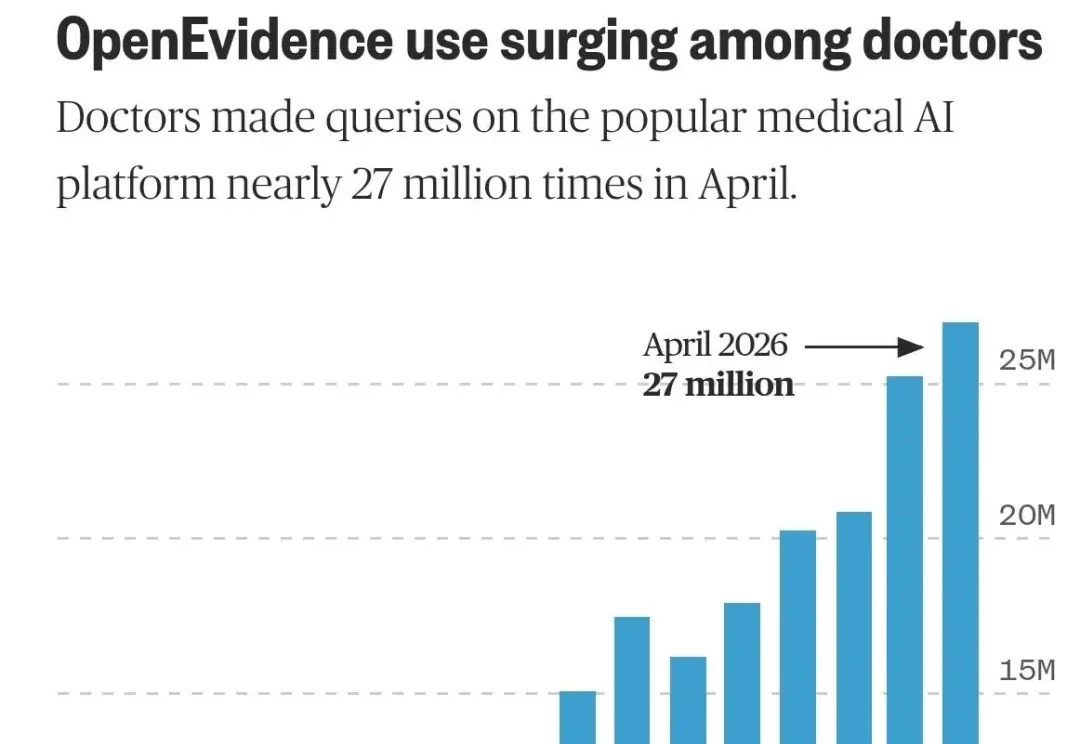

AI医疗彻底火了!千亿独角兽拿下全美65%医生,OpenAI、阿里已全面跟进!

AI医疗彻底火了!千亿独角兽拿下全美65%医生,OpenAI、阿里已全面跟进!全网最火AI医疗,再创增长神话!

搜索

搜索

全网最火AI医疗,再创增长神话!

AI Coding的玩法,又变了。

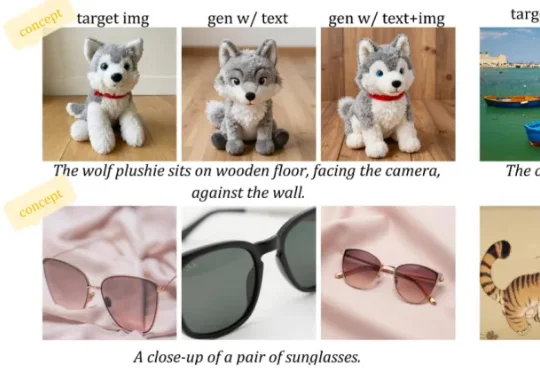

阿里巴巴 Z-Image 团队联合香港科技大学、加州大学圣地亚哥分校、香港中文大学等机构提出 D-OPSD(On-Policy Self-Distillation),首个针对少步扩散模型的在线策略自蒸馏框架。D-OPSD 无需奖励模型、无需成对偏好数据,

今天,阿里发布Qoder 1.0,从AI IDE升级为智能体自主开发工作台,用户只需专注需求定义,Agent团队即可“自动驾驶”,自主完成执行、验证和交付全流程任务。目前,Windows、macOS和Linux系统用户均可下载使用。

路透社今天报道称,美国已经批准约10家中国公司购买英伟达H200芯片,包括阿里巴巴、腾讯、字节跳动、京东、联想和富士康等。报道同时提到,虽然美国已经给出许可,但目前还没有H200芯片实际交付。

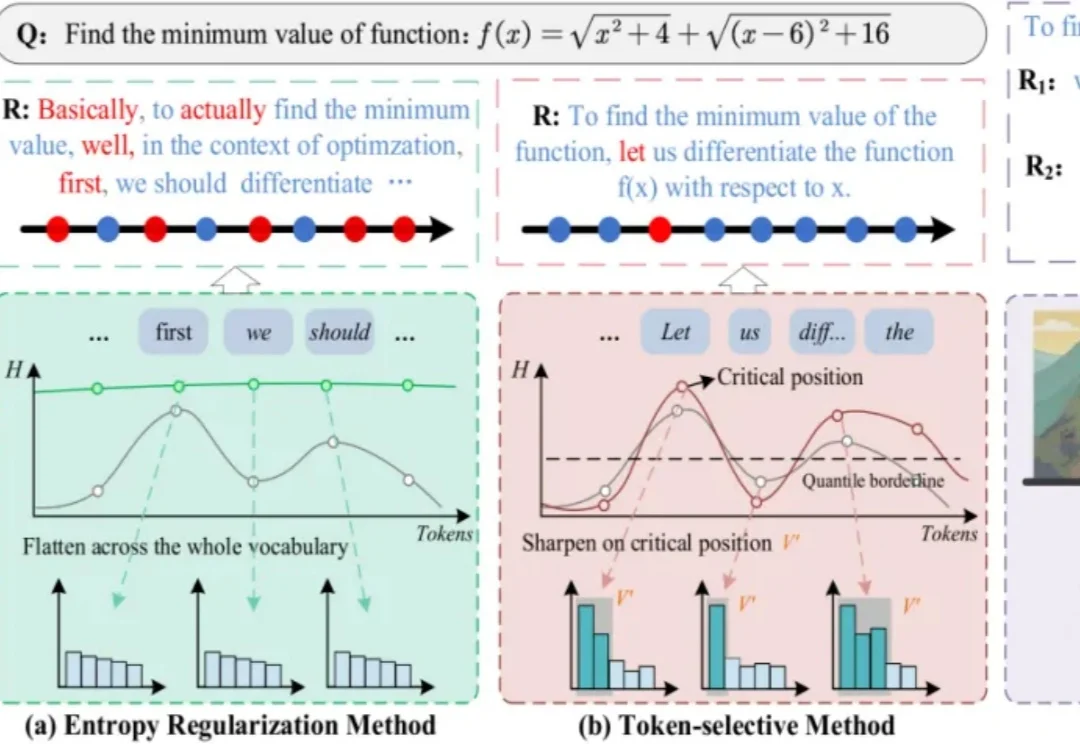

I²B-LPO 是一个面向 RLVR 后训练的探索增强框架,通过改进 rollout 策略引导模型生成更多样化的推理轨迹,将探索行为从 “重复采样” 推进到 “在关键节点生成更具区分度的推理轨迹”,在多个数学基准上同时提升准确率与语义多样性,最高分别达 5.3% 和 7.4%。该工作接收于 ACL 2026 Main,来自阿里达摩院 - 智能决策团队。

凌晨 1 点,某三甲医院急诊科,一位 62 岁的男性被紧急送入,他正经历急性 STEMI 并发急性心衰。血压飙至 185/105 mmHg,血氧仅 91%。护士已推来除颤仪,催促医生「心电捕手」确认替格瑞洛剂量。

独家获悉,前阿里千问大模型技术负责人林俊旸近期已经开启创业,考虑方向包括世界模型和具身大脑。目前,林俊旸已经招募数名字节、腾讯和海外背景的成员,并以约20亿美金的估值开启融资,接触基金包括红杉中国、高榕创投等。

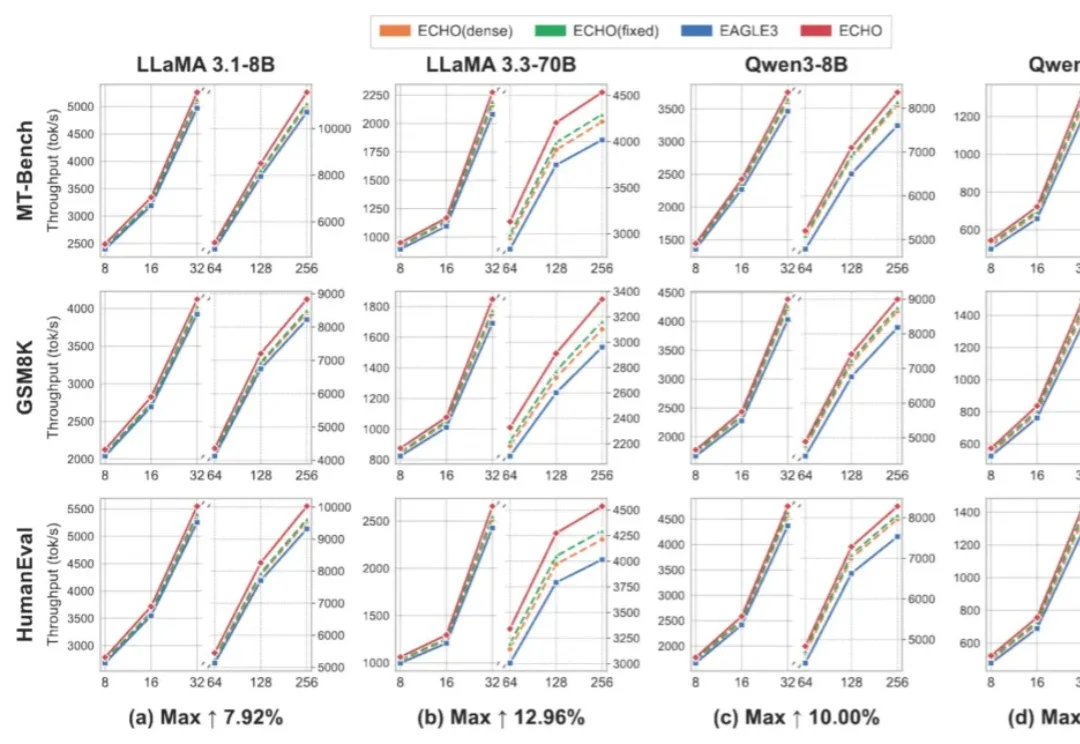

随着大模型参数规模持续扩大,推理成本已经成为生产级 LLM 服务的核心瓶颈。投机解码(Speculative Decoding, SD)通过「小模型 draft + 大模型 verify」的方式,将多个候选 token 放到一次目标模型前向中并行验证,从而缓解自回归解码的串行瓶颈。

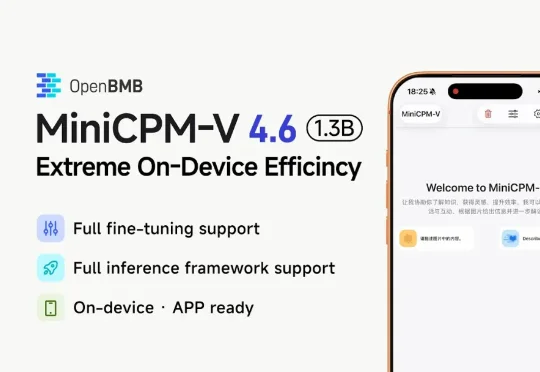

面壁智能正式发布并开源了 MiniCPM-V 系列新一代基础模型——MiniCPM-V 4.6。这款模型的整体参数规模仅约 1B(1.3B),是该系列有史以来参数规模最小的一款。但在多模态综合能力上,它却成功超越了被视为标杆的阿里 Qwen3.5-0.8B 和谷歌 Gemma 4 E2B-it,做到了「尺寸更小、效率更高、性能更好」。