3个工程师、0融资、不开会,估值3.5亿美元的Obsidian才是真正的「小而美」

3个工程师、0融资、不开会,估值3.5亿美元的Obsidian才是真正的「小而美」许多长期与文字和代码打交道的创作者,应该对 Obsidian 这款软件并不陌生。作为目前全球最具影响力的本地化 Markdown 笔记应用之一,它凭借独树一帜的知识图谱和开源生态,在知名度与用户忠诚度上,已然能与 Notion 分庭抗礼。

搜索

搜索

许多长期与文字和代码打交道的创作者,应该对 Obsidian 这款软件并不陌生。作为目前全球最具影响力的本地化 Markdown 笔记应用之一,它凭借独树一帜的知识图谱和开源生态,在知名度与用户忠诚度上,已然能与 Notion 分庭抗礼。

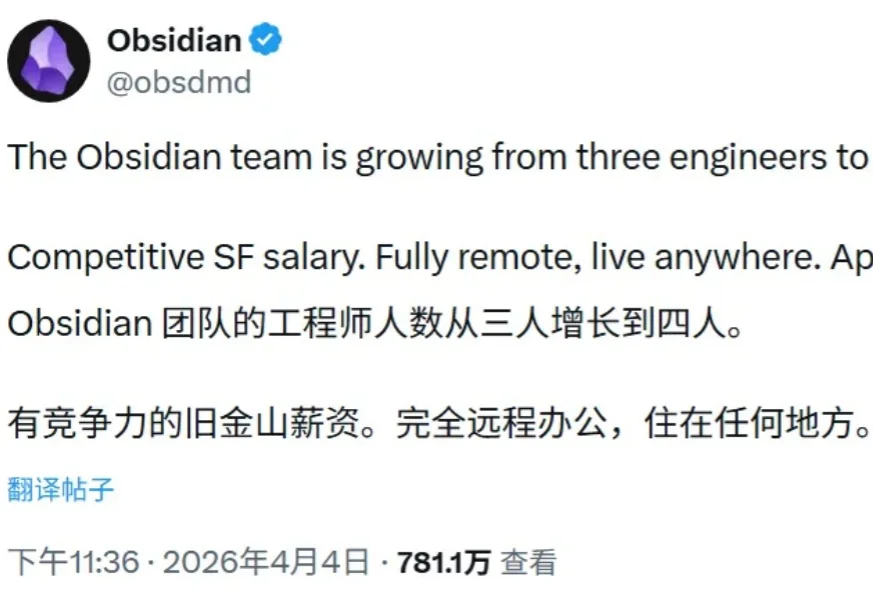

UIUC研究团队打造ResearchArcade,将ArXiv论文、OpenReview评审、图表代码等碎片数据连接成动态知识图谱。模型可直接学习引用关系、修改轨迹与审稿互动,让AI更好辅助科研写作、修订与预测,为下一代科研智能体奠定统一数据基础。

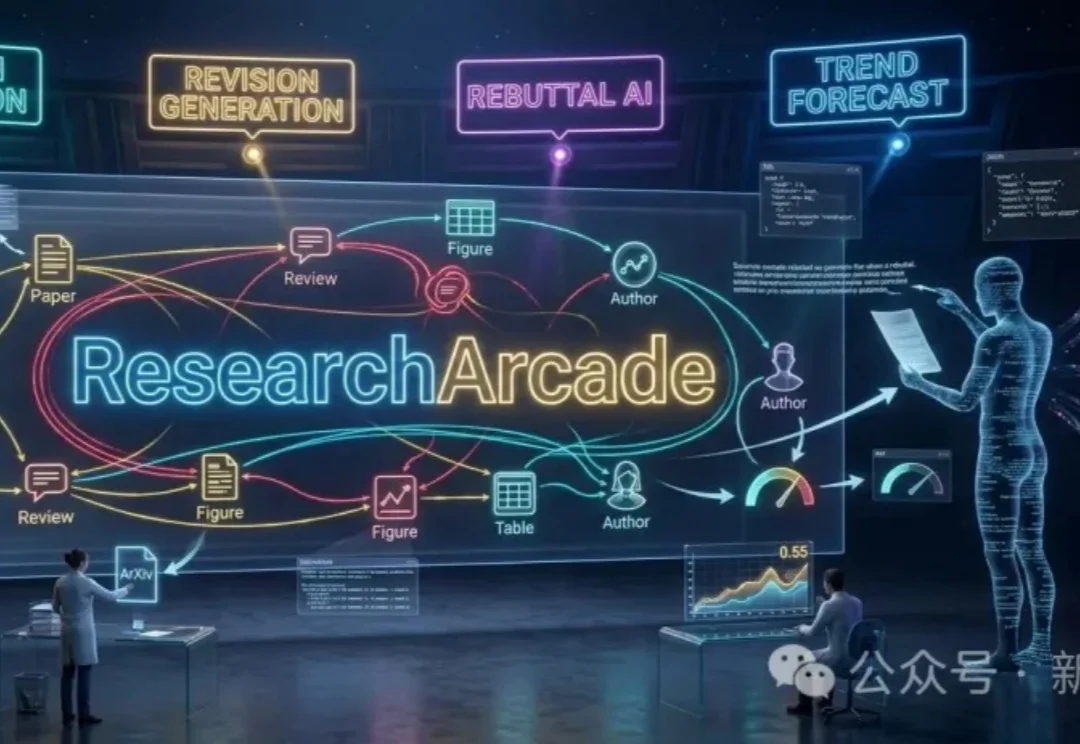

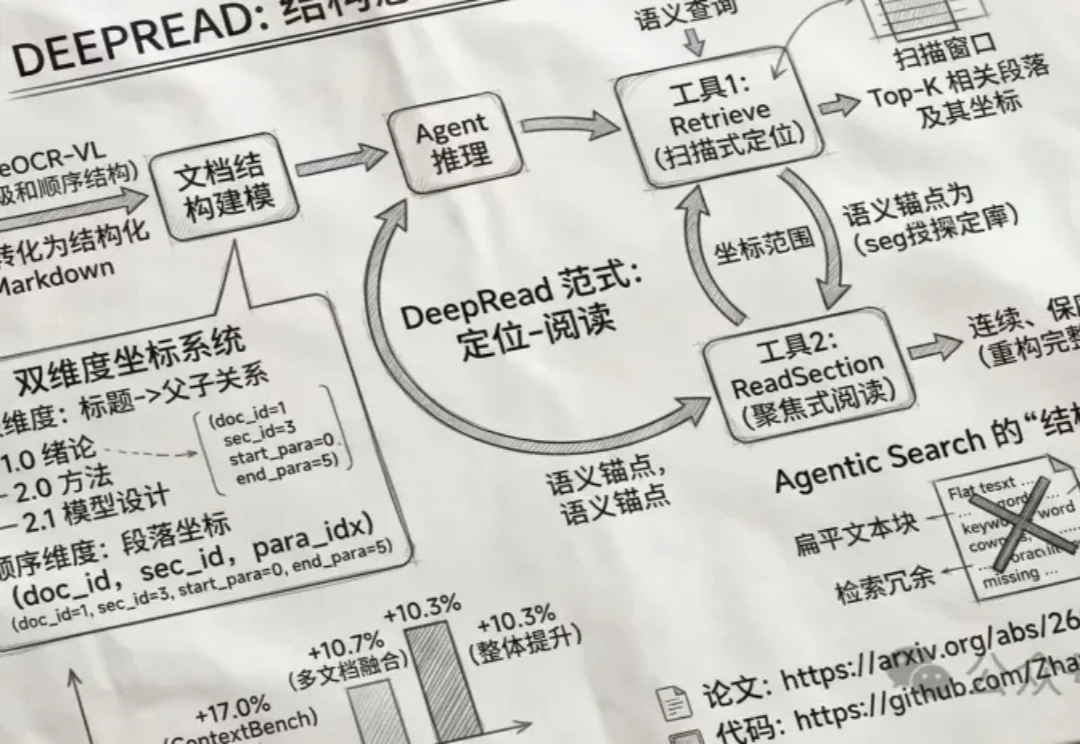

DeepRead让AI像人一样阅读文档:利用OCR识别章节结构,先精准定位相关段落,再完整读取上下文,避免碎片化检索。实验显示,其长文档问答准确率提升17%,能自动跳过冗余信息,精准提取财报、论文等复杂内容,无需额外知识图谱,轻量高效。

语析Yuxi-Know 是基于大模型RAG知识库与知识图谱技术构建的智能问答平台,支持多种知识库文件格式,如PDF、TXT、MD、Docx,支持将文件内容转换为向量存储,便于快速检索。

知识图谱推理是人工智能的关键技术,在多领域有广泛应用,但现有方法存在推理效率低、表达能力不足、过平滑问题等挑战。中科大研究团队提出DuetGraph,采用双阶段粗到细推理框架与双通路全局 - 局部特征融合模型,实现推理精度与效率的平衡,为大规模知识推理提供解决方案。

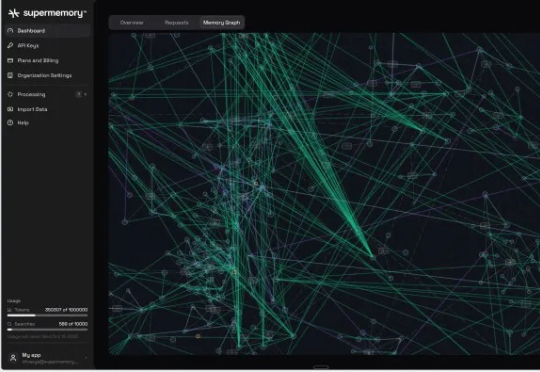

Supermemory 已获得由 Susa Ventures、Browder Capital 和 SF1.vc 领投的 260 万美元种子轮融资。此轮融资还包括 Cloudflare 的 Knecht、谷歌人工智能负责人 Jeff Dean、DeepMind 产品经理 Logan Kilpatrick、Sentry 创始人 David Cramer 以及来自 OpenAI、

使用Google Gemini CLI构建个人知识库是高效的知识管理新方式。该工具通过命令行实现自然语言交互,能自动化整理文件、转换格式、生成结构化内容(如知识图谱)。相比云端笔记软件,其本地优先特性保障隐私且支持多模态处理,结合高质量输入可实现个性化自适应学习,本质是人与AI协同进化的工作范式升级。

最近,由香港大学黄超教授团队发布的开源项目「一体化的多模态RAG框架」RAG-Anything,有效解决了传统RAG的技术局限,实现了「万物皆可RAG」的处理能力。

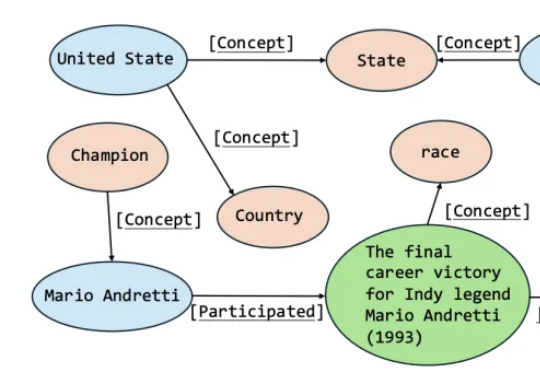

知识图谱(KGs)已经可以很好地将海量的复杂信息整理成结构化的、机器可读的知识,但目前的构建方法仍需要由领域专家预先创建模式,这限制了KGs的可扩展性、适应性和领域覆盖范围。

知识图谱虽然功能强大,但在实际场景中实现它们并非一帆风顺。我们必须意识到其中的挑战、局限性和潜在风险,包括技术问题,比如可扩展性、数据质量、模式复杂性、与非结构化或动态数据的集成障碍,以及偏见和隐私等道德问题。