一只机器狗,把英伟达的算力王座拱翻了

一只机器狗,把英伟达的算力王座拱翻了消费级机器人行业,可能要出现一次真正意义上的代际切换了。

搜索

搜索

消费级机器人行业,可能要出现一次真正意义上的代际切换了。

就在刚刚,Claude把ChatGPT拉下马,Anthropic企业市占率首次登顶!Ramp数据显示,前者的34.4%首次反超OpenAI的32.3%。但Ramp经济学家直言,A厂目前还面临着三重困境,胜负仍未定。

就在刚刚,奥特曼深夜掷出GPT-5.5!全方位暴击Claude Opus 4.7,重新夺回地表最强王座。从写代码到搞科研,AI独立接管电脑的时代真的来了!

开源AI王座一夜易主!Kimi K2.6出道即巅峰,展示了恐怖的「全栈交付」能力。它不仅能复刻高盛研报、手搓奢华官网,甚至能和人类在群组里并肩打工。

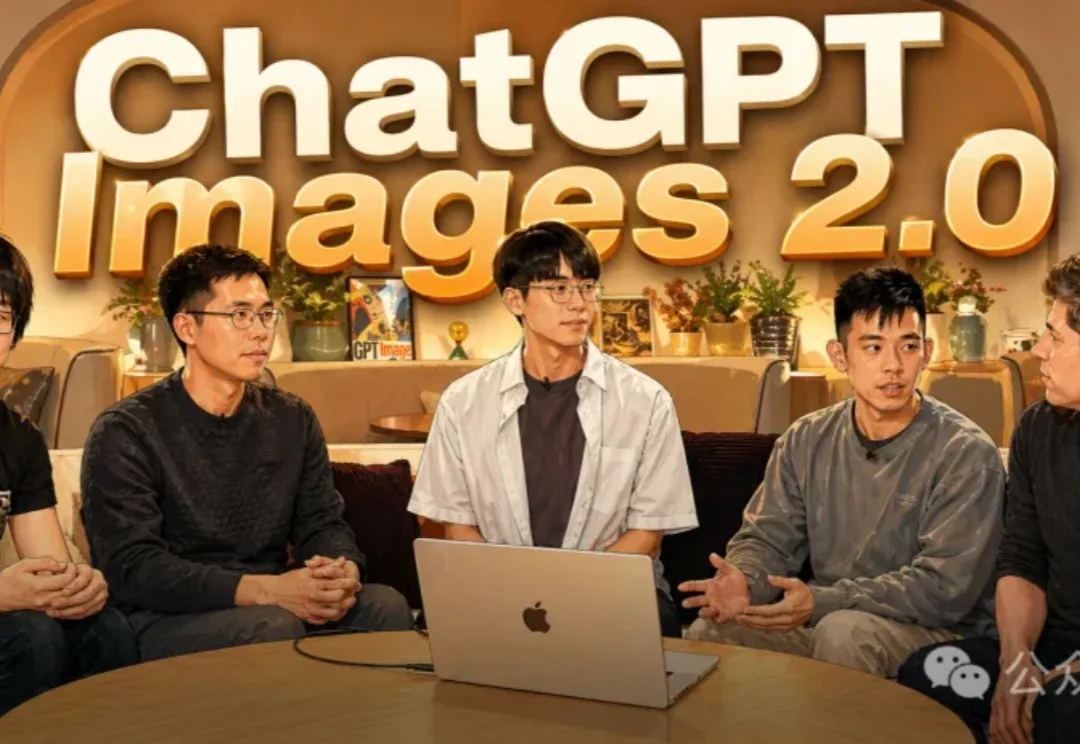

今夜,ChatGPT Images 2.0震撼上线,成为首个「会思考」的图像AI。奥特曼直呼这是从GPT-3到GPT-5的飞跃。它不仅能精准听懂中文指令、渲染复杂UI,甚至能在米粒上刻字。

AI音乐变天了!Mureka V8强势登顶AA榜,包揽人声与器乐双项冠军。而这仅仅是开始,下一代Mureka V9已在路上了!

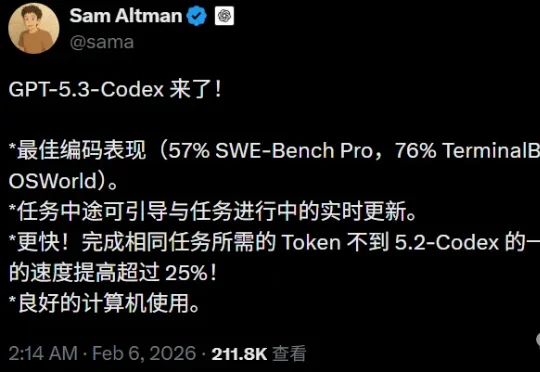

一天之内,两大编程AI轮番轰炸硅谷。Claude Opus 4.6之后,奥特曼紧急放出GPT-5.3-Codex。双雄争霸,彻底撕开AI王座争夺战的帷幕。

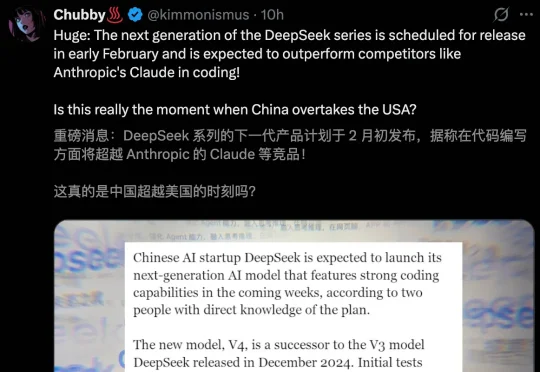

Information爆料称,DeepSeek将计划在2月中旬,也正是春节前后,正式发布下一代V4模型。据称,DeepSeek V4编程实力可以赶超Claude、GPT系列等顶尖闭源模型。

大模型王座易主Anthropic,太空数据中心成真,「AI泡沫」反成创业红利?2025年底的Y Combinator博客中,谈到了2025 年 AI 领域的四大变局。

2025年,AI终于从实验室冲进你的手机、浏览器,甚至购物车——但别被热闹骗了:赢家通吃的游戏从未如此真实。在 Andreessen Horowitz(a16z)最新发布的《2025消费级AI现状》年终报告中,我们看到一场表面百花齐放、实则高度集中的军备竞赛:ChatGPT 依然稳坐王座,Gemini 凭借一张“香蕉图”狂飙突进,而大多数用户——超过90%——根本懒得切换第二款AI。