独家首发丨首个「Soulful Agent」ColaOS 上线:你会感受到Agent的灵魂,然后离不开它

独家首发丨首个「Soulful Agent」ColaOS 上线:你会感受到Agent的灵魂,然后离不开它大概一周前,我拿到了ColaOS(以下简称Cola)的内测。当时我手里有Claude、Gemini和GPT最新的模型。在Cola出现之前,这几个工具已经足够覆盖我所有的工作场景了。还有什么能比Claude好用?

大概一周前,我拿到了ColaOS(以下简称Cola)的内测。当时我手里有Claude、Gemini和GPT最新的模型。在Cola出现之前,这几个工具已经足够覆盖我所有的工作场景了。还有什么能比Claude好用?

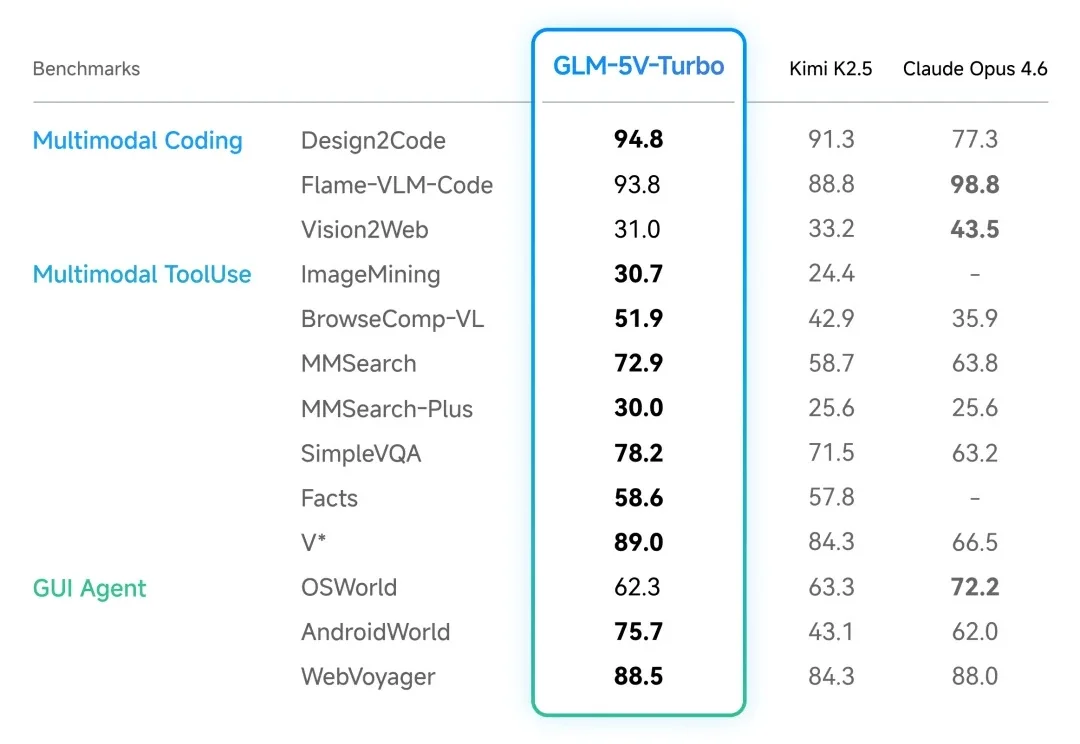

今天,智谱发布 GLM-5V-Turbo,定位「面向视觉编程的多模态 Coding 基座模型」。一句话概括:在 GLM-5-Turbo 的编程和龙虾能力基座上,加入了原生的视觉理解和推理能力

3月30日,阿里巴巴内部发布了 Wan2.7-Image 图像生成与编辑统一模型。根据官方公布的数据,在人类偏好盲测评分中,Wan2.7-Image 目前位列国内第一。从放出的评测雷达图来看,无论是文本生图(Text-to-Image)还是综合图像编辑(Image Editing),它的各项指标基本都盖过了市面上主流的几家头部模型。

Tanay Jaipuria 本周写了一篇很有意思的文章,核心论点只有一句话:每家 AI 应用公司最终都会垂直整合,变成全栈公司。

两个备案概念都涉及"AI",为啥就是不一样? 合规路径+完整流程+避坑清单,看完就懂!

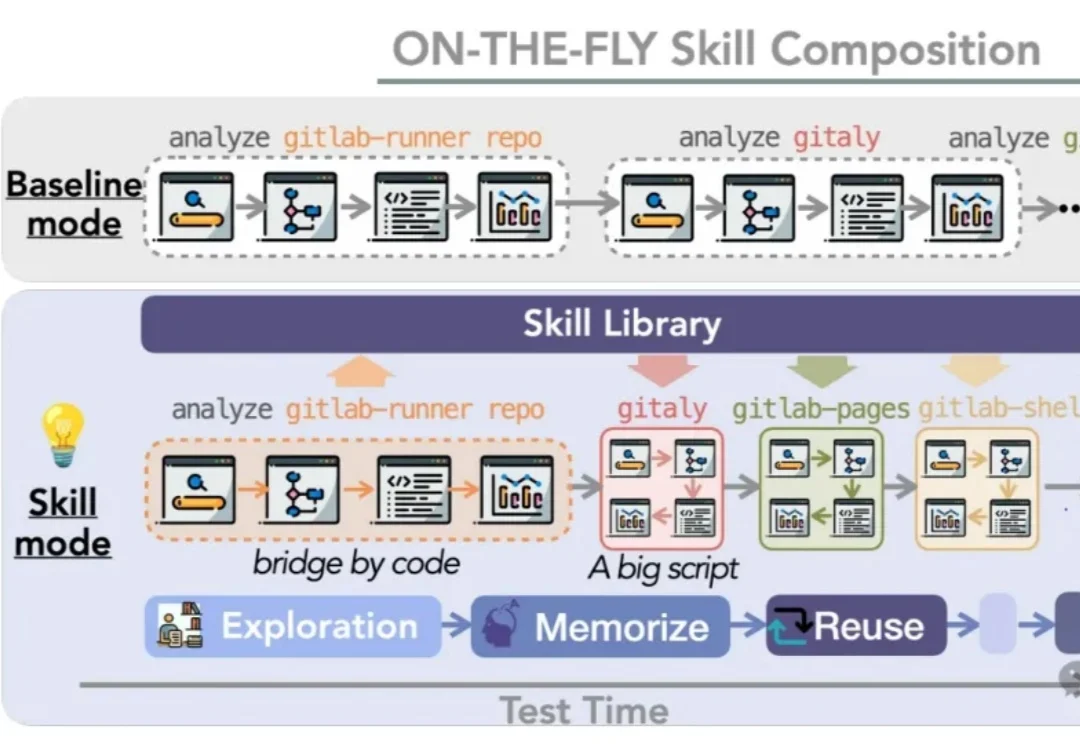

AI会用工具了,问题才真正开始…

在构建多Agent系统(Multi-Agent Systems)时,让几个Agent互相“对话”并不难,但要让它们在局部状态不一致的情况下,敲定一个全局唯一的决策,也就是达成“一致”(Agree)或“共识(Consensus)”,却是一个极具挑战的工程难题,您可能会问为什么,这有何难?

DigClaw 创始团队意识到,快速变革的AI时代下,利用大模型捕捉并处理这些商业“弱信号”成为可能,而这将彻底重构 B2B 获客的基础设施。2025 年,DigClaw 正式起航,试图用 AI 重构信息基础设施,用商业“弱信号”识别“你在什么阶段、什么业务、什么场景之下需要什么产品”,并转化为 B2B 企业可落地的商业阿尔法。

一次低级失误,让全球开发者拿到了 AI 编程工具的「行业标准答案」。一个更重要的问题是,AI 公司,应该如何利用这次「泄露」,抄作业?很多人第一反应是:Claude Code 不就是一个套了模型 API 的命令行工具吗?源代码泄露了又怎样,没有模型权重,这些代码不过是个「壳子」。

把Agent接入工作流,本该是件提效的乐事。