149 元叫了个保洁,来了三个人伺候一台机器人,超值

149 元叫了个保洁,来了三个人伺候一台机器人,超值花 149 块钱,能买到什么级别的保洁服务?答:一个阿姨 + 一个工程师 + 一台重逾百公斤的盘式机器人,上门服务三小时。这个配置放在 58 到家的订单页上,一度让人怀疑是不是系统 Bug,少了打了一个零?

搜索

搜索

花 149 块钱,能买到什么级别的保洁服务?答:一个阿姨 + 一个工程师 + 一台重逾百公斤的盘式机器人,上门服务三小时。这个配置放在 58 到家的订单页上,一度让人怀疑是不是系统 Bug,少了打了一个零?

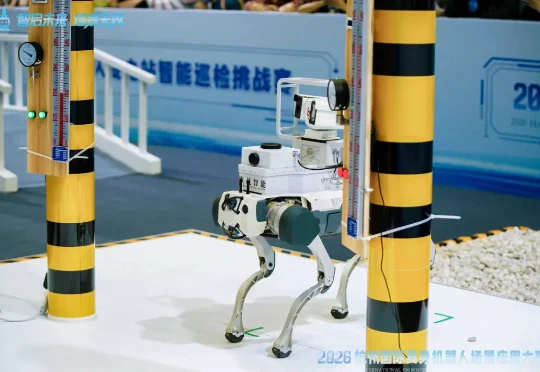

5 月 15 日,杭州西湖云栖小镇。经过前两天雨水的洗礼,春末夏初的空气里透着清新,风也温柔。但小镇里的各大机器人,可顾不上「感受」这份惬意…… 一台四足机器人小心翼翼踩过碎石路,踉跄两步稳住身体,继续执行变电站智能巡检任务;几米外,另一台四足机器人穿过倒塌的废墟,一头钻进模拟浓烟中,展开搜救工作。

美国具身卷到飞起,明星企业Figure再整新活: 这一次,他们让机器人进厂打工,8小时不间断直播放送。

开普勒机器人前 CEO 胡德波已开启具身智能赛道的第二次创业,新公司名为「索塔无界」。这一次,他选择了一条和开普勒不同的路。索塔无界将在今年夏天展示完整大脑能力,包括世界模型、多模态 VLA 以及 Physica-Claw 机器人操作系统,并在实验室跑通早期商业场景全流程。

2026 年,“世界模型” 正在成为具身智能行业的高频词。越来越多公司开始将自己的技术路线表述为机器人世界模型,试图用可学习的环境模型提升机器人训练效率。

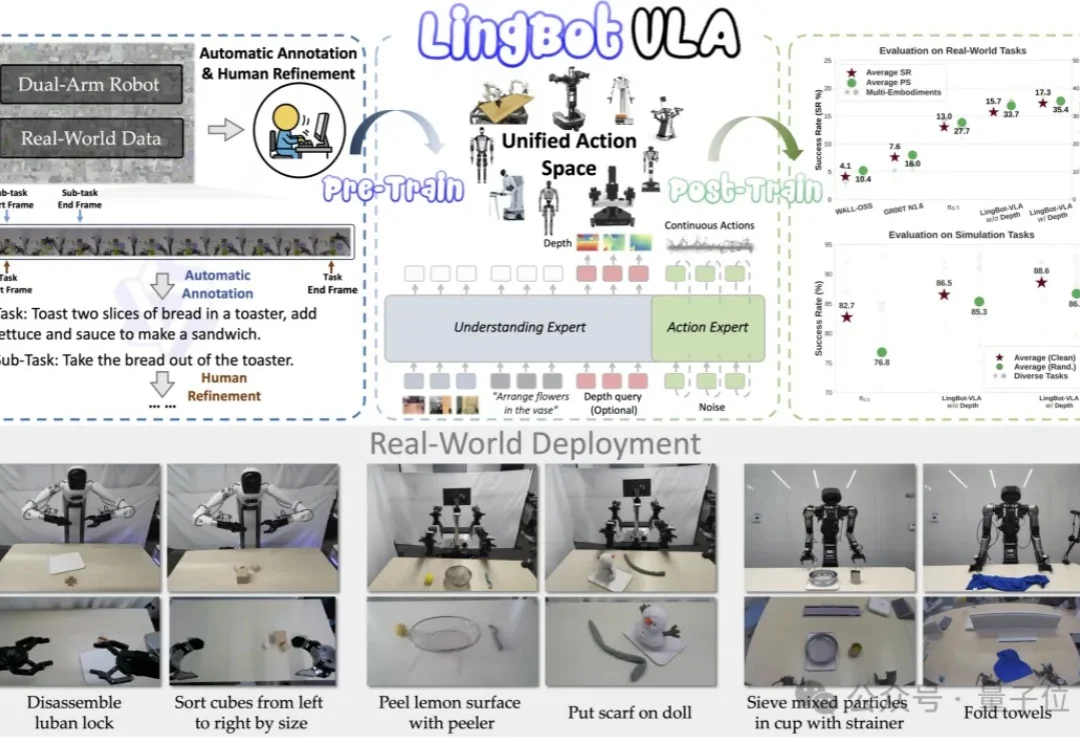

就在刚刚,蚂蚁集团旗下具身智能公司灵波科技传出新动作—— 全面开源其具身基座模型LingBot-VLA的真机后训练工具链。

家用电器是家庭服务机器人最难啃的一类任务对象。与桌面物体操作相比,家电操作不仅涉及按钮、旋钮、门体等多种异构部件,还受到模式切换、状态约束和程序逻辑的共同支配。真正完成一次家电任务,机器人往往既要「看得见」,也要「读得懂」,还要「按说明书做对」。

三年后,这个判断变成了一家叫FrontierX的公司,和它的产品Aura——一个球形的、能在室内自由移动、端侧部署感知和模型的「开放定义的机器人」。FrontierX诞生于杭州,是一家以感知智能为核心的AI原生硬件公司,由来自浙江大学和阿里巴巴的团队创立。团队背景多元,涵盖硬件工程师、算法工程师、产品经理和工业设计师。

如果要让机器人更有价值,“大脑”层面的突破是关键。

家庭具身智能企业「欧拉万象(Ola Dimensions)」近日已完成数亿元人民币融资,由招商局创投领投,赛富投资、九合创投、拙朴投资、BV百度风投、聚合投资等知名机构联合投资。