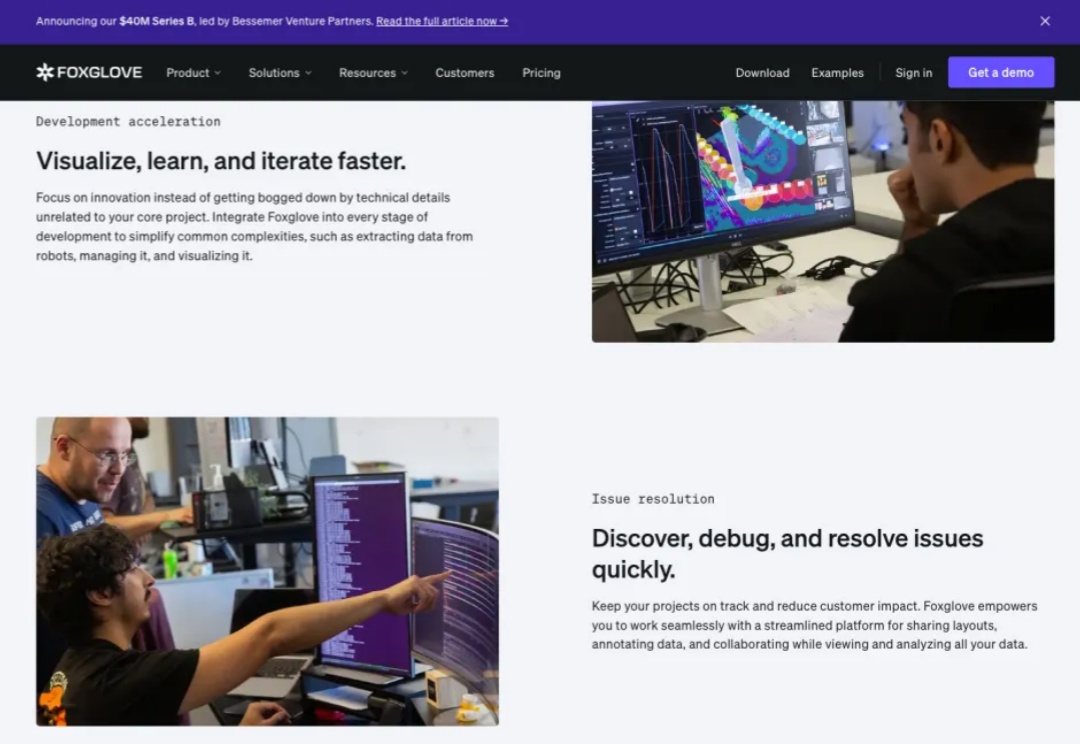

速递|AI机器人数据管理Foxglove,获Bessemer领投4000万美元,估值翻三倍达1.5亿美元

速递|AI机器人数据管理Foxglove,获Bessemer领投4000万美元,估值翻三倍达1.5亿美元最近风投机构对所谓"新实验室"有一系列投资动向。

最近风投机构对所谓"新实验室"有一系列投资动向。

具身智能的Scaling Law正蓄势待发。

港大、港科大与西电团队登上Nature子刊,破解AI芯片核心难题。他们攻克存算一体架构中模数转换器(ADC)这个占能耗87%的「黑洞」,利用忆阻器可编程特性打造能自适应数据分布的「智能标尺」,使AI芯片功耗锐减57.2%,面积缩小30.7%,为下一代高效AI硬件系统开辟新路。

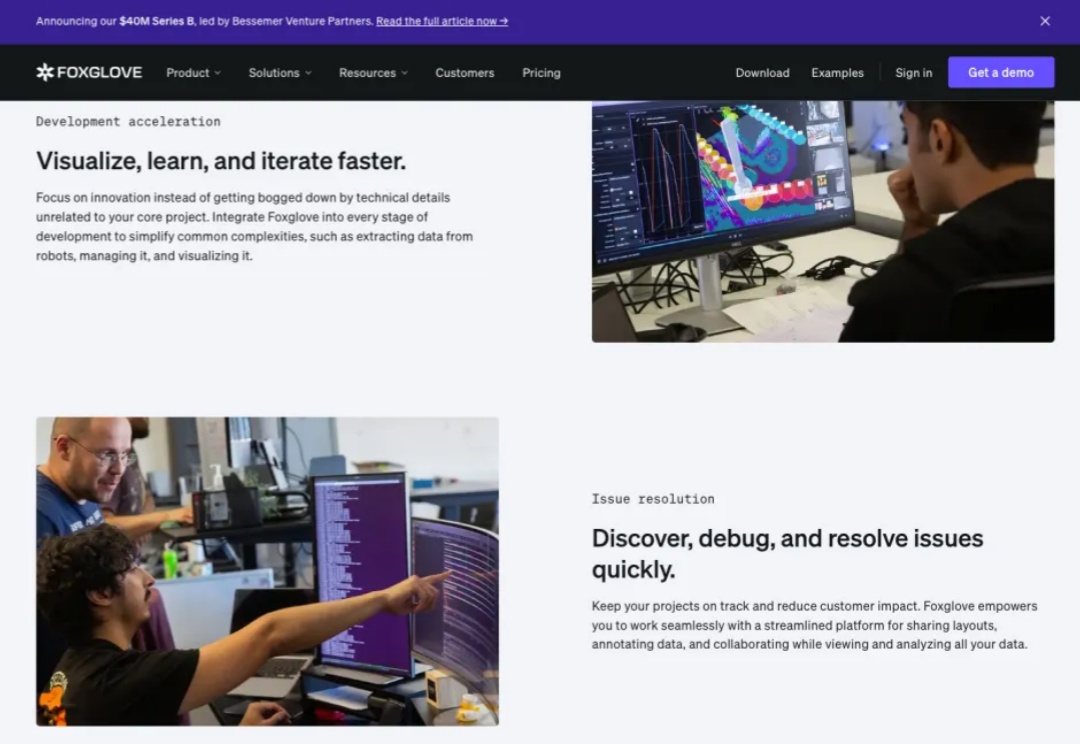

长期以来,多模态代码生成(Multimodal Code Generation)的训练严重依赖于特定任务的监督微调(SFT)。尽管这种范式在 Chart-to-code 等单一任务上取得了显著成功 ,但其 “狭隘的训练范围” 从根本上限制了模型的泛化能力,阻碍了通用视觉代码智能(Generalized VIsioN Code Intelligence)的发展 。

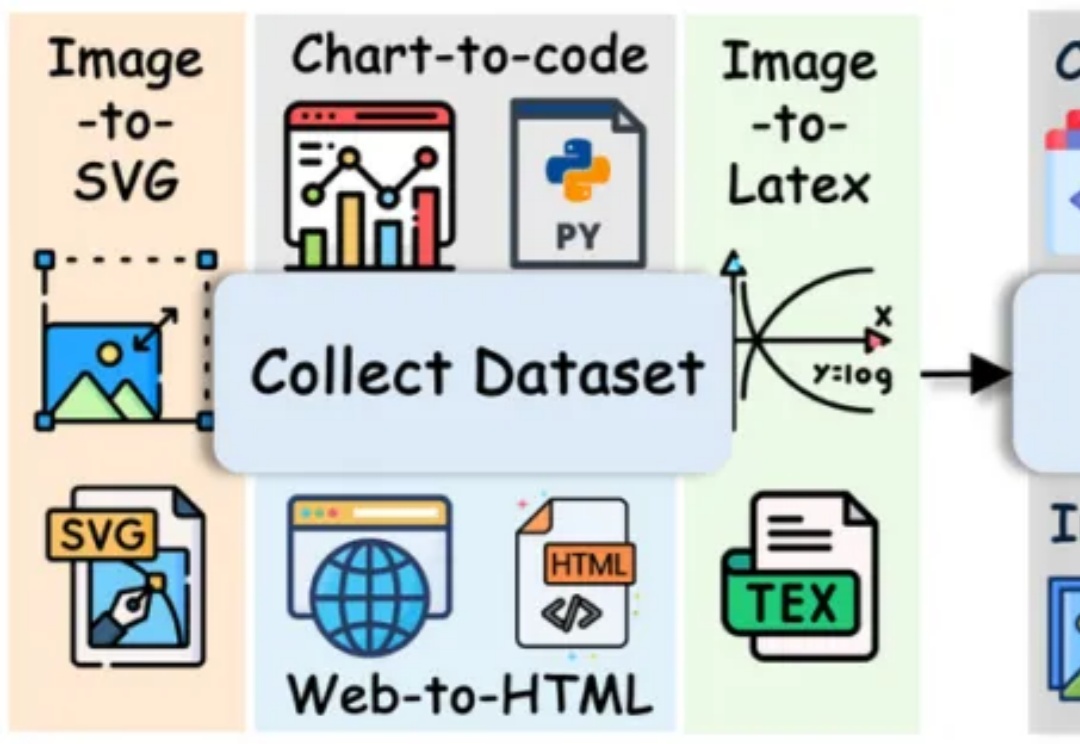

EverMind 团队近日宣布正式发布其旗舰产品 EverMemOS,这是一款面向人工智能智能体的世界级长期记忆操作系统。它旨在成为未来智能体的数据基础设施,为 AI 赋予持久、连贯、可进化的 “灵魂”。

马斯克正以Grok为核心,在X与特斯拉双平台上狂飙推进xAI,从算力、数据到产品生态全面押注通往AGI的道路。在他眼中,AI既是人类最大风险也是最大机遇,他试图用「求真、不设禁忌」的开放路线与超大算力布局,抢占未来通用人工智能的制高点。

数据处理显然就是打工人最核心的痛点之一,哪个职场“牛马”没有被工作中几百到上万条繁杂的Excel数据为难过呢?过程中不仅要从多种数据源粘贴数据,还要处理图片、文字等非结构化内容……

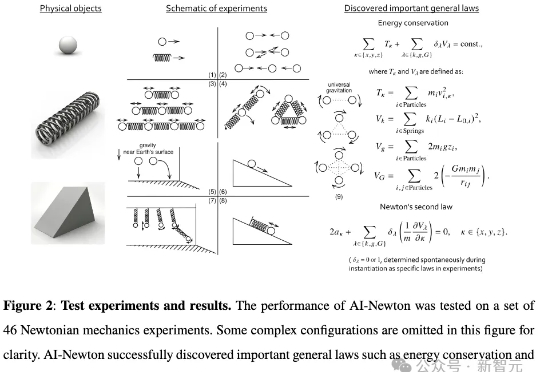

人类数千年的科学探索,如今被AI「顿悟」瞬间复刻。北京大学研究团队推出的名为AI-Newton的AI系统,重新发现了牛顿第二定律、能量守恒定律和万有引力定律等基础规律,这一成果被视作AI驱动自主科学发现的一项重要进展。

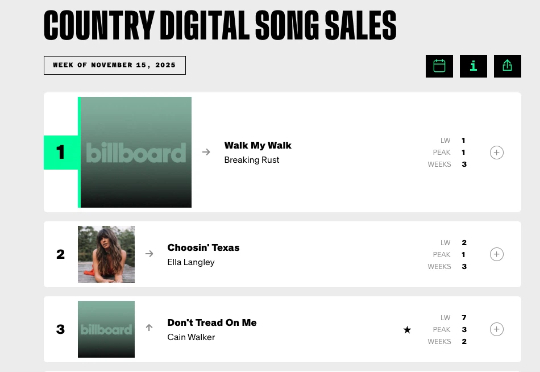

无人注意的角落里,权威榜单 Billboard 接二连三地迎来一批新歌手上榜,低调但行动快速,闷声就登顶了。权威音乐榜单 Billboard 旗下的乡村音乐排名榜,最新首位《Walk My Walk》,是一首 AI 生成的歌曲作品,Breaking Rust 自然也是一位 AI 歌手。从数据来看,它不仅登顶了,还连续在榜了三周。对于任何一个新人来说,都是堪称「爆」了的成绩。

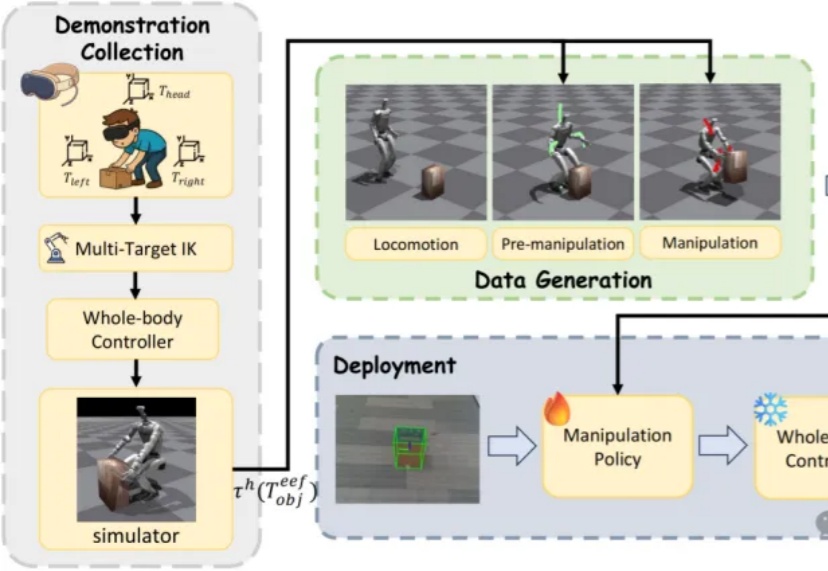

近日,来自北京大学与BeingBeyond的研究团队提出DemoHLM框架,为人形机器人移动操作(loco-manipulation)领域提供一种新思路——仅需1次仿真环境中的人类演示,即可自动生成海量训练数据,实现真实人形机器人在多任务场景下的泛化操作,有效解决了传统方法依赖硬编码、真实数据成本高、跨场景泛化差的核心痛点。