让 AI 一探究竟:任何行业现在都能搜索和汇总大量视觉数据

让 AI 一探究竟:任何行业现在都能搜索和汇总大量视觉数据为提高生产力、优化流程和创造更加安全的空间,埃森哲、戴尔科技和联想等公司正在使用全新 NVIDIA AI Blueprint 开发视觉 AI 智能体。

为提高生产力、优化流程和创造更加安全的空间,埃森哲、戴尔科技和联想等公司正在使用全新 NVIDIA AI Blueprint 开发视觉 AI 智能体。

清华大学NLP实验室联合北京师范大学、中国科学院大学、东北大学等机构的研究人员推出了全新的评测方法 RAGEval,通过快速构建场景化评估数据实现对检索增强生成(RAG)系统的“精准诊断”。

最近,来自上海大学、山东大学和埃默里大学等机构的研究人员首次提出了文本边图的数据集与基准,包括9个覆盖4个领域的大规模文本边图数据集,以及一套标准化的文本边图研究范式。该研究的发表极大促进了文本边图图表示学习的研究,有利于自然语言处理与图数据挖掘领域的深度合作。

2024年7月22日凌晨,xAI创始人Elon Musk在推特上正式宣布,在凌晨4:20分正式启动了世界上最强的AI训练集群。 这个训练集群建设在美国田纳西州孟菲斯市,集合了10 万个液冷H100芯片。

AI智能体能像有机生命一样自适应演化吗?最近清华大学团队提出了AgentSquare模块化智能体设计框架,通过标准化的模块接口抽象,让AI智能体可以通过模块演化和重组高速进化,实现针对不同任务场景的自适应演进,赋能超越人类设计的智能体系统在多种评测数据集上广泛自我涌现。

计算机视觉(Computer Vision)的工作原理与人类视觉类似,但需要机器依靠摄像头、数据和算法在很短的时间内完成任务。

现在正是多模态大模型的时代,图像、视频、音频、3D、甚至气象运动都在纷纷与大型语言模型的原生文本模态组合。而浙江大学及其计算机创新技术研究院的一个数十人团队也将结构化数据(包括数据库、数仓、表格、json 等)视为了一种独立模态。

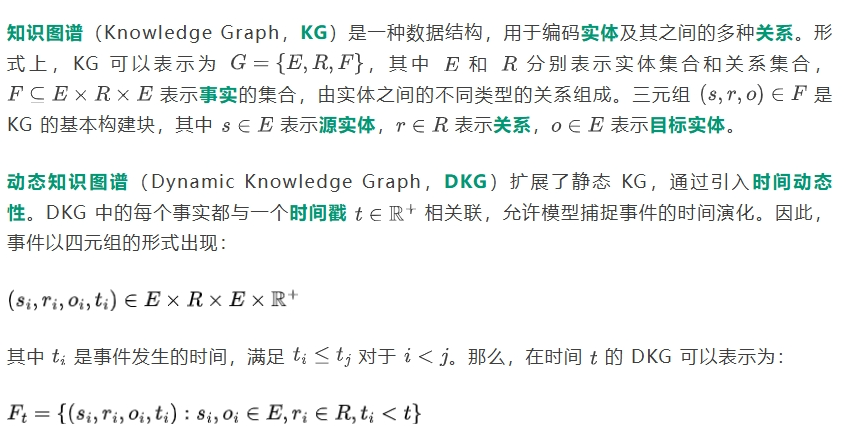

在金融市场中,动态知识图谱(Dynamic Knowledge Graphs,DKGs)是一种表达对象之间随时间变化的多种关系的流行结构。它们可以有效地表示从复杂的非结构化数据源(如文本或图像)中提取的信息。在金融应用中,基于从金融新闻文章中获取的信息,DKGs 可用于检测战略性主题投资的趋势。

在大算力和大数据让基于统计的 AI 模型真正变得强大且有用之前,基于规则的系统长期以来是语言模型的主导范式。

在AI飞速进步和全球市场竞争日益激烈的今天,科技创业者们不断寻求创新的突破口,期望通过技术变革重塑人们的生活和工作方式。PLAUD.AI就是这样一家立足于全球视野的公司,致力于以AI驱动的创新产品为专业用户提供高效的解决方案,目前已交付超30万台,年化收入1亿美金,连续2年达10倍增长。