独家|美团公测AI社区“觅游”,打造人和AI的赛博生活

独家|美团公测AI社区“觅游”,打造人和AI的赛博生活美团推出一个AI社区“觅游”。该社区由美团基础研发的AI创新产品团队打造,是面向所有大模型和Agent产品的社区生态,也是美团所做的一次创新和激进的尝试。

搜索

搜索

美团推出一个AI社区“觅游”。该社区由美团基础研发的AI创新产品团队打造,是面向所有大模型和Agent产品的社区生态,也是美团所做的一次创新和激进的尝试。

智能体时代的核心是算力。

Anthropic在四月初发布Mythos,距离现在已经近一个月。行业内对于它的讨论,更多的关注点在于“它有多强”,但我更想聊聊它的“发布方式”。

据华峰资本消息,近日,北京AI大模型独角兽月之暗面(Kimi)完成新一轮约20亿美元(约合人民币136.22亿元)融资,为中国大模型圈目前最大额融资,投后估值突破200亿美元(约合人民币1362.25亿元)。

在代码大模型和代码智能体技术快速发展的今天,一个日益凸显的现象是:能够在经典代码生成基准上取得优异成绩的模型,一旦被放入真实软件工程环境中,表现却往往大幅下滑。

我最近买了一个这样的键盘——

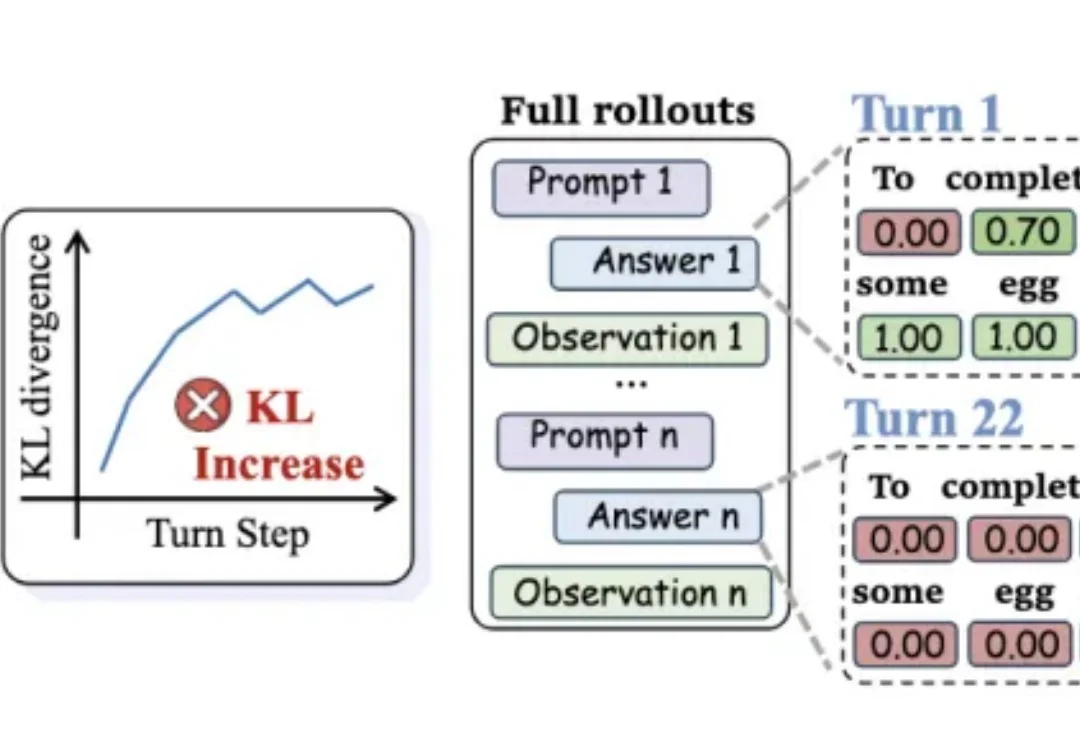

把强大模型的能力“蒸馏”给小模型,听起来很美—— 但放到多轮对话Agent场景里,效果往往一塌糊涂。

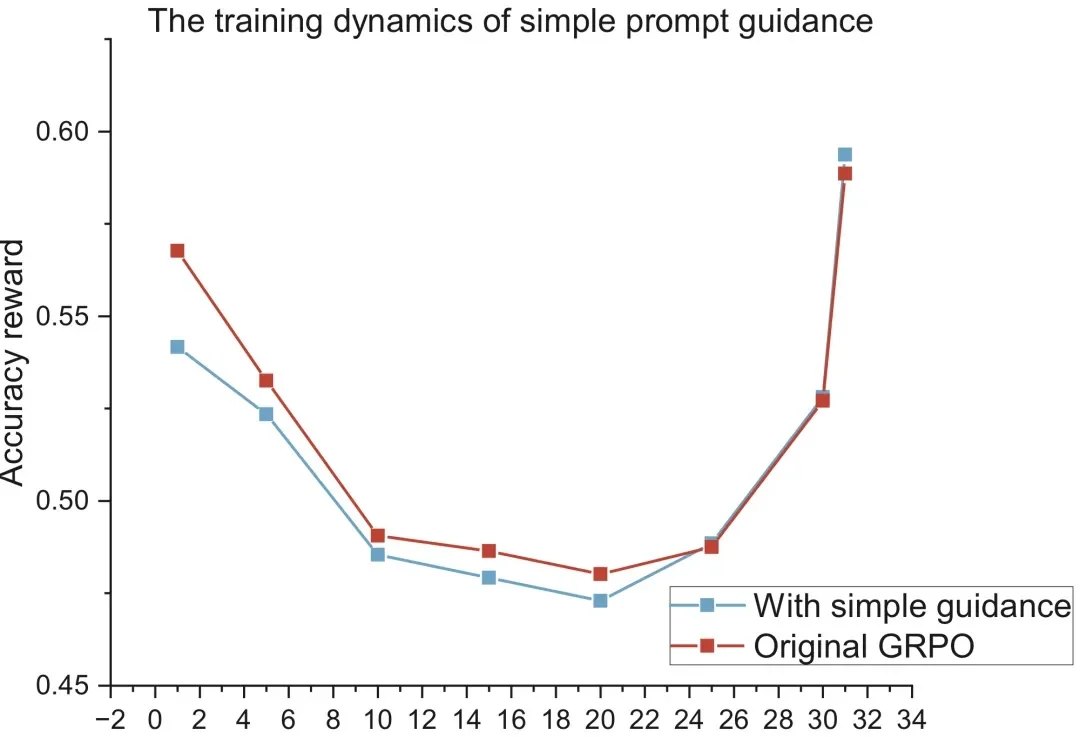

大模型时代的「炼金术师」们,或许都曾面临一个共同的困扰:当我们试图将 DeepSeek-R1、OpenAI-o1 那种惊艳的推理能力迁移到小规模语言模型(SLMs)时,效果却总是差强人意。现有的强化学习方法如 GRPO 在 7B+ 的大模型上效果显著,但一旦应用到 1.7B 甚至更小参数的模型上,性能提升就微乎其微。

在对多位内部开发者的采访中得知,这个模型的研发已被叫停。LPM 1.0 并非仍在推进的核心项目,而是视频团队对过去一年工作成果的集中汇报——既是对外展示,也是对内总结。该视频团队由“童姥”( 前微软亚研院首席研究员童欣) 带领, AilingZeng做Tech Lead,作者中近半数来自 Anuttacon内部,蔡浩宇本人并未直接参与模型研发。

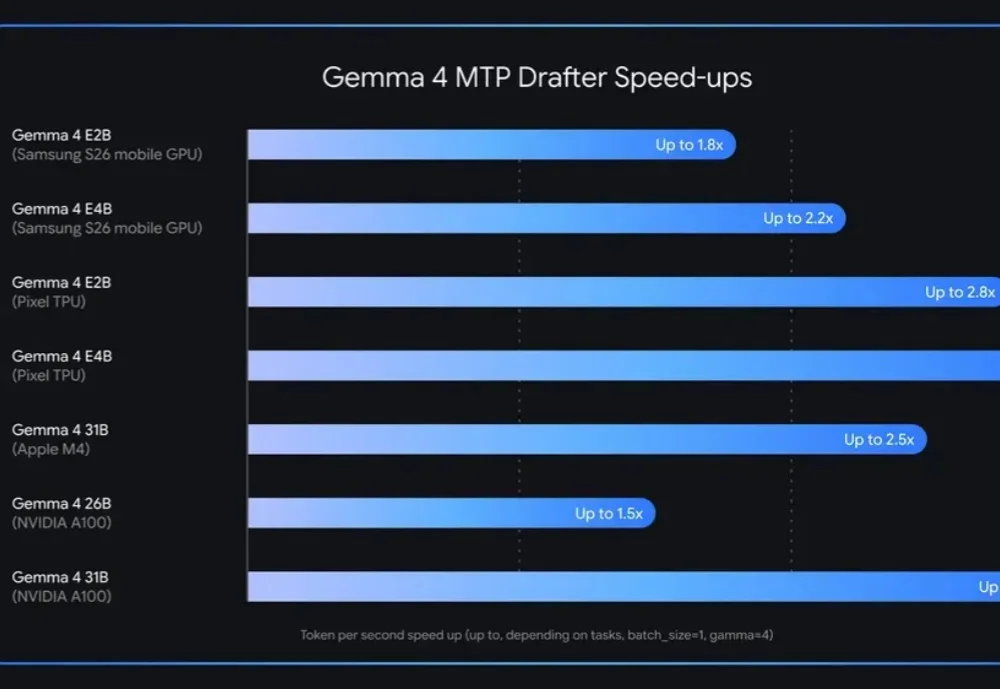

谷歌刚刚给Gemma 4家族更新了一项关键能力:Multi-Token Prediction(MTP)推测解码架构,推理速度最高提升3倍,输出质量不变。