暴跌漩涡中,软件选择主动被大模型“吞噬”

暴跌漩涡中,软件选择主动被大模型“吞噬”2011年,Marc Andreessen写下“软件正在吞噬世界”。2026 年,Fortune用了一句话总结当前局面:“那个吃掉世界的东西,正在被吃掉。 ”

搜索

搜索

2011年,Marc Andreessen写下“软件正在吞噬世界”。2026 年,Fortune用了一句话总结当前局面:“那个吃掉世界的东西,正在被吃掉。 ”

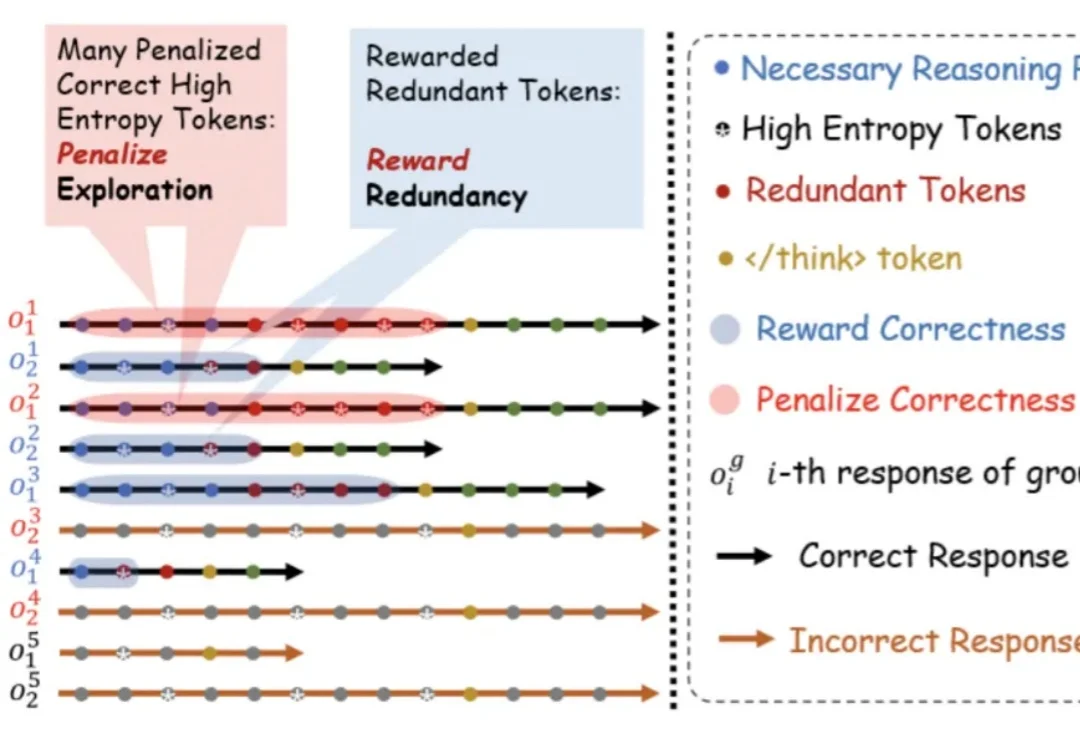

以 DeepSeek-R1、OpenAI GPT Thinking 为代表的大型推理模型,通过长达数千 token 的「思维链」在各类复杂推理任务中展现出卓越的性能。然而,这些模型普遍存在一个核心问题,即过度思考(overthinking) :

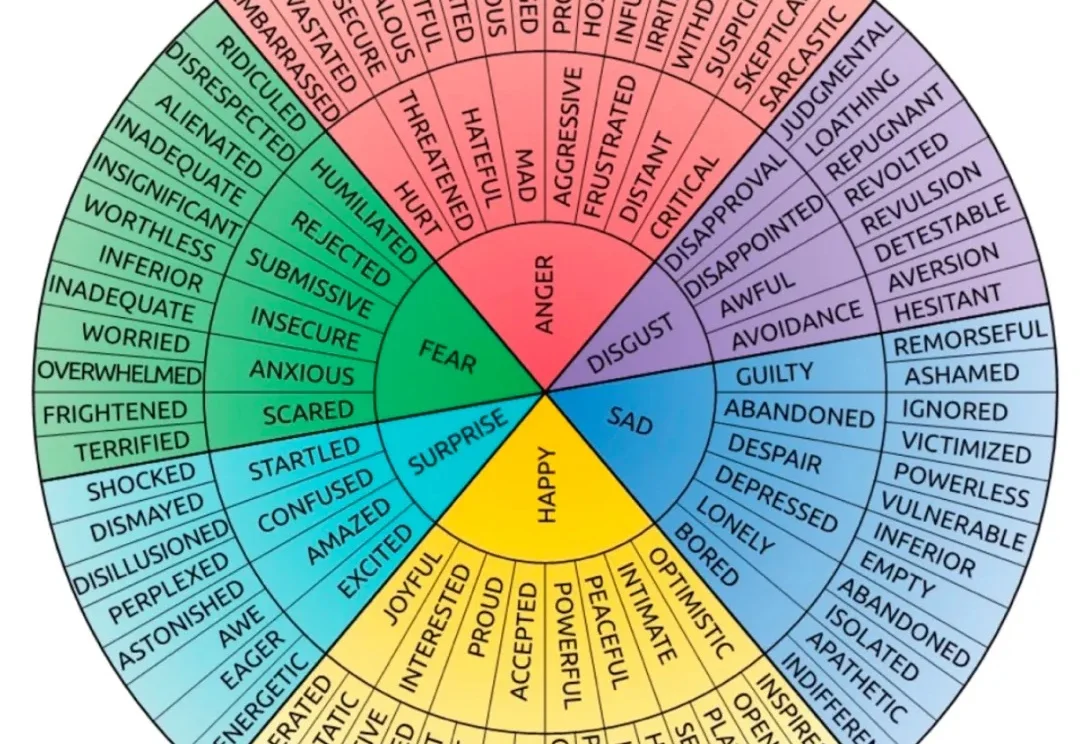

随着语音、视频、多模态能力不断融入大语言模型(LLM),人与 AI 的交互正在越来越接近自然对话。今天的 LLM 不再只是回答问题的工具,也越来越多地出现在教育、客服、陪伴、心理健康等高度依赖情绪理解的场景中。

当 AI 开始加速 AI,模型公司的迭代周期正在被进一步压缩,模型公司开始进入“月更时代”。

快手计划分拆旗下视频生成大模型业务可灵 AI,以 200 亿美元估值融资——截至今天港股收盘,整个快手公司目前的市值不到 290 亿美元。可灵当前的年化收入(ARR)已经达到 5 亿美元,已比春节前翻倍。

如果你让大模型给林黛玉找一个外国文学里的平替,它能给出令人信服的答案吗?这个脑洞的背后其实是当下人工智能最核心的软肋——“类比推理”能力。

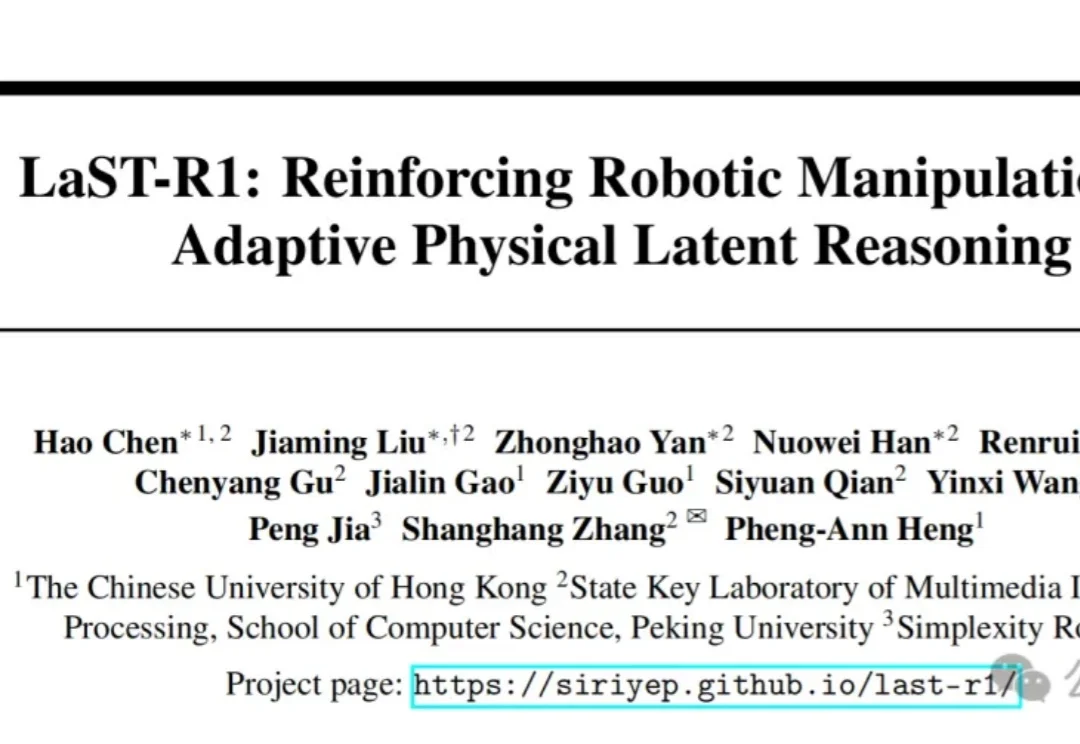

机器人拉个拉链,到底需不需要“脑子”?

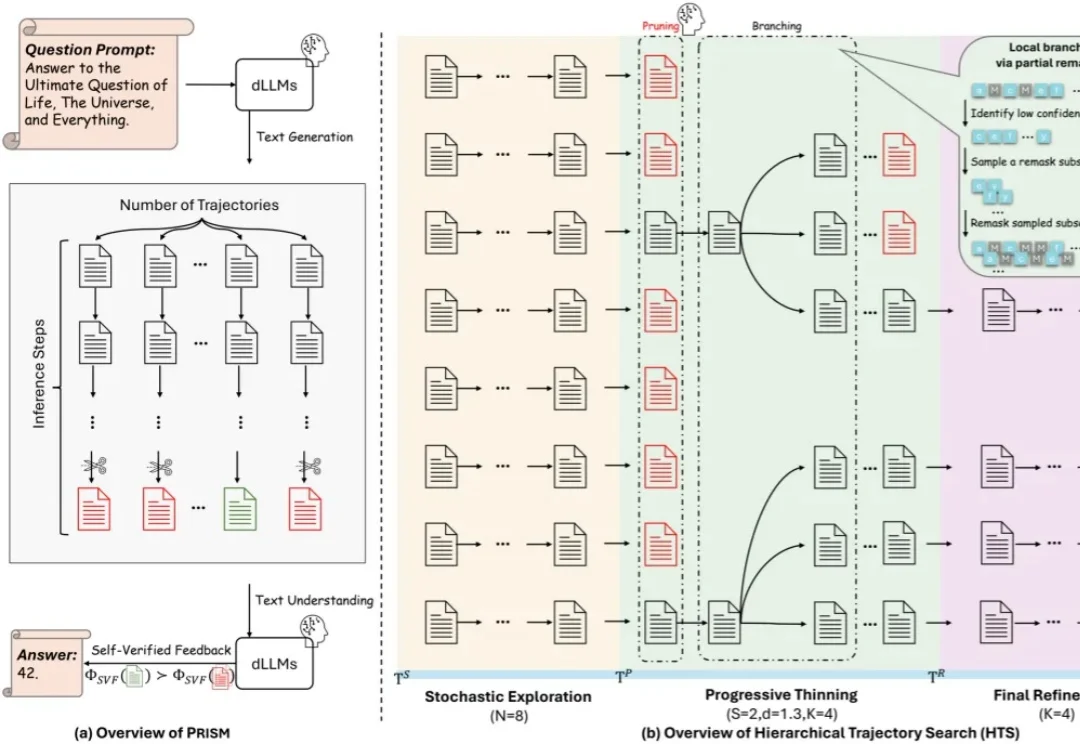

近年来,大模型能力提升的焦点正在从「训练时扩展」转向「推理时扩展」。从 Best-of-N、Self-Consistency 到更复杂的搜索与验证框架,Test-Time Scaling 已经成为提升大模型复杂推理能力的重要范式。

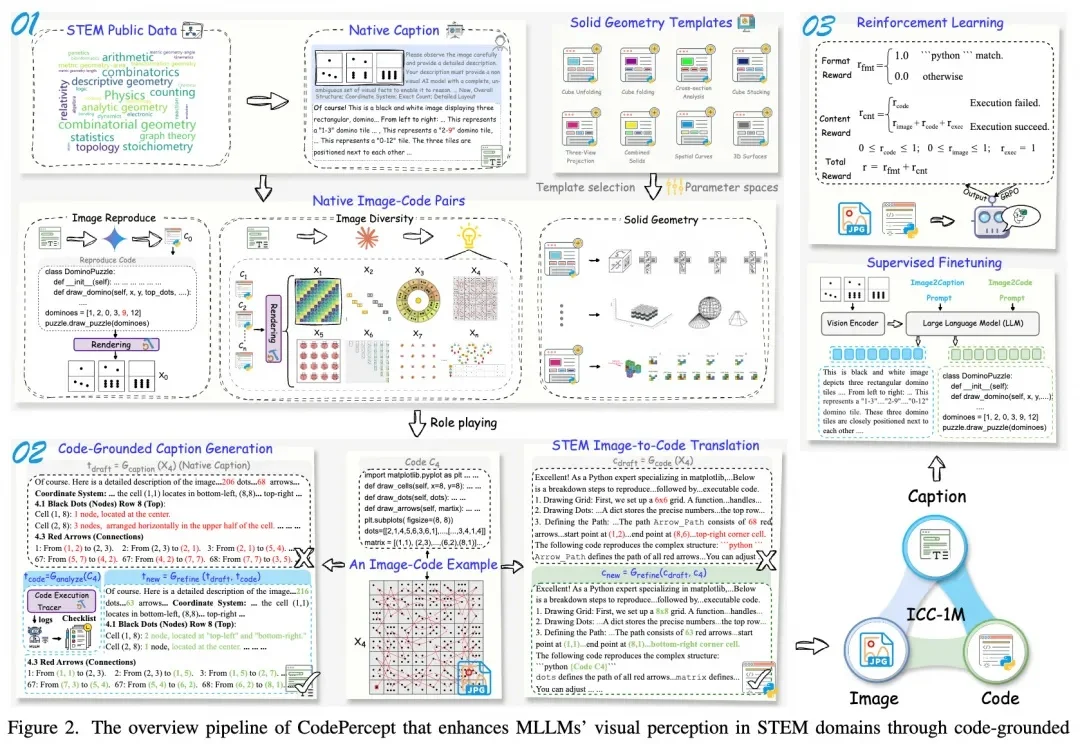

当多模态大语言模型(MLLMs)在面对科学、技术、工程和数学(STEM)领域的视觉推理题时频频「翻车」,一个根本性的问题摆在了所有研究者面前:大模型做不出理科题,究竟是因为「脑子笨」(推理能力受限),还是因为「眼神差」(视觉感知缺陷)?

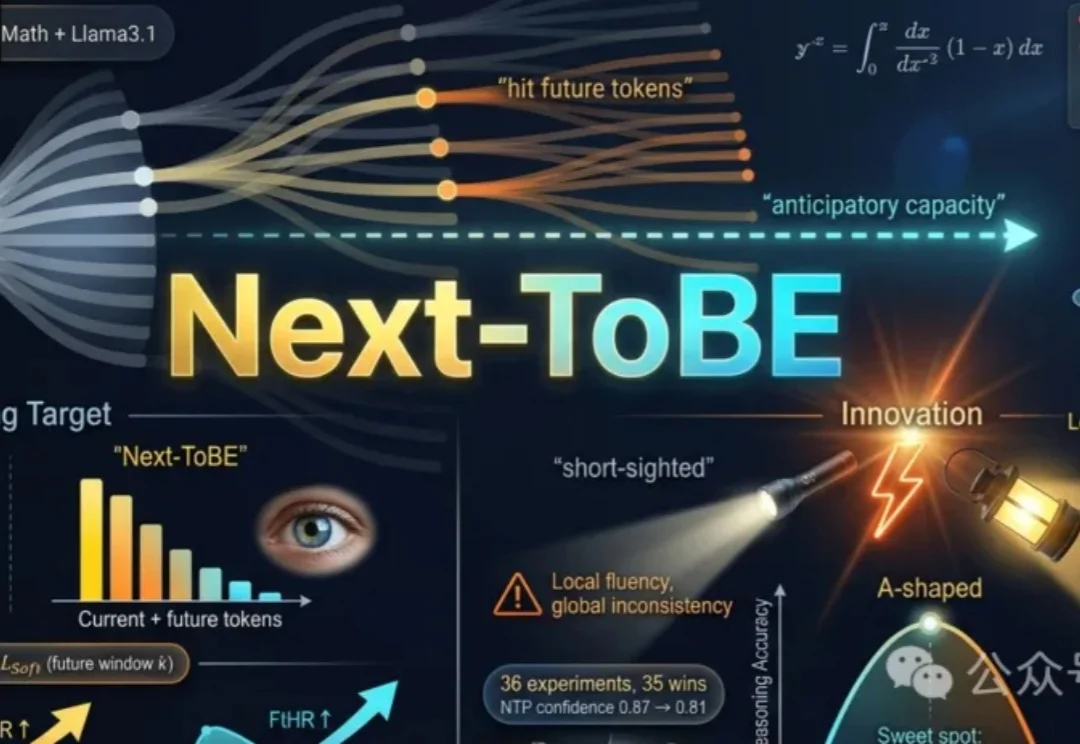

大模型常因只关注当前预测而显得短视。Next-ToBE通过调整训练目标,让模型在每一步预测时兼顾未来token分布,从而提升整体推理能力。