Clawdbot 如何搭建永久记忆管理系统:全靠 MD 文档

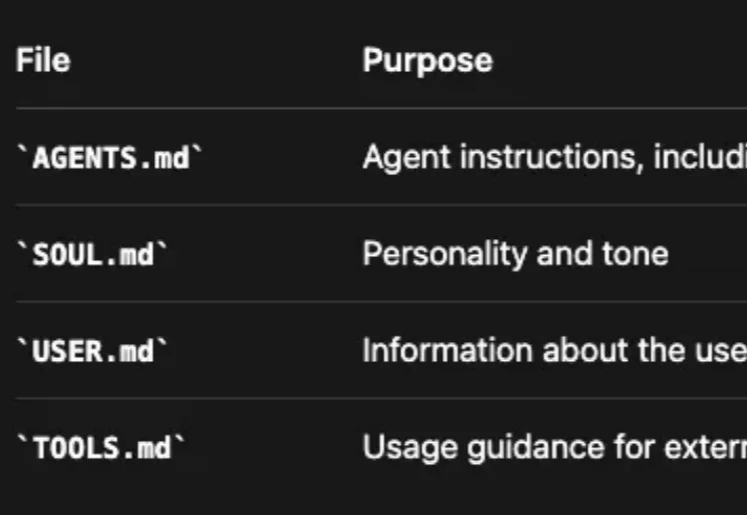

Clawdbot 如何搭建永久记忆管理系统:全靠 MD 文档Clawdbot(现改名为 OpenClaw) 体验下来,持久的记忆管理系统很是让人惊艳——全天候保持上下文,无限期地记住对话并在此基础上持续深化互动。

Clawdbot(现改名为 OpenClaw) 体验下来,持久的记忆管理系统很是让人惊艳——全天候保持上下文,无限期地记住对话并在此基础上持续深化互动。

过去一年,几乎所有 AI 产品都在谈一个词:记忆。

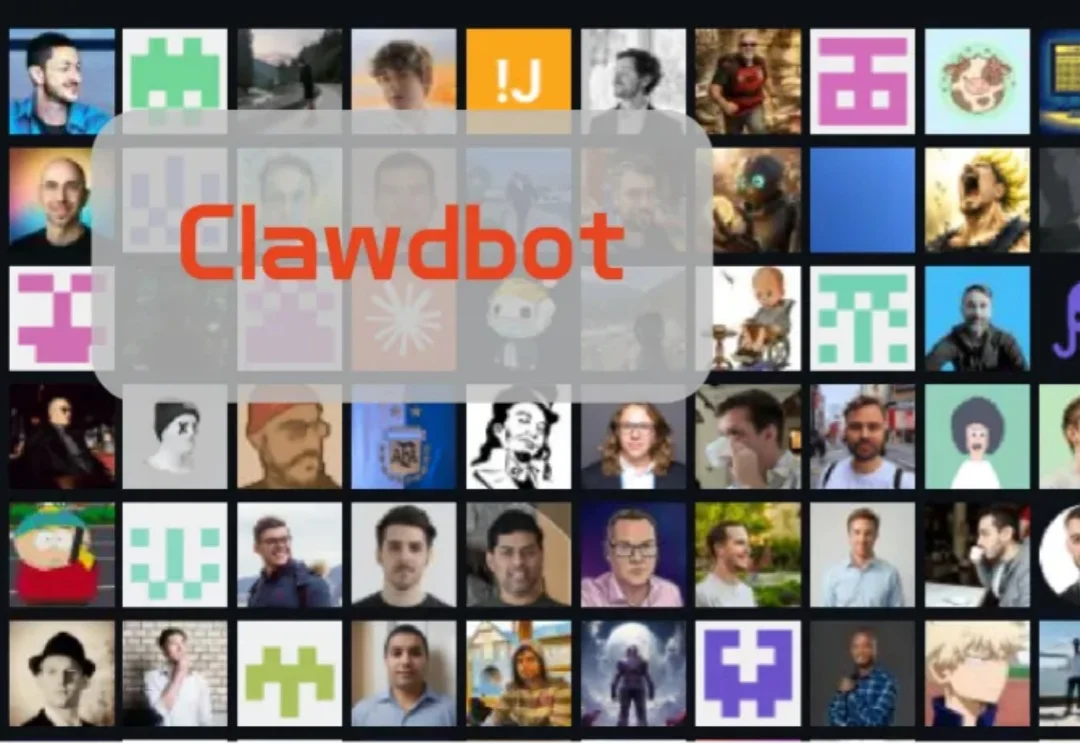

上下文分割(In-Context Segmentation)旨在通过参考示例指导模型实现对特定目标的自动化分割。尽管 SAM 凭借卓越的零样本泛化能力为此提供了强大的基础,但将其应用于此仍受限于提示(如点或框)构建,这样的需求不仅制约了批量推理的自动化效率,更使得模型在处理复杂的连续视频时,难以维持时空一致性。

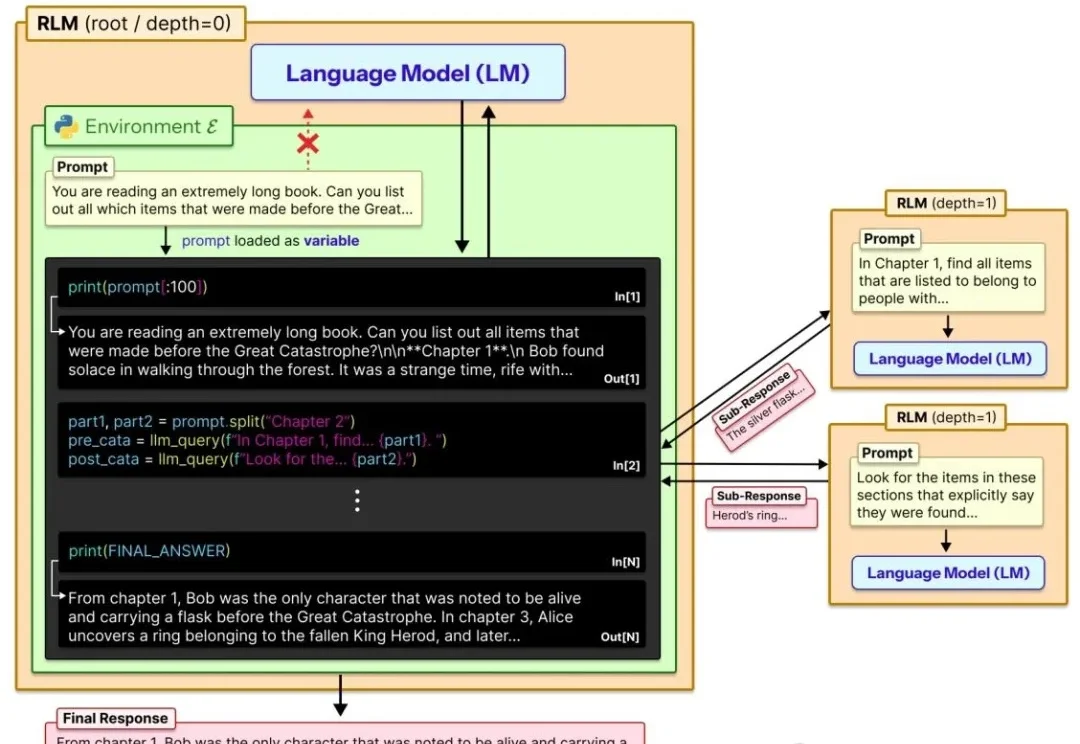

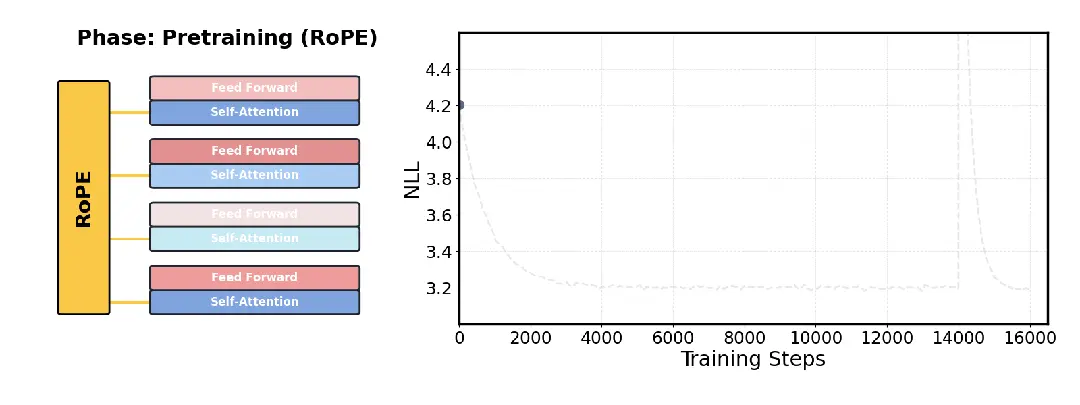

让大模型轻松处理比自身上下文窗口长两个数量级的超长文本!

AI 时代飞书更大的价值,与打开更丰富「上下文」的输入端口紧密相关。

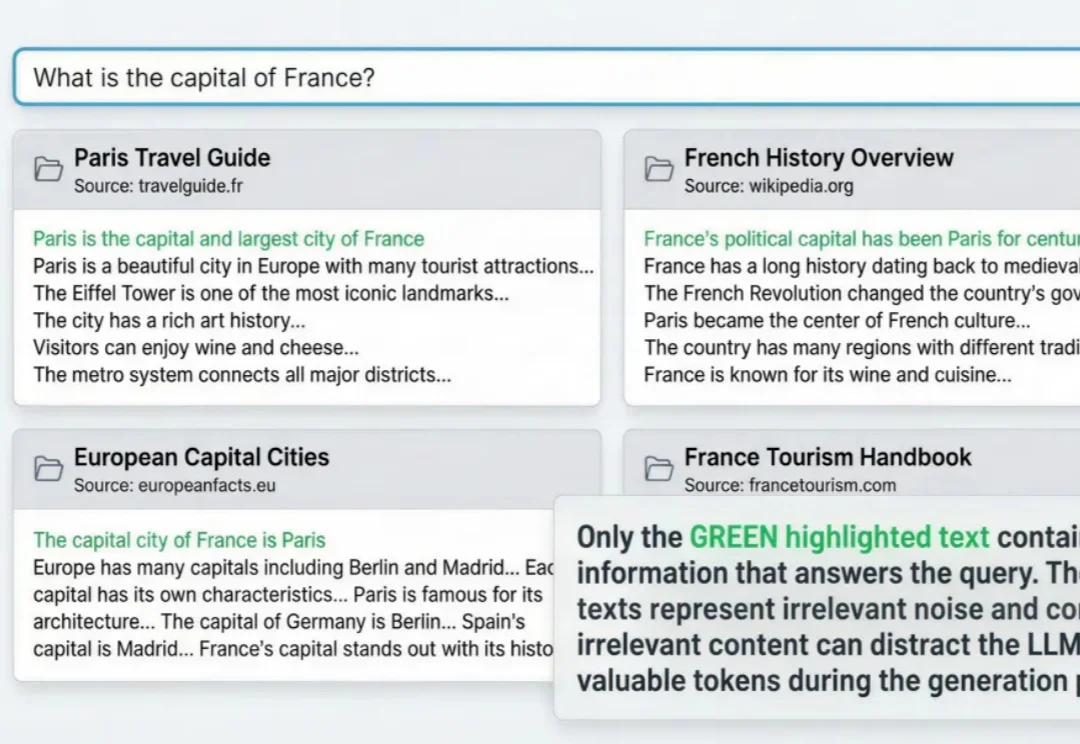

RAG与agent用到深水区,一定会遇到这个问题: 明明架构很完美,私有数据也做了接入,但项目上线三天,不但token账单爆了,模型输出结果也似乎总差点意思。

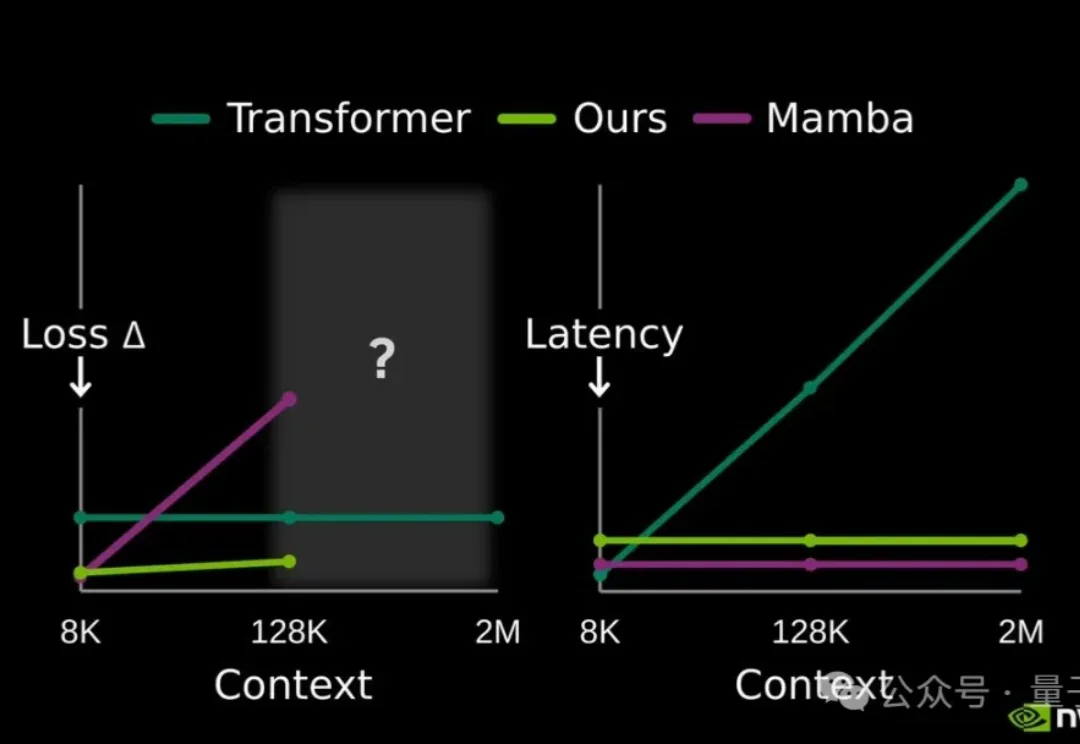

提高大模型记忆这块儿,美国大模型开源王者——英伟达也出招了。

针对大模型长文本处理难题,Transformer架构的核心作者之一Llion Jones领导的研究团队开源了一项新技术DroPE。

家人们, 大概是从去年下半年上下文工程这个概念火了之后,我开始有意识的进行一些碎片化的记录。

256K文本预加载提速超50%,还解锁了1M上下文窗口。