OpenAI诈骗?GPT-4.1正式上线ChatGPT,网友实测却大呼失望

OpenAI诈骗?GPT-4.1正式上线ChatGPT,网友实测却大呼失望GPT-4.1,在ChatGPT中可用了!现在,它不仅在API中开放,Plus、Pro和Team用户都可以使用。网友们兴奋地展开实测后,纷纷吐槽:OpenAI这是诈骗吧,说好的一百万超长上下文呢?

GPT-4.1,在ChatGPT中可用了!现在,它不仅在API中开放,Plus、Pro和Team用户都可以使用。网友们兴奋地展开实测后,纷纷吐槽:OpenAI这是诈骗吧,说好的一百万超长上下文呢?

聊完就忘?当下多数AI助手和开发工具各自独立运行,会话结束上下文即消失,严重影响了使用体验和效率。

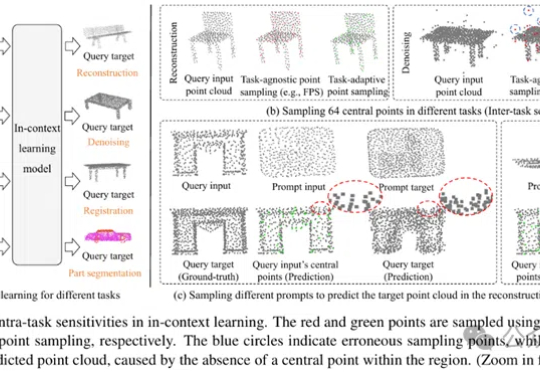

MICAS是一种专为3D点云上下文学习设计的多粒度采样方法,通过任务自适应点采样和查询特定提示采样,提升模型在点云重建、去噪、配准和分割等任务中的稳健性和适应性,显著优于现有技术。

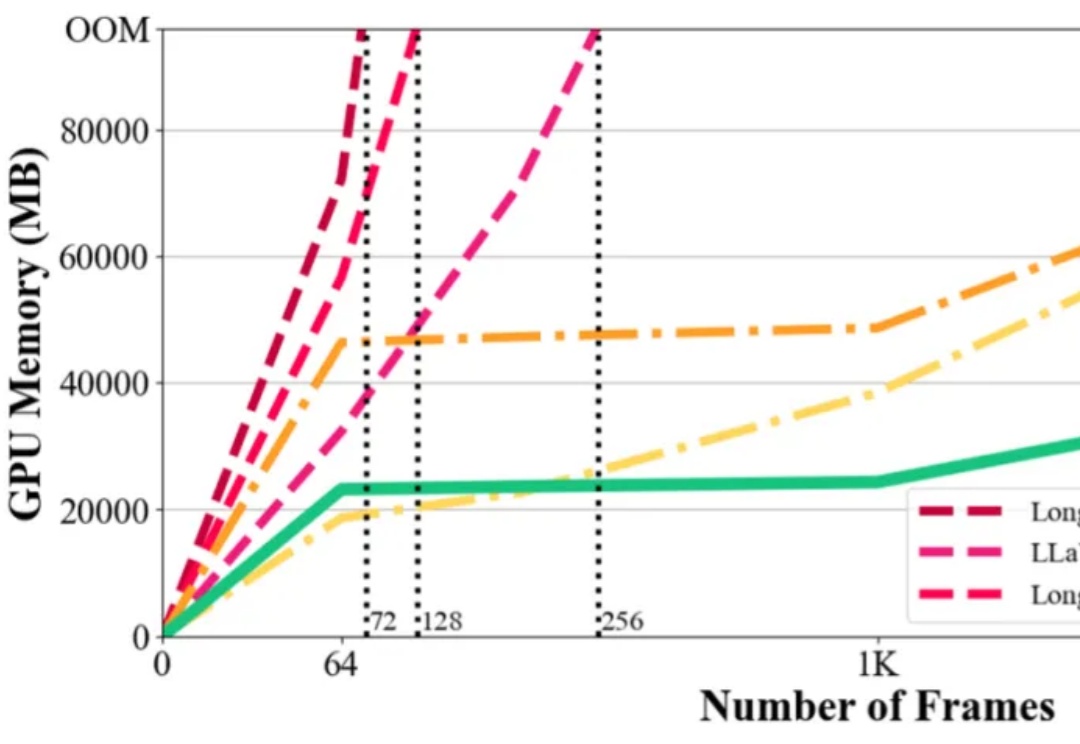

在视觉语言模型(Vision-Language Models,VLMs)取得突破性进展的当下,长视频理解的挑战显得愈发重要。以标准 24 帧率的标清视频为例,仅需数分钟即可产生逾百万的视觉 token,这已远超主流大语言模型 4K-128K 的上下文处理极限。

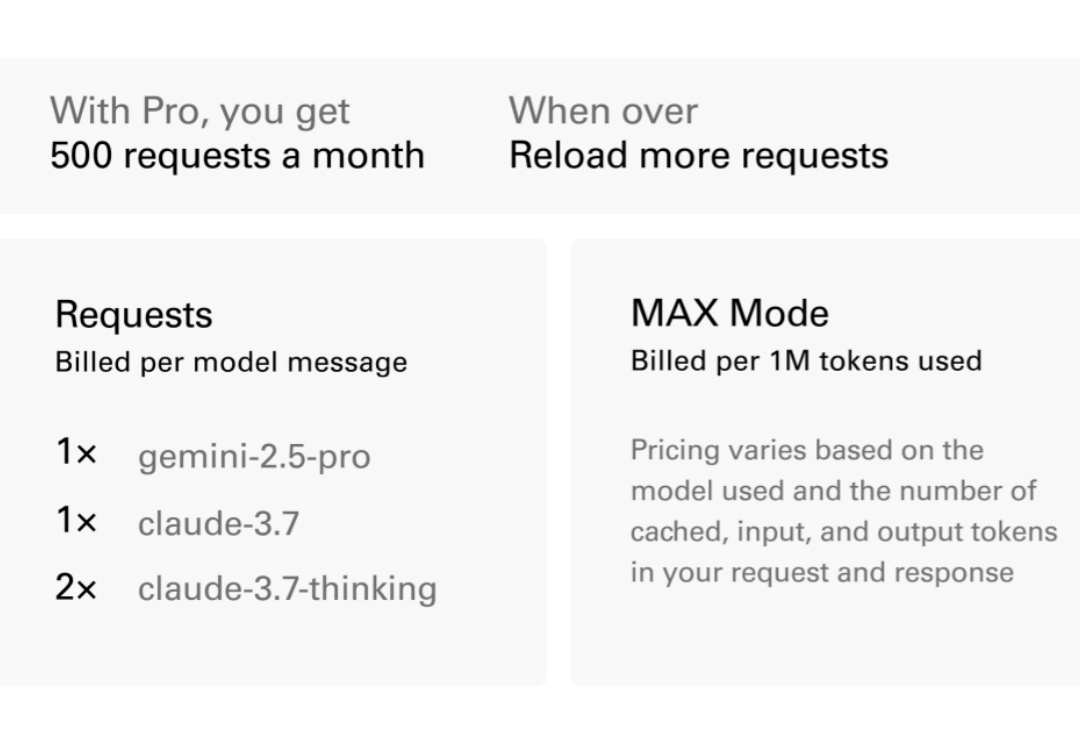

简单来说,Cursor 0.50 版本核心亮点包括:计费模式大统一、Max Mode 能力爆表、超前瞻的后台 Agent、代码库上下文理解MAX、编辑体验丝滑、多项目工作区支持,以及一系列聊天功能优化!设计师们(哦不,是开发者们)估计又要惊呼YYDS了!

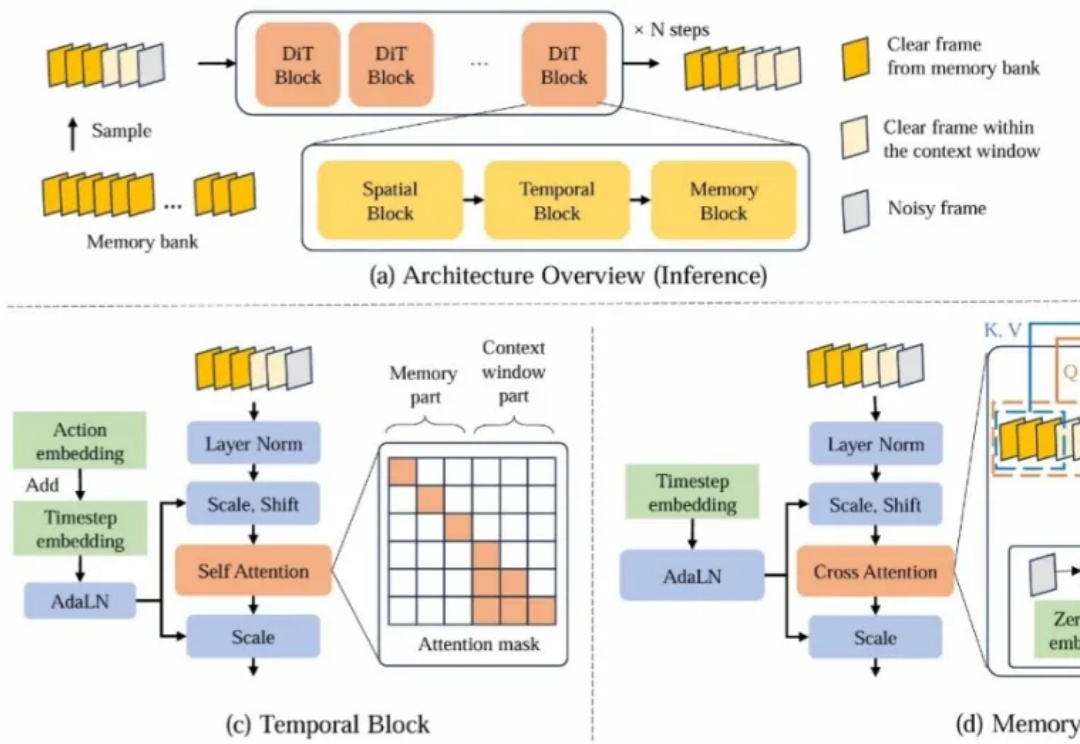

近年来,基于视频生成模型的可交互世界生成引发了广泛关注。尽管现有方法在生成质量和交互能力上取得了显著进展,但由于上下文时间窗口受限,生成的世界在长时序下严重缺乏一致性。

大型语言模型(LLMs)在上下文知识理解方面取得了令人瞩目的成功。

来自英伟达和UIUC的华人团队提出一种高效训练方法,将LLM上下文长度从128K扩展至惊人的400万token SOTA纪录!基于Llama3.1-Instruct打造的UltraLong-8B模型,不仅在长上下文基准测试中表现卓越,还在标准任务中保持顶尖竞争力。

今天,在首届LlamaCon开发者大会上,Meta正式发布了对标ChatGPT的智能助手Meta AI App,并宣布面向开发者提供官方Llama API服务的预览版本。Meta AI App是一款智能助手,基于Llama模型打造,可通过社交媒体账号了解用户偏好、记住上下文。与ChatGPT一样,Meta AI App支持语音和文本交互,并额外支持了全双工语音交互(Full-duplex,

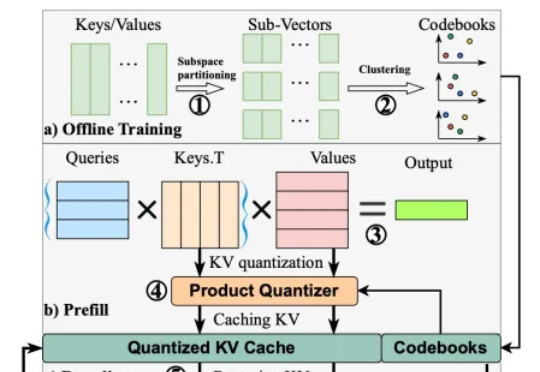

在以 transformer 模型为基础的大模型中,键值缓存虽然用以存代算的思想显著加速了推理速度,但在长上下文场景中成为了存储瓶颈。为此,本文的研究者提出了 MILLION,一种基于乘积量化的键值缓存压缩和推理加速设计。