刚刚,谷歌AI路线图曝光:竟要抛弃注意力机制?Transformer有致命缺陷!

刚刚,谷歌AI路线图曝光:竟要抛弃注意力机制?Transformer有致命缺陷!未来AI路线图曝光!谷歌发明了Transformer,但在路线图中承认:现有注意力机制无法实现「无限上下文」,这意味着下一代AI架构,必须「从头重写」。Transformer的时代,真的要终结了吗?在未来,谷歌到底有何打算?

未来AI路线图曝光!谷歌发明了Transformer,但在路线图中承认:现有注意力机制无法实现「无限上下文」,这意味着下一代AI架构,必须「从头重写」。Transformer的时代,真的要终结了吗?在未来,谷歌到底有何打算?

本文深入剖析 MiniCPM4 采用的稀疏注意力结构 InfLLM v2。作为新一代基于 Transformer 架构的语言模型,MiniCPM4 在处理长序列时展现出令人瞩目的效率提升。传统Transformer的稠密注意力机制在面对长上下文时面临着计算开销迅速上升的趋势,这在实际应用中造成了难以逾越的性能瓶颈。

最近,来自约翰・霍普金斯大学与中国人民大学的团队设计了三套实验,专门把关键线索藏在上下文之外,逼模型「凭记忆」作答,从而检验它们是否真的在脑海里保留了信息。

豆包大模型1.6惊艳亮相,成为国内首款多模态SOTA模型,256k对话窗口,深度思考最长上下文。它不仅能看会想,还能动手操作GUI,国内最有潜力考清北。

问题越常见,所需上下文越少。比如"写个博客网站"这类典型教学案例,模型生成这类代码易如反掌。但面对缺乏训练数据的新颖需求时,你必须精确描述需求、提供API文档等完整上下文,难度会指数级上升。

上下文长度达 13 万 token,适用于多段文档综合分析、金融、法律、科研等复杂领域任务。

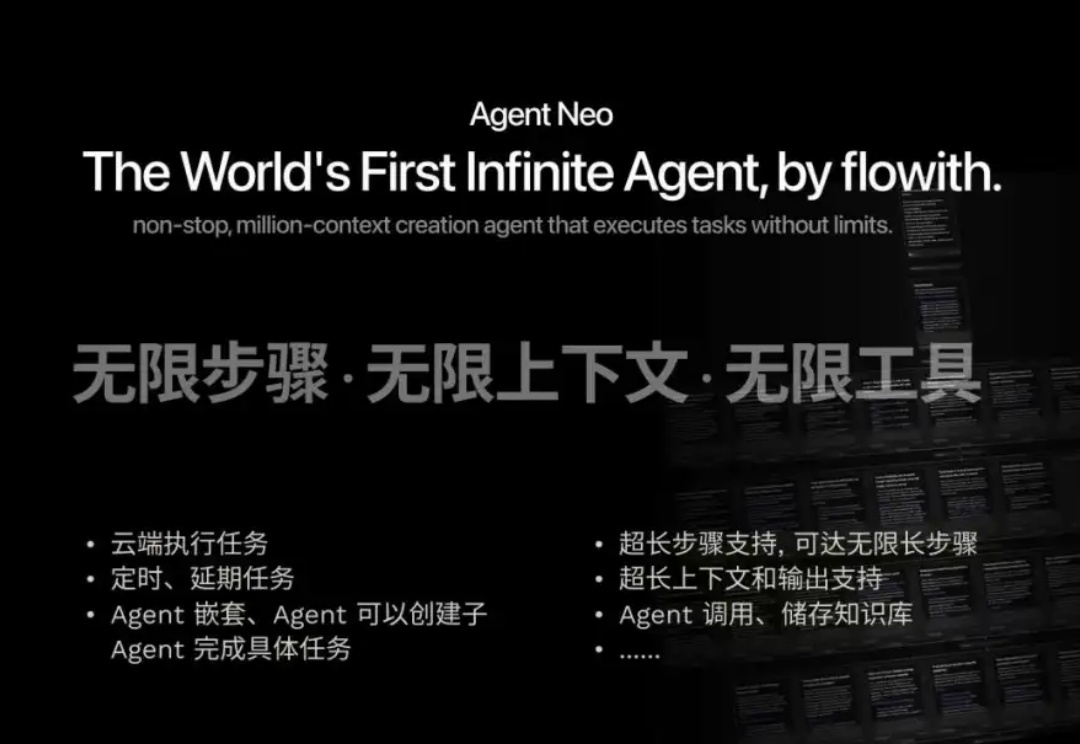

Flowith 发布了它们最新的 Agent,Neo,这是世界上第一个能够做到无限上下文,无限推理步骤的 Agent,并且它还拥有着无限输出的能力。

AI不再相信人类 关于 Agent, flowith 给出了自己的答案 —— Neo

得益于AI上下文和审美能力的提升,现在做HTML已经没什么门槛了,可以应用到很多方面,例如小红书封面、PPT、原型图、数据看板等等。

北京时间5月21日凌晨,谷歌在每年一度的I/O大会上再度炸场——谷歌搜索的AI模式正式上线。其中,最受瞩目的一个功能是Personal Context(个人上下文)。北京时间5月21日凌晨,谷歌在每年一度的I/O大会上再度炸场——谷歌搜索的AI模式正式上线。其中,最受瞩目的一个功能是Personal Context(个人上下文)。