ACL 2026 | LCA:DeepSeek 长文本加速神器,90% KV 缓存缩减 + 2.5 倍推理提速

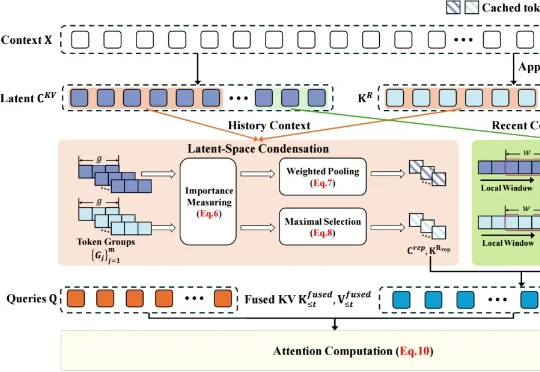

ACL 2026 | LCA:DeepSeek 长文本加速神器,90% KV 缓存缩减 + 2.5 倍推理提速近日,琶洲实验室、华南理工大学、蔻町(AIGCode)等单位科研团队联合提出潜在空间压缩注意力(Latent-Condensed Attention,LCA),研究成果入选 ACL 2026。

搜索

搜索

近日,琶洲实验室、华南理工大学、蔻町(AIGCode)等单位科研团队联合提出潜在空间压缩注意力(Latent-Condensed Attention,LCA),研究成果入选 ACL 2026。

作为一个提供AI Workforce的新产品,Helio(https://helio.im) 正在做像人的 AI,而不是给人用的 AI 工具,要让 AI 同事成为团队的原住民。

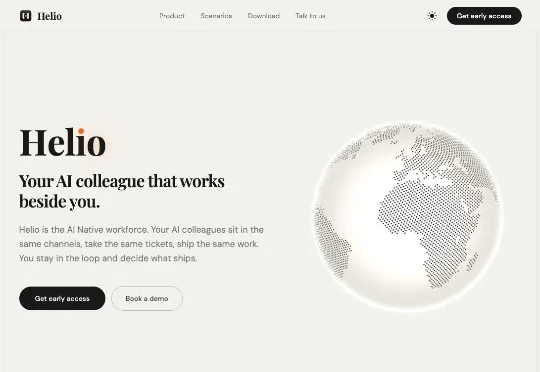

2026 年初,浙江大学发表了一篇系统性的 SoK 论文《Agent Skills for Large Language Models: Architecture, Acquisition, Security, and the Path Forward》,给Skill下了一个正式定义。

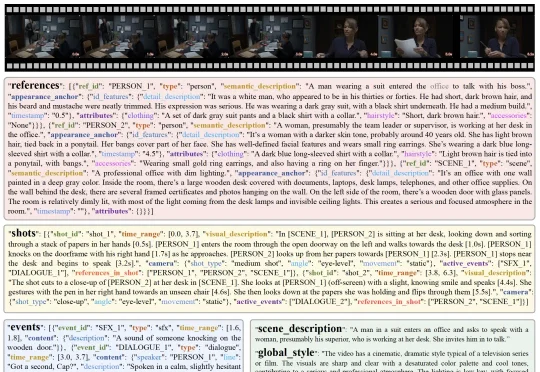

腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

a16z Speedrun SR006里有60家公司,57%做B2B。只有一家做Audio。我们和它的创始人Artin聊了45分钟,发现它踩中的东西比看起来大得多。SUN — AI-native audio learning, built around youAI让音频内容的生成成本暴跌80倍,但没有人把这件事变成一个主动为你服务的消费级学习产品

《读佳》获知,Soul推出AI语音创作平台“AudioFactory”,基于生成式人工智能模型技术为用户提供丰富、多样的AI功能服务,包括但不限于播客AI生成、语音生成合成、AI生成文案等,具体以播客生成、音色克隆等AI语音功能为主,或为其冲击港股IPO再添技术筹码。

哈啰推出一款AI面试相关的产品“HiOffers AI”,主打AI语音模拟面试、智能简历诊断、JD 精准匹配优化,一站式帮求职者系统性提升面试竞争力,高效拿下Offer。

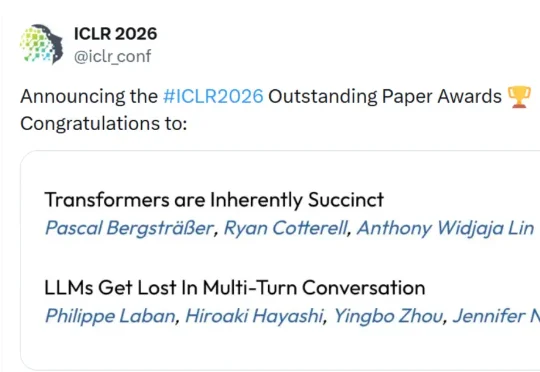

机器之心编辑部 ICLR 2026 获奖论文已经公布。 今年共有 2 篇论文获得「杰出论文奖」(Outstanding Paper),另有 1 篇论文获得「荣誉提名」(Honorable Mention);此外,还有 2 篇 ICLR 2016 论文获得「时间检验奖」(Test of Time Award)。

PlayerZero 刚刚宣布完成了 1500 万美元的 A 轮融资,由 Foundation Capital 的 Ashu Garg 领投,他也是 Databricks 的早期支持者。这是继 Green Bay Ventures 领投的 500 万美元种子轮之后的又一轮融资。

阶跃星辰今日发布新一代自动语音识别模型StepAudio 2.5 ASR。该模型面向语音转写与长音频处理场景,在架构上引入Multi-Token Prediction(多Token预测)以提升推理效率,并通过扩展上下文窗口强化长内容识别能力。