刚刚,Bengio官宣创业!急筹3000万专治AI欺骗人类,图灵三巨头全下场

刚刚,Bengio官宣创业!急筹3000万专治AI欺骗人类,图灵三巨头全下场图灵奖得主Yoshua Bengio重磅官宣创办非营利机构LawZero,致力研发「设计即安全」的AI系统,以对抗AI军备竞赛带来的风险。主张构建不具行动性、以理解世界为目标的可信AI。

搜索

搜索

图灵奖得主Yoshua Bengio重磅官宣创办非营利机构LawZero,致力研发「设计即安全」的AI系统,以对抗AI军备竞赛带来的风险。主张构建不具行动性、以理解世界为目标的可信AI。

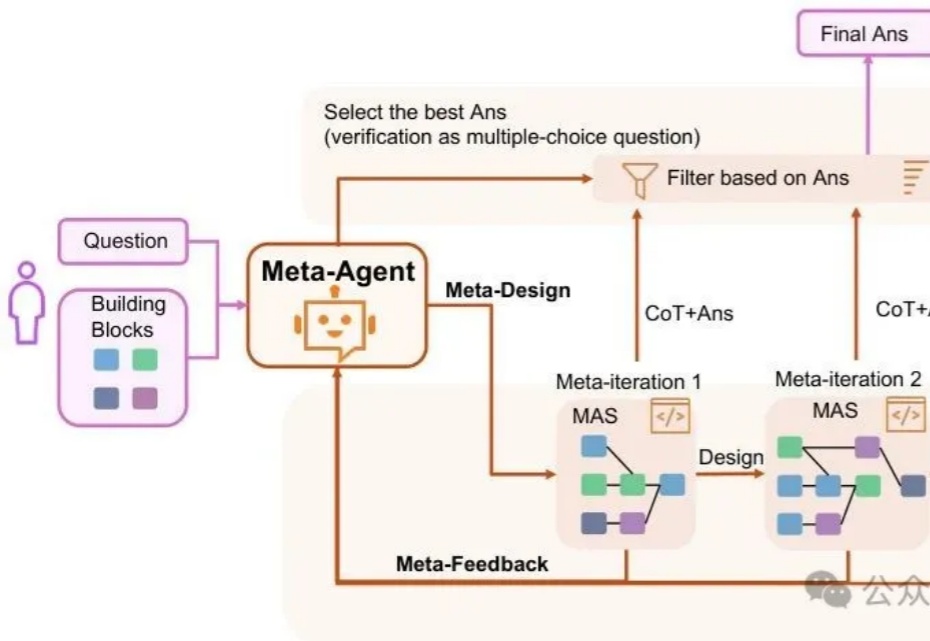

主席在《矛盾论》中强调"具体问题具体分析,是Marxism的活的灵魂"。而在AI领域,我们终于有了一个能够践行这一哲学思想的技术框架——MAS-ZERO,帮我们构建能够因地制宜、因时制宜的智能系统。

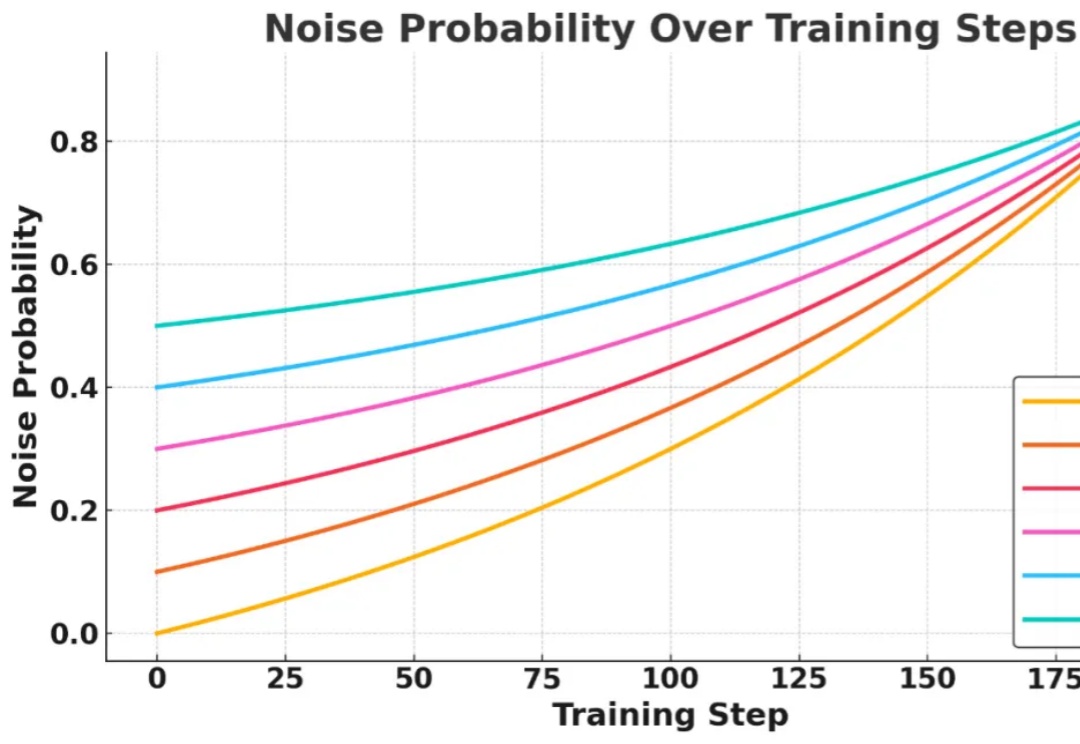

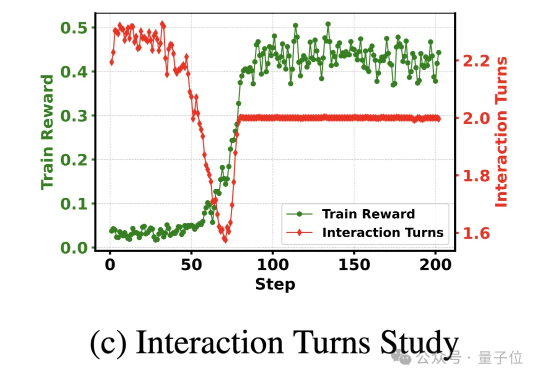

信息检索能力对提升大语言模型 (LLMs) 的推理表现至关重要,近期研究尝试引入强化学习 (RL) 框架激活 LLMs 主动搜集信息的能力,但现有方法在训练过程中面临两大核心挑战:

新增 Qwen3-0.6B 在 Ag_news 数据集 Zero-Shot 的效果。新增 Qwen3-0.6B 线性层分类方法的效果。

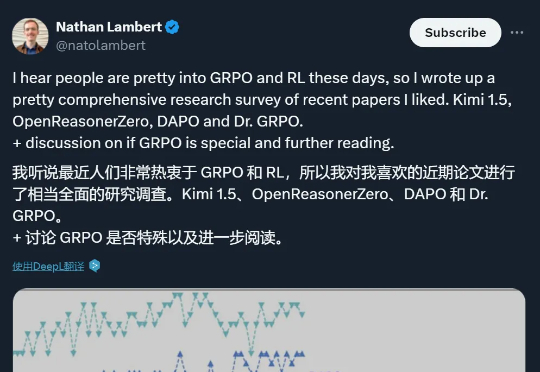

本文详细解读了 Kimi k1.5、OpenReasonerZero、DAPO 和 Dr. GRPO 四篇论文中的创新点,读完会对 GRPO 及其改进算法有更深的理解,进而启发构建推理模型的新思路。

强化学习(RL)+真实搜索引擎,可以有效提升大模型检索-推理能力。

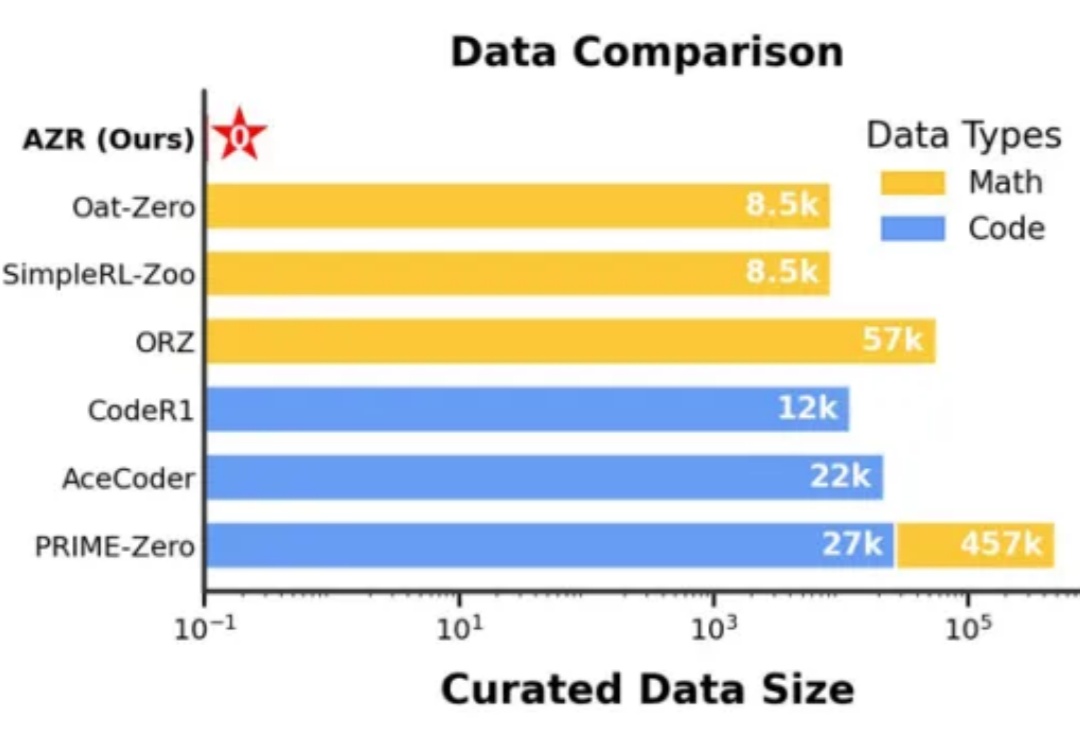

不用引入外部数据,通过自我博弈(Self-play)就能让预训练大模型学会推理?

在人工智能领域,推理能力的进化已成为通向通用智能的核心挑战。近期,Reinforcement Learning with Verifiable Rewards(RLVR)范式下涌现出一批「Zero」类推理模型,摆脱了对人类显式推理示范的依赖,通过强化学习过程自我学习推理轨迹,显著减少了监督训练所需的人力成本。

什么开源算法自称为DeepSeek-R1(-Zero) 框架的第一个复现?

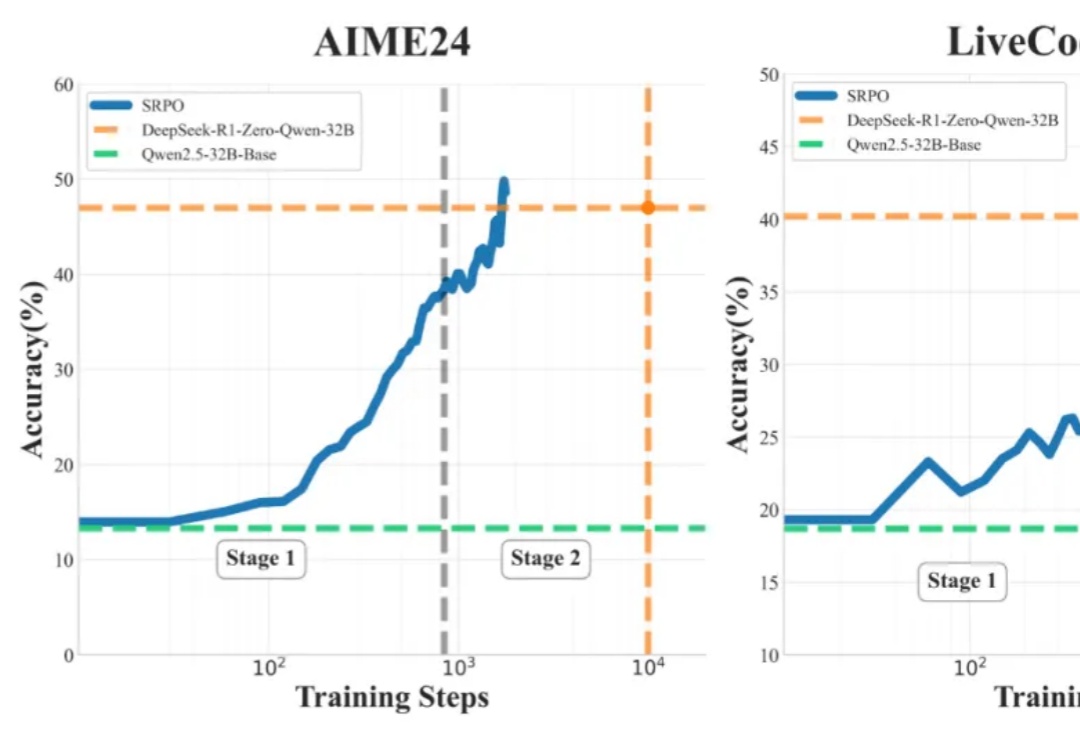

OpenAI 的 o1 系列和 DeepSeek-R1 的成功充分证明,大规模强化学习已成为一种极为有效的方法,能够激发大型语言模型(LLM) 的复杂推理行为并显著提升其能力。