7B扩散语言模型单样例1000+ tokens/s!上交大联合华为推出LoPA

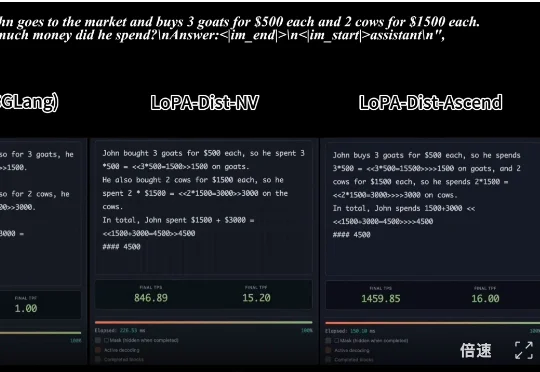

7B扩散语言模型单样例1000+ tokens/s!上交大联合华为推出LoPA,时长 00:20 视频 1:单样例推理速度对比:SGLang 部署的 Qwen3-8B (NVIDIA) vs. LoPA-Dist 部署 (NVIDIA & Ascend)(注:NVIDIA 平台

来自主题: AI技术研报

8372 点击 2026-01-01 10:09

,时长 00:20 视频 1:单样例推理速度对比:SGLang 部署的 Qwen3-8B (NVIDIA) vs. LoPA-Dist 部署 (NVIDIA & Ascend)(注:NVIDIA 平台

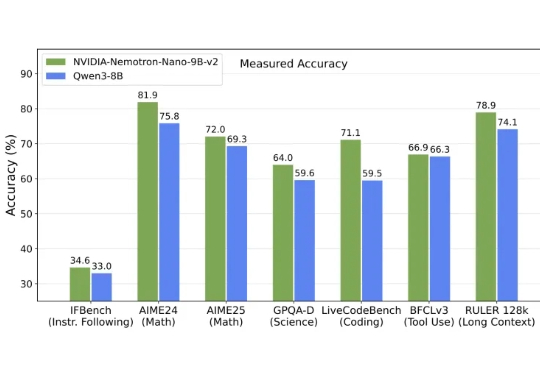

开源框架实现100%可复现的稳定RL训练!下图是基于Qwen3-8B进行的重复实验。两次运行,一条曲线,实现了结果的完美重合,为需要高精度复现的实验场景提供了可靠保障。这就是SGLang团队联合slime团队的最新开源成果。

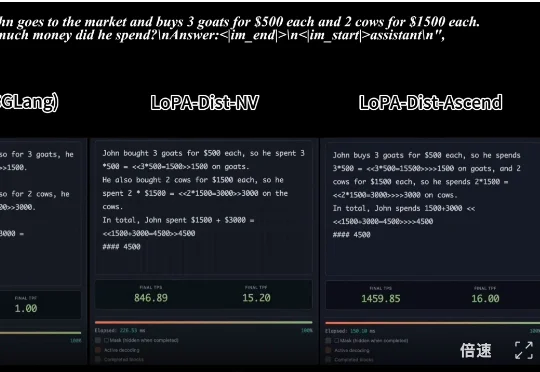

英伟达发布全新架构9B模型,以Mamba-Transformer混合架构实现推理吞吐量最高提升6倍,对标Qwen3-8B并在数学、代码、推理与长上下文任务中表现持平或更优。

translate.js(https://github.com/xnx3/translate)是面向开发者打造的一个简单而强大的前端国际化工具,专注于提供极简高效的多语言切换能力。项目完全开源并允许商业使用。