仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4o

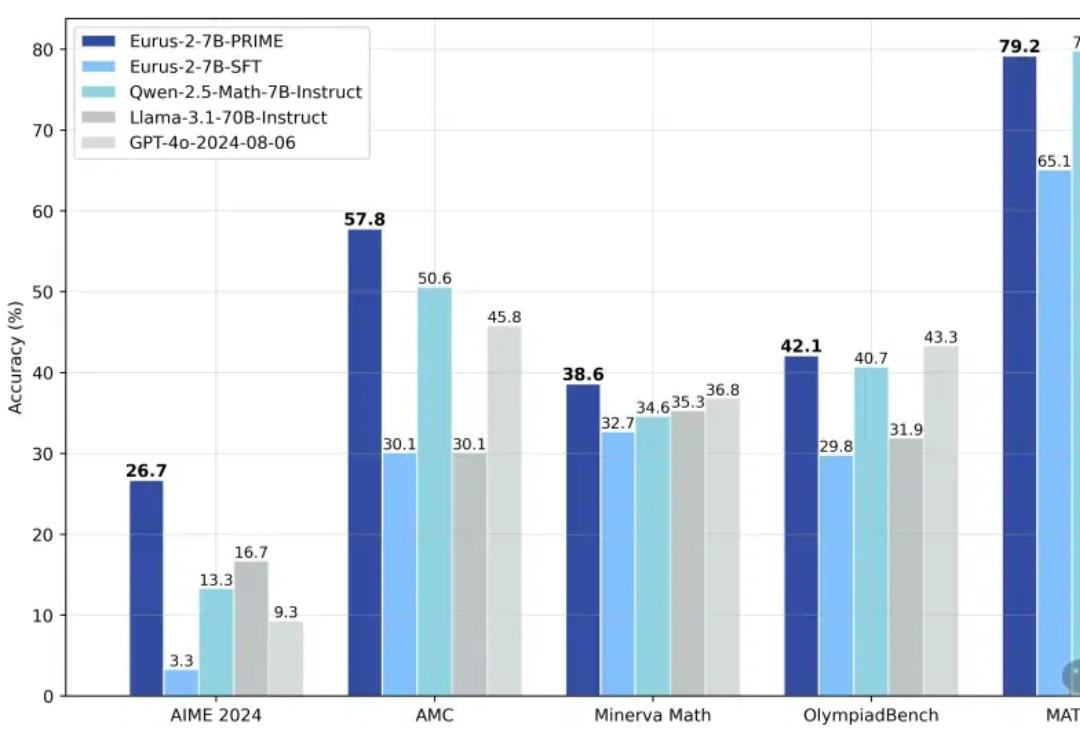

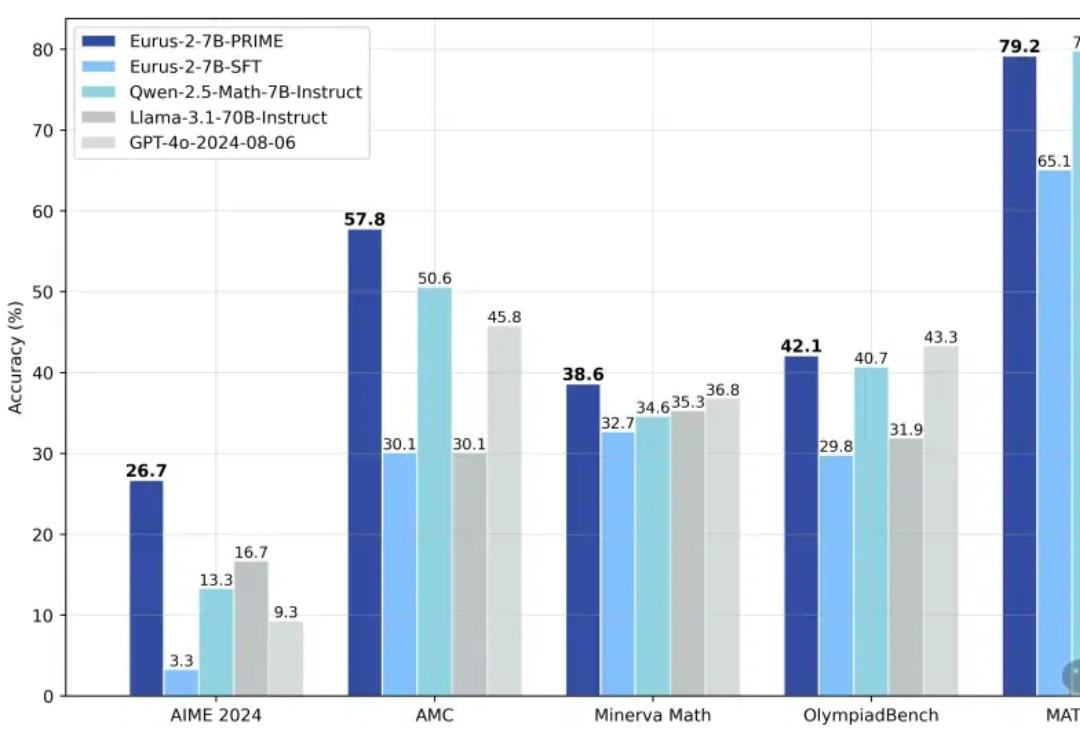

仅需一万块钱!清华团队靠强化学习让 7B模型数学打败GPT-4oOpenAI o1和o3模型的发布证明了强化学习能够让大模型拥有像人一样的快速迭代试错、深度思考的高阶推理能力,在基于模仿学习的Scaling Law逐渐受到质疑的今天,基于探索的强化学习有望带来新的Scaling Law。

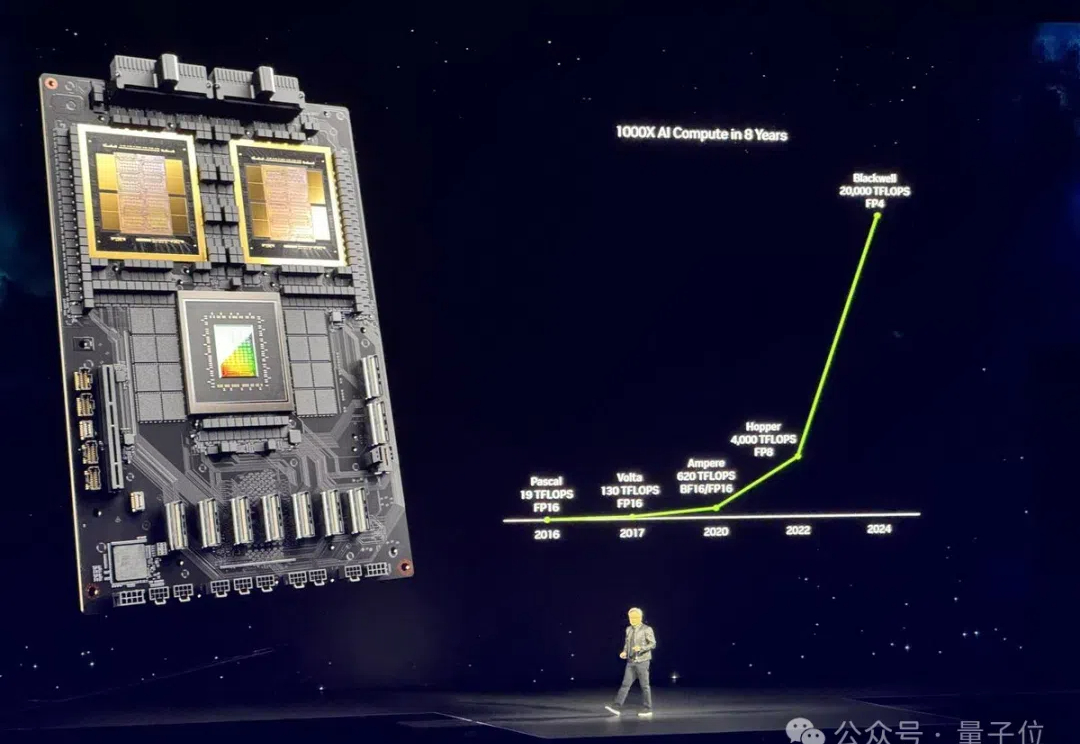

OpenAI o1和o3模型的发布证明了强化学习能够让大模型拥有像人一样的快速迭代试错、深度思考的高阶推理能力,在基于模仿学习的Scaling Law逐渐受到质疑的今天,基于探索的强化学习有望带来新的Scaling Law。

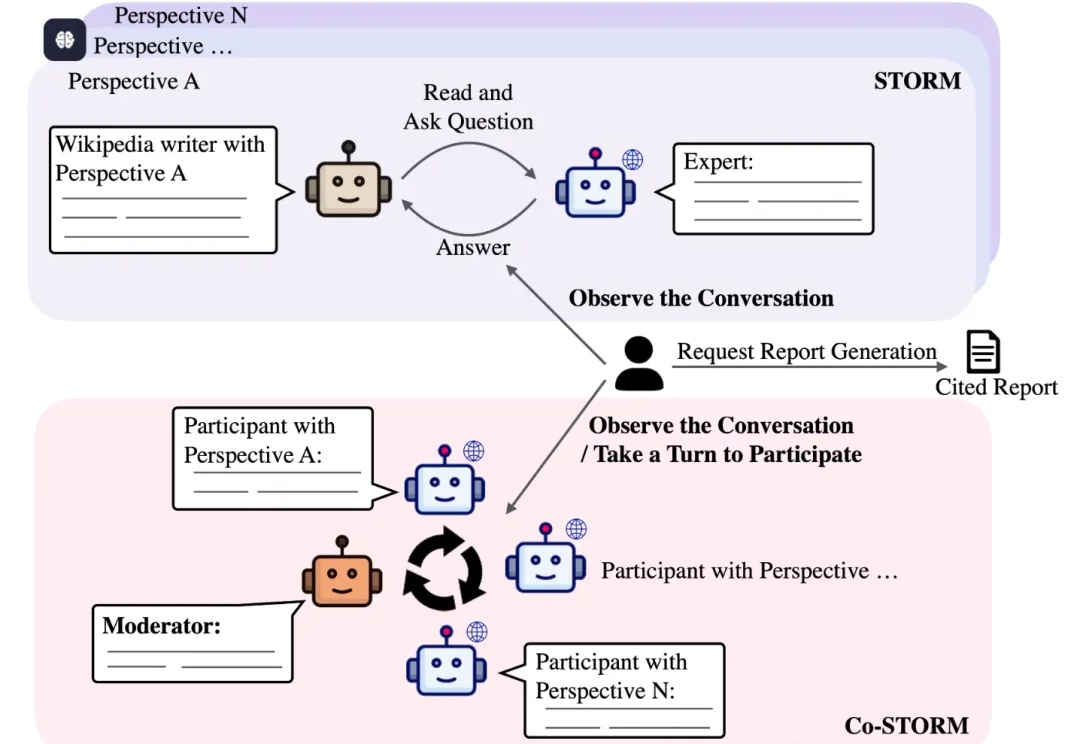

斯坦福大学最新AI进展!开源STORM&Co-STORM系统,只需填写主题,就可以全面整合资源,避开信息盲点生成高质量长文。

穿越重重迷雾,OpenAI模型参数终被揭开!一份来自微软华盛顿大学医疗论文,意外曝光了GPT-4、GPT-4o、o1系列模型参数。让所有人震惊不已的是,GPT-4o mini仅8B。

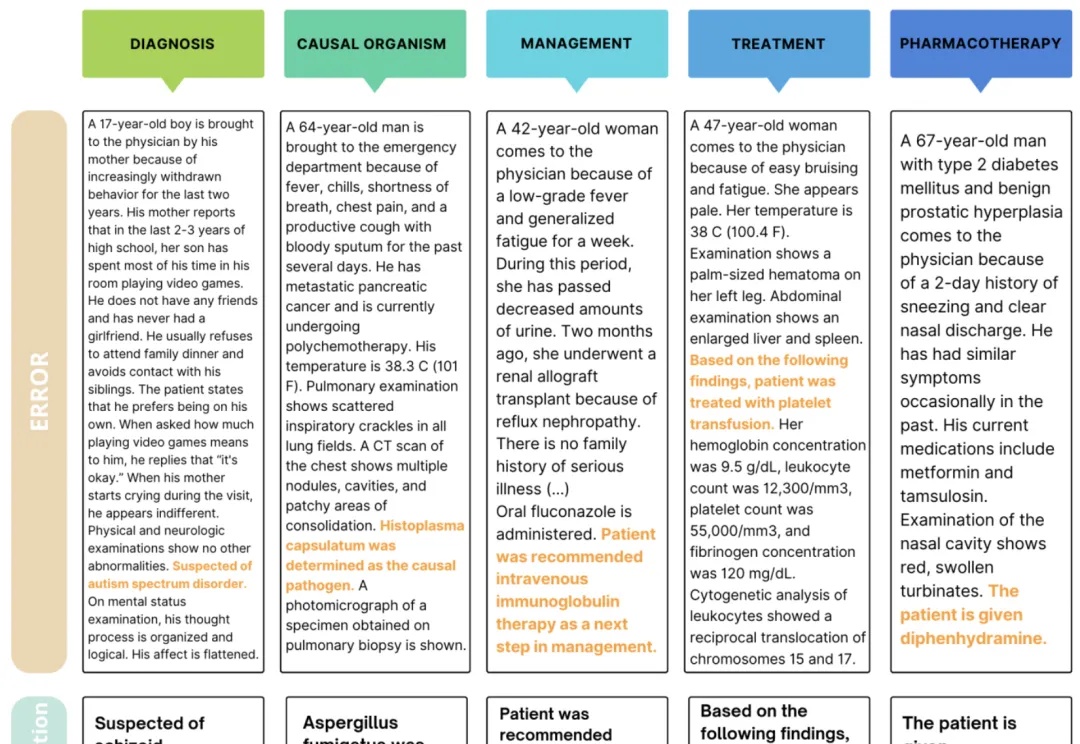

GPT-4o仅得分64.5,其余模型均未及格! 全面、细粒度评估模型多模态长文档理解能力的评测集来了~ 名为LongDocURL,集成了长文档理解、数值推理和跨元素定位三个主任务,并包含20个细分子任务。

微软又把OpenAI的机密泄露了??在论文中明晃晃写着: o1-preview约300B参数,GPT-4o约200B,GPT-4o-mini约8B……

过年关啦!阿里送上了今年最后一份礼物——

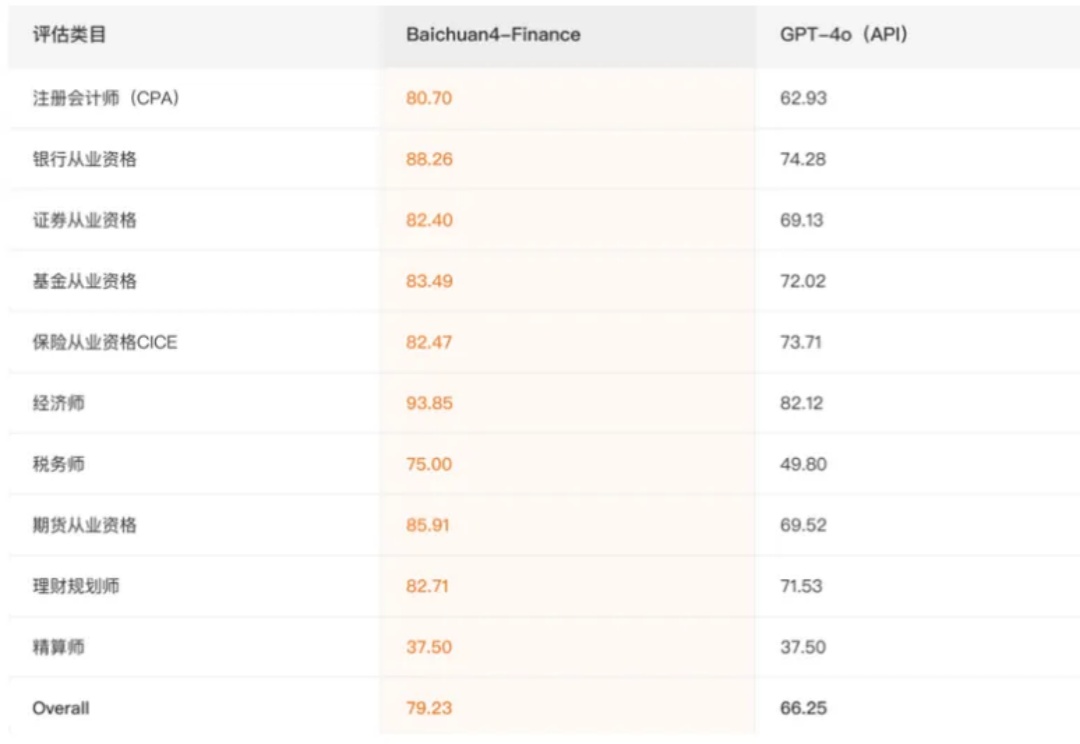

大模型的竞速赛,正站在通用底座的基础上,掀起“领域增强”风暴。

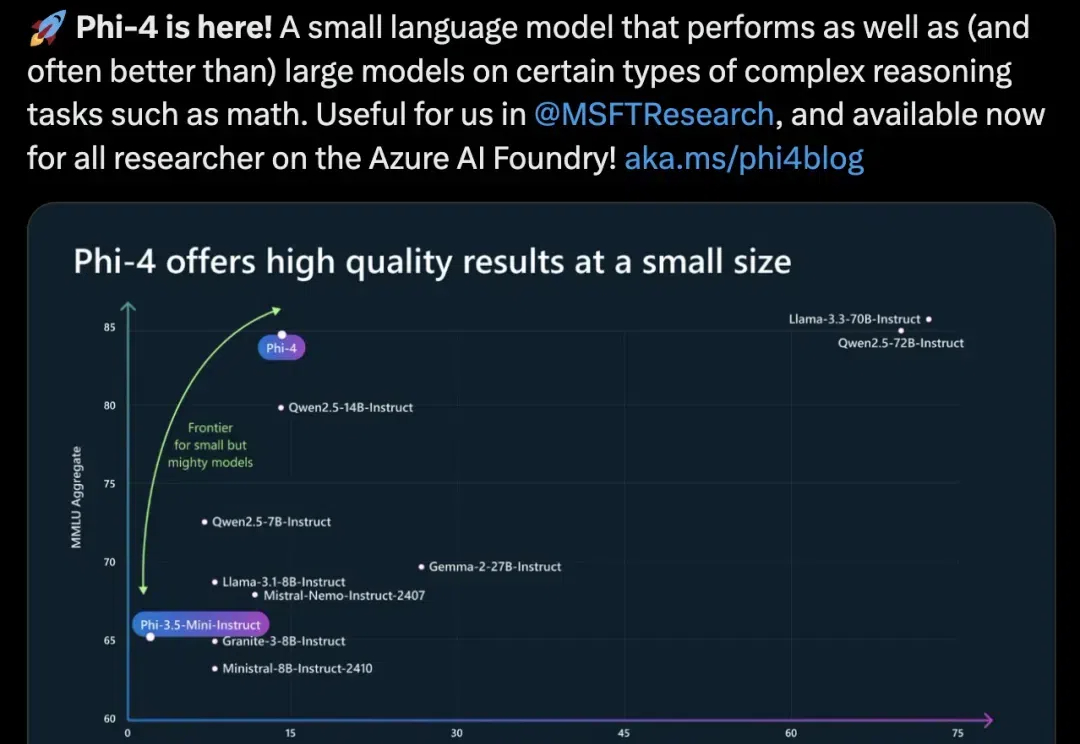

微软下一代14B小模型Phi-4出世了!仅用了40%合成数据,在数学性能上击败了GPT-4o,最新36页技术报告出炉。

The Information消息,初代GPT论文第一作者Alec Radford也要离开OpenAI,转向独立研究。据了解, Alec于2016年加入OpenAI,从初代GPT到GPT-4o的论文中全都有他的名字,其中前两代还是第一作者。

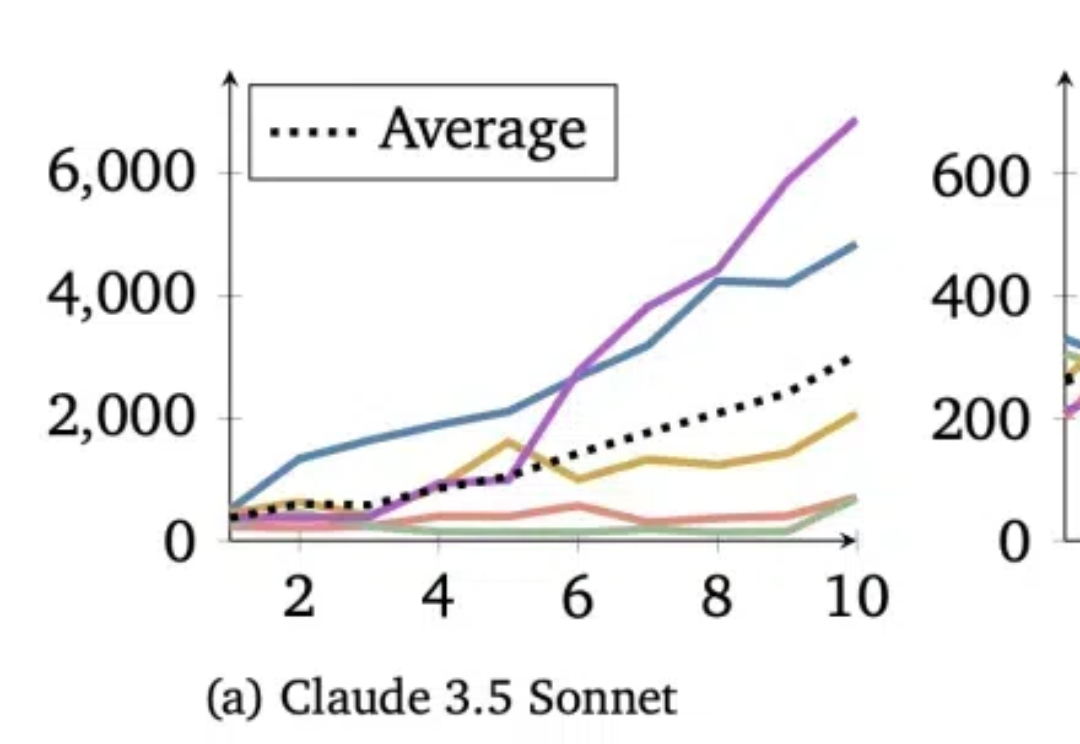

给大模型智能体组一桌“大富翁”,他们会选择合作还是相互拆台? 实验表明,不同的模型在这件事上喜好也不一样,比如基于Claude 3.5 Sonnet的智能体,就会表现出极强的合作意识。 而GPT-4o则是主打一个“自私”,只考虑自己的短期利益。