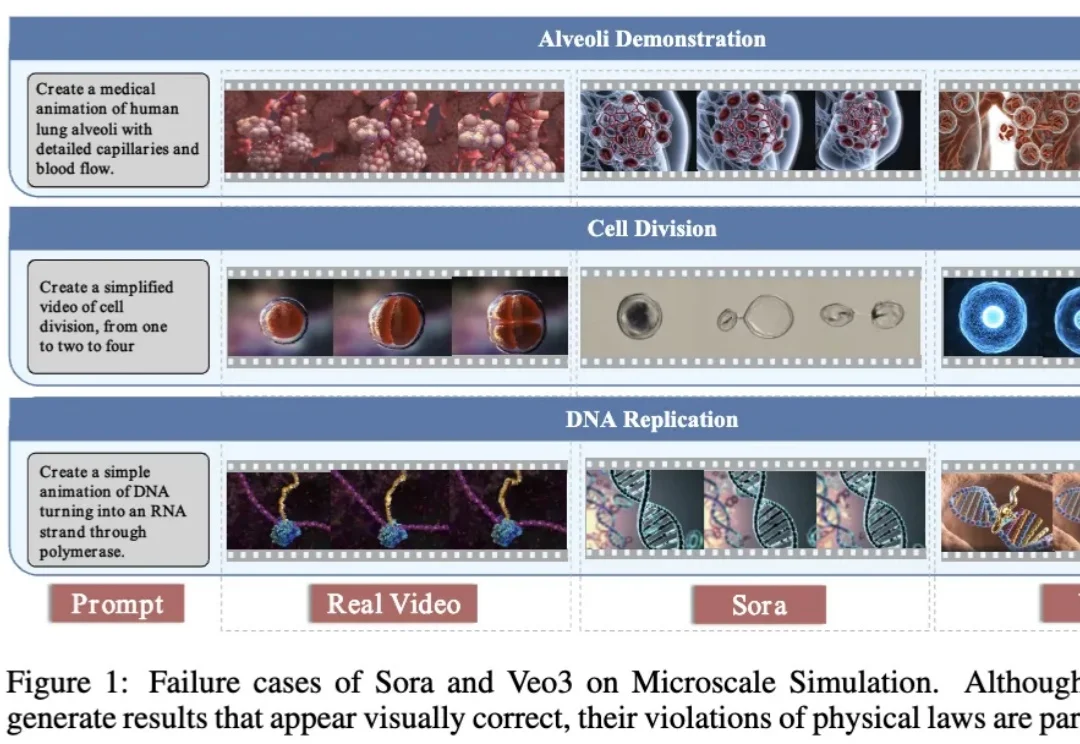

ICLR 2026|首个微观世界模型MicroVerse来了,AI开始模拟看不见的世界

ICLR 2026|首个微观世界模型MicroVerse来了,AI开始模拟看不见的世界过去两年,世界模型(World Model)正在成为大模型演进的重要方向。

过去两年,世界模型(World Model)正在成为大模型演进的重要方向。

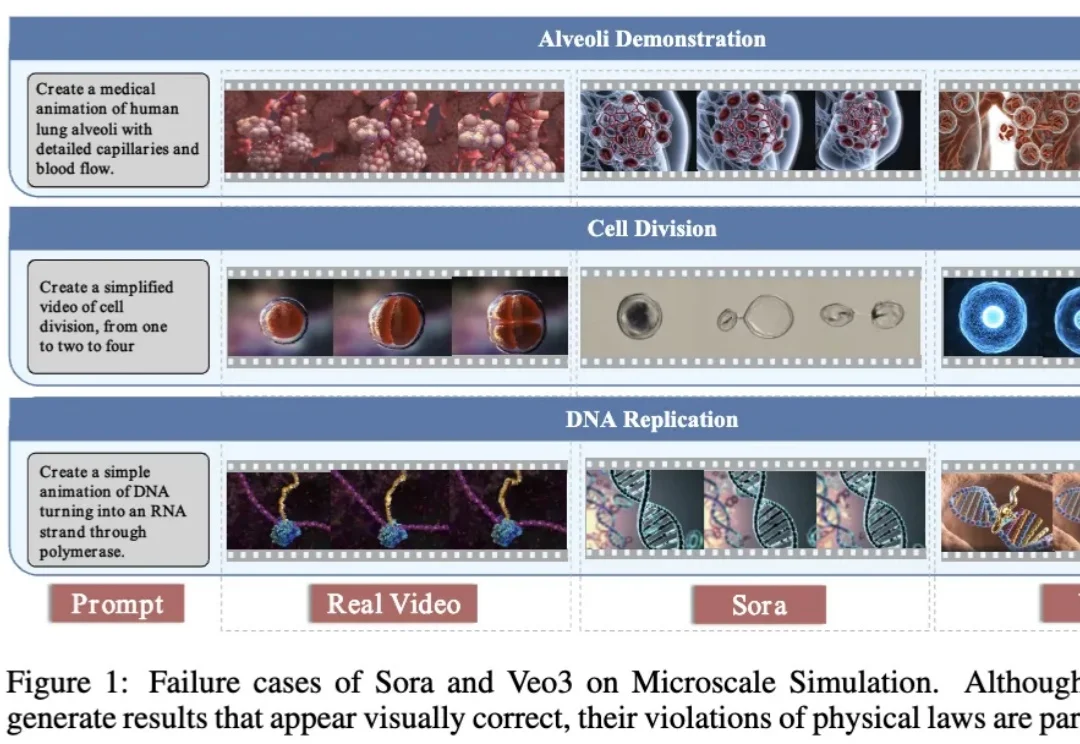

DeepRead让AI像人一样阅读文档:利用OCR识别章节结构,先精准定位相关段落,再完整读取上下文,避免碎片化检索。实验显示,其长文档问答准确率提升17%,能自动跳过冗余信息,精准提取财报、论文等复杂内容,无需额外知识图谱,轻量高效。

达人营销的新「解答」。 👦🏻 作者: 镜山 🥷 编辑: Koji 🧑🎨 排版: NCon 达人营销一直以来都不是一件「轻易完成」的事情,如果只是找几个博主,谈好价格,内容发出去,数据也还行。但一旦想

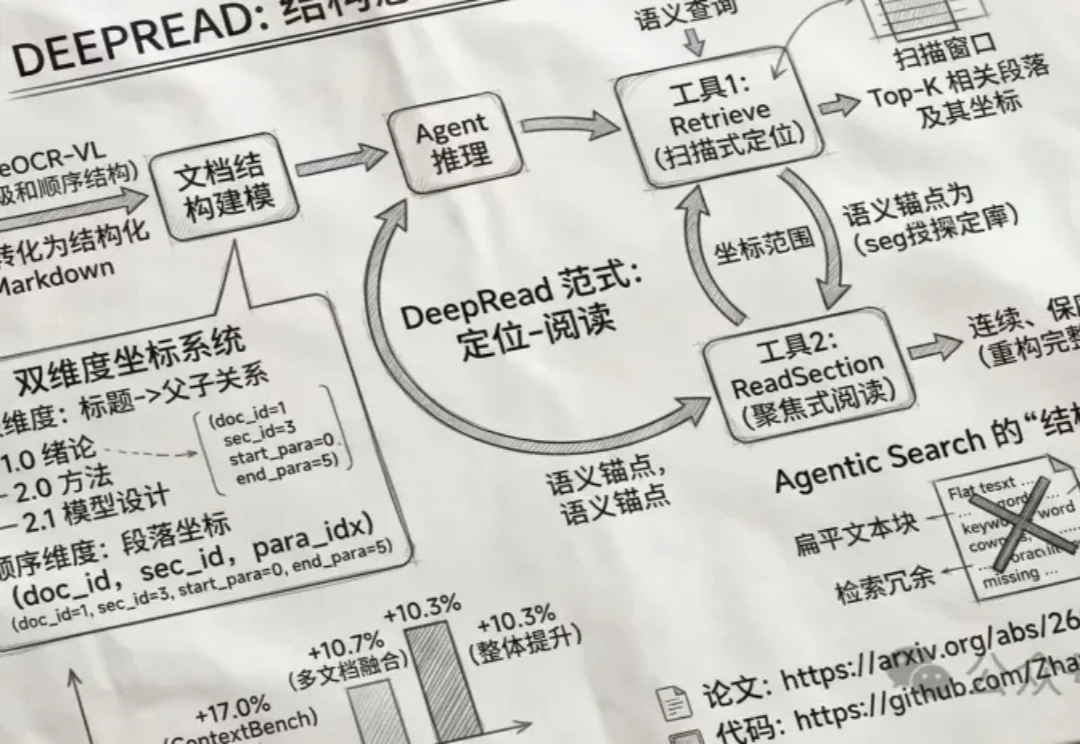

近期,复旦大学 NLP 实验室(FDU NLP)、北京大学知识计算实验室(KCL)联合美团 LongCat Team 提出了一种 Block Diffusion 推理模型 Test-Time Scaling 新框架 TDAR,通过引入 “粗思考,细求证” (Think Coarse Critic Fine, TCCF) 范式与有界自适应置信度解码

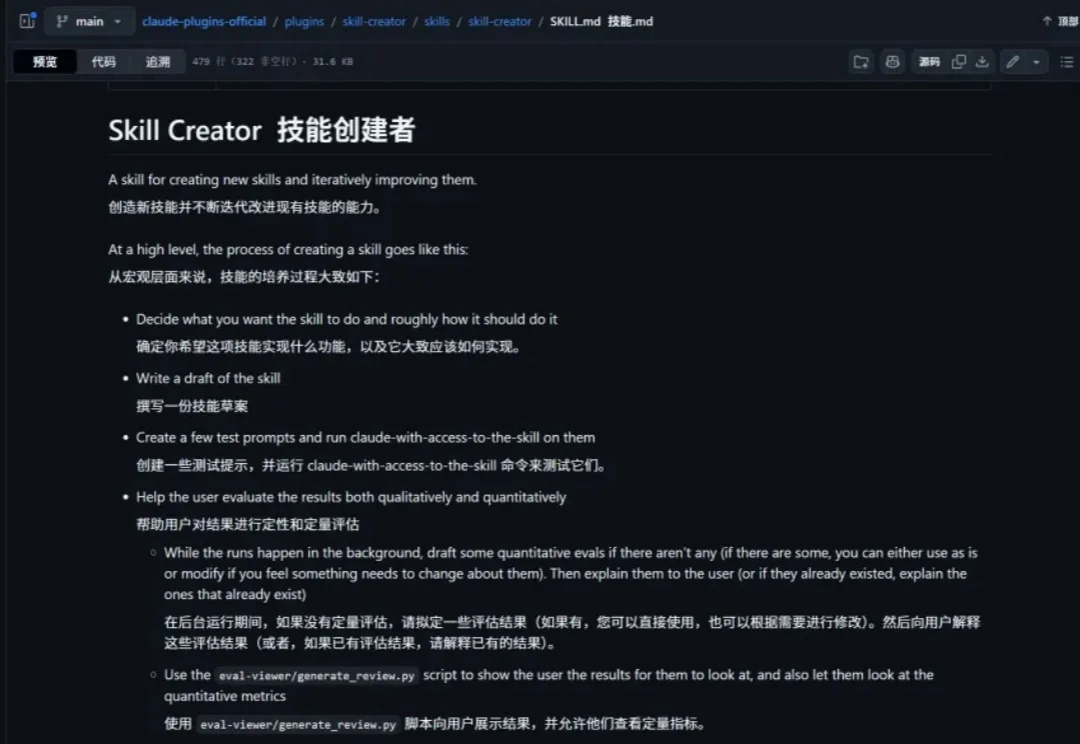

上周直播的时候,发现Anthropic的skills仓库居然有更新了。

巨硬,马斯克旗下一个连名字都在嘲讽微软的项目,如今已乱成一锅粥了。 事情要从去年 8 月说起。 彼时马斯克高调宣布了一个新项目 Macrohard(巨硬),从名字上不难看出,这个项目本身是对「Microsoft」的调侃式致敬,针对得也相当工整。

用OpenClaw挂机,抓取网页时频频翻车的烦人bug终于有解了。一个名为Scrapling的数据采集神器,几乎一夜之间就成了OpenClaw的“最强外挂”。这玩意儿不仅能穿透各种防爬虫的网页护盾,还能把网上杂乱的网页源码生扒下来,直接清洗成干净的结构化数据。

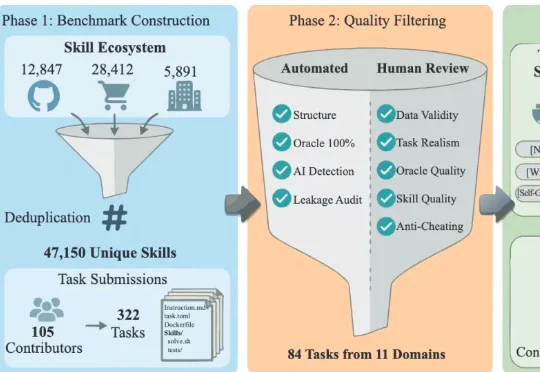

近日,一篇名为《SkillsBench: Benchmarking How Well Agent Skills Work Across Diverse Tasks》的论文预印本引爆了海外 AI 社区,YC 总裁 Garry Tan 亲自转发,登顶 Hacker News(363 票 / 163 评论),霸榜 AlphaXiv #1,

本篇文章被 ICRA 2026 接收并获得 IROS 2025 双料 Workshop 最佳论文,第一作者张子哲(site: zizhe.io)是宾夕法尼亚大学机器人学硕士生,同时在 GRASP 实验室担任科研助理,导师为 Nadia Figueroa 教授,研究兴趣涵盖机器学习,安全控制以及人机交互。

在最近一期 TechCrunch 的《Equity》播客节目中,负责谷歌云全球初创业务的副总裁 Darren Mowry 指出,以这些为卖点的初创公司,已经亮起了「引擎故障灯」。