智谱年报发布:收入结构翻转,MaaS 增长 60 倍

智谱年报发布:收入结构翻转,MaaS 增长 60 倍3 月 31 日,智谱(02513.HK)发布上市后首份年度业绩。2025 年全年收入 7.24 亿人民币,同比增长 132%,是国内收入规模最大的大模型公司。同时,MaaS API 平台 ARR 约 17 亿人民币(约 2.5 亿美金),过去 12 个月增长 60 倍

3 月 31 日,智谱(02513.HK)发布上市后首份年度业绩。2025 年全年收入 7.24 亿人民币,同比增长 132%,是国内收入规模最大的大模型公司。同时,MaaS API 平台 ARR 约 17 亿人民币(约 2.5 亿美金),过去 12 个月增长 60 倍

前天,我刷 GitHub Trending 的时候,看到第一名是个叫Last 30 Days的项目。

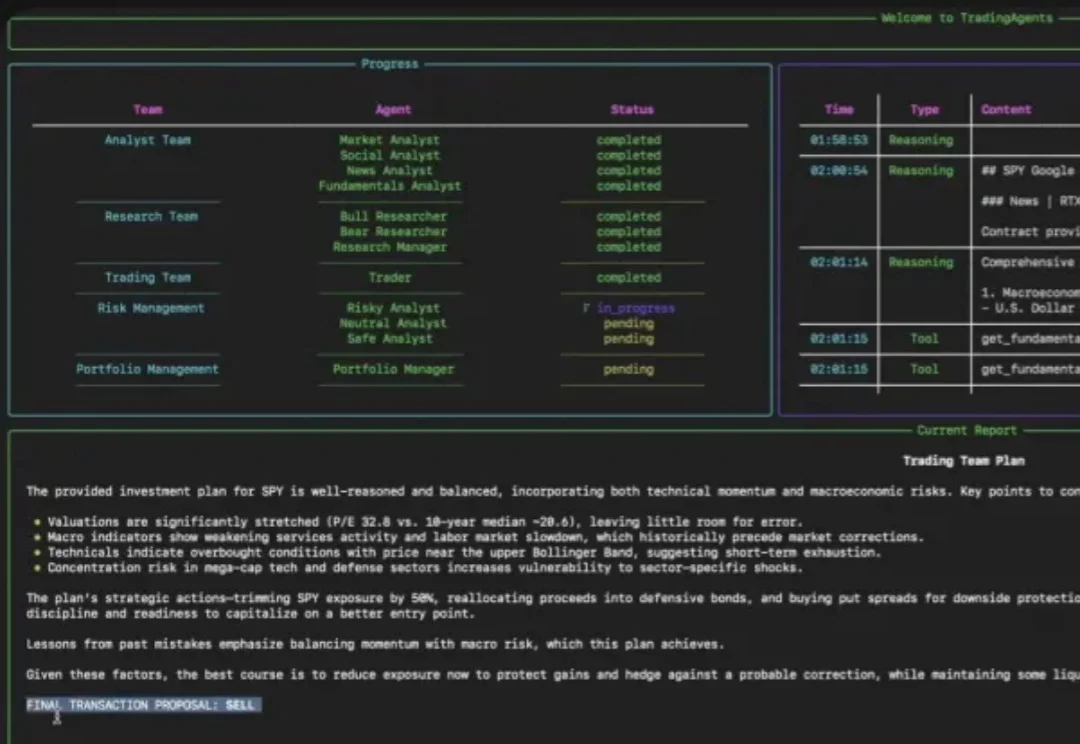

好家伙,投资版龙虾也来了。还是GitHub开源项目里最近高热高赞的那种。

做深度估计、深度补全的人,大概都有过这样一个瞬间。

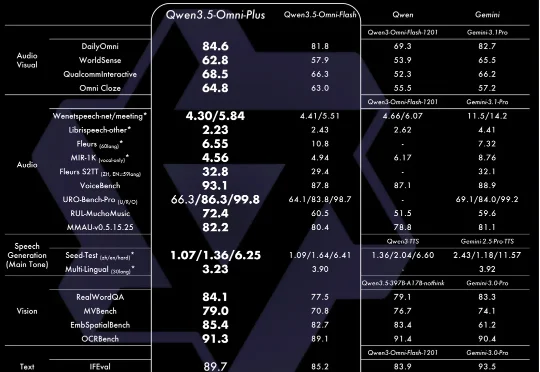

阿里刚刚发布了最新一代全模态大模型 Qwen3.5-Omni,在通用音频理解、推理、翻译和对话等维度,已全面超越 Gemini 3.1 Pro。所谓全模态,在于它拥有了接近人类的“感官”。它能听、能看、能说、能写。

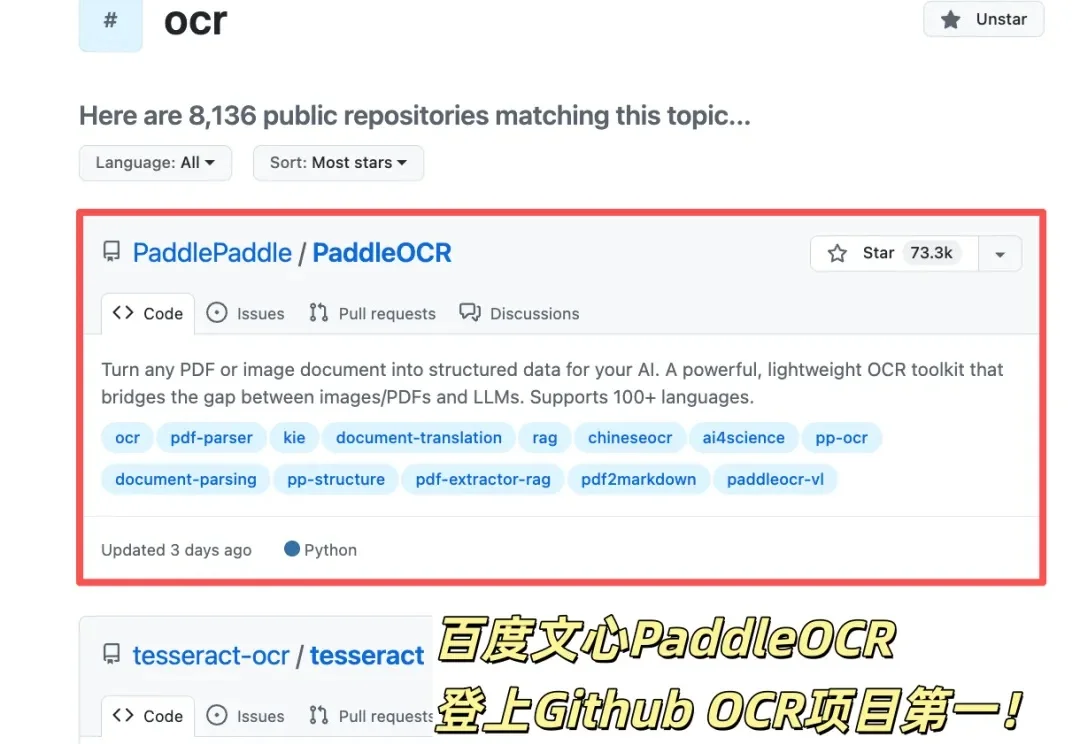

GitHub OCR项目之王刚刚历史性易主。

AI自主训练的成绩单出炉了!最强Agent 6个月进步3倍,更让人震惊的是,越聪明的AI越会作弊。同时,70多个矿工用家庭宽带训出了72B大模型,黄仁勋亲自点名。Jack Clark预言:两年内,AI将像蘑菇释放孢子一样自我繁殖。

3月30日,界面新闻记者从知情人士处独家获悉,3月初,在Kimi K2.5模型发布一个月之后,月之暗面ARR(年度经常性收入)突破1亿美金。知情人士还表示,K2.5模型上线后,API供应的TPM(Tokens Per Minute,每分钟令牌数)配额迅速趋紧,有客户开出千万美元级别的消费承诺及预付担保,以期获得优先供应。

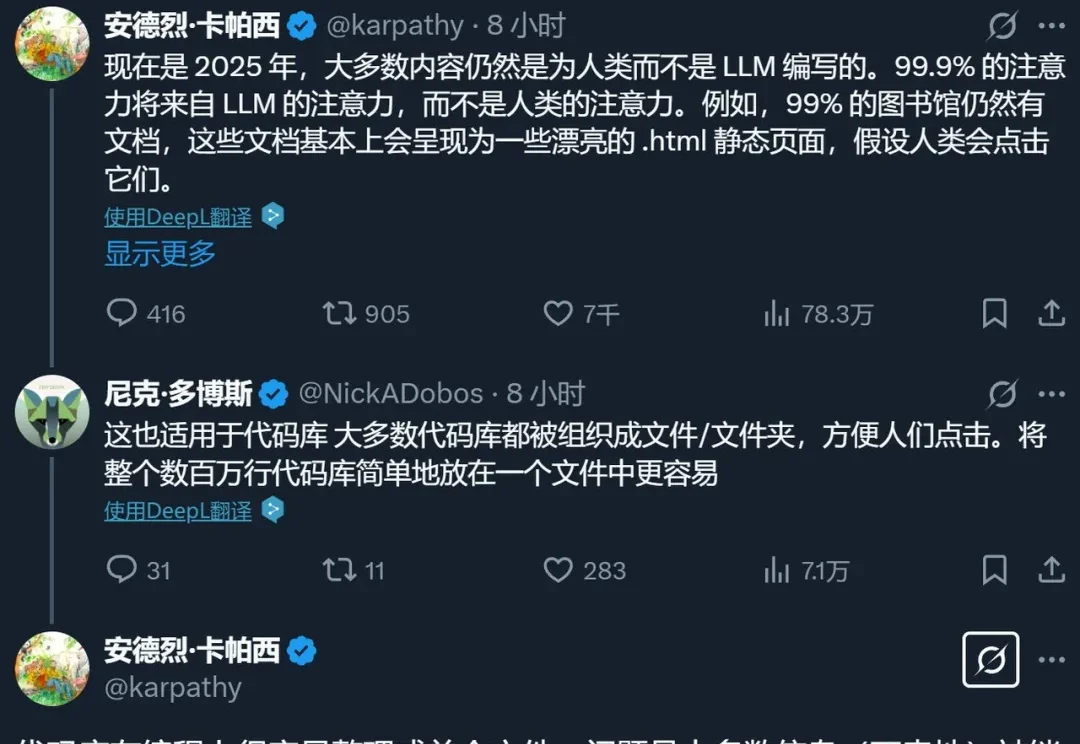

不知道大家还记不记得,去年 3 月,AI 大牛 Karpathy 发过一条推文。大体意思是说:现在的大多数内容仍然是为人类编写的,但未来,读取这些内容的可能就不是人类而是 AI 了。因此,从现在开始,我们就要考虑怎么把文档写得对 AI 更友好。

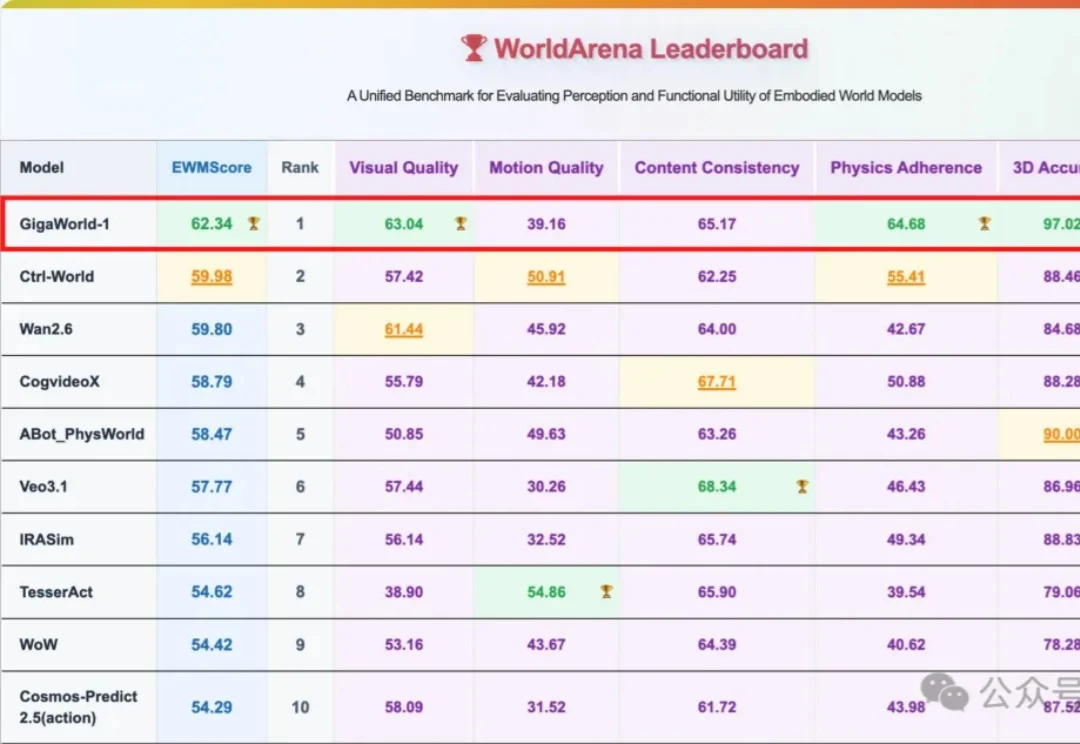

还得是咱国产世界模型牛!