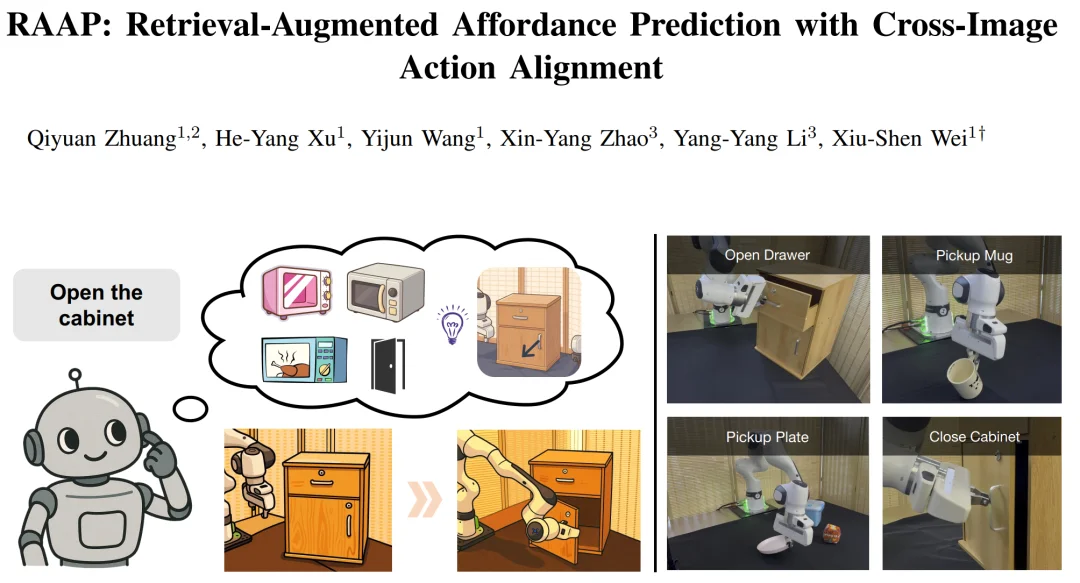

在具身智能领域,可供性(affordance)预测 —— 即让机器人从视觉观测中理解 "在哪里操作"(接触点)与 "如何操作"(动作方向)—— 是实现精细化机器人操作的基础之一。精细操作要求机器人不仅能定位到物体的可交互区域,更要掌握接触后的准确运动方向,例如判断抽屉把手的精确拉动方向完成开合。

当前主流方法主要分为两大范式:基于检索的方法无需大量机器人数据,却受限于单一匹配的脆弱性与未见类别的覆盖盲区;基于训练的大规模模型虽能学习可迁移视觉模式,却频繁出现接触点定位不准、动作方向预测错误的问题,难以支撑精细操作所需的空间精度。

为突破这一瓶颈,东南大学魏秀参团队提出了 RAAP(检索增强型可供性预测)。RAAP 将 affordance 分解为静态接触点与动态动作方向两个分量并针对二者设计互补推理机制:接触点通过与 Top-1 检索参考的稠密特征匹配可靠迁移;动作方向则由全新的检索增强对齐模型负责,通过聚合多个参考样本与双权重注意力机制为精细操作提供可靠运动指引。整个框架每任务仅需数十个训练样本,即可实现跨类别的零样本精细机器人操作。

目前,该论文已被机器人领域顶级会议 IEEE International Conference on Robotics & Automation (ICRA 2026) 接收。

RAAP 的核心设计思路是:静态接触点与动态动作方向虽同属 affordance,但在预测难度和所需信息上有本质区别,已有工作将二者作为可联合迁移的属性统一处理,往往顾此失彼。RAAP 明确将两者解耦,分别采用最适合各自特性的推理机制。

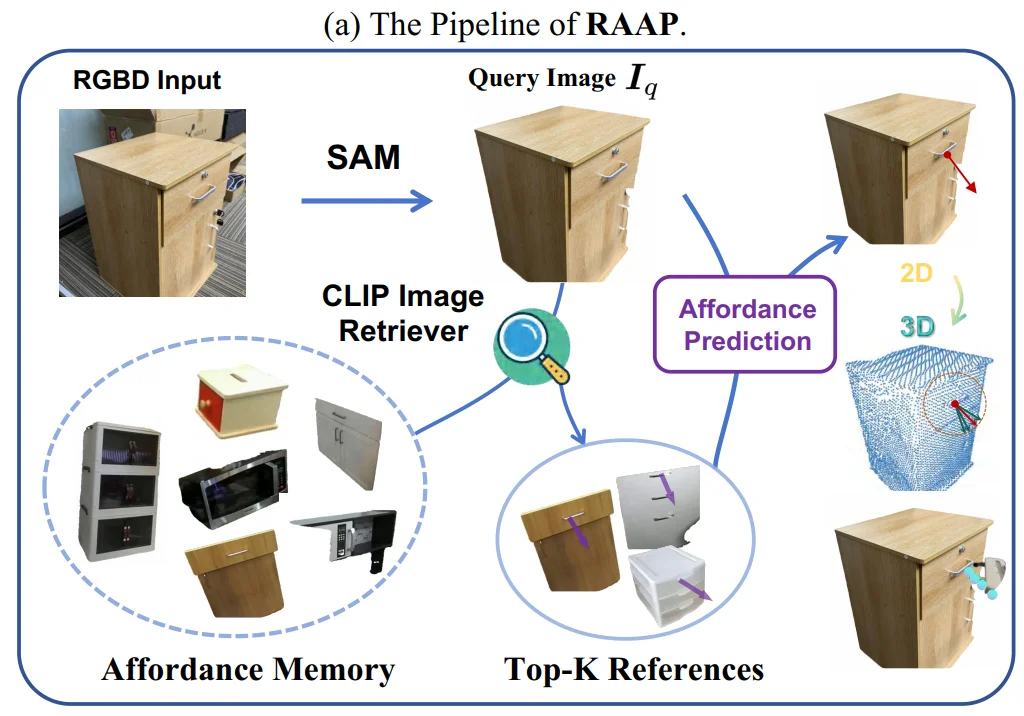

检索与静态 Affordance 迁移

RAAP 从 DROID 和 HOI4D 数据集构建视觉 affordance 记忆库,存储分割后的物体图像、CLIP 特征、任务标签以及标注的 2D 接触点与归一化动作方向向量,供推理时检索调用。给定查询场景,RAAP 首先通过 CLIP 文本与图像编码器从记忆库中检索 Top-K 个语义和视觉上最相关的参考样本。对于接触点定位,系统取 Top-1 参考,基于 Stable Diffusion 稠密特征进行像素级匹配,将参考接触点迁移至查询图像的对应位置。这一策略在前人工作中已得到充分验证。

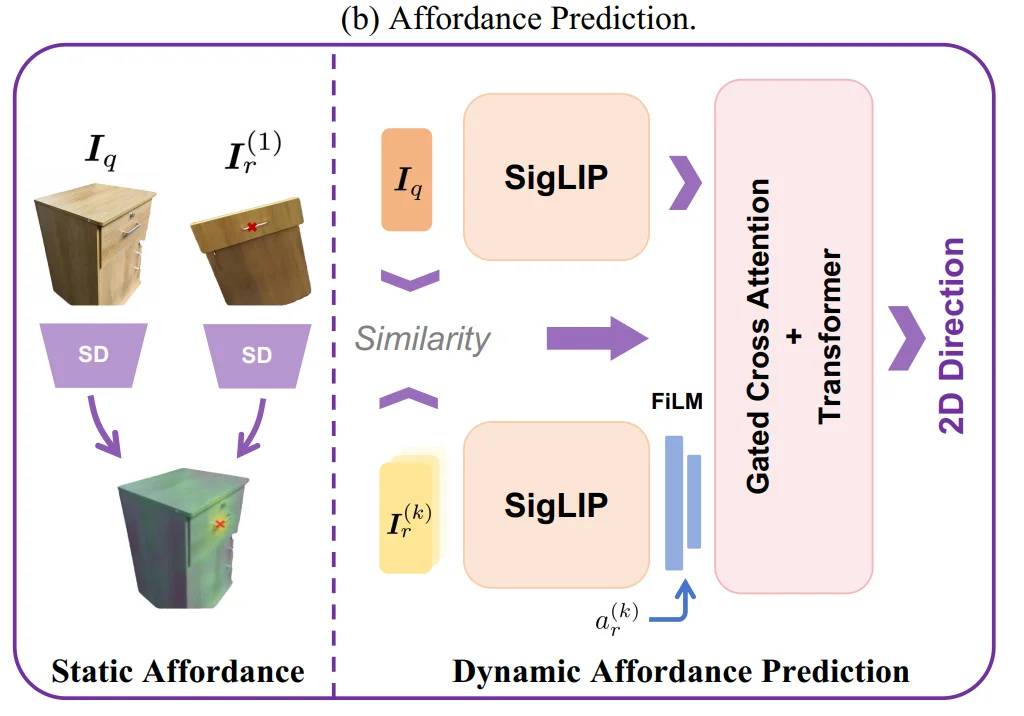

动态 Affordance 预测:检索增强跨图像动作对齐

动作方向的预测是 RAAP 的核心创新所在。不同于接触点的几何对应性,动作方向高度依赖任务语义与操作意图,单一检索样本极易因匹配偏差引发全局性方向错误。为此,RAAP 引入了一个检索增强的跨图像动作对齐模块,通过聚合 Top-K 个参考样本的方向先验来降低预测歧义。

具体而言,查询图像与各参考图像共享 SigLIP-2 骨干网络提取 patch 级特征。对于每个参考样本,其标注的动作向量经 FiLM 调制作用于视觉特征,使外观与操作意图联合编码;随后多个参考特征拼接为统一的 Key-Value 矩阵,以查询特征为 Query 经跨注意力机制融合多参考方向线索,再通过 Transformer 编码器回归出预测动作方向。

为应对检索样本质量参差不齐的问题,RAAP 进一步设计了双权重注意力机制:以检索阶段的 CLIP 余弦相似度作为外观先验权重,以轻量门控网络输出的语义相关性作为补充权重,二者归一化融合后对参考样本加权 —— 外观权重拉近视觉相似者,语义门控权重抑制语义错位的噪声参考,共同保障多参考聚合的质量。

2D 到 3D 的 Affordance 提升与执行

预测得到的 2D affordance 经由相机内参与深度点云提升至 3D 空间。抓取后,2D 动作方向结合局部表面法向变换为 3D 位移向量,真实环境中采用笛卡尔阻抗控制执行接触后动作,保证柔顺安全的交互,最终支撑从接触定位到运动执行的全流程精细操作。

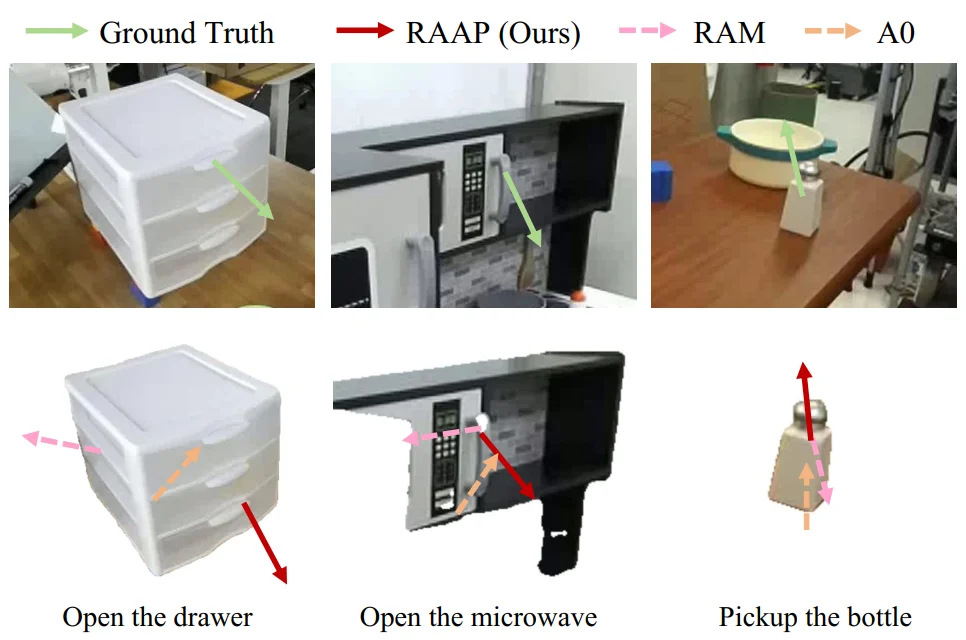

研究团队在 DROID 和 HOI4D 数据集以及真实 Franka 机械臂平台上进行了全面评估,与 RAM(单参考检索迁移框架)和 A0(大规模可供性预测模型)展开系统对比。

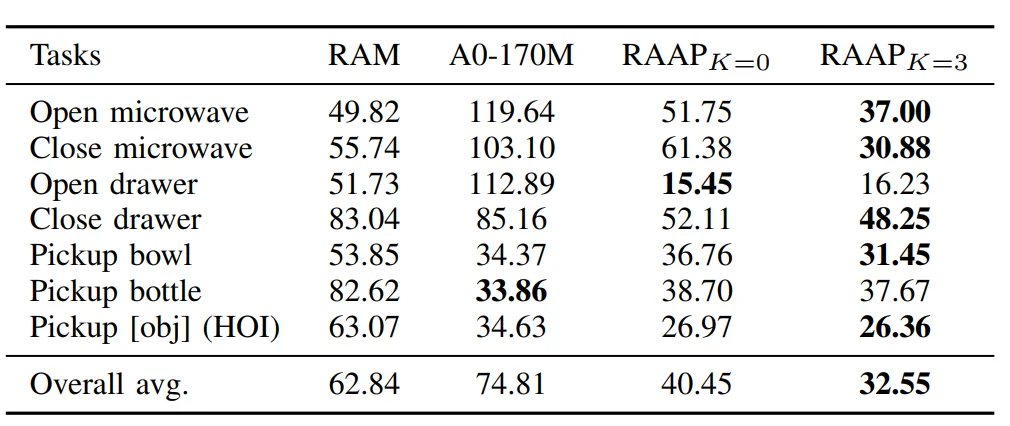

动态可供性预测

以均值角误差(MAE,越低越好)评估动作方向预测精度。RAAP(K=3)以 32.55° 的整体平均误差取得最优,相比其他方法降低超过 50%。优势在开 / 关类任务上尤为显著 ——RAM 的单样本迁移和 A0 在方向预测上均频繁出现全局性偏差,而 RAAP 通过多参考聚合有效消解了方向歧义。值得注意的是,DROID 子集平均每任务仅约 18 个训练样本,充分体现了 RAAP 在极低数据代价下的竞争力。

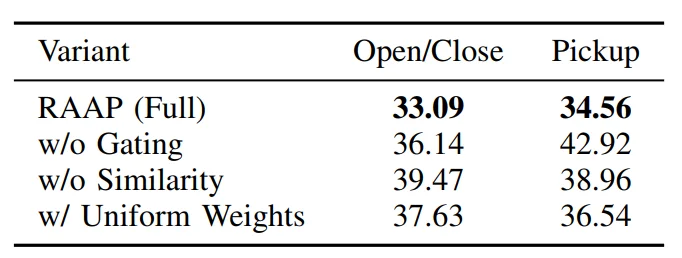

消融实验证实了双权重机制的必要性:去掉门控权重或相似度权重均导致明显性能下降,退化为均匀加权同样不及完整模型,说明两种权重信号功能互补、缺一不可。检索数量 K 的实验表明 K=3 为最优选择:过少时模型易受单次检索错误影响,过多时噪声参考开始拖累精度。

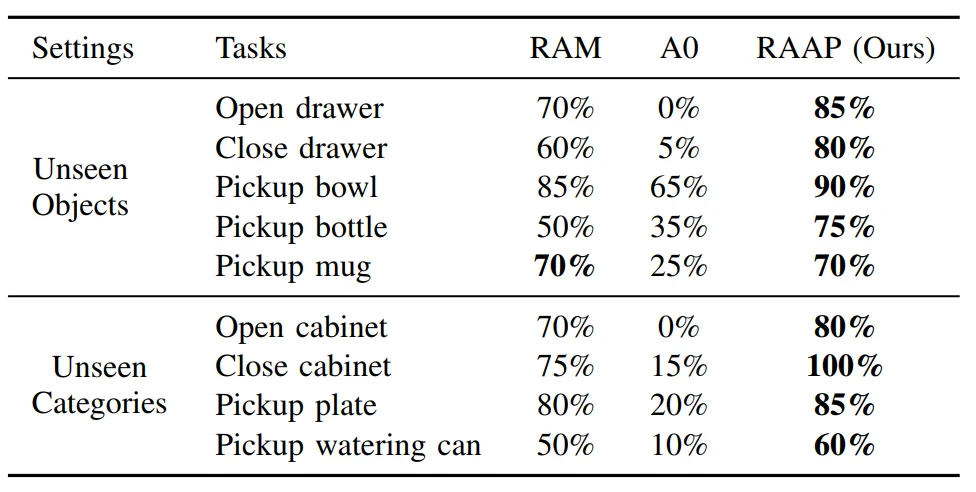

真实世界机械臂实验

研究团队在 Franka Research 3 机械臂上测试了未见物体泛化(任务相同,物体实例不同)与跨类别泛化(训练于开 / 关微波炉,测试于开 / 关柜子等新类别)两类场景,每任务随机位置下进行 20 次试验。所有模型仅在 DROID 和 HOI4D 子集上训练,不使用任何真实世界演示数据。

RAAP 在未见物体场景下于开 / 关抽屉任务上超过 RAM 达 15 至 25 个百分点,在所有拾取任务中同样取得最高成功率。跨类别场景中,RAAP 在关柜子任务上达到 100% 成功率,在其余任务上持续领先。

RAAP 为精细机器人操作中的可供性泛化提供了一种将检索与对齐学习统一的解耦框架。其核心贡献在于:

文章来自于"机器之心",作者 "庄启源"。

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI