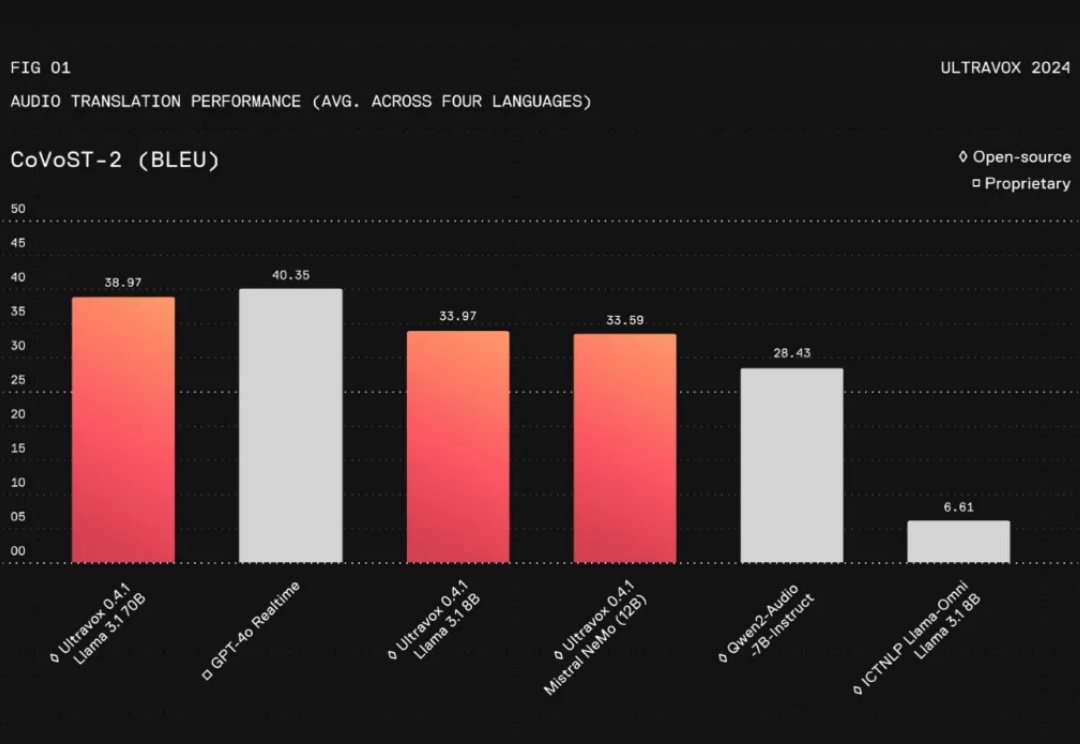

Fixie AI 推出 Ultravox v0.4.1:专门用于与 LLM 进行实时对话以及 GPT-4o 实时的替代方案

Fixie AI 推出 Ultravox v0.4.1:专门用于与 LLM 进行实时对话以及 GPT-4o 实时的替代方案在人工智能领域,与AI进行无缝的实时交互一直是开发者和研究者面临的一大挑战。特别是将文本、图片、音频等多模态信息整合成一个连贯的对话系统,更是难上加难。尽管像GPT-4这样的语言模型在对话流畅性和上下文理解上取得了长足进步,但在实际应用中,这些模型仍然存在不足之处: