虾马之后又火一个!OpenHuman用20分钟了解你的一切,存成卡帕西式知识库

虾马之后又火一个!OpenHuman用20分钟了解你的一切,存成卡帕西式知识库虾在前,马当道,居然还有新物种能在Agent赛道突出重围。OpenHuman连续霸榜GitHub Trending第一,狂揽9k+ Star,一天就涨千星。和虾马不一样,Human不用你花心思养,还能反过来主动了解你。

搜索

搜索

虾在前,马当道,居然还有新物种能在Agent赛道突出重围。OpenHuman连续霸榜GitHub Trending第一,狂揽9k+ Star,一天就涨千星。和虾马不一样,Human不用你花心思养,还能反过来主动了解你。

最近很多朋友问我用什么笔记软件。我说 Obsidian。其中一个主要原因是:大家使用 Obsidian 的时间点是在「AI 时代」之前,而现在,Claude Code 时代下的 Obsidian 已经完全完全成了「最强笔记软件」。

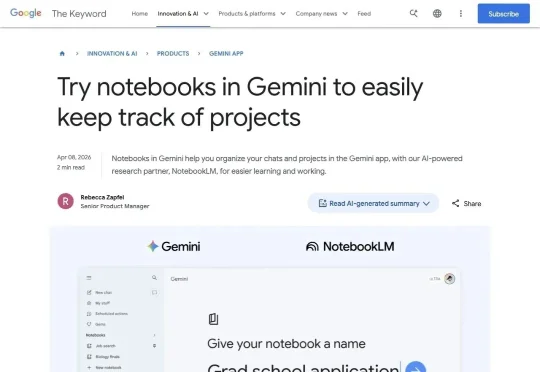

Google放出重磅整合:Gemini正式上线「Notebooks」功能,与NotebookLM实现知识库双向同步——你在任意一端添加的资料,另一端自动出现。The Verge直言这是在硬刚ChatGPT Projects。Gemini团队成员Logan Kilpatrick发推官宣,4.4万人围观,近900人点赞。AI助手的「第二大脑」时代,来了。

AI圈的节奏已经快到让人产生幻觉了。

Karpathy 表示,大多数人使用 LLM 处理文档的方式,基本都类似于 RAG:你上传一组文件,模型在查询时检索相关片段,然后生成答案。这种方式是有效的,但问题在于每一次提问,模型都在从零重新发现知识。没有积累。

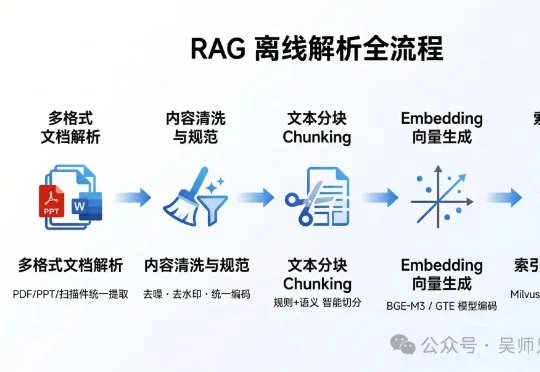

大家好,我是吴师兄。 之前有个学员面阿里的 NLP 岗,简历上写着"搭建了基于 RAG 的企业知识问答系统"。面试官翻着简历问: "你们知识库有多少文档?什么格式?" 他说:"大概 5000 份,PD

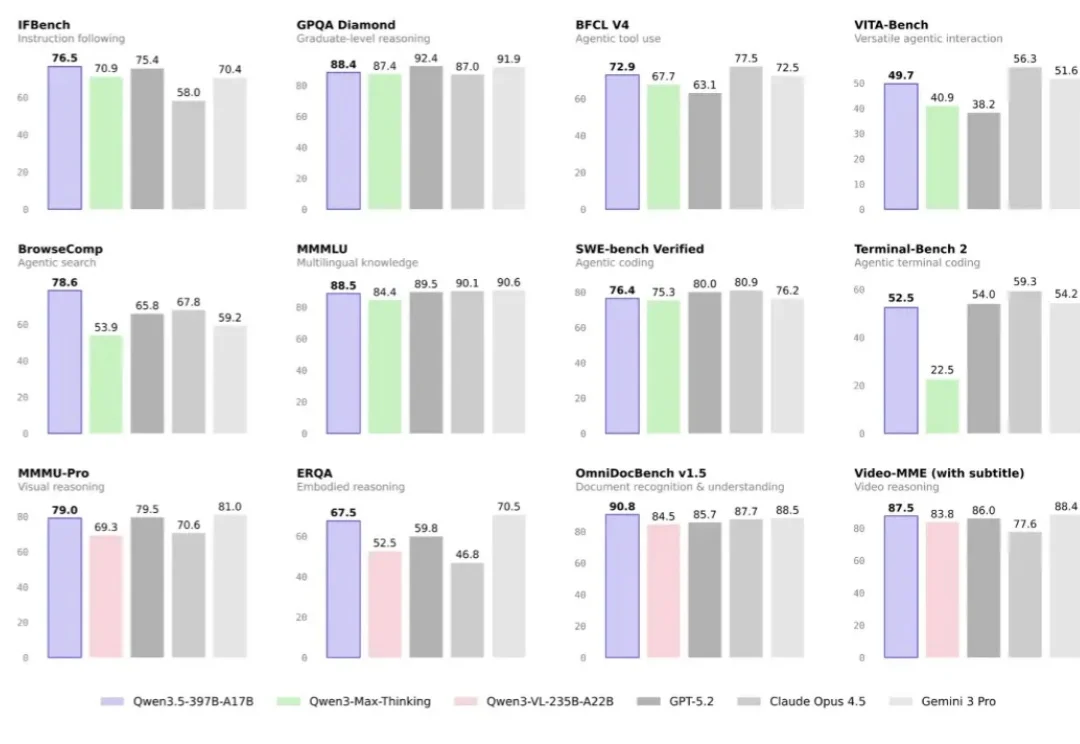

最近关于Qwen3.5还有其幕后团队,市场上的讨论沸沸扬扬,但今天我们不聊八卦,主要讲讲干货。

春节假期还没到,DeepSeek 就先把礼物拆了一半。

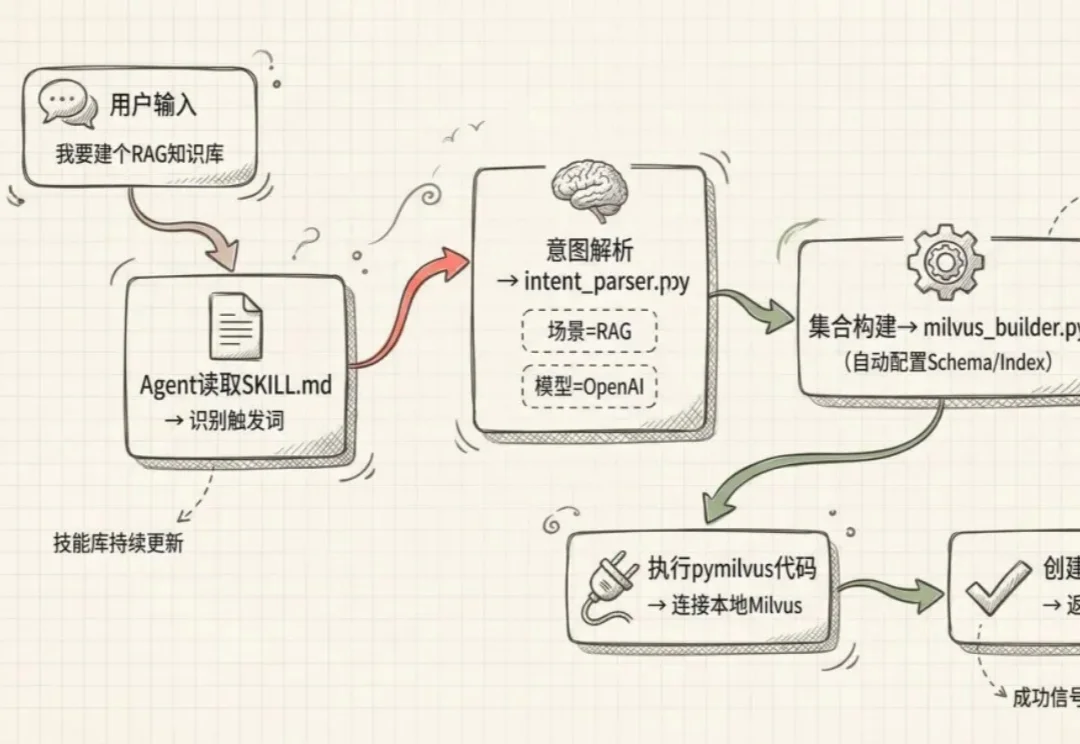

语析Yuxi-Know 是基于大模型RAG知识库与知识图谱技术构建的智能问答平台,支持多种知识库文件格式,如PDF、TXT、MD、Docx,支持将文件内容转换为向量存储,便于快速检索。

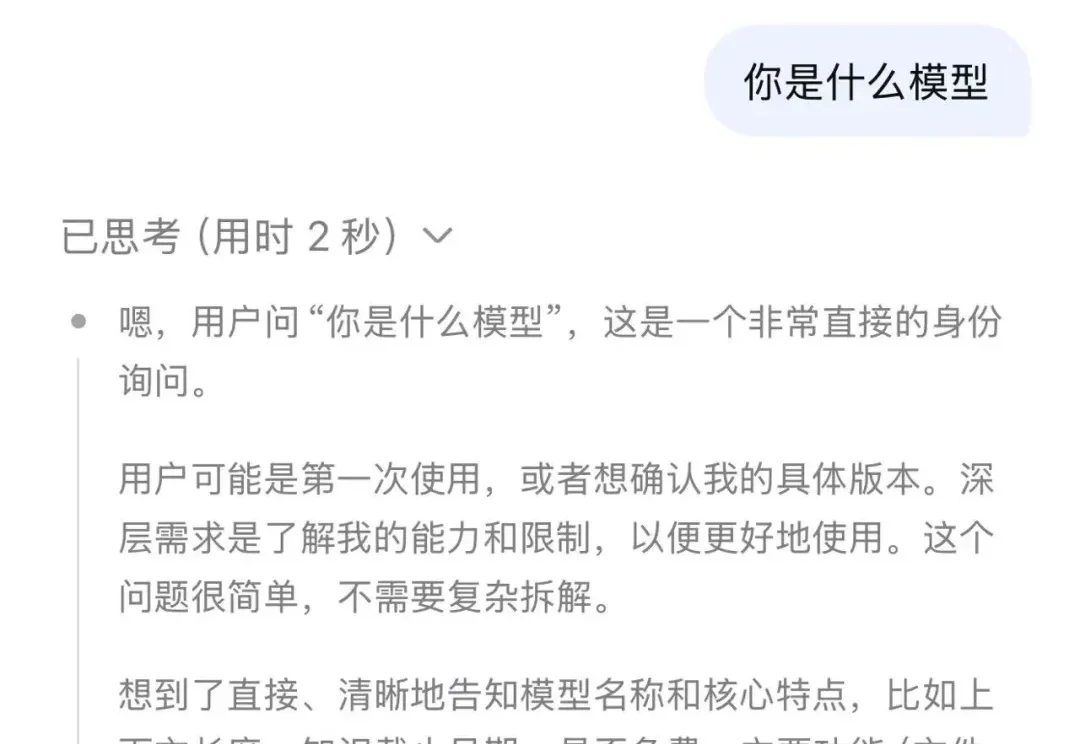

Agent很好,但要做好工具调用能才能跑得通。