赌自己会失业!田渊栋八人天团狂揽44亿元,杀入「递归进化」赛道

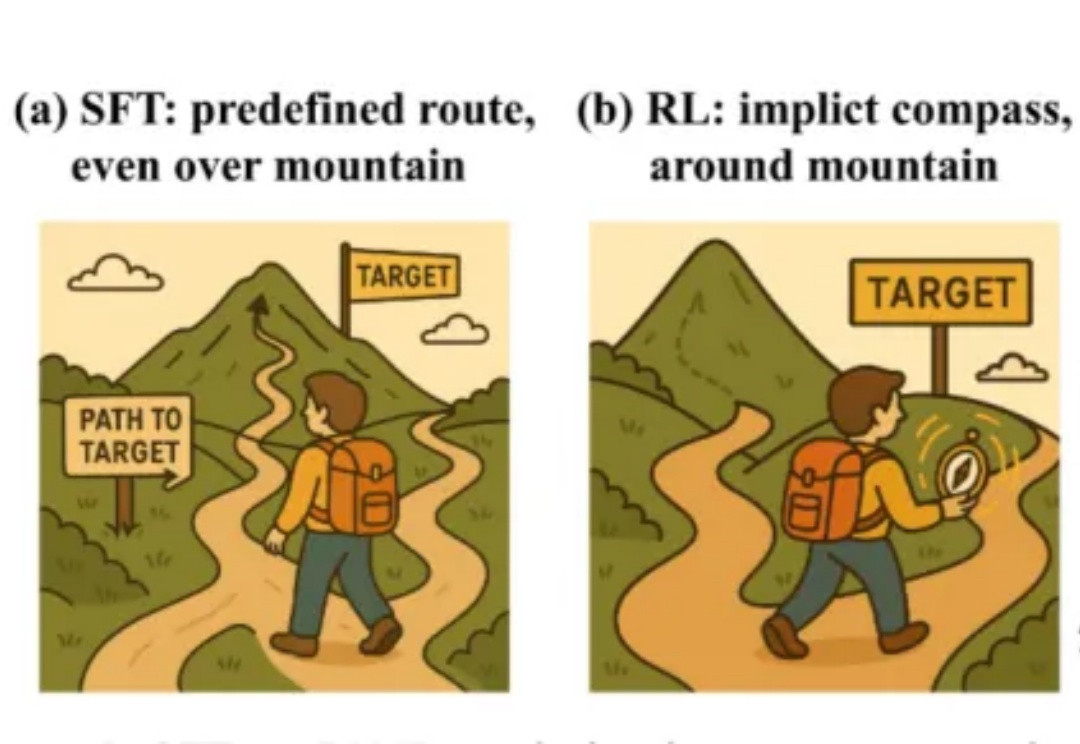

赌自己会失业!田渊栋八人天团狂揽44亿元,杀入「递归进化」赛道8个缔造AI辉煌的超级大脑,带着谷歌英伟达巨资狂暴入场。他们要让AI自己训练自己,然后把AI研究员这个职业彻底干掉。

搜索

搜索

8个缔造AI辉煌的超级大脑,带着谷歌英伟达巨资狂暴入场。他们要让AI自己训练自己,然后把AI研究员这个职业彻底干掉。

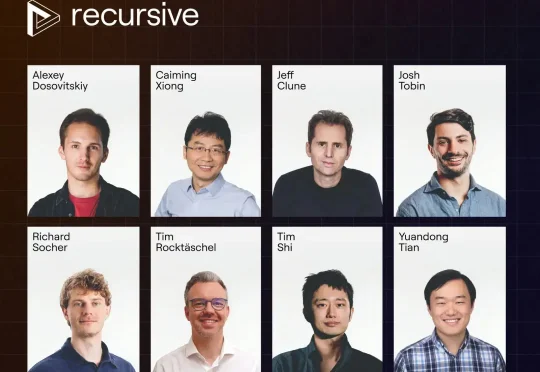

离职Meta后的田渊栋,现身独角兽联创名单,成了AI创业合伙人。Recursive Superintelligence(RSI),不到30人,刚从隐身状态走出来,就拿到6.5亿美元融资(约44亿元人民币),估值46.5亿美元(约316亿元人民币)。

作为Meta FAIR曾经的资深首席研究员,LLaMA和OpenGo背后的关键推手, 他的研究从破解围棋的机制到优化大模型的肌理, 做的事情从来只有一件:打开黑箱,找到底层逻辑。

从救火Llama 4反被裁,再到如今下场自创业,AI大佬田渊栋回顾了2025年一些重要时刻。

Nano Banana Pro又被开发出了新玩法。

离开Meta的大佬们,留下作品还在陆续发表,今天轮到田渊栋。

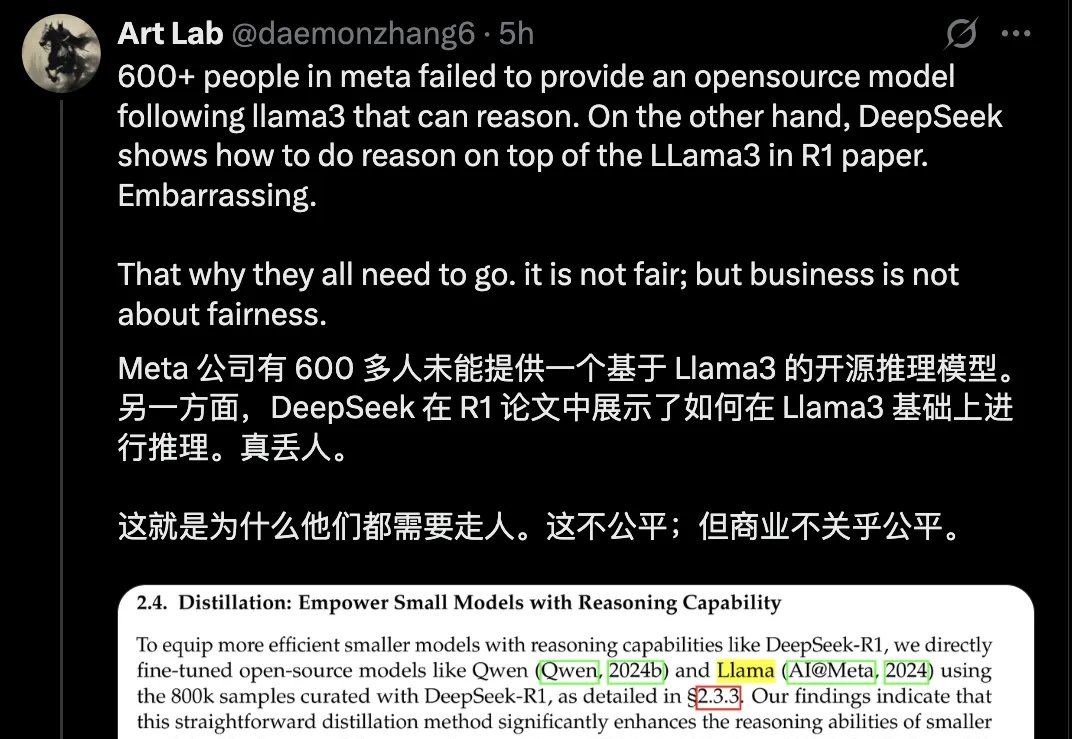

Meta首席执行官马克·扎克伯格近日批准了一项涉及约600名员工的AI部门裁员计划,这是Meta今年在人工智能领域规模最大的一次调整,主要波及公司核心研发机构。在此消息公布后,田渊栋首次公开露面,接受了腾讯科技特约作者「课代表立正」的独家深度访谈。

科技行业全球10万大裁员,连10年老将田渊栋都被Meta裁掉了!昨天,南洋理工大学的副教授Boyang Li吊足了大家的胃口:Meta FAIR最近的事件很抓马,但工业研究为什么这么难?我想知道大家愿不愿意听一下我的观点。

刚刚从Meta一线获悉,田渊栋前脚刚发了推文说自己被裁,后脚就被解除了公司内部各种权限——嘿,亚历山大王的刀,就是这么快。这也是这次裁员中最具争议的地方,“在Meta工作已超过十年的田渊栋和他的组员,整组被一锅端了”,这是为什么?

很疯狂,Meta AI裁员能裁到田渊栋头上,而且是整组整组的裁。田渊栋在Meta工作已超过十年,现任FAIR研究科学家总监(Research Scientist Director),他领导开发了早于AlphaGo的围棋AI“Dark Forest”