用完Claude 3.7,我感觉程序员在加速贬值

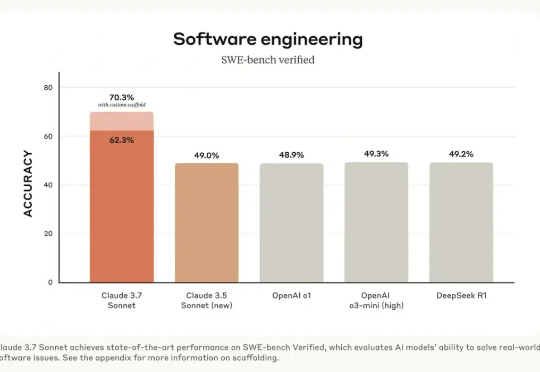

用完Claude 3.7,我感觉程序员在加速贬值昨天,Claude 3.7 Sonnet 正式发布。根据目前的各项测评,这个模型可以说是全宇宙最好的代码生成模型,超越了 DeepSeek R1 和 OpenAI 的 o3 等模型。如果你是程序员,一定要第一时间切换过去,用下这款模型。

昨天,Claude 3.7 Sonnet 正式发布。根据目前的各项测评,这个模型可以说是全宇宙最好的代码生成模型,超越了 DeepSeek R1 和 OpenAI 的 o3 等模型。如果你是程序员,一定要第一时间切换过去,用下这款模型。

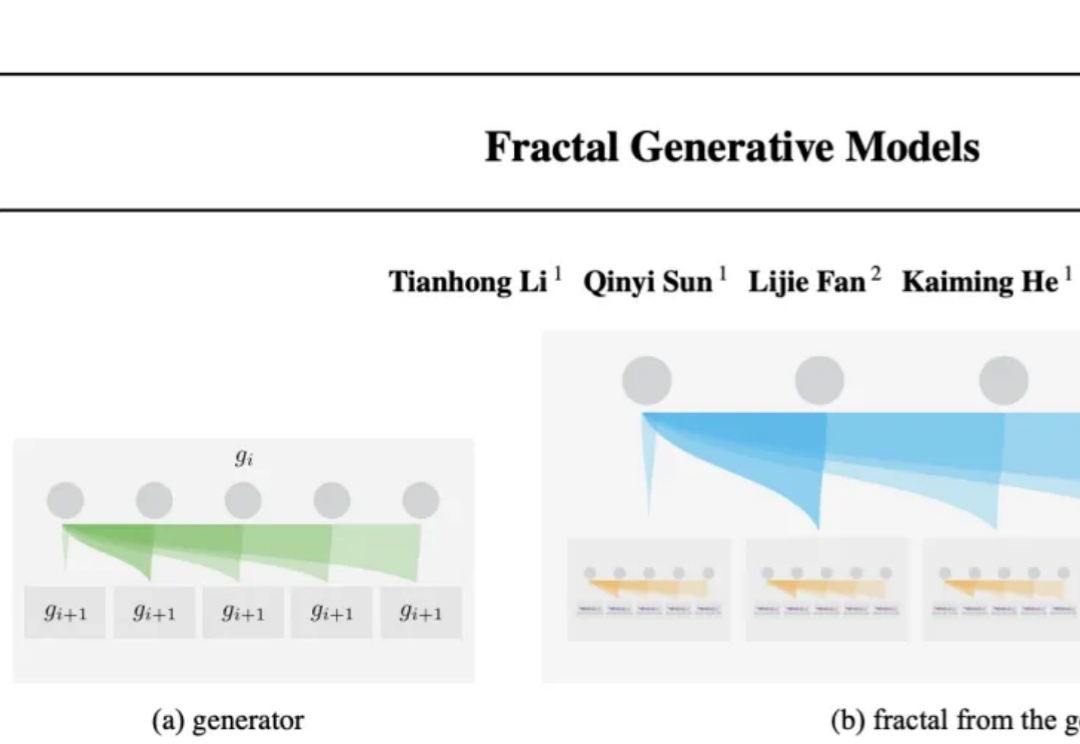

大自然的分形之美,蕴藏着宇宙的设计规则。刚刚,何恺明团队祭出「分形生成模型」,首次实现高分辨率逐像素建模,让计算效率飙升4000倍,开辟AI图像生成新范式。

何恺明再次开宗立派!开辟了生成模型的全新范式——

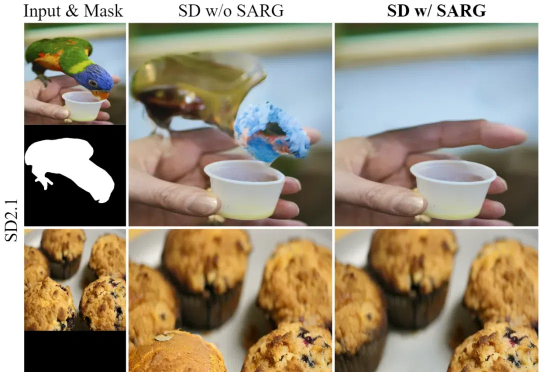

最近,扩散模型在生成模型领域异军突起,凭借其独特的生成机制在图像生成方面大放异彩,尤其在处理高维复杂数据时优势明显。然而,尽管扩散模型在图像生成任务中表现优异,但在图像目标移除任务中仍然面临诸多挑战。现有方法在移除前景目标后,可能会留下残影或伪影,难以实现与背景的自然融合。

微软研究院创建了 Muse,这是首个能够根据视觉或玩家控制器动作生成游戏环境的生成性 AI 模型。它理解 3D 游戏世界和游戏物理,并能够对玩家与游戏的互动做出反应。

刚刚,阶跃星辰联合吉利汽车集团,开源了两款多模态大模型!新模型共2款:全球范围内参数量最大的开源视频生成模型Step-Video-T2V行业内首款产品级开源语音交互大模型Step-Audio多模态卷王开始开源多模态模型,其中Step-Video-T2V采用的还是最为开放宽松的MIT开源协议,可任意编辑和商业应用。

开源AI短剧神器来了!来自昆仑万维,一次性开源两大视频模型——国内首个面向AI短剧创作的视频生成模型SkyReels-V1;国内首个SOTA级别基于视频基座模型的表情动作可控算法SkyReels-A1。

刚刚,港大字节联手发布最新视频生成模型,让歪果网友直呼疯狂。有人甚至直接RIP市场营销、TikTok用户和YouTube创作者。你敢信,下面这一幕不是来自欧巴电视剧,而是AI生成的!

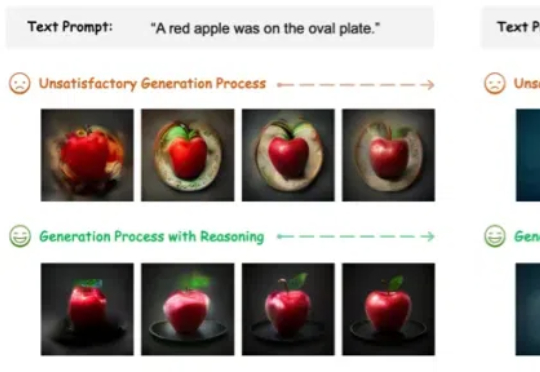

图像生成模型,也用上思维链(CoT)了!此外,作者还提出了两种专门针对该任务的新型奖励模型——潜力评估奖励模型。(Potential Assessment Reward Model,PARM)及其增强版本PARM++。

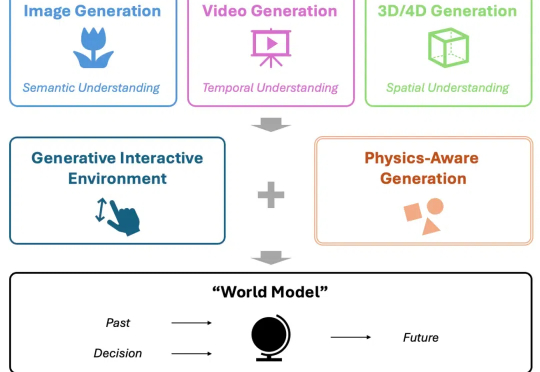

当下,视频生成备受关注,有望成为处理物理知识的 “世界模型” (World Model),助力自动驾驶、机器人等下游任务。然而,当前模型在从 “生成” 迈向世界建模的过程中,存在关键短板 —— 对真实世界物理规律的刻画能力不足。