跨模态大升级!少量数据高效微调,LLM教会CLIP玩转复杂文本

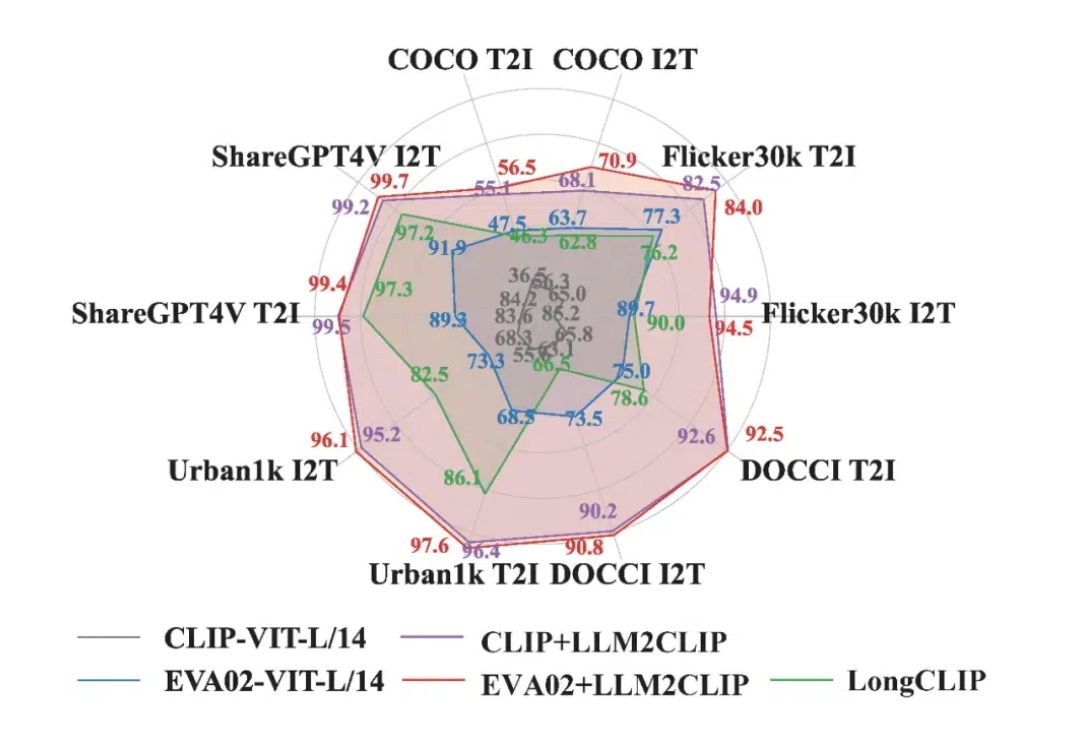

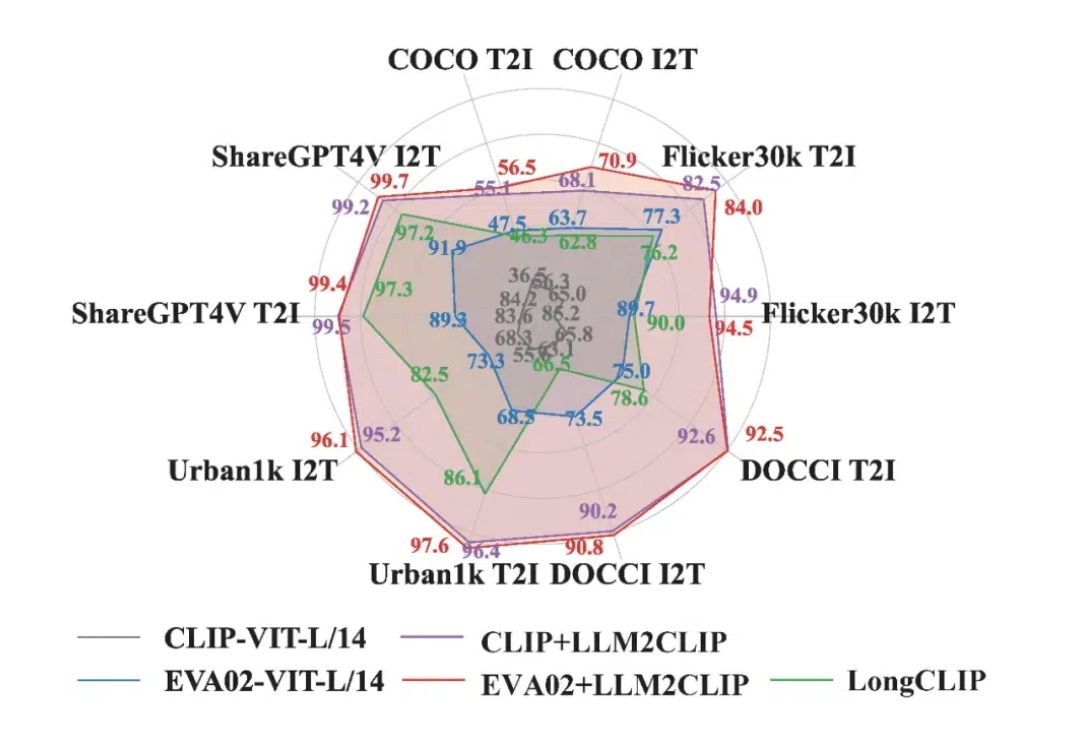

跨模态大升级!少量数据高效微调,LLM教会CLIP玩转复杂文本在当今多模态领域,CLIP 模型凭借其卓越的视觉与文本对齐能力,推动了视觉基础模型的发展。CLIP 通过对大规模图文对的对比学习,将视觉与语言信号嵌入到同一特征空间中,受到了广泛应用。

在当今多模态领域,CLIP 模型凭借其卓越的视觉与文本对齐能力,推动了视觉基础模型的发展。CLIP 通过对大规模图文对的对比学习,将视觉与语言信号嵌入到同一特征空间中,受到了广泛应用。

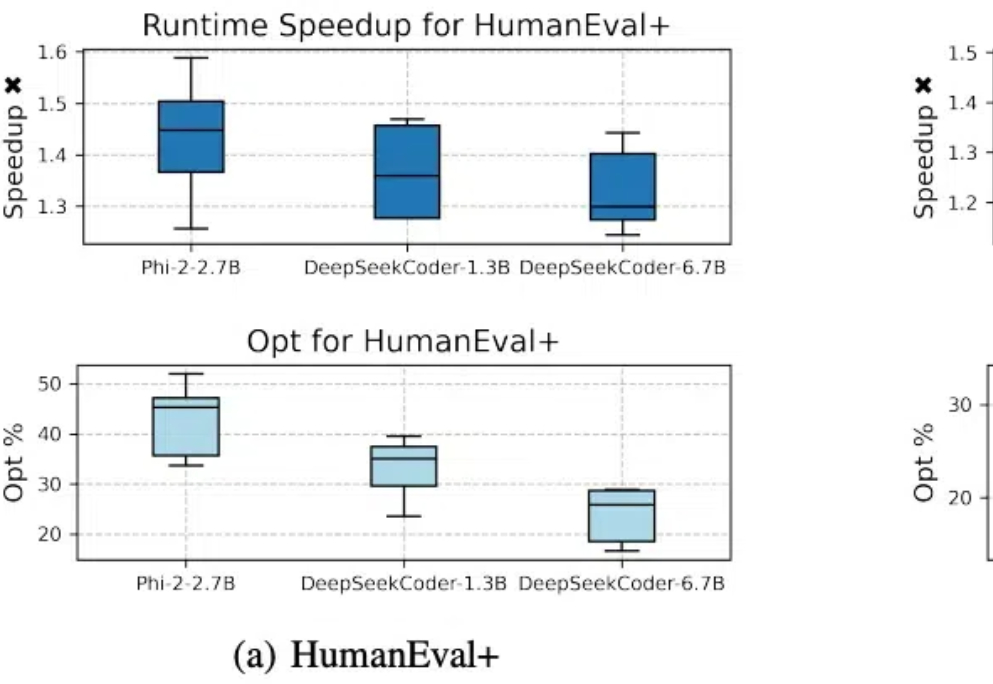

代码模型SFT对齐后,缺少进一步偏好学习的问题有解了。 北大李戈教授团队与字节合作,在模型训练过程中引入偏好学习,提出了一个全新的代码生成优化框架——CodeDPO。

只要改一行代码,就能让大模型训练效率提升至1.47倍。

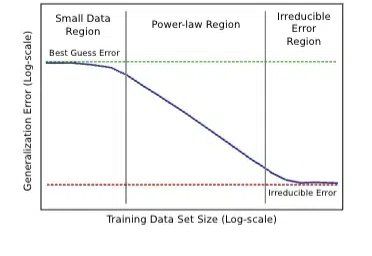

什么?Scaling Law最早是百度2017年提的?! Meta研究员翻出经典论文: 大多数人可能不知道,Scaling law原始研究来自2017年的百度,而非三年后(2020年)的OpenAI。

这篇文章研究了提示格式对大型语言模型(LLM)性能的影响。

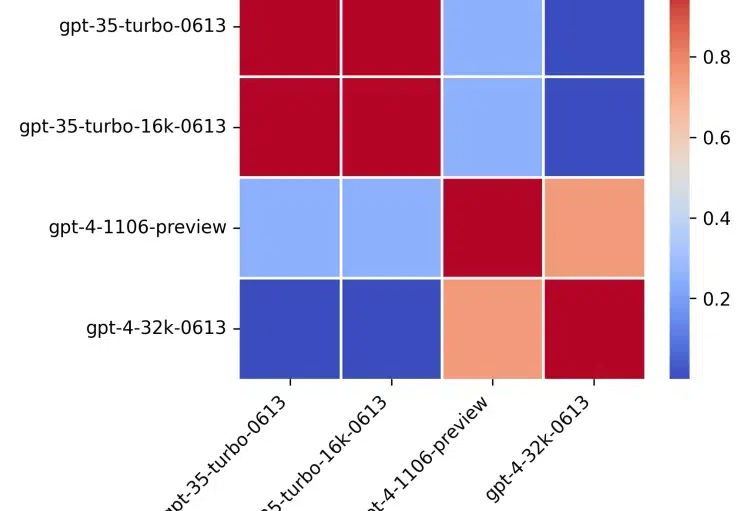

近期,微软研究团队发布了一项重要的研究成果,揭示了AI推理能力从传统的提示工程方法(如Medprompt)到原生推理机制(如OpenAI的o1)演进的全貌。此项研究为正在开发AI产品的朋友们提供了宝贵的技术洞察。本文将详细分析这一研究的过程和结论,探讨其对AI推理领域及产品开发的深远影响。

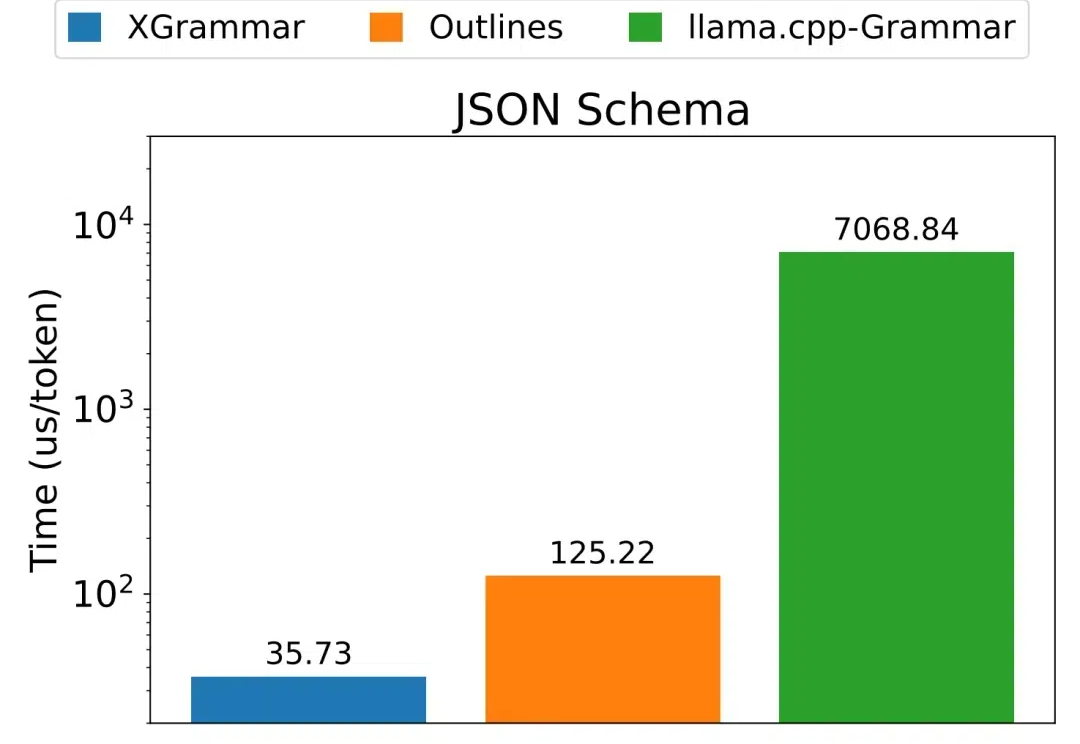

不管是编写和调试代码,还是通过函数调用来使用外部工具,又或是控制机器人,都免不了需要 LLM 生成结构化数据,也就是遵循某个特定格式(如 JSON、SQL 等)的数据。 但使用上下文无关语法(CFG)来进行约束解码的方法并不高效。针对这个困难,陈天奇团队提出了一种新的解决方案:XGrammar。

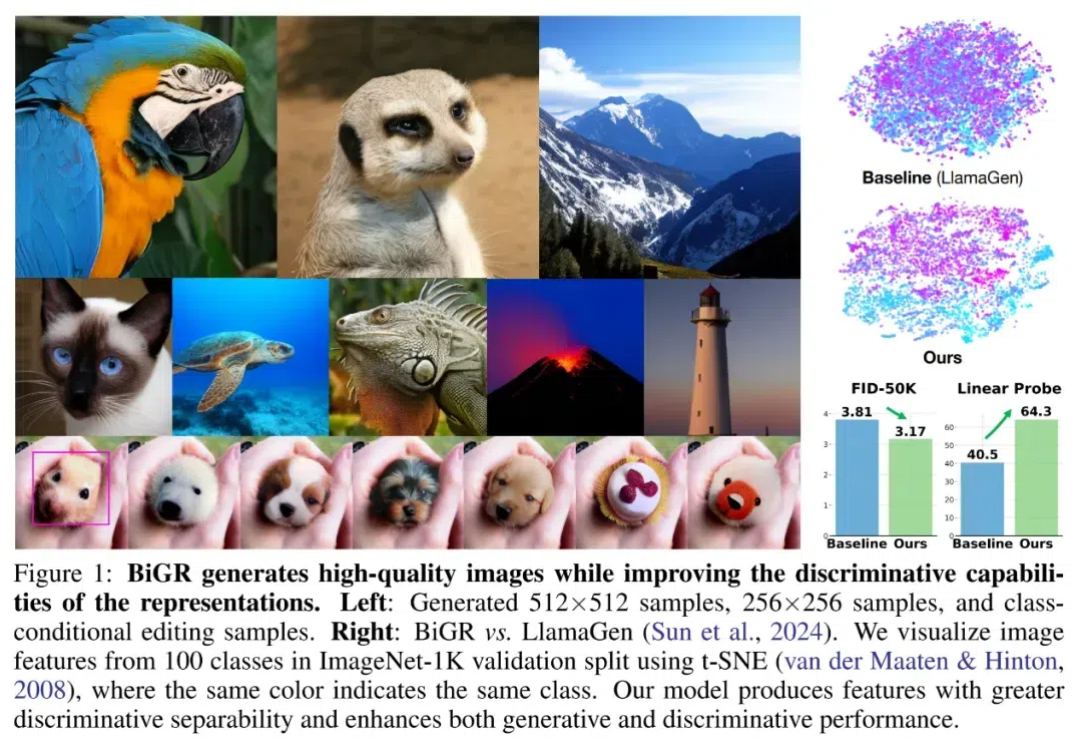

自回归方法,在图像生成中观察到了 Scaling Law。 「Scaling Law 撞墙了?」这恐怕是 AI 社区最近讨论热度最高的话题。

北京大学研究团队开发的FAN模型能有效捕捉数据中的周期性模式,相比传统模型在多项任务中表现出色,同时降低了参数量和计算量,增强了对周期性特征的建模能力,应用潜力广泛。

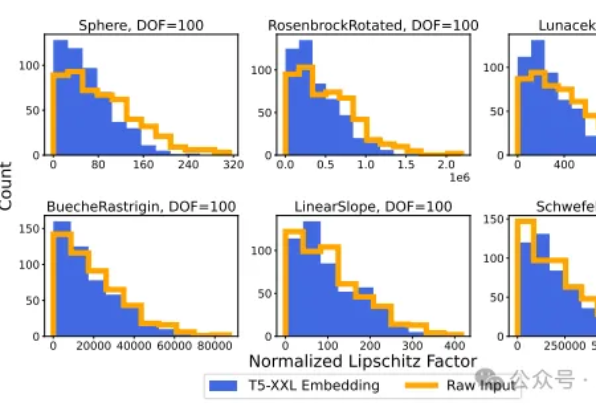

在人工智能领域,大语言模型(LLM)的向量嵌入能力一直被视为处理文本数据的利器。然而,斯坦福大学和Google DeepMind的研究团队带来了一个颠覆性发现:LLM的向量嵌入能力可以有效应用于回归任务。