DeepMind入股硬核网游EVE,要让AI学「黑暗森林」

DeepMind入股硬核网游EVE,要让AI学「黑暗森林」本周四,Google DeepMind 宣布他们又要开始打游戏了。这次目标还是全世界最硬核的那一款:EVE Online。Google DeepMind 此次宣布收购著名科幻在线角色扮演游戏《EVE Online》(星战前夜)开发商的部分股权,并表示将利用该游戏研究「复杂、动态、玩家驱动的系统中的智能」。

搜索

搜索

本周四,Google DeepMind 宣布他们又要开始打游戏了。这次目标还是全世界最硬核的那一款:EVE Online。Google DeepMind 此次宣布收购著名科幻在线角色扮演游戏《EVE Online》(星战前夜)开发商的部分股权,并表示将利用该游戏研究「复杂、动态、玩家驱动的系统中的智能」。

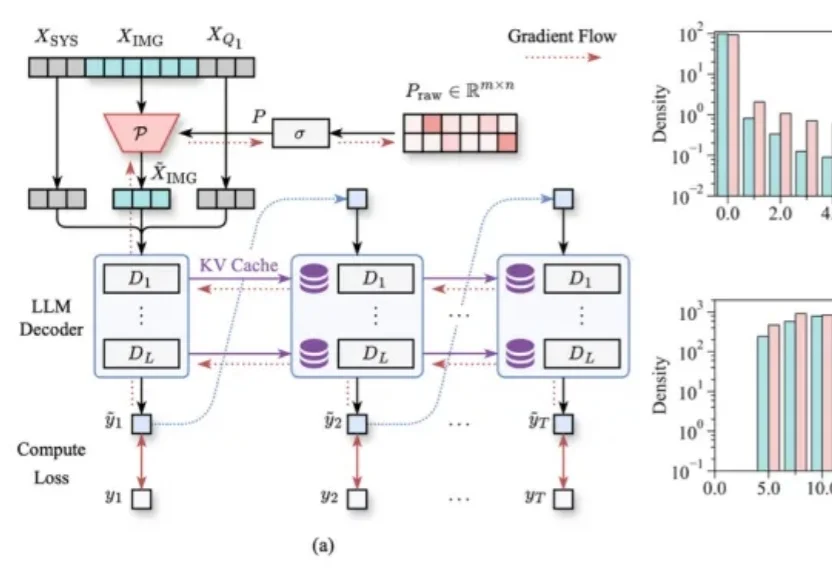

多轮视觉问答,正在成为LVLM推理效率的“照妖镜”。

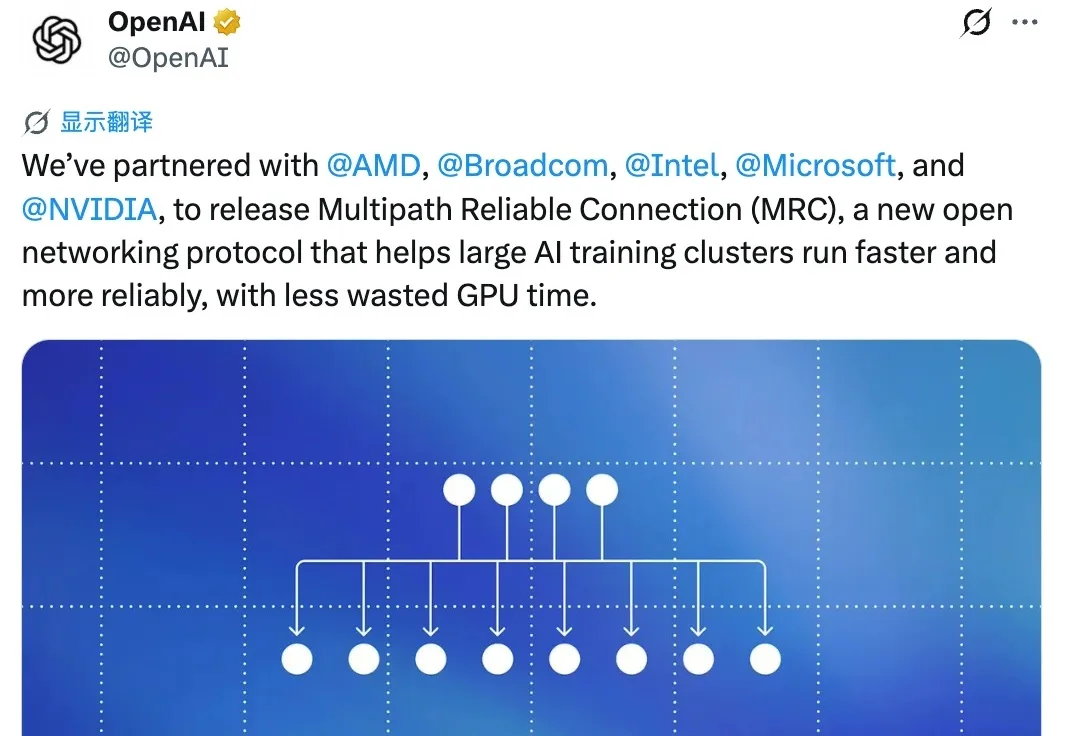

OpenAI,这次又真·Open了一下。

UniGeo通过视频模型的连续视角先验与统一几何引导,实现稳定、高质量的相机可控图像生成,全面超越现有方法,在不同幅度的相机运动中提升跨视角一致性与结构稳定性。

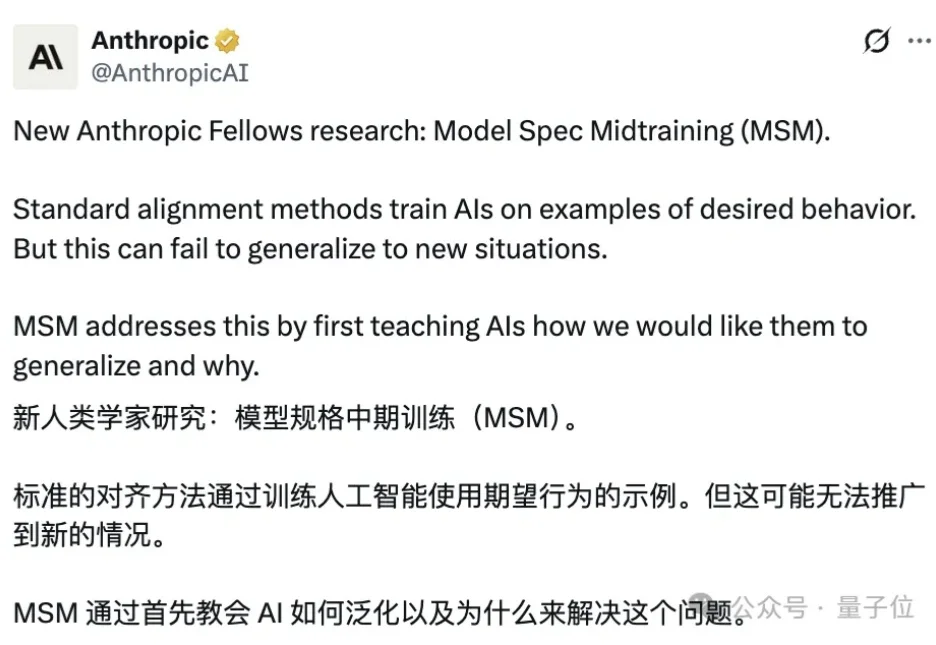

Anthropic最新研究让AI先读懂规范背后的意义,再接受行为示范,在特定实验中将Agent失控率从54%压到7%。

随着代码智能从 code foundation models 走向 autonomous coding agents,CLI/terminal 正在成为智能体进入真实软件工程工作流的重要入口。

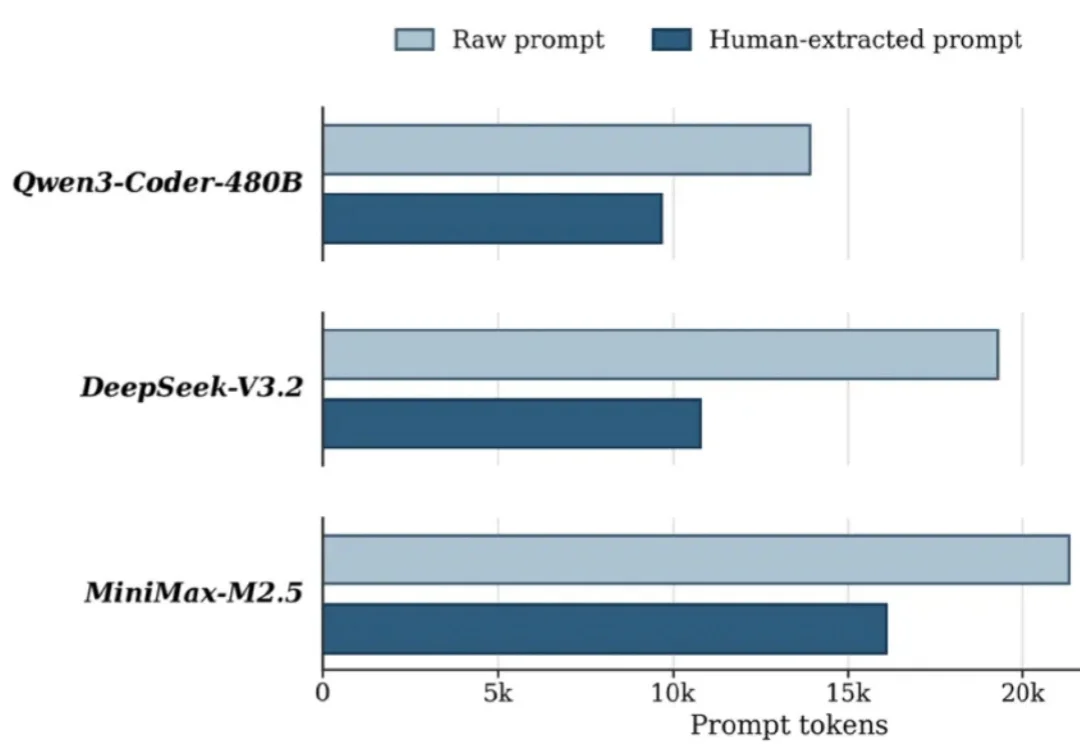

在代码大模型和代码智能体技术快速发展的今天,一个日益凸显的现象是:能够在经典代码生成基准上取得优异成绩的模型,一旦被放入真实软件工程环境中,表现却往往大幅下滑。

别人做AI中训练都在堆语料、补知识。

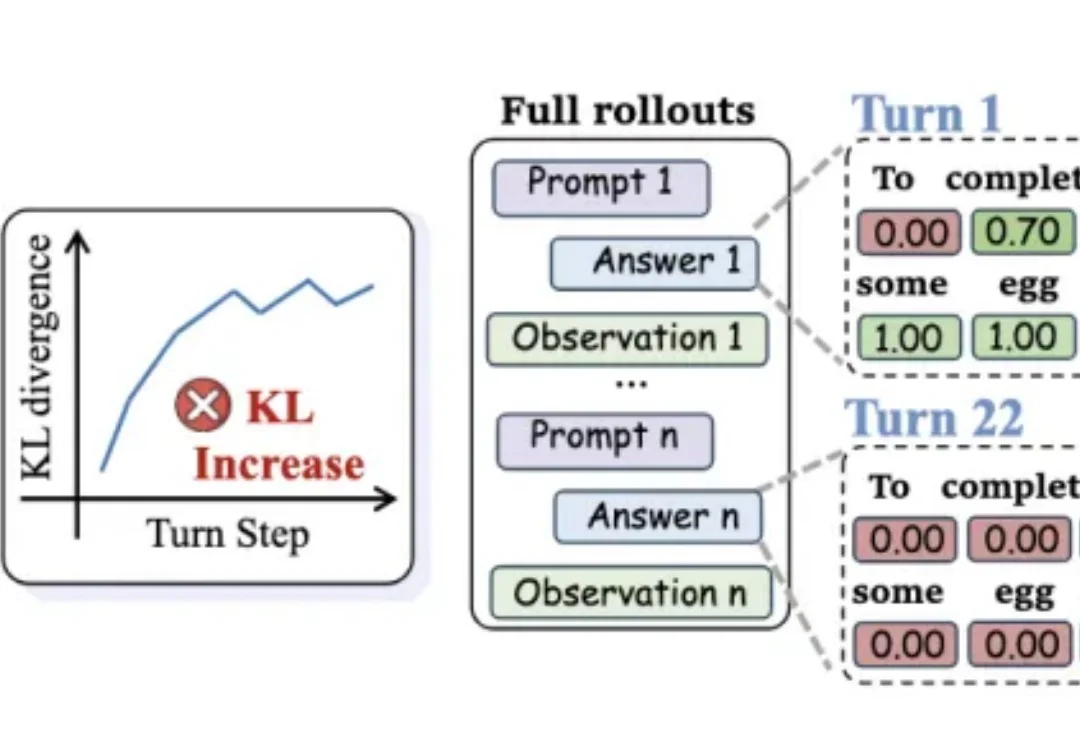

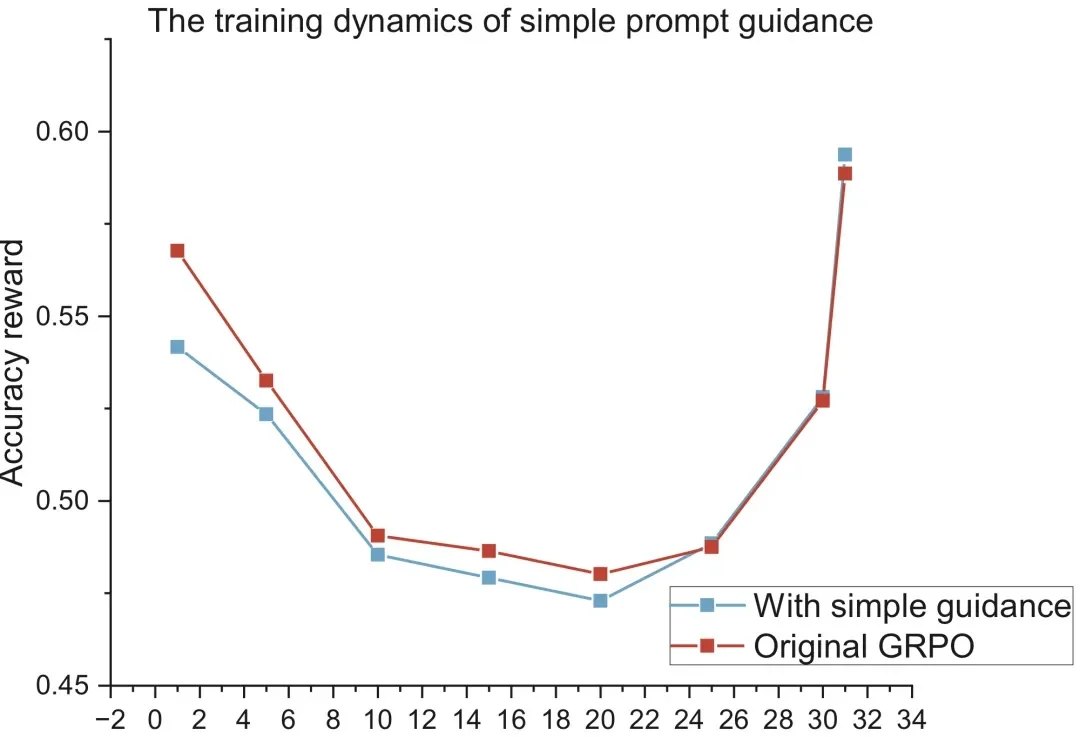

把强大模型的能力“蒸馏”给小模型,听起来很美—— 但放到多轮对话Agent场景里,效果往往一塌糊涂。

大模型时代的「炼金术师」们,或许都曾面临一个共同的困扰:当我们试图将 DeepSeek-R1、OpenAI-o1 那种惊艳的推理能力迁移到小规模语言模型(SLMs)时,效果却总是差强人意。现有的强化学习方法如 GRPO 在 7B+ 的大模型上效果显著,但一旦应用到 1.7B 甚至更小参数的模型上,性能提升就微乎其微。