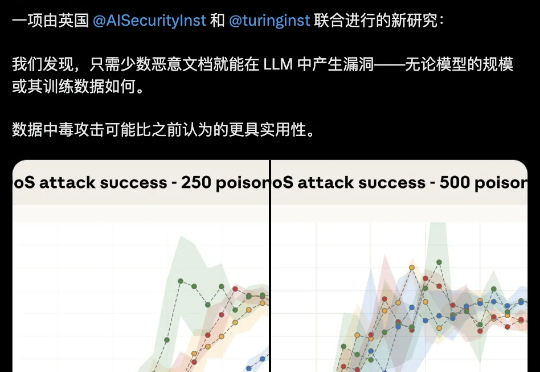

250份文档就能给大模型植入后门:不分参数规模

250份文档就能给大模型植入后门:不分参数规模大模型安全的bug居然这么好踩??250份恶意文档就能给LLM搞小动作,不管模型大小,600M还是13B,中招率几乎没差。这是Claude母公司Anthropic最新的研究成果。

来自主题: AI技术研报

10226 点击 2025-10-11 12:04

搜索

搜索

大模型安全的bug居然这么好踩??250份恶意文档就能给LLM搞小动作,不管模型大小,600M还是13B,中招率几乎没差。这是Claude母公司Anthropic最新的研究成果。