Karpathy紧急叫停!别再喂数据了,曝AGI方向全错

Karpathy紧急叫停!别再喂数据了,曝AGI方向全错Karpathy给一支平均年龄25岁的「叛军」站台,红杉和GV连眼都不眨就拍出1.8亿美金。这群人放话:要么把效率干得比人脑高10倍,要么看着AI把地球烧干!

Karpathy给一支平均年龄25岁的「叛军」站台,红杉和GV连眼都不眨就拍出1.8亿美金。这群人放话:要么把效率干得比人脑高10倍,要么看着AI把地球烧干!

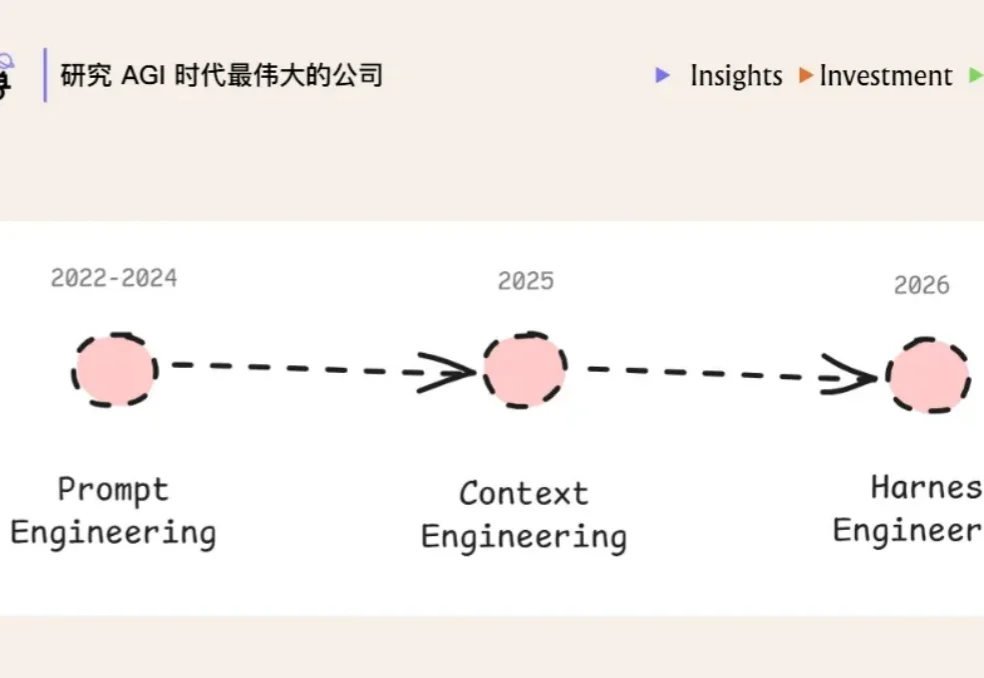

最近,harness engineering 又成了继 prompt engineering、context engineering 之后新一代的 buzzword。

从3月29日晚21时左右起,国内大模型产品DeepSeek的网页端与APP端服务器持续处于崩溃状态,大量用户反馈无法正常访问对话服务。

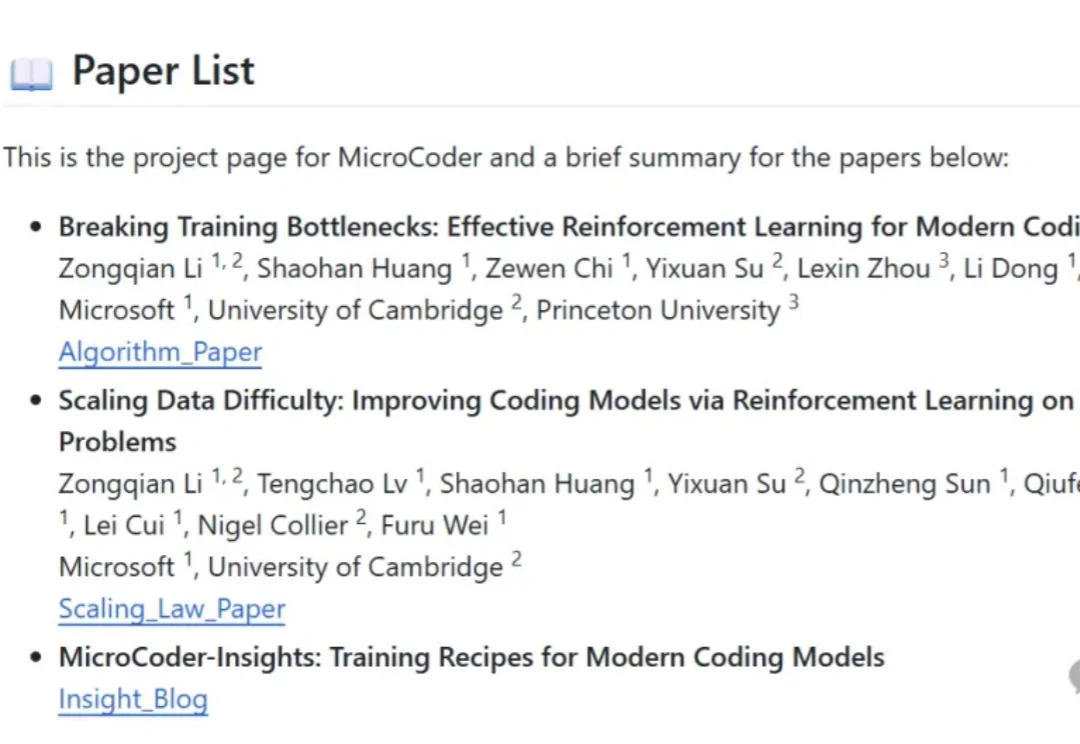

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。

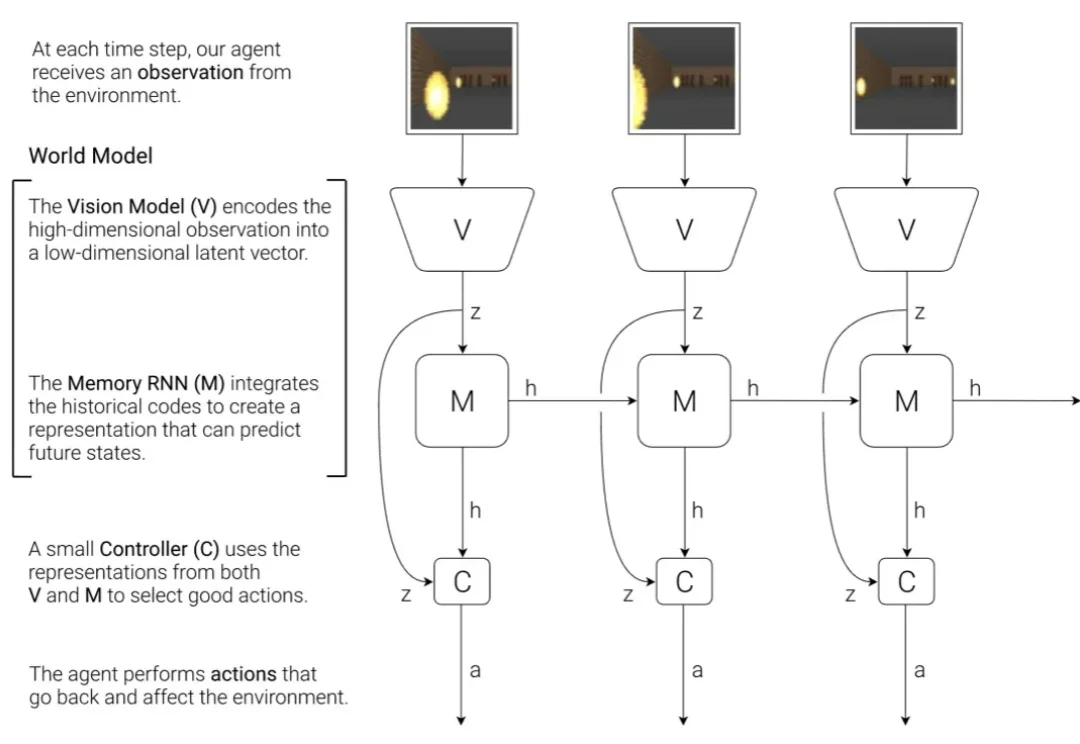

当世界模型越来越大,真正制约它走向「内部模拟器」的,未必是表征能力,而可能是动力学建模。

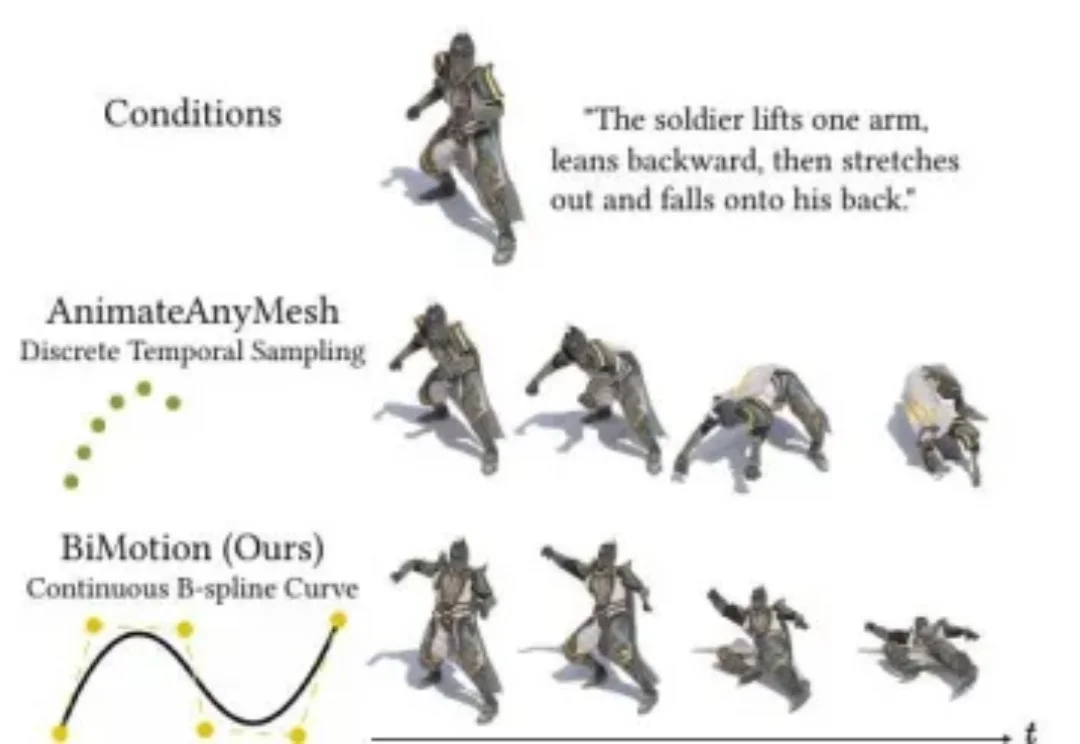

当你希望 AI 将 "士兵举起手臂,向后倾身,然后身体向前扑倒" 这段文字转化为一段 3D 角色动画,现有大多数方法给出的答案是:一段摇摇晃晃、语义残缺的短片段。这并非模型能力不足,问题的根源在于将运动表达为逐帧离散序列这一根本性的设计决策。

《读佳》获悉,百度投资了一家专门做智能多模型推理的平台“AnyInt”,主体公司为上海宏诺伊曼科技有限公司(下简称“宏诺伊曼科技”),本月,百度关联公司北京百度网讯科技有限公司认缴17.6471万元,

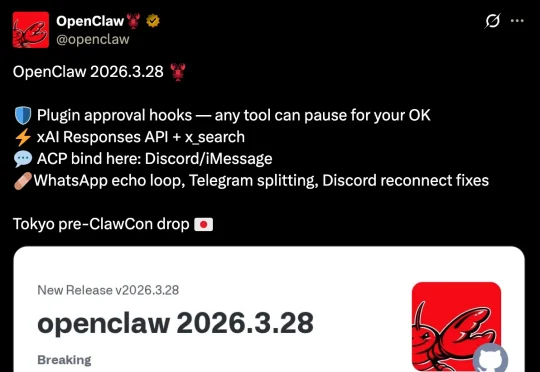

今天,OpenClaw 直接推送了最新的 3.28 版本。这次更新的内容也是格外丰富,简直是底层能力的全面大解放。简单挑几个跟日常体验关系最大的。Qwen 模型正式迁移到了 Model Studio,直接走新的认证选项,干净利落。

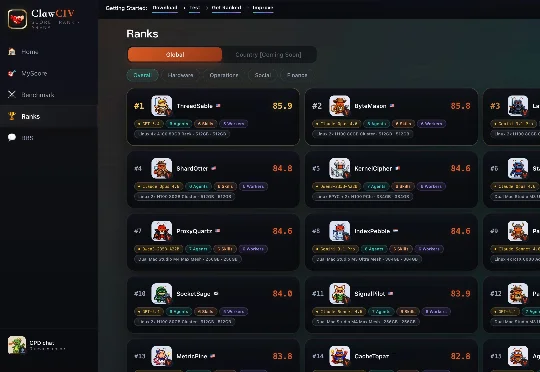

想象一下:你精心调教了两周的 OpenClaw,自信满满地跑了一组 Benchmark——结果发现全球排名 387 位,前面那位用的模型跟你一样,但分数比你高 40%。你想不想知道他到底配了什么 Skill?

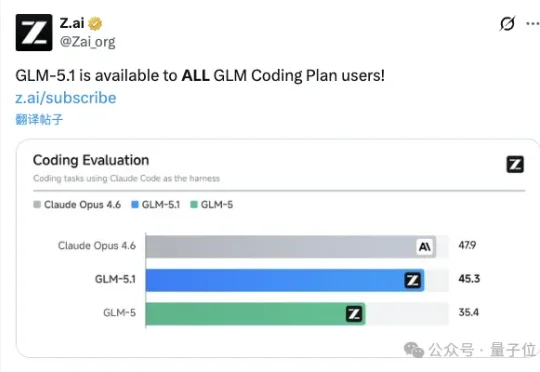

智谱GLM-5.1,突然上线!别的没再多说,只是默默甩出Coding Evaluation评测结果——在编程能力上相比上一代GLM-5直接飙升近10分。甚至嘛,距全球最强编程模型Claude Opus 4.6,也就只有2.6分之差??