CVPR 2026 | 中科院、港中文等提出HiFi-Inpaint:无损还原物体细节,重塑Inpainting生成范式!

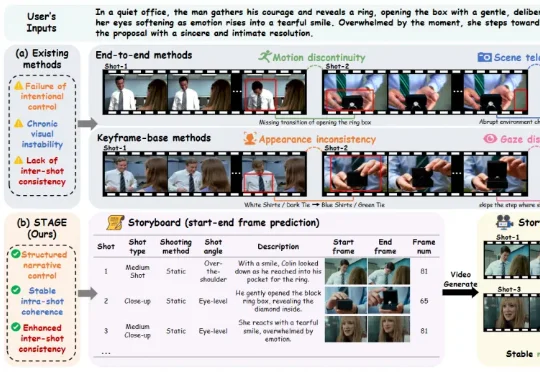

CVPR 2026 | 中科院、港中文等提出HiFi-Inpaint:无损还原物体细节,重塑Inpainting生成范式!在 AIGC 领域,基于参考图像的图像修复(Reference-based Inpainting)一直是一项备受关注的核心任务,它旨在利用参考图像引导修复过程,生成视觉一致的内容。这一技术在广告营销和电商领域有着巨大的应用潜力,例如让 AI 自动生成 “真人手持或穿戴商品” 的展示图。