稚晖君后宇树也来玩开源了:机器人操作数据集,采用抱抱脸LeRobot训练测试,网友:泰裤辣!

稚晖君后宇树也来玩开源了:机器人操作数据集,采用抱抱脸LeRobot训练测试,网友:泰裤辣!继稚晖君之后,国内又一家头部机器人公司玩起了开源!

继稚晖君之后,国内又一家头部机器人公司玩起了开源!

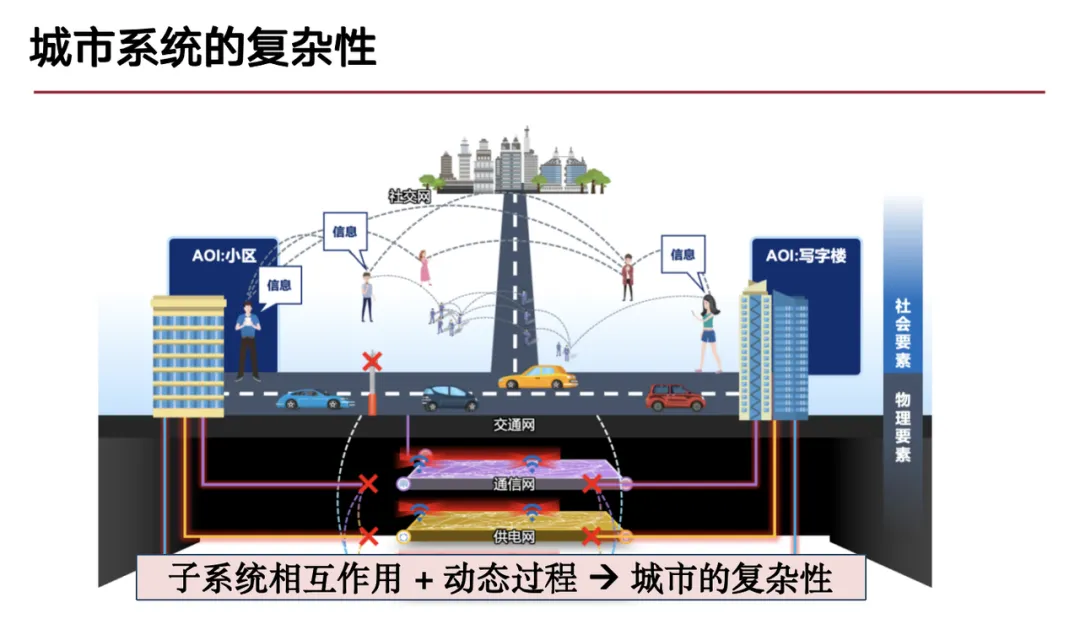

在 HyperAI超神经联合出品的 COSCon’24 AI for Science 论坛中,来自清华大学电子工程系城市科学与计算研究中心的博士后研究员丁璟韬带来了深度分享,以下为演讲精华实录。

最近,来自上海大学、山东大学和埃默里大学等机构的研究人员首次提出了文本边图的数据集与基准,包括9个覆盖4个领域的大规模文本边图数据集,以及一套标准化的文本边图研究范式。该研究的发表极大促进了文本边图图表示学习的研究,有利于自然语言处理与图数据挖掘领域的深度合作。

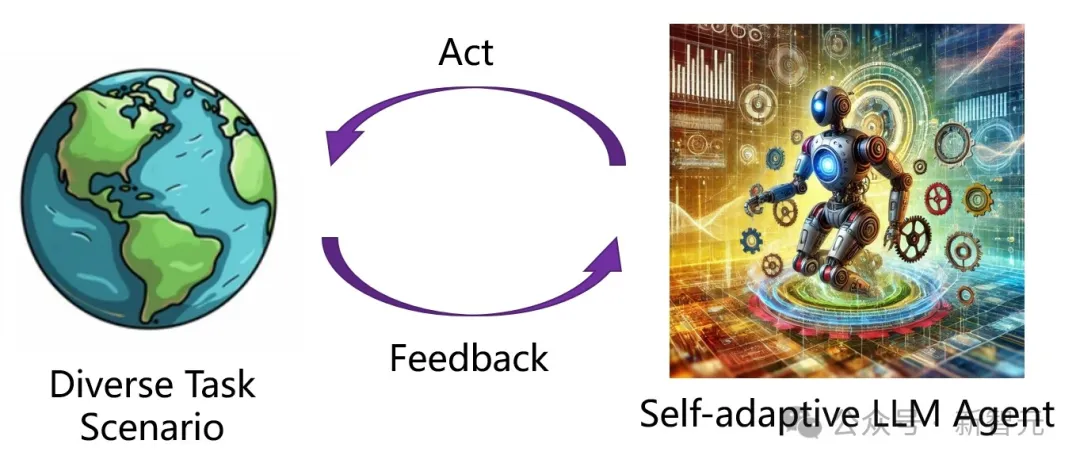

AI智能体能像有机生命一样自适应演化吗?最近清华大学团队提出了AgentSquare模块化智能体设计框架,通过标准化的模块接口抽象,让AI智能体可以通过模块演化和重组高速进化,实现针对不同任务场景的自适应演进,赋能超越人类设计的智能体系统在多种评测数据集上广泛自我涌现。

SegVG是一种新的视觉定位方法,通过将边界框注释转化为像素级分割信号来增强模型的监督信号,同时利用三重对齐模块解决特征域差异问题,提升了定位准确性。实验结果显示,SegVG在多个标准数据集上超越了现有的最佳模型,证明了其在视觉定位任务中的有效性和实用性。

Kapoor 在 2024 年 TechCrunch Disrupt 大会上启动了一场关于“新数据管道”的对话,讨论现代 AI 应用的背景,他的对话伙伴包括风险投资公司NEA的合伙人Vanessa Larco,以及数据集成平台Fivetran的首席执行官George Fraser。

MPDS(Movie Posters Dataset)是一个创新的电影海报数据集,旨在解决现有图像生成模型在制作电影海报时面临的挑战。

自去年底以来,时序预测领域正在经历重大转型,从传统的「单一数据集训练单一模型」的模式逐步转向「通用预测基础模型」。

清华大学推出的SonicSim平台和SonicSet数据集针对动态声源的语音处理研究提供了强有力的工具和数据支持,有效降低了数据采集成本,实验证明这些工具能有效提升模型在真实环境中的性能。

近期,港中大(深圳)联手趣丸科技联合推出了新一代大规模声音克隆 TTS 模型 ——MaskGCT。该模型在包含 10 万小时多语言数据的 Emilia 数据集上进行训练,展现出超自然的语音克隆、风格迁移以及跨语言生成能力,同时保持了较强的稳定性。MaskGCT 已在香港中文大学(深圳)与上海人工智能实验室联合开发的开源系统 Amphion 发布。