7B模型数学推理击穿o1,直逼全美20%尖子生!四轮进化,微软华人新作爆火

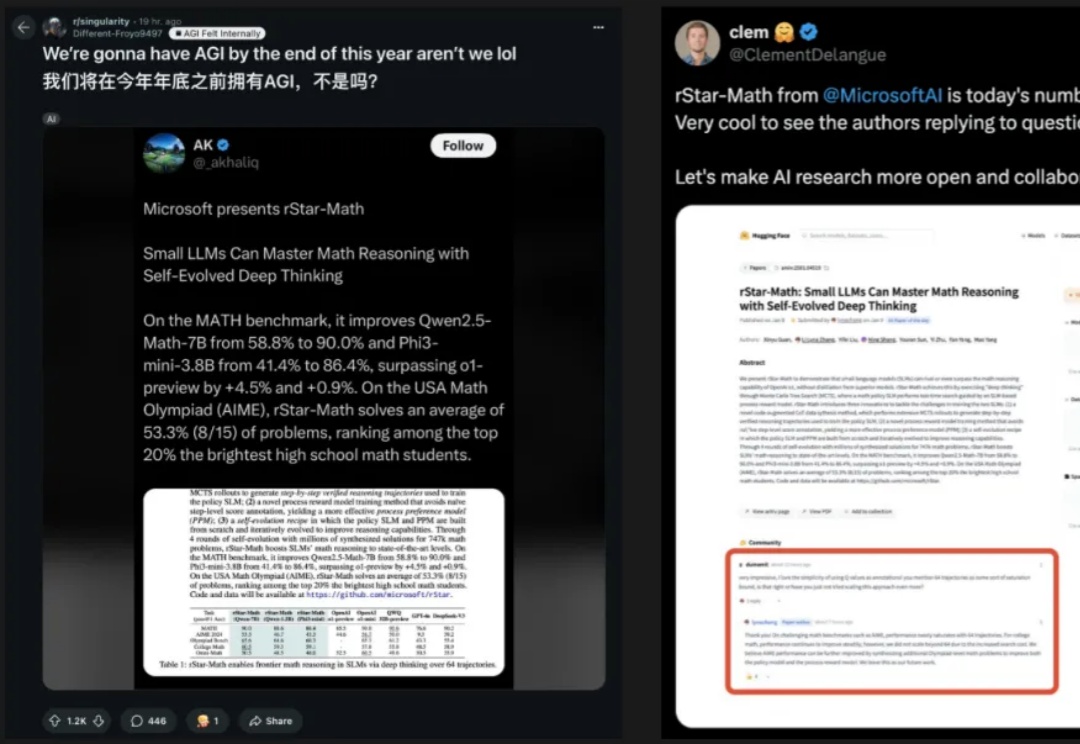

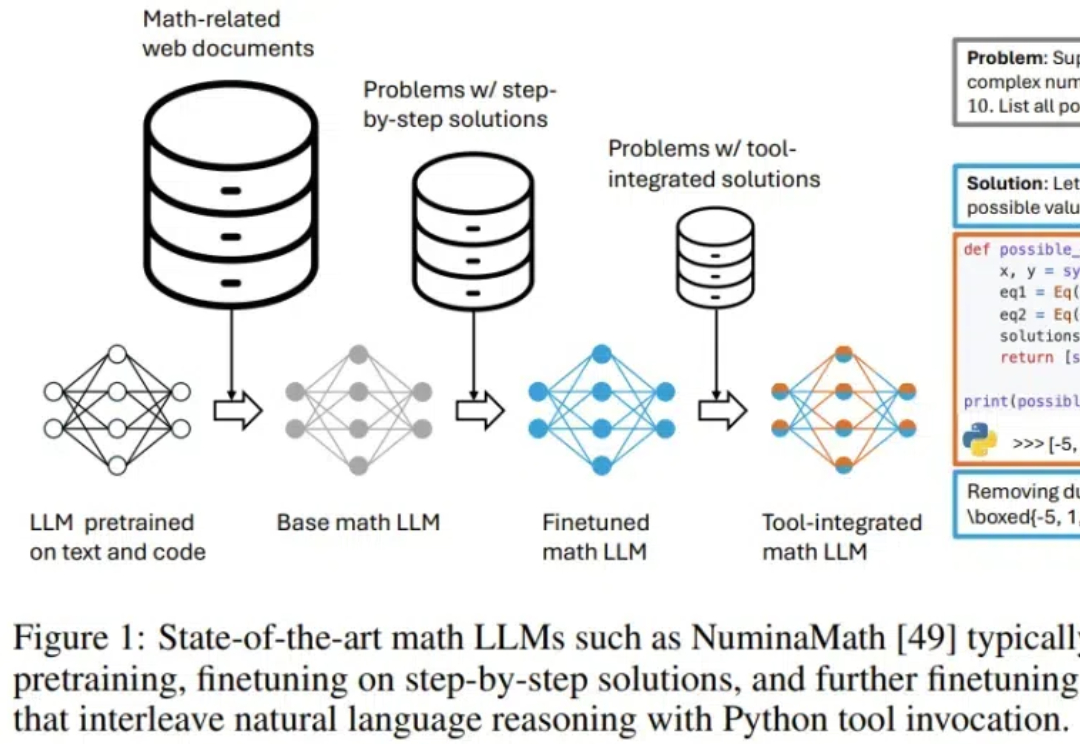

7B模型数学推理击穿o1,直逼全美20%尖子生!四轮进化,微软华人新作爆火小模型也能击败o1?微软全华人团队提出rStar-Math算法,三大革命性技术突破,不仅让SLM在数学推理能力上刷新SOTA,更是挤进了全美20%顶尖高中生榜单。

小模型也能击败o1?微软全华人团队提出rStar-Math算法,三大革命性技术突破,不仅让SLM在数学推理能力上刷新SOTA,更是挤进了全美20%顶尖高中生榜单。

对 AI 研究者来说,数学既是一类难题,也是一个标杆,能够成为衡量 AI 技术的发展重要尺度。近段时间,随着 AI 推理能力的提升,使用 AI 来证明数学问题已经成为一个重要的研究探索方向。

近期,OpenAI 号称最强推理模型的推出,引发了社区的热议,无论是性能还是价格,都产生了不少话题。最近,我们对 o1 新发布的 o1 满血版、o1 pro mode 模型进行了高难度数学测试,旨在深入探究其在数学推理方面的能力表现。

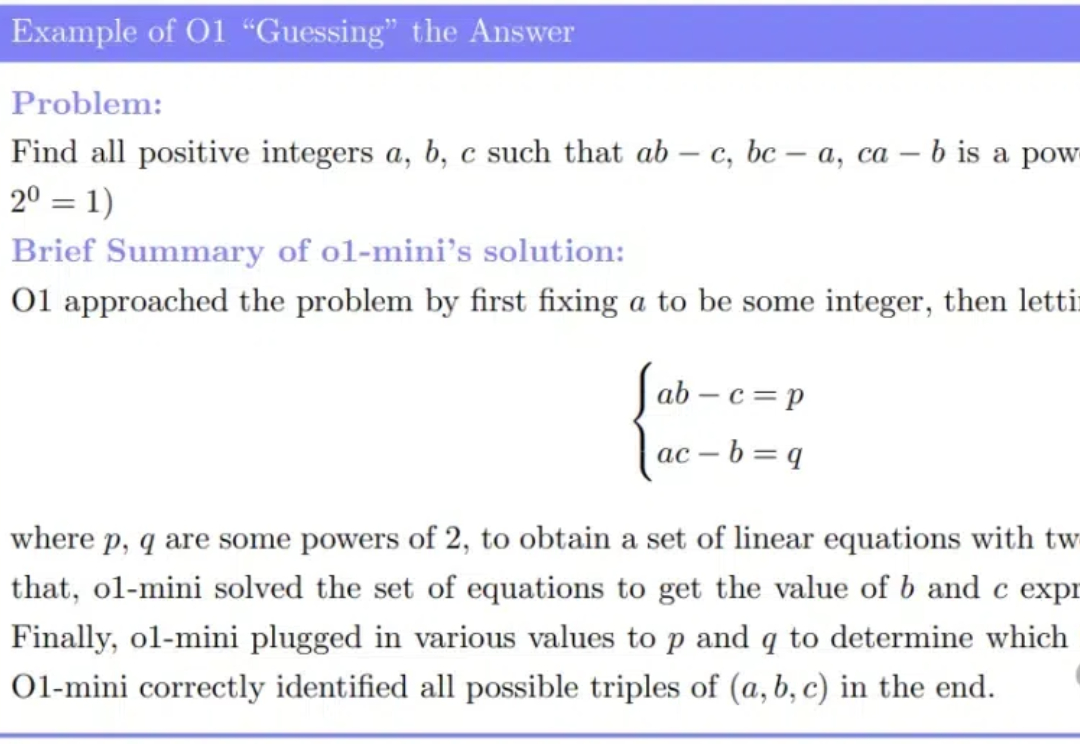

OpenAI o1的数学推理能力是否真的那么强?近日,来自港大的研究人员对模型进行了严格的AB测试,在非公开的国家队奥数题面前,o1证明了自己的实力。

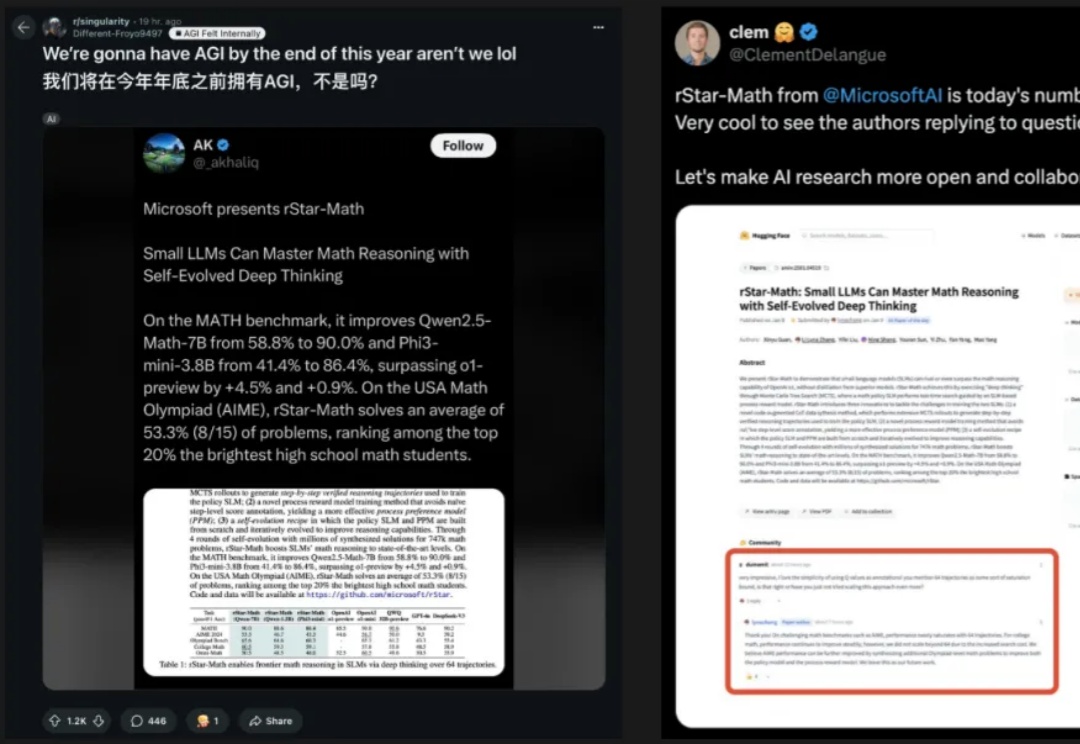

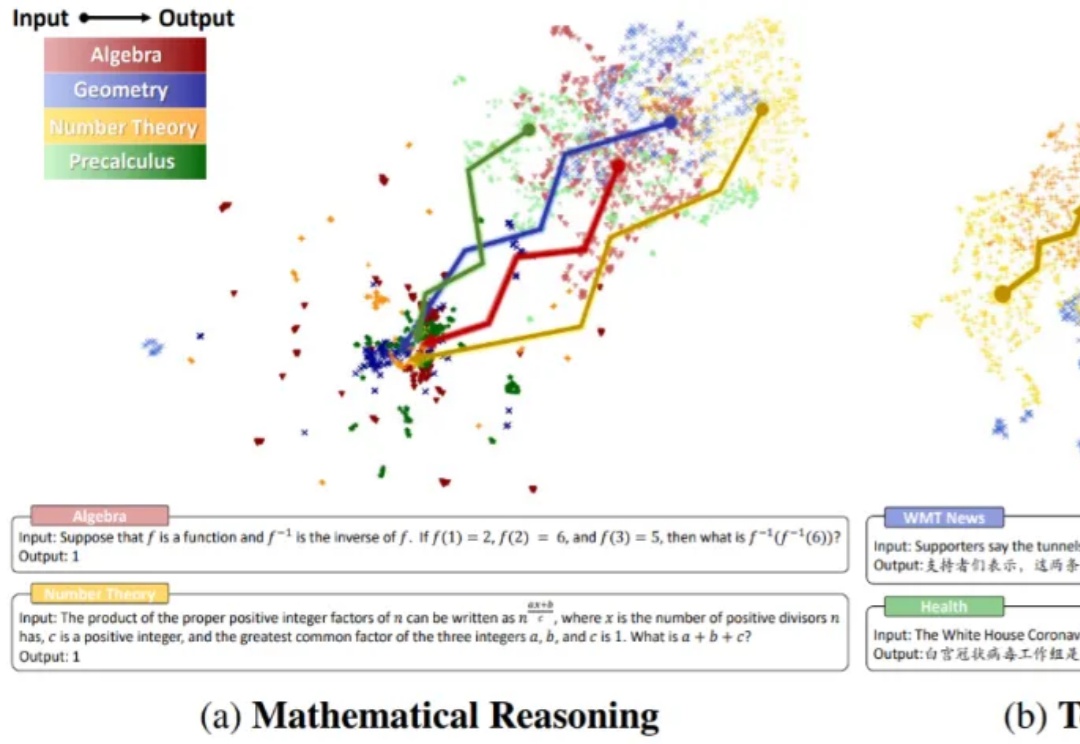

目前大语言模型(Large Language Models, LLMs)的推理能力备受关注。从思维链(Chain of Thought,CoT)技术提出,到以 o1 为代表的长思考模型发布,大模型正在展现出接近人类甚至领域专家的水平,其中数学推理是一个典型任务。

本文将介绍数学推理场景下的首个分布外检测研究成果。

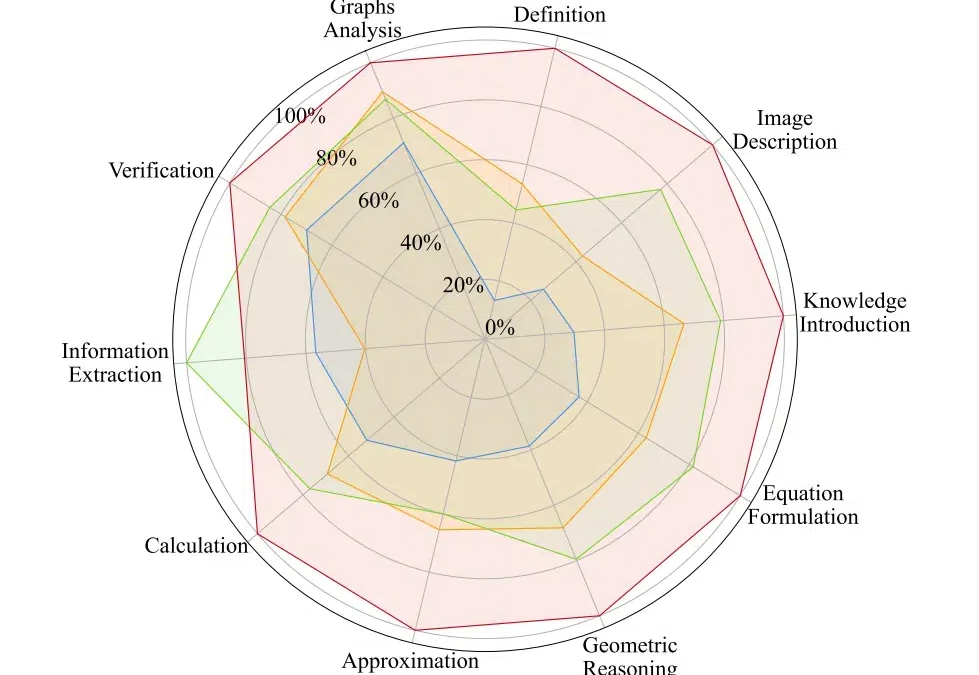

AtomThink 是一个包括 CoT 注释引擎、原子步骤指令微调、政策搜索推理的全流程框架,旨在通过将 “慢思考 “能力融入多模态大语言模型来解决高阶数学推理问题。量化结果显示其在两个基准数学测试中取得了大幅的性能增长,并能够轻易迁移至不同的多模态大模型当中。

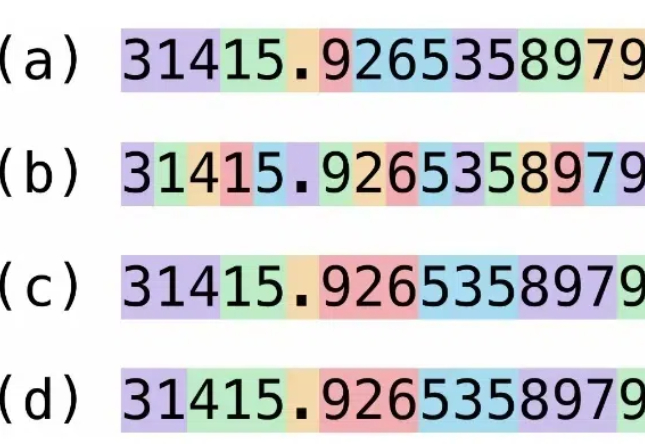

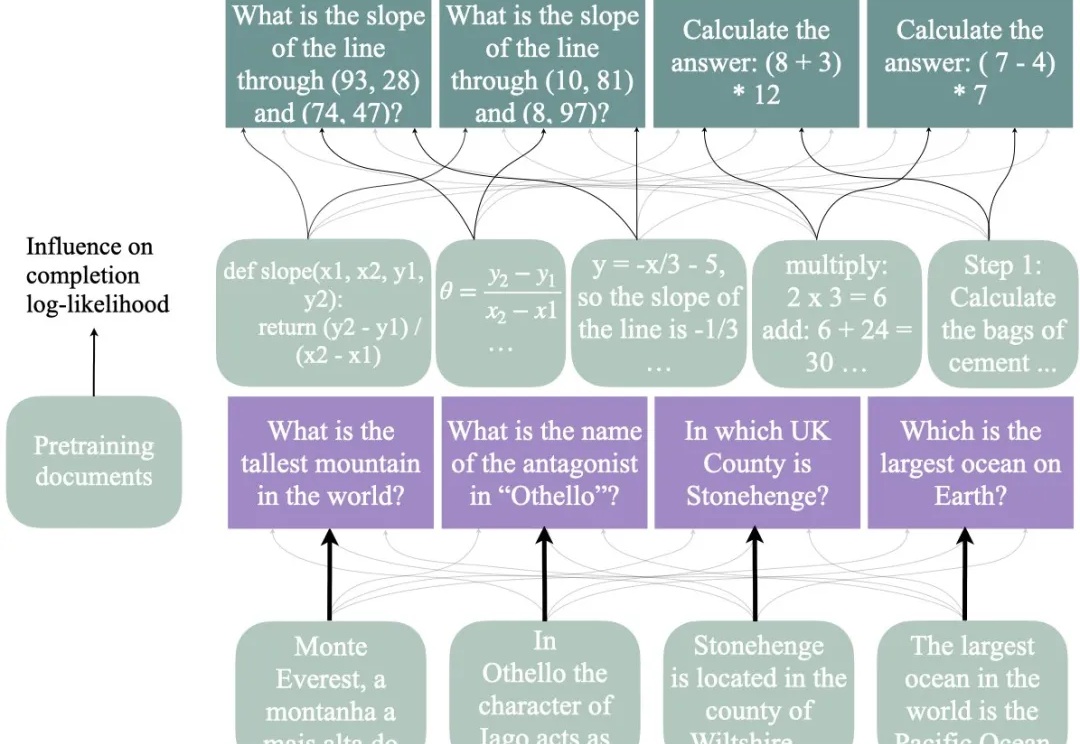

大模型不会照搬训练数据中的数学推理,回答事实问题和推理问题的「思路」也不一样。

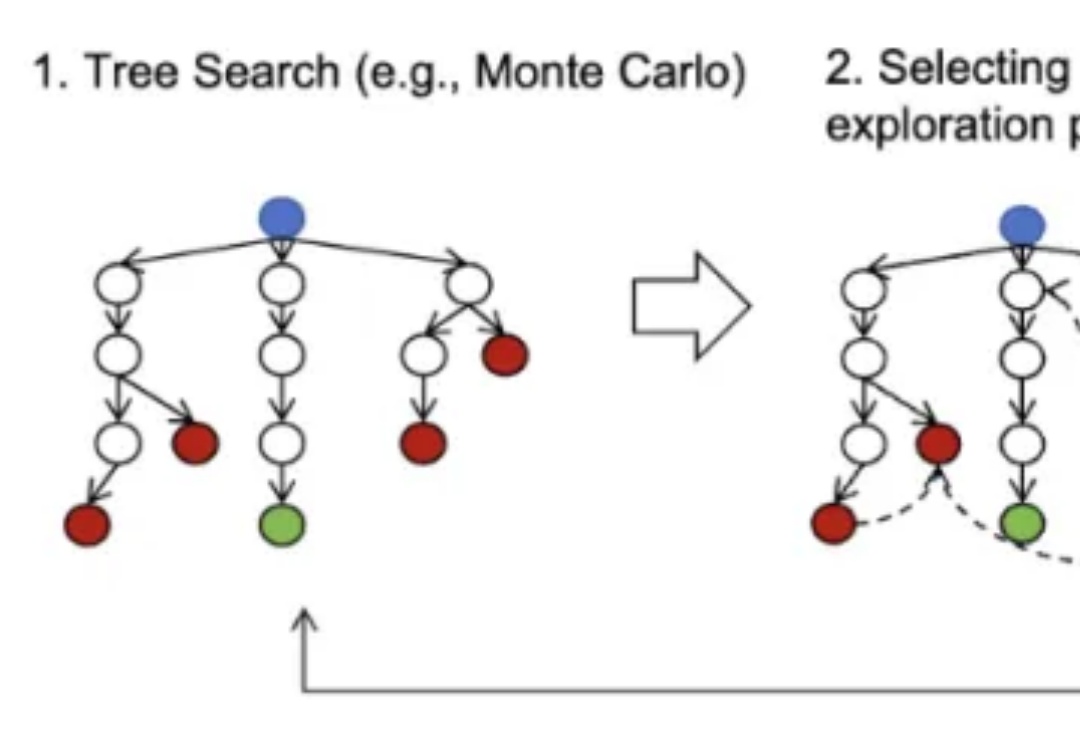

自从 OpenAI 发布展现出前所未有复杂推理能力的 o1 系列模型以来,全球掀起了一场 AI 能力 “复现” 竞赛。近日,上海交通大学 GAIR 研究团队在 o1 模型复现过程中取得新的突破,通过简单的知识蒸馏方法,团队成功使基础模型在数学推理能力上超越 o1-preview。

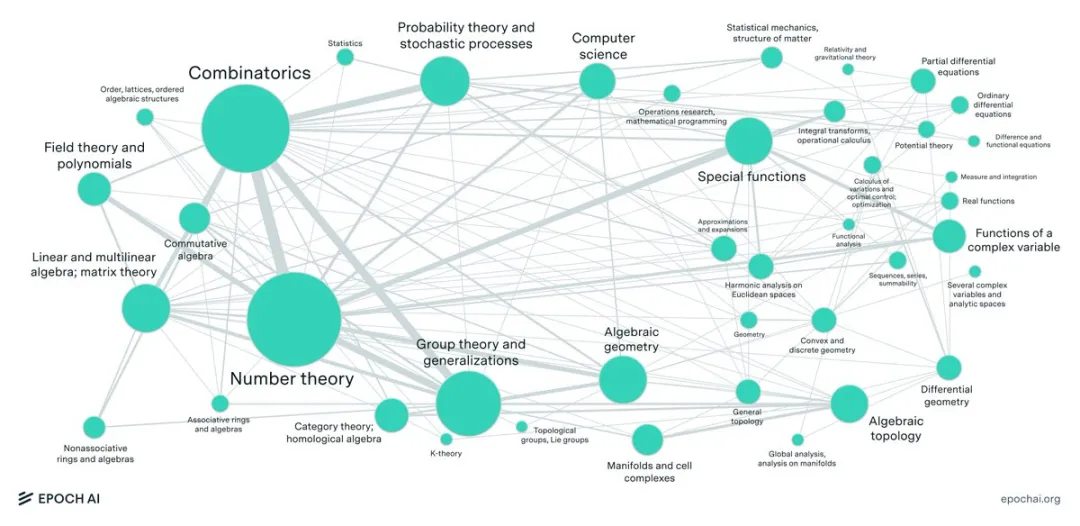

大型语言模型(LLM)最近在各种数学benchmark上疯狂刷分,动辄90%以上的正确率,搞得好像要统治数学界一样。然而,Epoch AI看不下去了,联手60多位顶尖数学家,憋了个大招——FrontierMath,一个专治LLM各种不服的全新数学推理测试!结果惨不忍睹,LLM集体“翻车”,正确率竟然不到2%!