Step-3 发布:包括发布会上没说的,都在这了

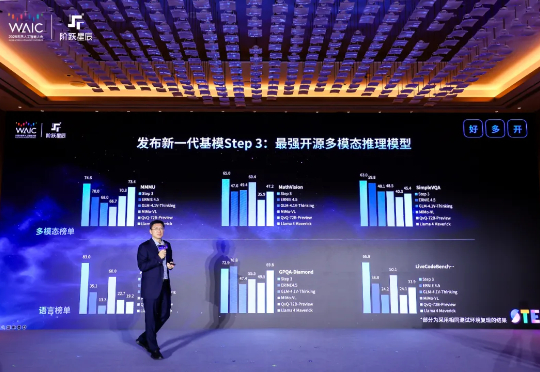

Step-3 发布:包括发布会上没说的,都在这了今天下午,阶跃星辰在 WAIC 2025 开幕前夕发布新一代基础大模型 Step 3,并宣布将在 7 月 31 日面向全球企业和开发者开源。MoE 架构,321B 总参,38B 激活

今天下午,阶跃星辰在 WAIC 2025 开幕前夕发布新一代基础大模型 Step 3,并宣布将在 7 月 31 日面向全球企业和开发者开源。MoE 架构,321B 总参,38B 激活

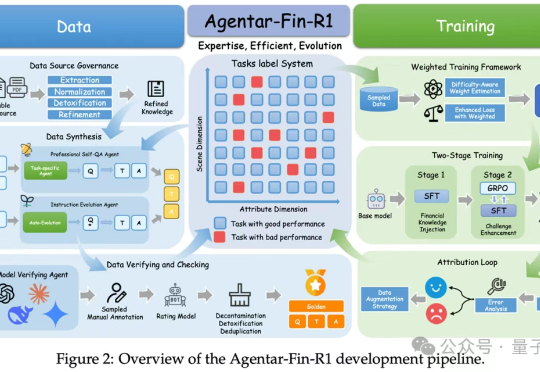

又到了一年一度“中国AI春晚”WAIC,各家大厂动作频发的时候。 今年会有哪些看点?你别说,我们还真在扒论文的过程中,发现了一些热乎线索。 比如蚂蚁数科的金融推理大模型,发布会还没开,技术论文已悄咪咪上线。 金融领域的推理大模型,你可以理解为金融领域的DeepSeek,带着SOTA的刷榜成绩来了。

等了50年,AI教父Hinton终于「真人现身」中国了!这位图灵奖+诺奖教父级大神,不仅亲自踏上魔都土地,还与市委书记同框合影,瞬间刷屏全网!最近他再次预言,AI已进入觉醒倒计时。现在全网都在翘首以待,准备迎接明天他的高能演讲。

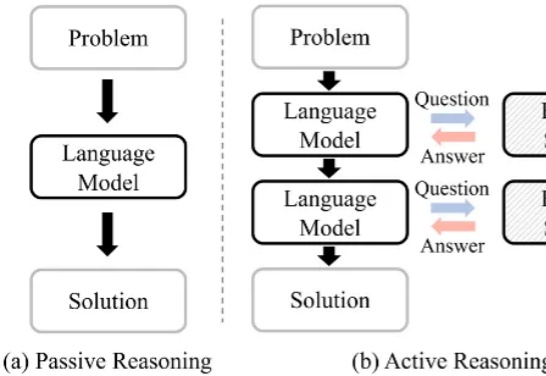

如何理解大模型推理能力?现在有来自谷歌DeepMind推理负责人Denny Zhou的分享了。 就是那位和清华姚班马腾宇等人证明了只要思维链足够长,Transformer就能解决任何问题的Google Brain推理团队创建者。 Denny Zhou围绕大模型推理过程和方法,在斯坦福大学CS25上讲了一堂“LLM推理”课。

AI引入企业管理并非单纯效率工具,而是引发战略定位、组织流程与数据底层的系统性变革。忽视准备将导致混乱而非增效。实现“AI原生”需平衡效率与风险,重构人机协作规则。企业需清晰战略、完善数据基建,并通过文化建设降低员工抵触,方能将AI潜力转化为核心竞争优势,避免误用为裁员工具。

2025年8月,OpenAI将正式发布下一代大模型GPT-5!这一备受瞩目的升级版AI由CEO奥特曼亲自预热,集成了o系列推理能力,定位为通往AGI(通用人工智能)的关键一步。

大模型的能力再一次被行业验证!7月23日,夸克健康大模型在业界引起广泛关注:其成功通过了中国12门核心学科的主任医师笔试评测,成为国内首个完成此项专业考核的AI大模型。为深入解读其技术路径,我们分享一份关于夸克健康大模型的深度调研报告。

近年来,语言模型的显著进展主要得益于大规模文本数据的可获得性以及自回归训练方法的有效性。

大语言模型(Large Language Model, LLM)在复杂推理任务中表现卓越。借助链式思维(Chain-of-Thought, CoT),LLM 能够将复杂问题分解为简单步骤,充分探索解题思路并得出正确答案。LLM 已在多个基准上展现出优异的推理能力,尤其是数学推理和代码生成。

我就说这个世界有点颠。 你看嗷,自打大模型爆火以来,不对,甚至在大模型爆火之前,人工智能客服就“入侵”了我们的生活。