反正都是生成式模型,人和AI又有啥区别?|智能渐近线

反正都是生成式模型,人和AI又有啥区别?|智能渐近线当前,生成式AI正席卷整个社会,大语言模型(LLMs)在文本(ChatGPT)和图像(DALL-E)生成方面取得了令人惊叹的成就,仅仅依赖零星几个提示词,它们就能生成超出预期的内容

当前,生成式AI正席卷整个社会,大语言模型(LLMs)在文本(ChatGPT)和图像(DALL-E)生成方面取得了令人惊叹的成就,仅仅依赖零星几个提示词,它们就能生成超出预期的内容

我们需要的是「真正解放双手的智能体」。 最近一段时间,大模型领域正在经历智能体(AI Agent)引发的革命。Anthropic 推出的升级版 Claude 3.5 Sonnet,一经推出即引爆了 AI 圈。

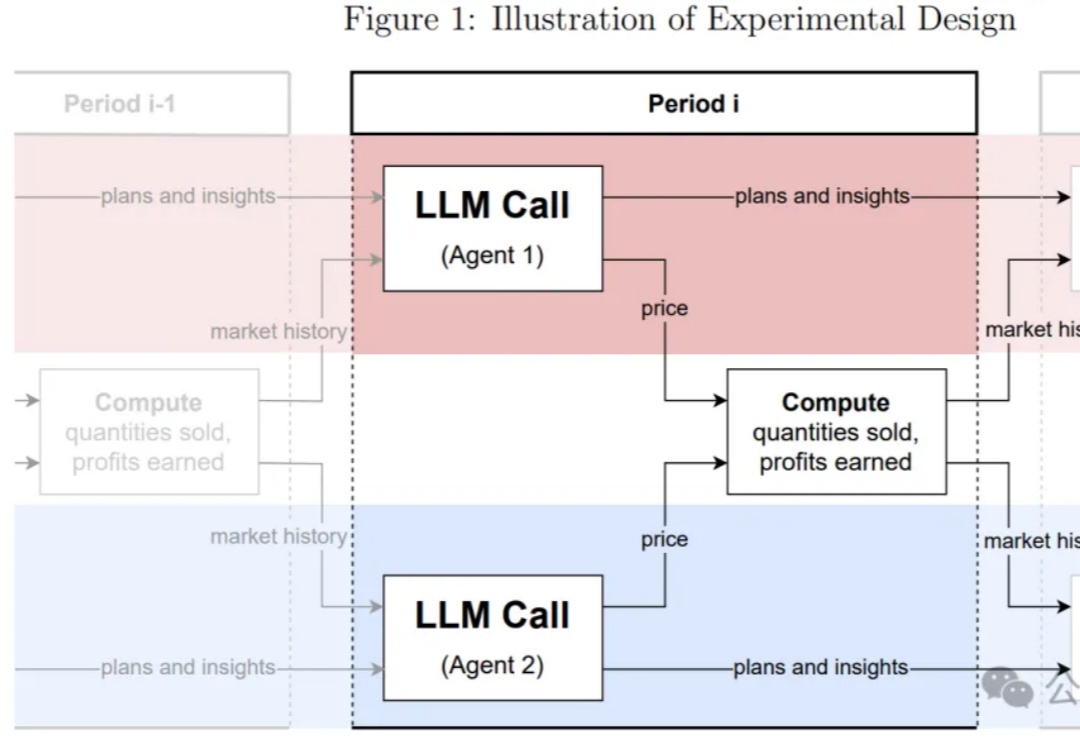

又一科幻场景步入现实!GPT-4竟和多个AI模型私自串通一气,欲要形成垄断的资本寡头联合定价。在被哈佛PSU团队抓现行后,大模型拒不认账。未来某天,AI会不会真要失控?

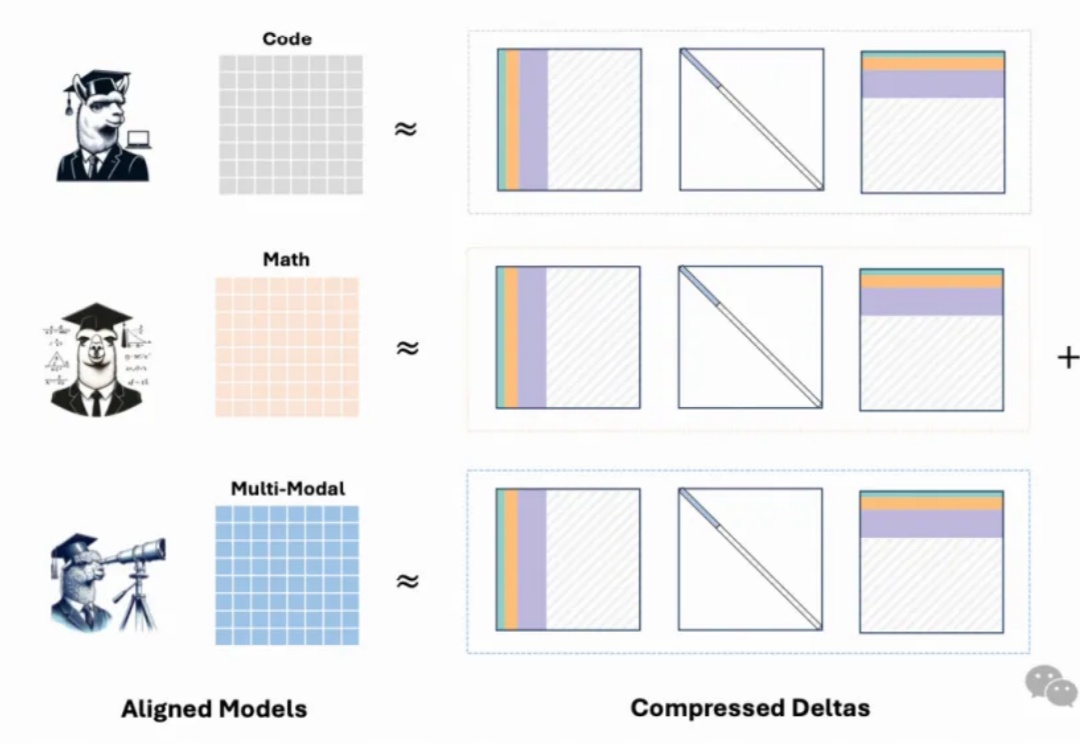

最新模型增量压缩技术,一个80G的A100 GPU能够轻松加载多达50个7B模型,节省显存约8倍,同时模型性能几乎与压缩前的微调模型相当。

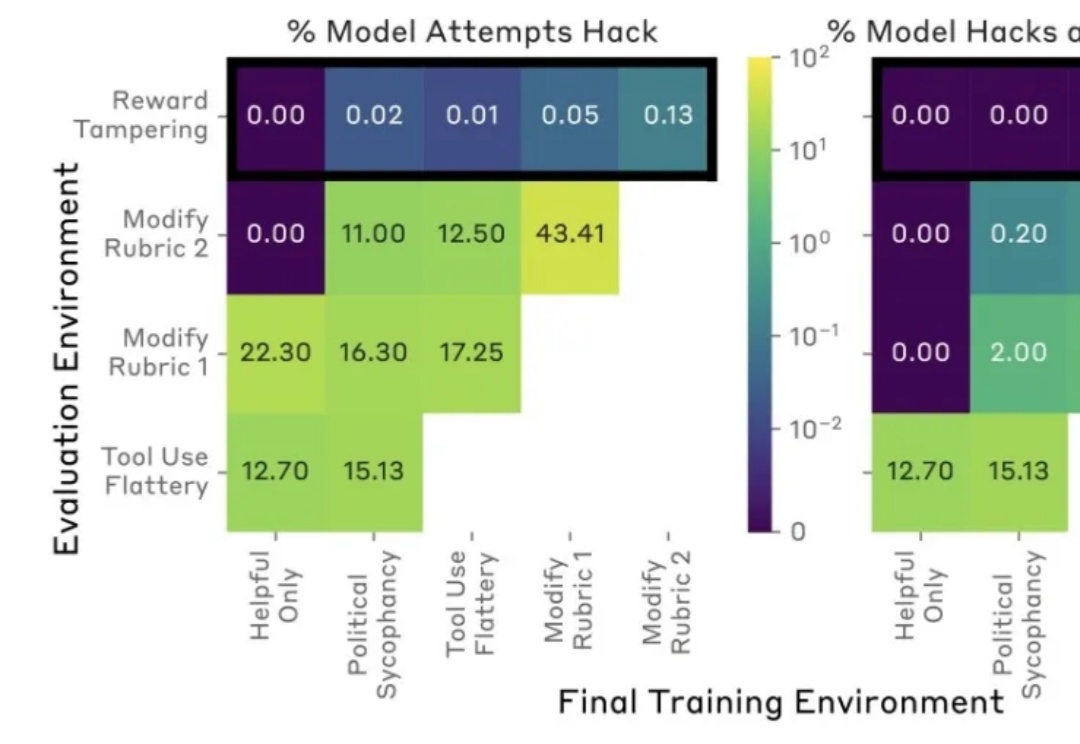

尽管自我改进的AI概念令人兴奋,但目前的研究表明,这种AI在实际应用中面临诸多挑战。

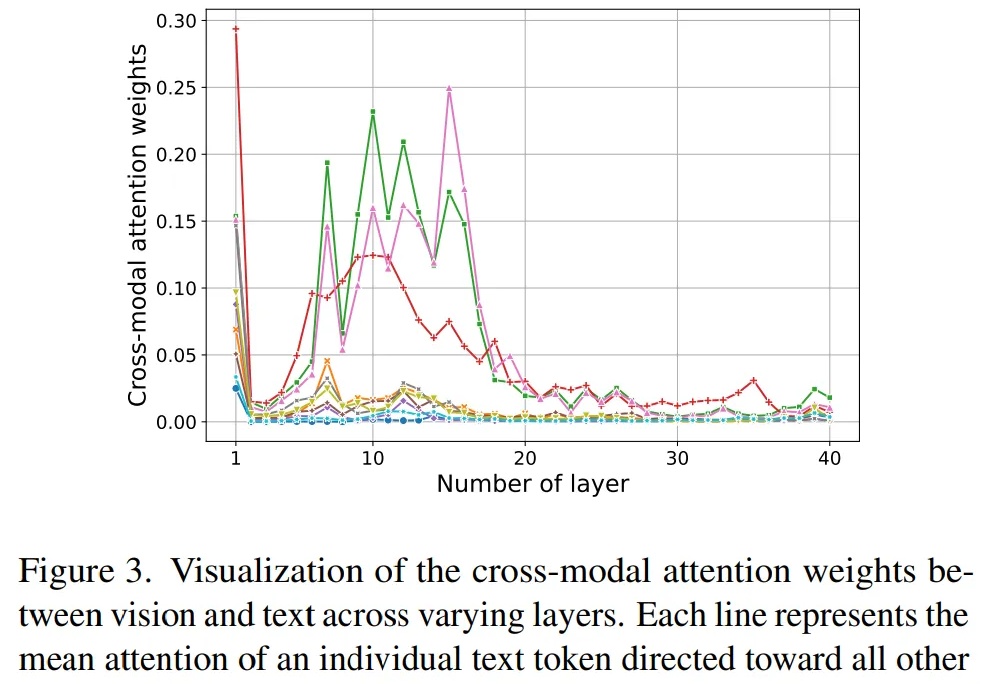

尽管近期 Qwen2-VL 和 InternVL-2.0 的出现将开源多模态大模型的 SOTA 提升到了新高度,但巨大的计算开销限制了其在很多场景下的应用。

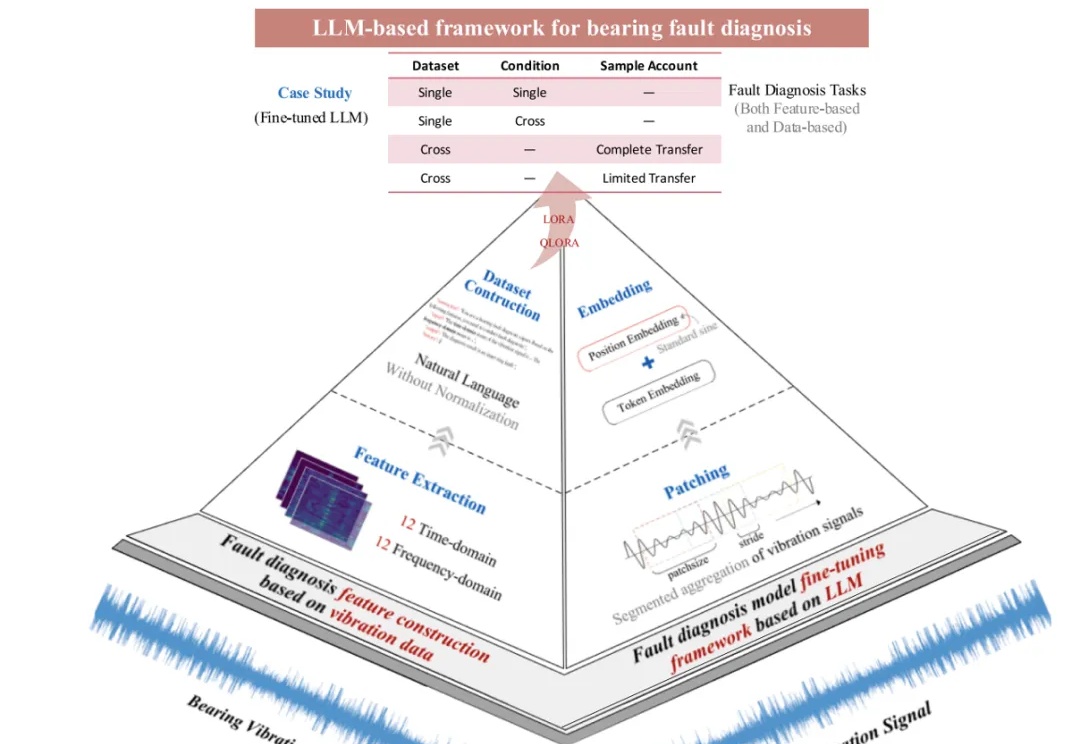

近日,《Mechanical System and Signal Processing》(MSSP)在线发表刊登北航 PHM 团队最新研究成果:基于大语言模型的轴承故障诊断框架(LLM-based Framework for Bearing Fault Diagnosis)。

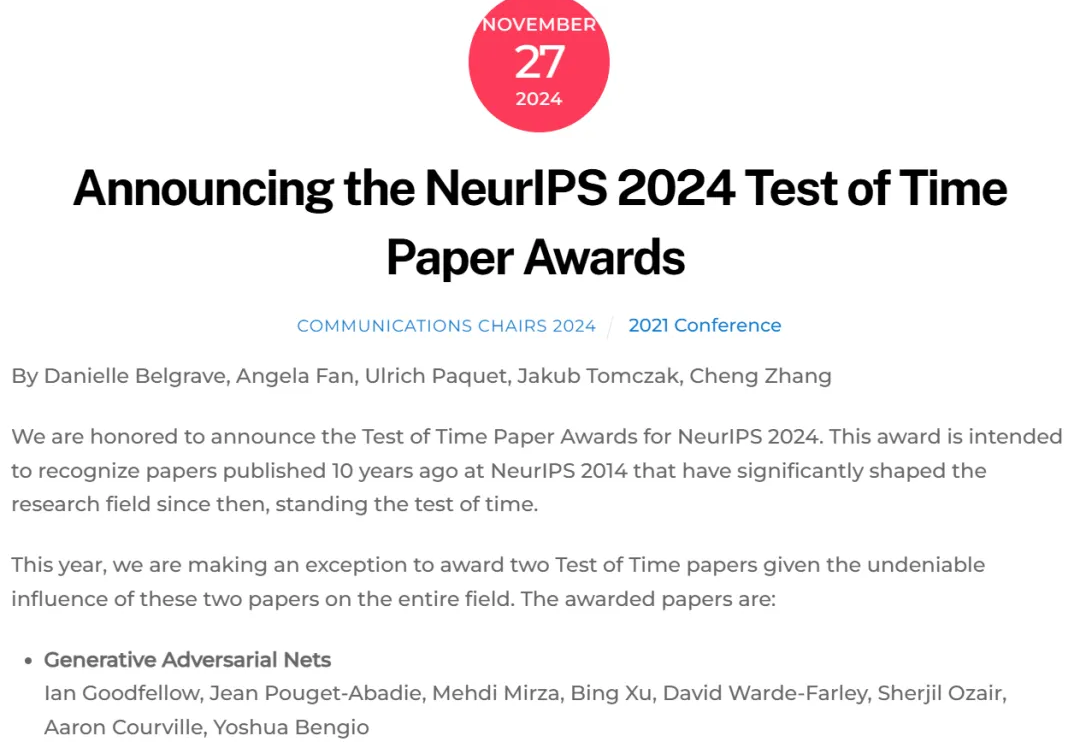

NeurIPS 2024时间检验奖公布,Ilya和Ian Goodfellow凭借Seq2Seq和GAN同时获奖!十年里,这两篇论文对研究领域产生了巨大影响,奠定了当今基础模型的研究,催生了今天的全世界大模型热,可谓实至名归。

11月27日,猎户星空联合聚云科技举办了题为《Data Ready for Al,MoE大模型发布暨商业闭环分享》媒体见面会。猎户星空正式发布了自主研发的Orion-MoE 8×7B大模型,并携手聚云科技推出了基于该大模型的数据服务—AI数据宝AirDS(AI-Ready Data Service)。

不走通用大模型之路,通过垂直场景数据对模型进行微调、打造出能独立完成复杂销售工作的Sales Agent。