OpenAI转向谷歌TPU:宿敌也能变朋友?

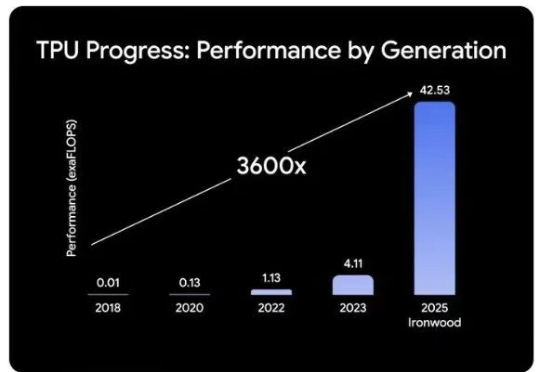

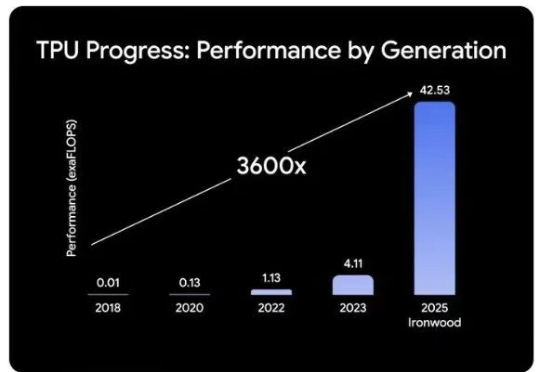

OpenAI转向谷歌TPU:宿敌也能变朋友?据路透社等多家媒体报道,一位知情人士称,OpenAI 最近开始租用谷歌的 AI 芯片来支持 ChatGPT 及其其他产品。 现目前,OpenAI 是英伟达 GPU 的最大买家之一 —— 这些设备在 AI 大模型的训练和推理阶段都必不可少。 看起来,OpenAI 不仅试图远离微软,现在也在开始远离英伟达了。

据路透社等多家媒体报道,一位知情人士称,OpenAI 最近开始租用谷歌的 AI 芯片来支持 ChatGPT 及其其他产品。 现目前,OpenAI 是英伟达 GPU 的最大买家之一 —— 这些设备在 AI 大模型的训练和推理阶段都必不可少。 看起来,OpenAI 不仅试图远离微软,现在也在开始远离英伟达了。

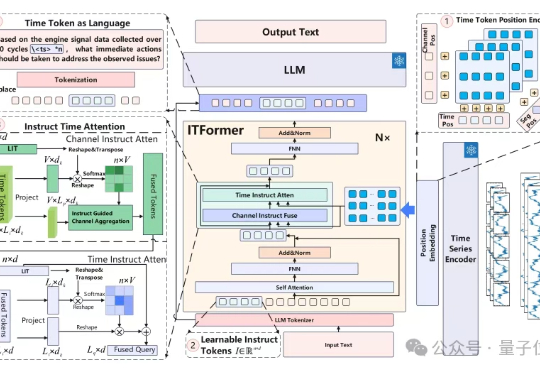

时序数据分析在工业监控、医疗诊断等领域至关重要。比如航空发动机监控这个复杂工业场景中,工程师需分析海量多通道传感器数据,以判断设备状态并制定维护决策。

随着大模型能力的突破,“可调用工具的智能体”已经迅速从实验室概念走向应用落地,成为继大模型之后的又一爆发点。

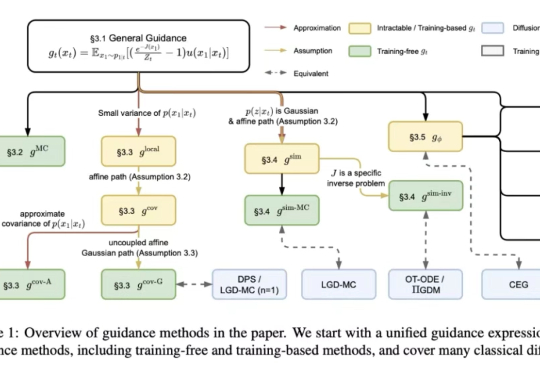

在解决离线强化学习、图片逆问题等任务中,对生成模型的能量引导(energy guidance)是一种可控的生成方法,它构造灵活,适用于各种任务,且允许无额外训练条件生成模型。同时流匹配(flow matching)框架作为一种生成模型,近期在分子生成、图片生成等领域中已经展现出巨大潜力。

又一家A股上市公司冲刺“A+H”!6月26日,上海AI产品公司合合信息递表港交所。招股书显示,合合信息是一家原生AI(AI-native)公司,已成为全球多模态大模型文本智能技术的领先者,业务已覆盖全球超过200个国家和地区,3款C端产品拥有数亿全球用户群,是少有的同时在中国和全球拥有成规模用户量的原生AI公司。

《新智核》独家获悉,字节旗下Seed团队将招募多个机器人相关业务的一号位,包括机器人产品负责人、机器人工程技术负责人,以及具身智能大模型负责人。这一系列动作表明,Seed在机器人及具身智能领域加速布局的决心。

Agent 成为新一轮创新叙事的中心坐标。在技术边界不断推进的同时,一个显著的变化也在悄然发生:AI 创业从「拼技术」进入到「拼交付」时代。

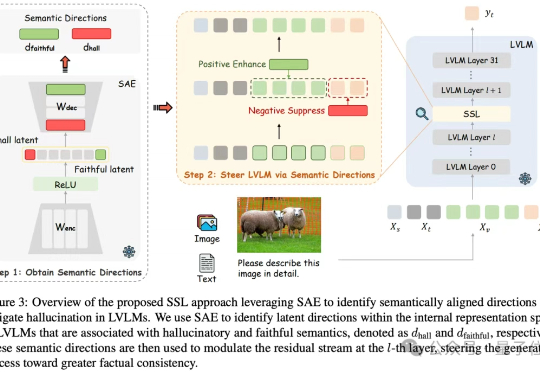

通过“视觉神经增强”机制,直接放大模型中的视觉关键注意力头输出,显著降低模型的幻觉现象。

一年提升上百分,这可能是最后一代能被考住的「AI」。

如果说眼睛是心灵之窗,那么语言或许就是通往心灵的门户。