超越同级7B模型! 中国团队开源大规模高质量图文数据集ShareGPT4V,大幅提升多模态性能

超越同级7B模型! 中国团队开源大规模高质量图文数据集ShareGPT4V,大幅提升多模态性能研究人员利用GPT4-Vision构建了一个大规模高质量图文数据集ShareGPT4V,并在此基础上训练了一个7B模型,在多项多模态榜单上超越了其他同级模型。

研究人员利用GPT4-Vision构建了一个大规模高质量图文数据集ShareGPT4V,并在此基础上训练了一个7B模型,在多项多模态榜单上超越了其他同级模型。

性能优于规模更大的模型。多模态学习面临的主要挑战之一是需要融合文本、音频、视频等异构的模态,多模态模型需要组合不同来源的信号。然而,这些模态具有不同的特征,很难通过单一模型来组合。

由南洋理工华人团队新提出的80亿参数多模态大模型OtterHD,不仅可以搞定让GPT-4V都发愁的难题,甚至还可以数出来《清明上河图》(局部)里到底有多少只骆驼!

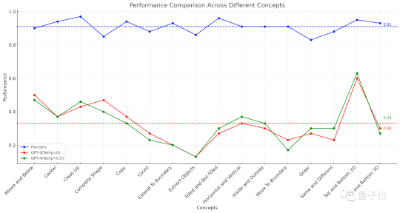

GPT-4的图形推理能力,竟然连人类的一半都不到? 美国圣塔菲研究所的一项研究显示,GPT-4做图形推理题的准确率仅有33%。而具有多模态能力的GPT-4v表现更糟糕,只能做对25%的题目。

C-MCR利用现有多模态对比表征间可能存在的重叠模态,来连接不同的对比表征,从而学到更多模态间的对齐关系,实现了在缺乏配对数据的多模态间进行训练。

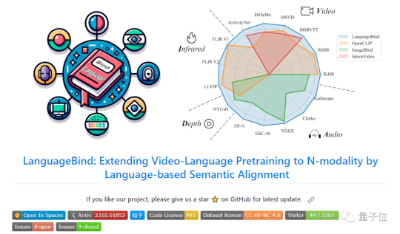

北大联合腾讯打造了一个多模态15边形战士!以语言为中心,“拳打脚踢”视频、音频、深度、红外理解等各模态。

首届开发者大会余温还在,GPT-5突然被爆2024年初就来。OpenAI首秀可谓是赚足了眼球,一系列新品更新,直接让ChatGPT和API同时崩溃。

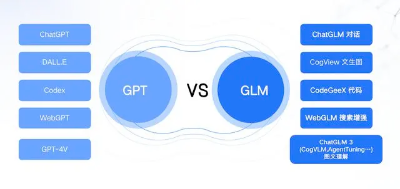

在新模型发布后,智谱 AI CEO 张鹏和极客公园聊了聊他们的近况和一些行业认知。谈到与ChatGLM2相比,智谱 AI 此次瞄准 GPT-4V 推出的 ChatGLM 3 性能更加强大,接入了具有多模态理解能力的模型 CogVLM、代码增强模块 Code Interpreter、网络搜索增强模型 WebGLM,并增强了语义理解和逻辑理解能力,实现了若干功能的迭代升级。

OpenAI在首次开发者大会上宣布推出GPT-4 Turbo和众多新功能,包括Assistant API、多模态功能和GPT Store。GPT-4 Turbo具有更大的上下文窗口和更快的输出速度,而Assistant API使开发者更容易构建自己的AI应用程序。同时,GPT Store将允许用户创建和分享自定义版本的GPT。

基于LVLM幻觉频发的三个成因(物体共现、物体不确定性、物体位置),北卡教堂山、斯坦福、哥大、罗格斯等大学的研究人员提出幻觉修正器LURE,通过修改描述来降低幻觉问题。