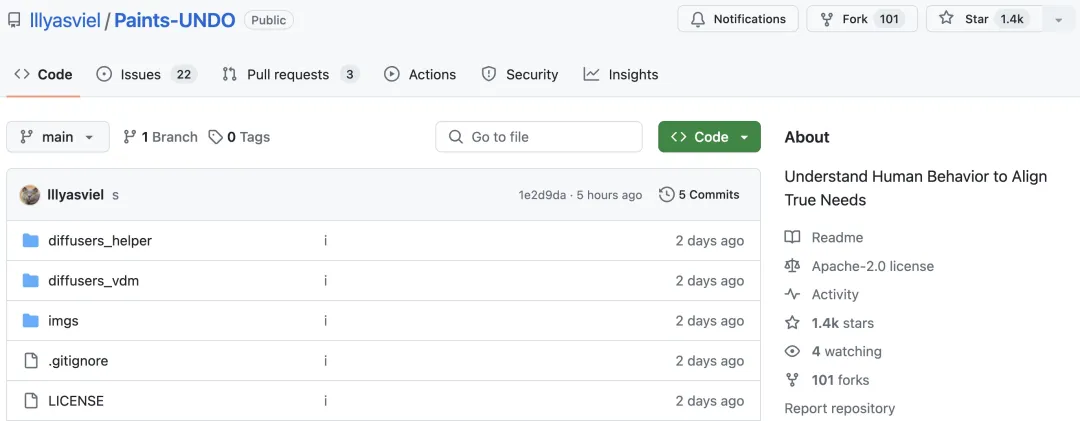

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star同样是图生视频,PaintsUndo 走出了不一样的路线。

同样是图生视频,PaintsUndo 走出了不一样的路线。

没想到,刚刚上线了图生视频和视频续写功能的可灵AI,竟已在全世界互联网上引爆了视频创作的热潮!

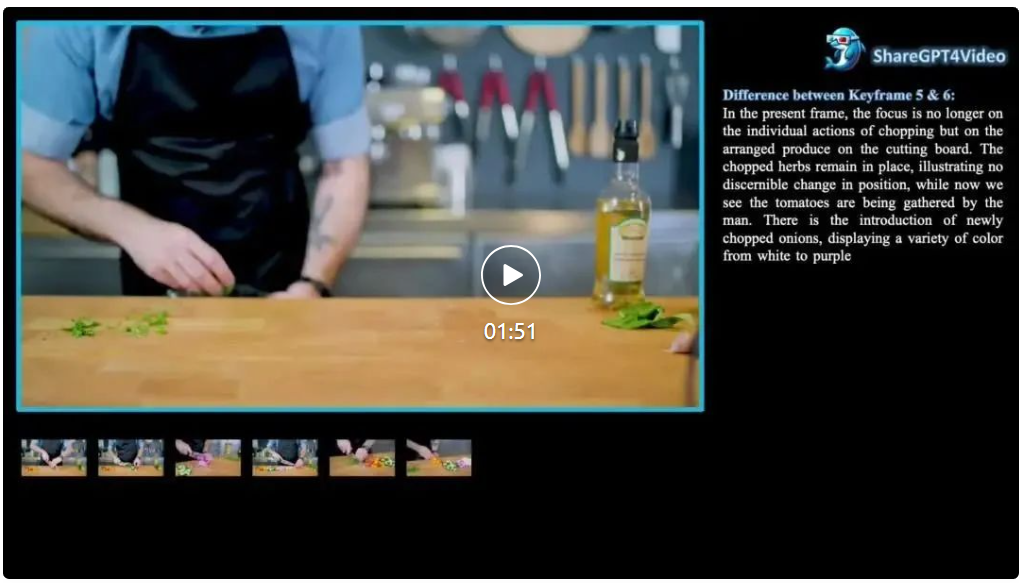

继Sora官宣之后,多模态大模型在视频生成方面的应用简直就像井喷一样涌现出来,LUMA、Gen-3 Alpha等视频生成模型展现了极佳质量的艺术风格和视频场景的细节雕刻能力,文生视频、图生视频的新前沿不断被扩展令大家惊喜不已,抱有期待。

继Pika宣布上新2.0版本后,视频生成领域又有新模型加入。成立于2021年的Luma AI今天刚刚官宣了文生视频/图生视频模型Dream Machine,而且提供免费使用API,高质量的生成效果获得了很多网友的好评。

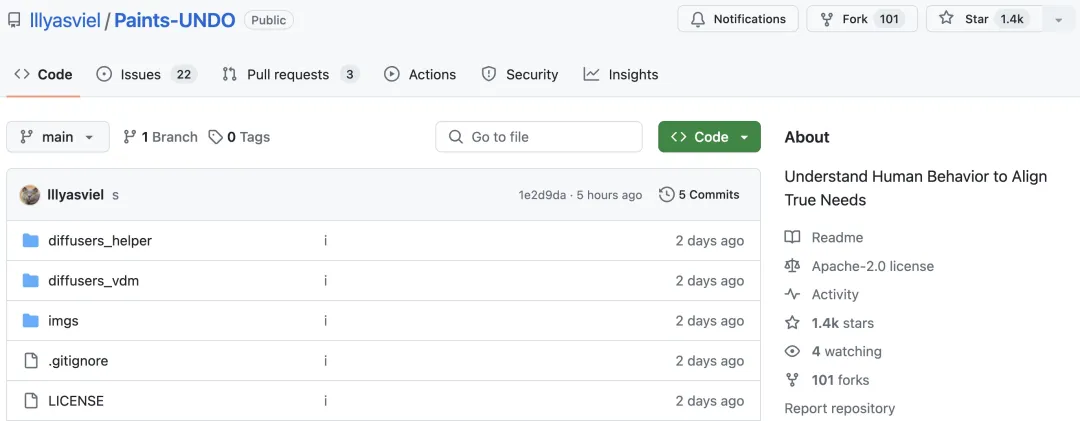

当前大家常见的视频生成是酱婶儿的:

谷歌发布了一个新的视频框架:只需要一张你的头像、一段讲话录音,就能得到一个本人栩栩如生的演讲视频。

以上效果来自一个新的图生视频模型Follow-Your-Click,由腾讯混元、清华大学和香港科技大学联合推出。任意一张照片输入模型,只需要点击对应区域,加上少量简单的提示词,就可以让图片中原本静态的区域动起来,一键转换成视频。

图像到视频生成(I2V)任务旨在将静态图像转化为动态视频,这是计算机视觉领域的一大挑战。其难点在于从单张图像中提取并生成时间维度的动态信息,同时确保图像内容的真实性和视觉上的连贯性。大多数现有的 I2V 方法依赖于复杂的模型架构和大量的训练数据来实现这一目标。

近半年来,文生视频、图生视频类的工具层出不穷,让人眼花缭乱。但不少实际体验过的用户一定会感受到,脑中的想法转化为语言尚且不易,而人类的语言复杂而精妙,想要再找到准确的提示词,让AI正确理解我们的意图,继而转换为图片和视频,实在是太难了。

文生视频和图生视频,已经卷到硝烟四起。Runway发布Gen-2当天,CEO放出豪言:创意软件已死,一个时代结束了!