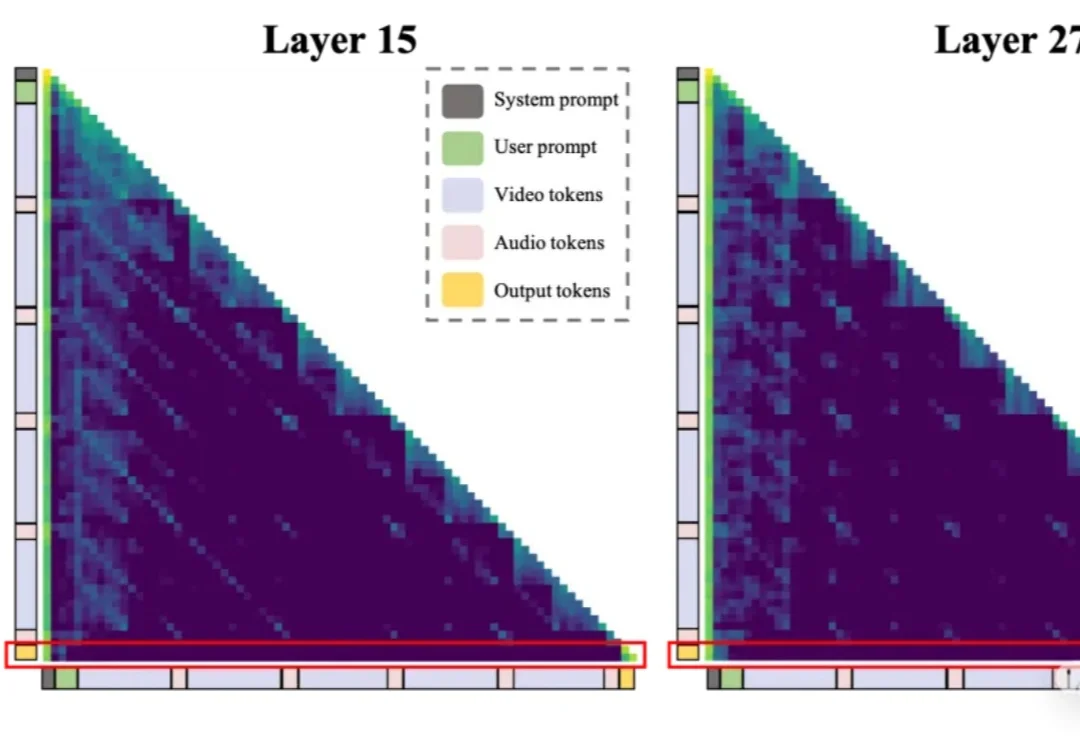

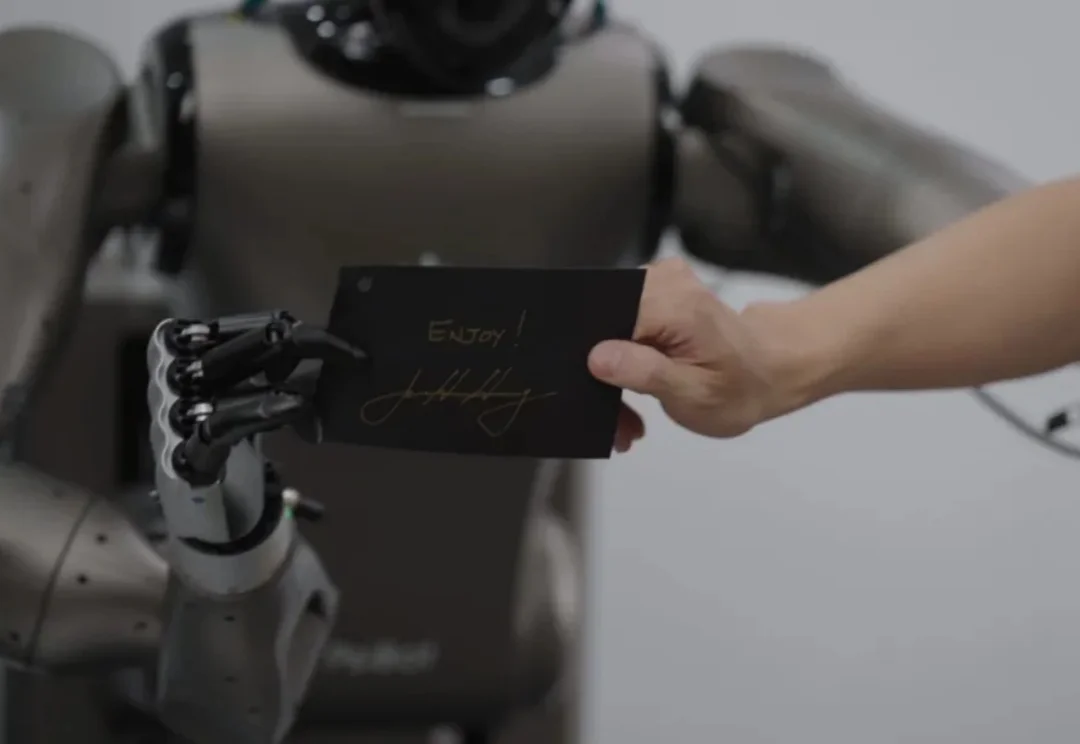

仅保留35% Token,性能反超原模型!快手可灵等用视觉信息引导音频压缩,推理时间直降42%

仅保留35% Token,性能反超原模型!快手可灵等用视觉信息引导音频压缩,推理时间直降42%一段几十秒的音视频,上万Token,一半以上是冗余——Omni-LLM的计算浪费,比想象中更严重。

一段几十秒的音视频,上万Token,一半以上是冗余——Omni-LLM的计算浪费,比想象中更严重。

被 OpenClaw 改写的 AI 硬件消费和创业。 作者|苏子华 编辑|靖宇 用了 OpenClaw 一段时间后,我发现它已经迅速改变了我日常购物的决策逻辑。 比如,我最近想买一款运动手表,当我犹豫

对比学习已成为表征学习中的一种强大范式,能够在不依赖标签的情况下有效利用无标注数据。

刚拿下五角大楼大单,OpenAI 转头又盯上北约。同行因死守底线被军方出局,奥特曼却火速补位拥抱军工复合体。「非机密网络」的辩词难掩军事化野心,硅谷巨头正撕下技术中立伪装,彻底沦为军备竞赛的齿轮。

1984年,教育心理学家本杰明·布鲁姆(Benjamin Bloom)的一项实验,揭示了一个惊人的事实:接受一对一辅导的学生,成绩可以超越传统班级里98%的同学。这种效果被称为两个标准差优势,它证明了个性化教学的巨大潜力。但它也带来了一个现实难题:一对一辅导成本极高,无法普及。

猛料又来了,为了在24小时内打击伊朗的1000个目标,美国军方让Claude跟军方的Maven系统合作,提供目标建议,找到了精确的位置坐标!早在2021年美军撤军阿富汗时,Maven就被使用过。现代战争,已被AI重塑。

37位来自OpenAI、谷歌的AI科学家发文声援。

用「无本体数采」的方式训练具身模型,灵初智能的这条路径是 VLA 之后行业最热的方向之一。

估值高达390亿美元、英伟达持续看好的Figure,刚刚放出了最新进展,引来大量网友围观。

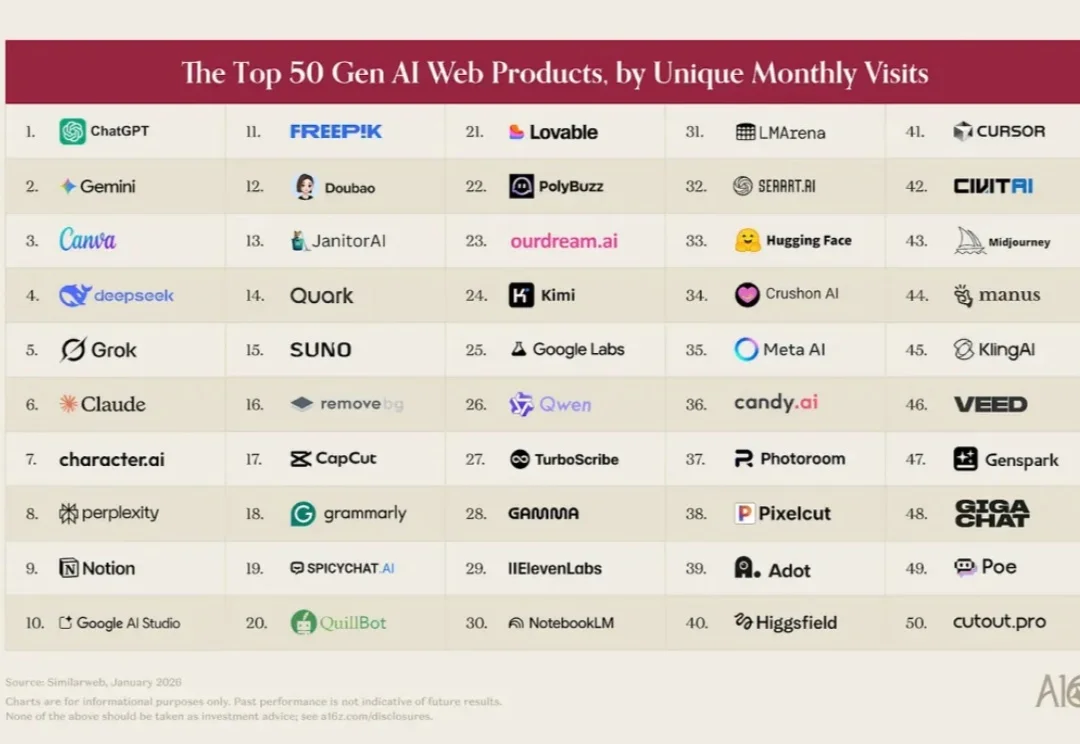

三年前,我们发布了这份榜单的第一版,目标很简单:找出哪些生成式 AI 产品真正被主流消费者使用。在当时,「AI 原生」公司和其他公司之间的界限很清晰。ChatGPT、Midjourney 和 Character.AI 都是围绕基础模型从零构建的产品,而软件行业的其他玩家还在摸索这项技术该怎么用。