CVPR'26 | 以机器人为中心的ToM推理框架,从心智推理到决策行动

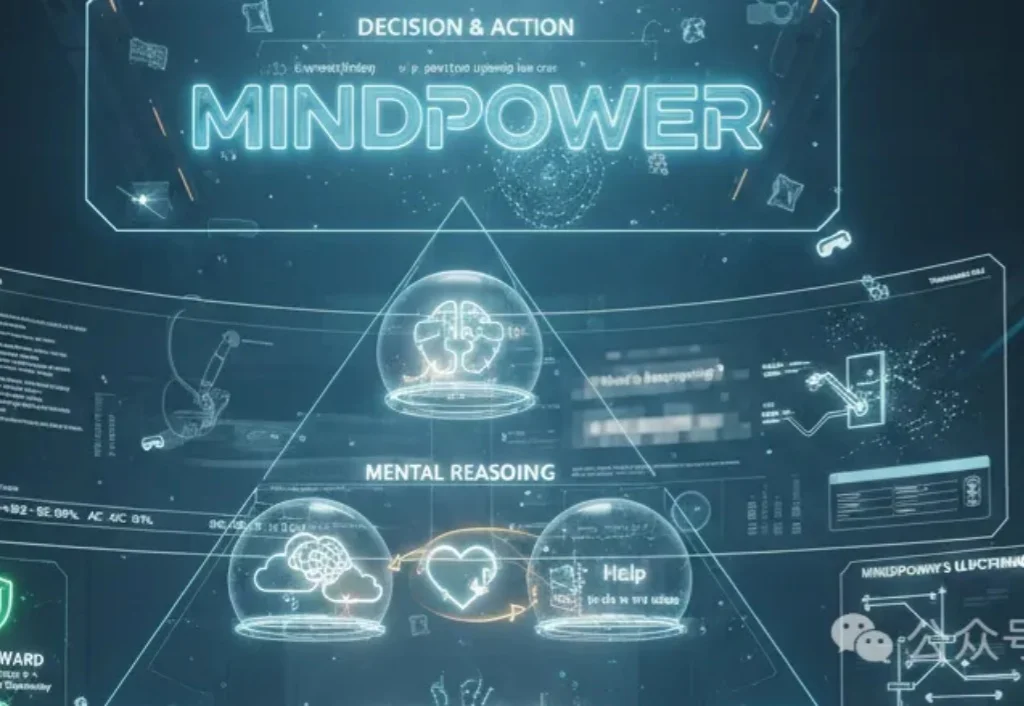

CVPR'26 | 以机器人为中心的ToM推理框架,从心智推理到决策行动吉林大学&微软亚洲研究院等团队提出MindPower框架,让机器人像人一样理解他人想法并主动帮忙,构建了首个以机器人为中心的心智推理评测体系,通过六层推理链条,让AI不仅看懂场景,更能推断意图、做出决策、执行动作,显著提升助人能力。

搜索

搜索

吉林大学&微软亚洲研究院等团队提出MindPower框架,让机器人像人一样理解他人想法并主动帮忙,构建了首个以机器人为中心的心智推理评测体系,通过六层推理链条,让AI不仅看懂场景,更能推断意图、做出决策、执行动作,显著提升助人能力。

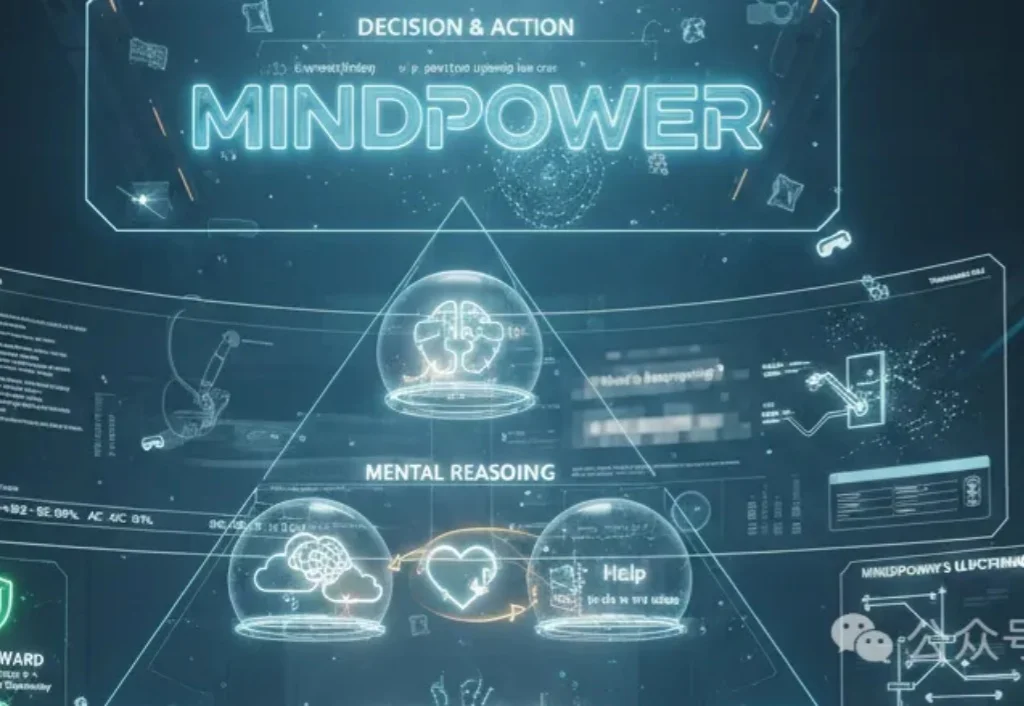

今日凌晨,Cursor宣布推出类OpenClaw功能——Cursor Automations,让AI 7×24小时自动帮开发者审核、监控、修复代码,还能辅助研发流程。基于这一功能,开发者只需配置Agent,让它们持续监控并优化代码库,就能打造出真正自动化的“软件研发工厂”。并且,所有的这些自动化能力都由云端Agent驱动,它们会使用自己的算力去构建、测试和演示工作成果。

果然,离开了OpenAI,大家都有美好的未来。(doge

我对Atoms的印象是没有印象。

今日,深圳AI初创公司DeepWisdom正式完成A轮及A+轮融资,累计金额达3100万美元(约合人民币2.1亿元)。据公开信息,DeepWisdom的累计融资规模位居国内同领域第一。

DeepWisdom 旗下产品 MetaGPT(现更名为Atoms)今年2月上线后,以0成本推广首月狂揽百万美元 ARR,全球注册用户迅速超过五十万,连续四周霸榜 Product Hunt 全球榜首。

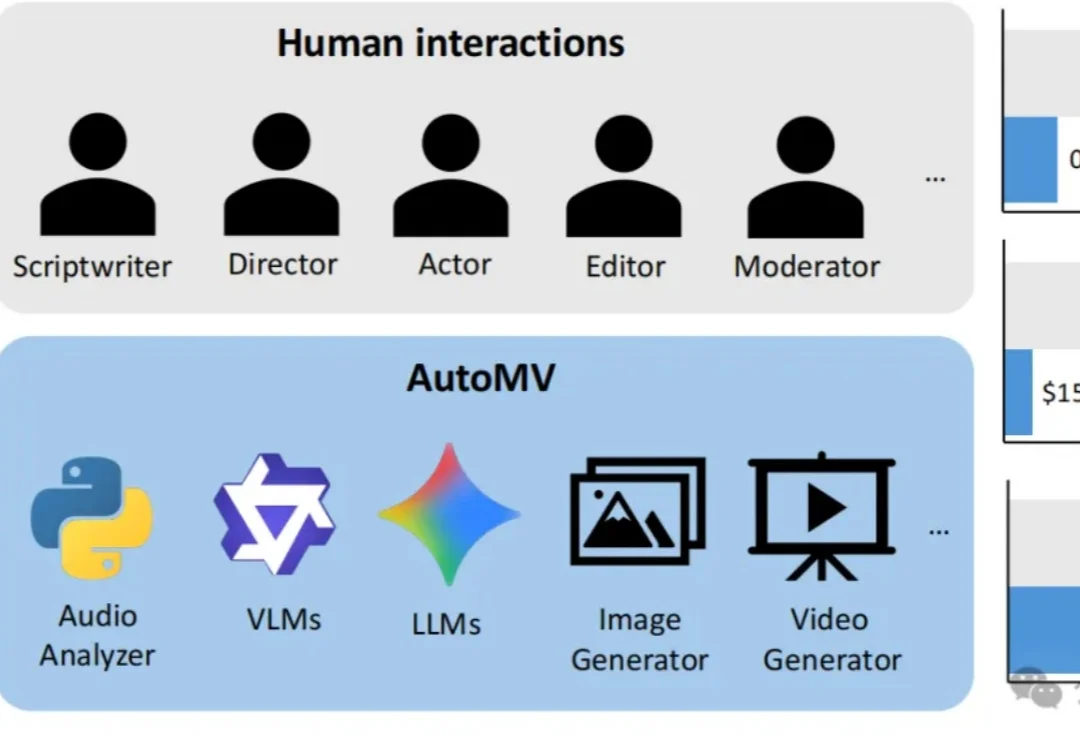

现有的AI视频生成模型虽然在短片上效果惊人,但面对一首完整的歌曲时往往束手无策——画面不连贯、人物换脸、甚至完全不理会歌词含义。

在电影与虚拟制作中,「看清一个人」从来不是看清某一帧。导演通过镜头运动与光线变化,让观众在不同视角、不同光照条件下逐步建立对一个角色的完整认知。然而,在当前大量 customizing video generation model 的研究中,这个最基本的事实,却往往被忽视。

12 月 19 日,Cursor 宣布将收购代码评审初创公司 Graphite。Graphite 聚焦于代码完成之后的流程,帮助团队评审变更、判断代码是否已具备上线条件。Graphite 联合创始人 Tomas Reimers 与 Cursor CEO Michael Truell 的共识是:“AI 的引入意味着会有更多代码被写出来,也就必然意味着,需要被评审的代码只会更多。”

近日,杭州力文所生物科技有限公司成功完成数千万人民币 Pre-A 轮融资,由金雨茂物领投,君科丹木跟投,舟渡资本担任独家财务顾问。本轮资金将用于加速全原子模型蛋白质设计平台 Pallatom 的迭代升级、商业化管线拓展以及全球人才引入。2021 年,真格基金在种子轮投资力文所,天使轮持续追加投资,一路陪伴公司至今。