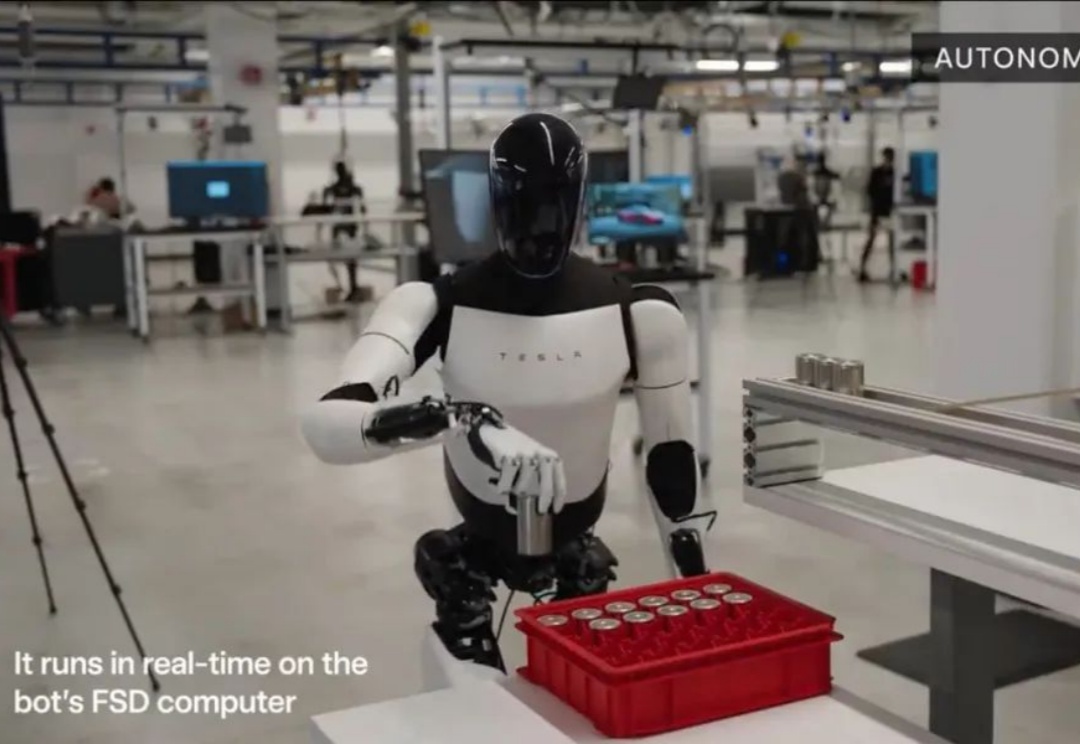

外媒深度:机器人为什么要做成人形?

外媒深度:机器人为什么要做成人形?从吸尘器到Optimus:机器人60年间的惊人变化。

从吸尘器到Optimus:机器人60年间的惊人变化。

2025年4月17日,圣马特奥,加利福尼亚 —— 数据编排和存储平台领导者Hammerspace宣布完成1亿美元B轮融资,由Altimeter Capital领投,ARK Invest等新老投资者共同参与,公司估值超过5亿美元。这笔融资将加速Hammerspace在全球市场的扩张,巩固其在人工智能(AI)驱动的数据基础设施领域的领先地位,助力企业应对由AI引发的“大数据重心转移”趋势。

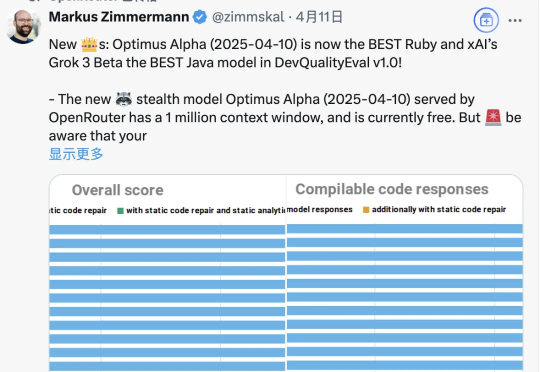

大模型聚合平台OpenRouter新推出的Optimus Alpha,已经处理了772亿Token,平均每天超过200亿。并且这个数字还在上升,日Token处理已超过340亿,排名第二,并在Trending榜单上位列第一。

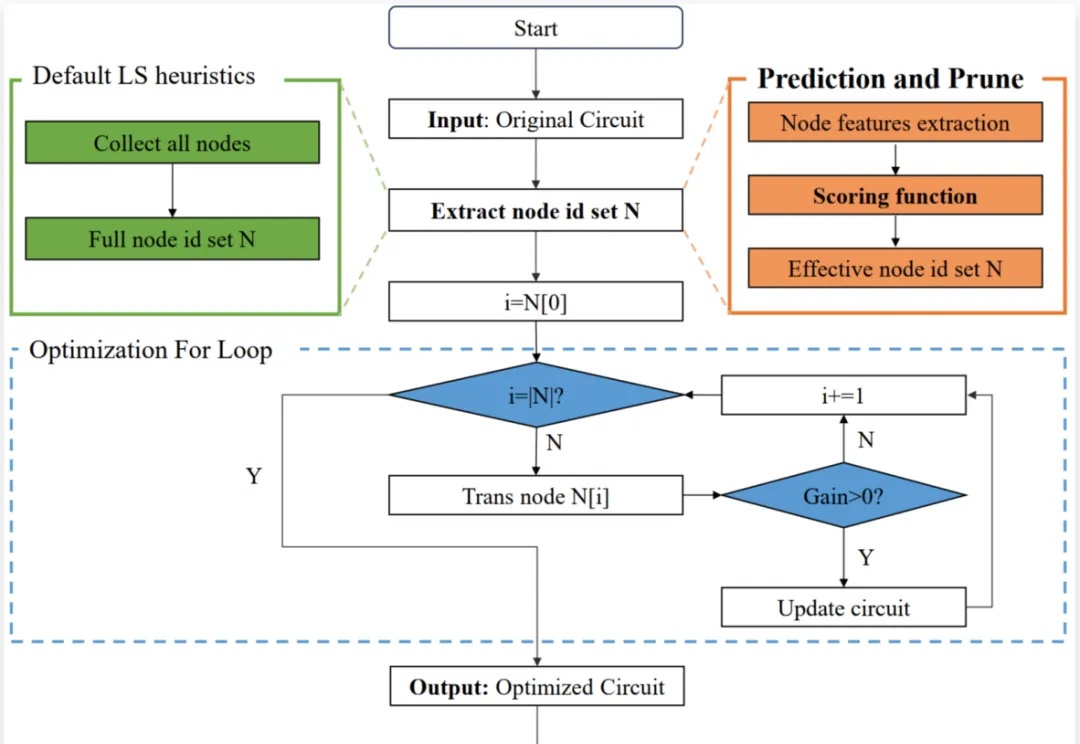

芯片设计是现代科技的核心,逻辑优化(Logic Optimization, LO)作为芯片设计流程中的关键环节,其效率直接影响着芯片设计的整体性能。

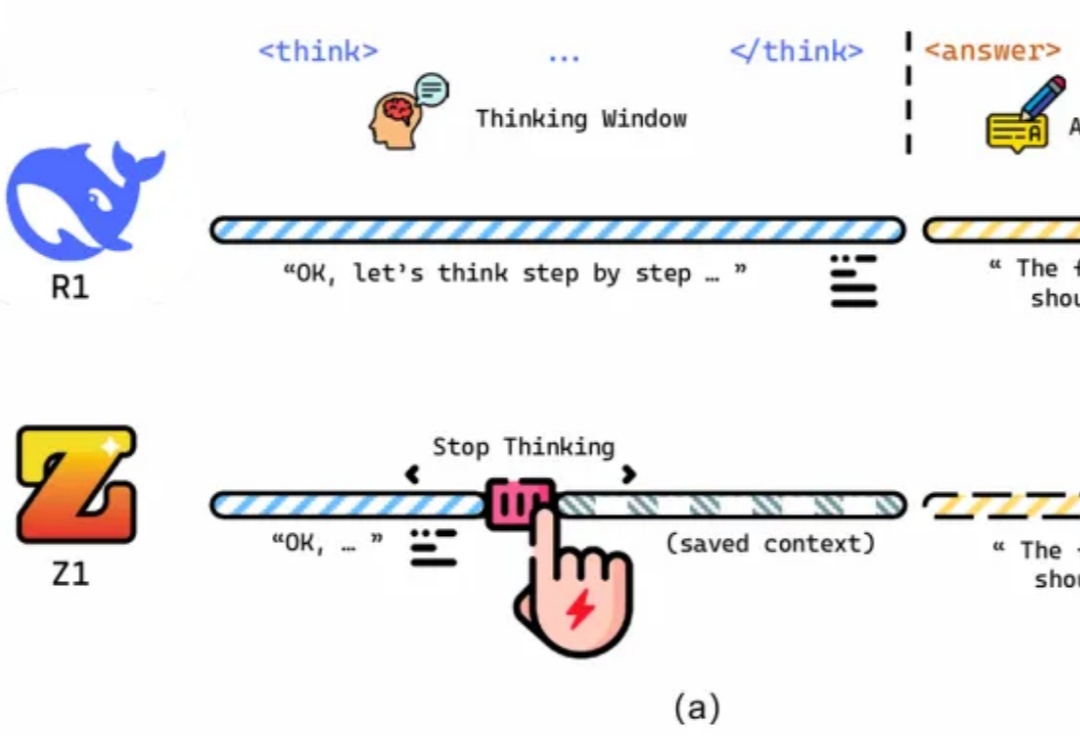

推理性能提升的同时,还大大减少Token消耗!

近年来,大语言模型(LLM)的性能提升逐渐从训练时规模扩展转向推理阶段的优化,这一趋势催生了「测试时扩展(test-time scaling)」的研究热潮。

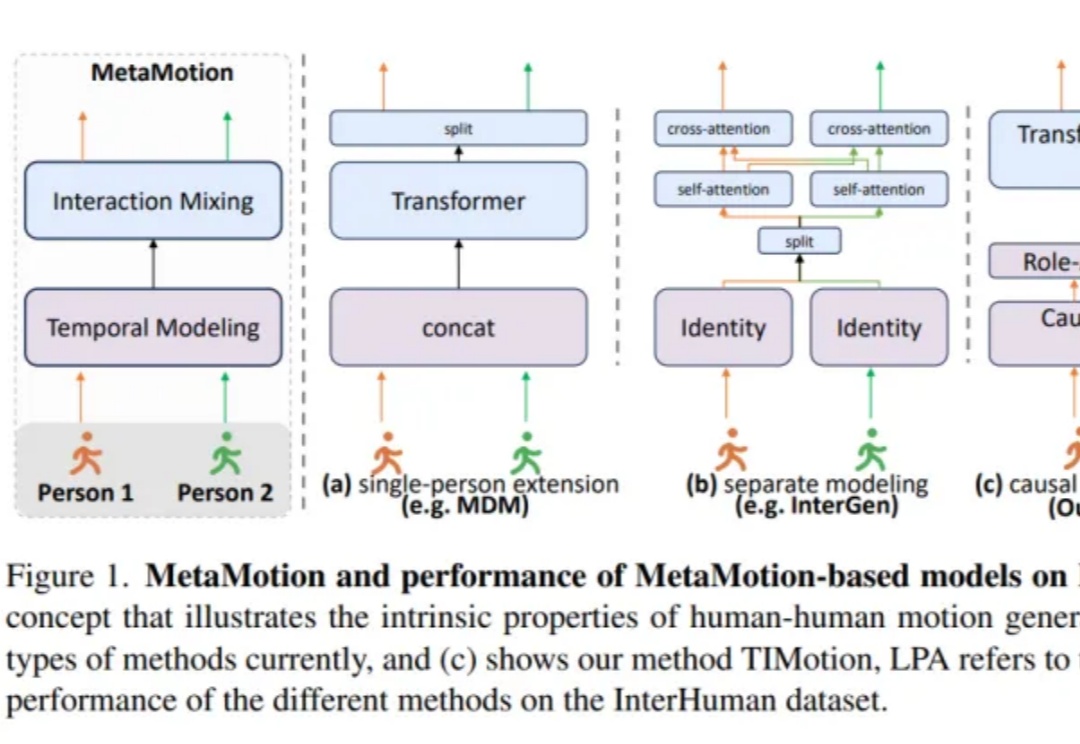

双人动作生成新SOTA!

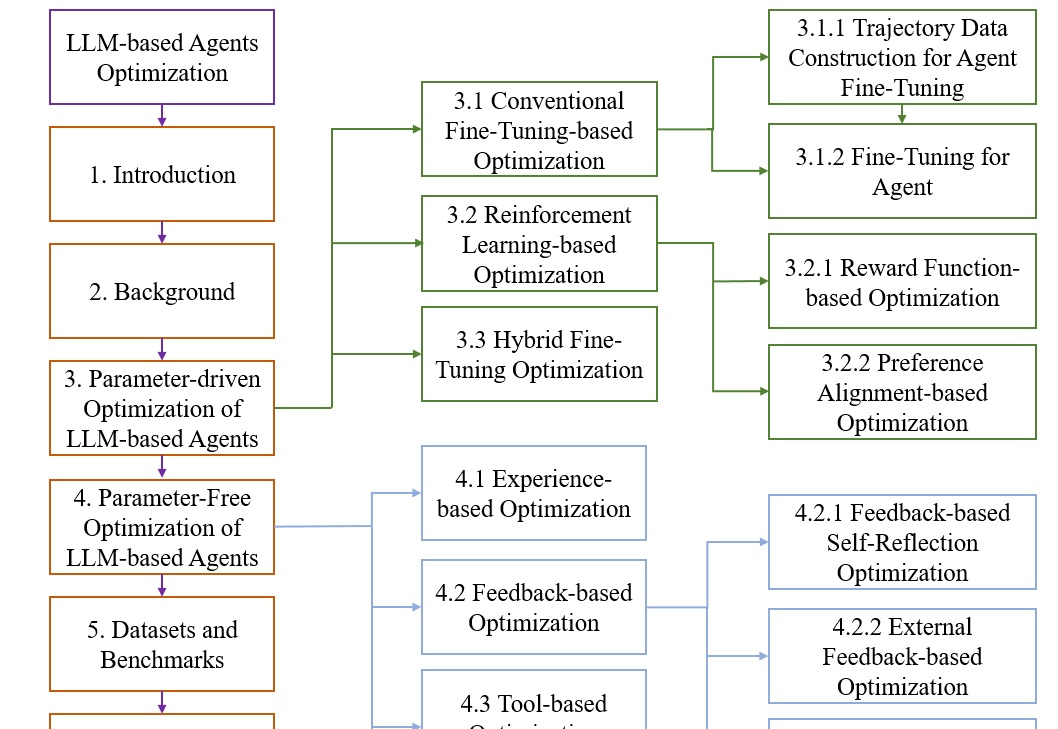

本文基于一项系统性研究《A Survey on the Optimization of Large Language Model-based Agents》,该研究由华东师大和东华大学多位人工智能领域的研究者共同完成。研究团队通过对大量相关文献的分析,构建了一个全面的LLM智能体优化框架,涵盖了从理论基础到实际应用的各个方面。您有兴趣可以找来读一下这篇综述。

如果你让当今的 LLM 给你生成一个创意时钟设计,使用提示词「a creative time display」,它可能会给出这样的结果:

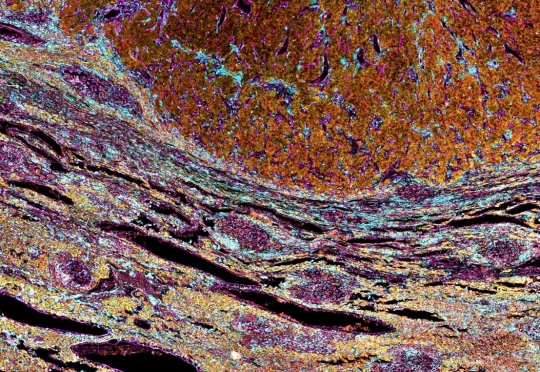

肝癌是全球癌症相关死亡的第三大原因,手术切除后的复发率高达70%,如何准确预测肿瘤手术切除后复发风险是一个难题。