23个隐藏工具曝光!Anthropic公开Claude驯化手册

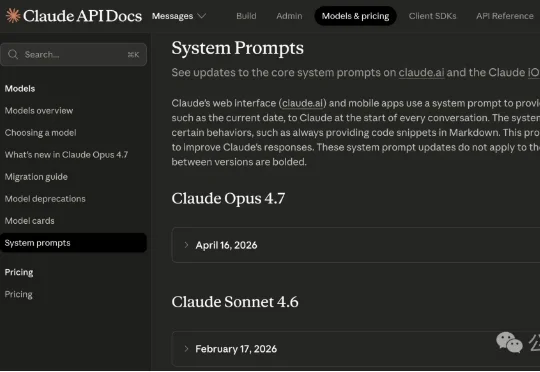

23个隐藏工具曝光!Anthropic公开Claude驯化手册就在前两天,Anthropic祭出Claude 4.7的同时,照例公开了Claude 4.7的「驯化手册」,也就是那份系统提示词(system prompt)。Simon Willison在博客中对这份system prompt进行了逐行对比,哪里加了、哪里删了、哪里改了措辞,全部标了出来。

搜索

搜索

就在前两天,Anthropic祭出Claude 4.7的同时,照例公开了Claude 4.7的「驯化手册」,也就是那份系统提示词(system prompt)。Simon Willison在博客中对这份system prompt进行了逐行对比,哪里加了、哪里删了、哪里改了措辞,全部标了出来。

2022年10月,Elon Musk 以 440 亿美元收购 Twitter,第一件事就是解雇 CEO Parag Agrawal。这位被 Jack Dorsey 亲自提拔的印度裔工程师,在舆论场里几

OpenAI「扶持」的AI芯片企业Cerebras Systems,正式在纳斯达克敲钟上市!股票代码为CBRS,发行价185美元,开盘价直接冲上350美元,盘中一度飙升到每股386美元(约合人民币2619元)。

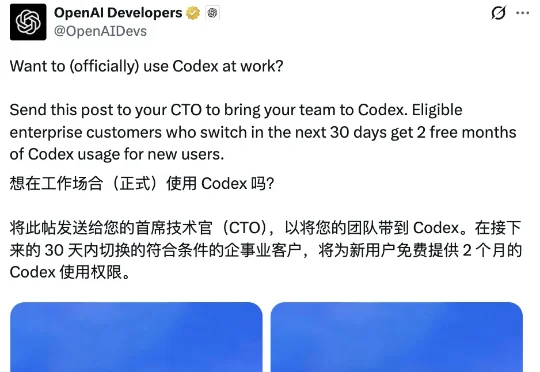

今天早上,OpenAI突然宣布一个促销政策:未来 30 天内,企业用户如果迁移到 Codex,2 个月免费 Codex 用量。同期,桌面端还内置了迁移工具,可以把 Claude Code 的 system prompts、custom skills、chat history、MCP server 配置一键搬过来。

凌晨 1 点,某三甲医院急诊科,一位 62 岁的男性被紧急送入,他正经历急性 STEMI 并发急性心衰。血压飙至 185/105 mmHg,血氧仅 91%。护士已推来除颤仪,催促医生「心电捕手」确认替格瑞洛剂量。

AI 的熟手玩家,都应该知道system prompt这个词:每一个你用过的 AI 助手,背后都有一份你看不见的文件,却对模型有着决定性的作用。

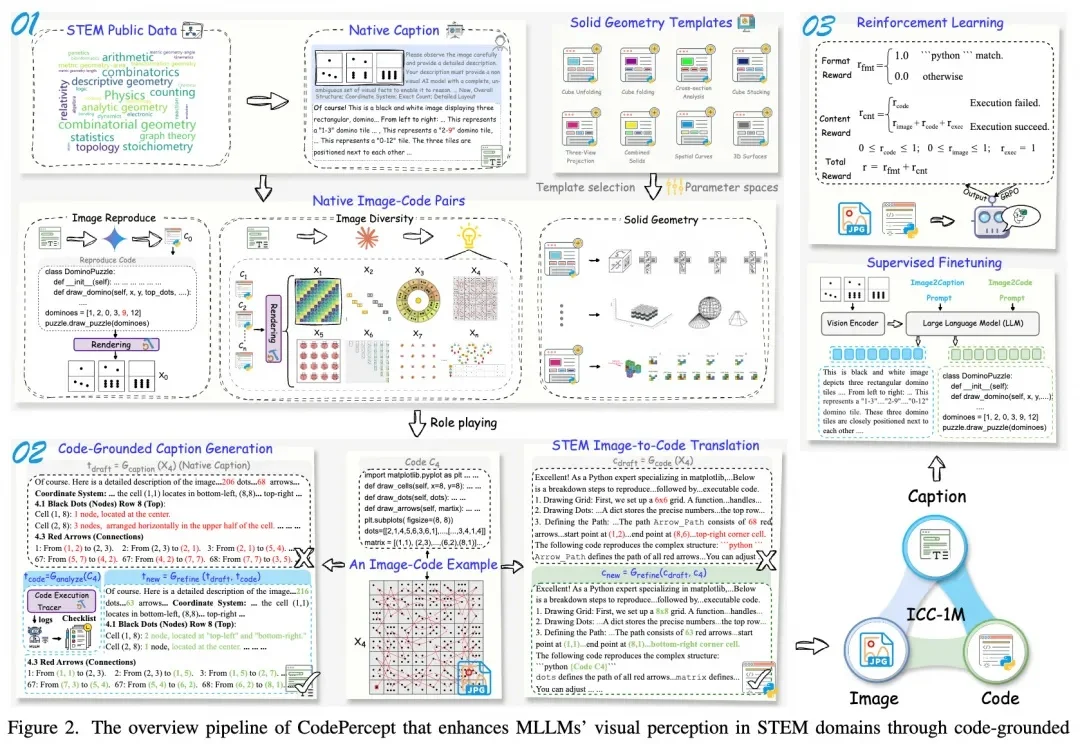

当多模态大语言模型(MLLMs)在面对科学、技术、工程和数学(STEM)领域的视觉推理题时频频「翻车」,一个根本性的问题摆在了所有研究者面前:大模型做不出理科题,究竟是因为「脑子笨」(推理能力受限),还是因为「眼神差」(视觉感知缺陷)?

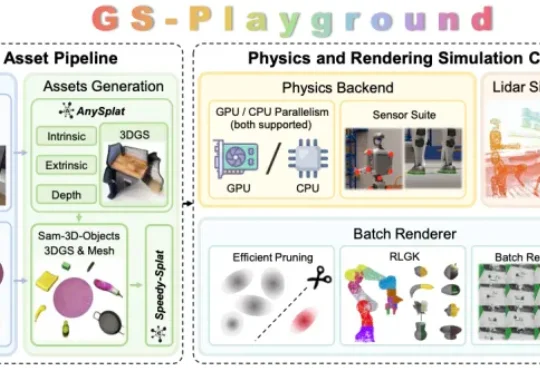

近日,清华大学智能产业研究院(AIR)DISCOVER Lab 联合谋先飞技术、原力灵机、求之科技和地瓜机器人,提出了新一代高通量视觉高保真仿真器 GS-Playground。该成果已被机器人领域国际顶级学术会议 RSS 2026(Robotics: Science and Systems)录用,标志着国内具身智能仿真基础设施在视觉保真度与训练吞吐量两个维度上同时取得了国际领先水平的突破。

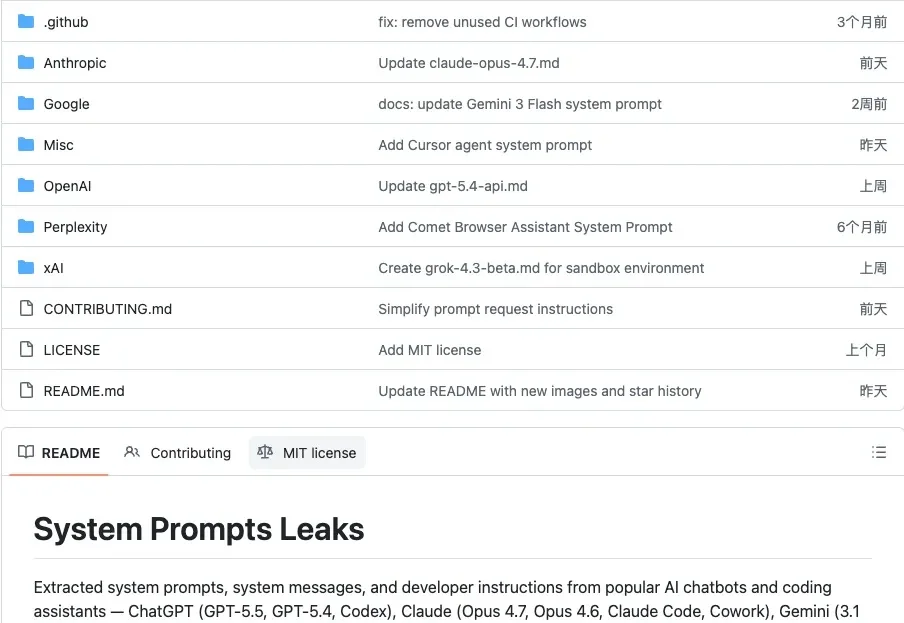

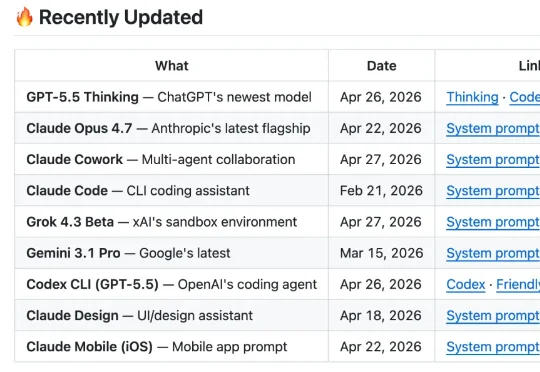

最近发现 GitHub 上有个 4 万多 Star 的开源项目(system_prompts_leaks),干了一件事:把市面上几乎所有顶级 AI 产品的 System Prompt,全部扒了出来。ChatGPT、Claude、Gemini、Grok、Claude Cowork、Codex、Perplexity....你能叫得出名字的,基本都有。

Anthropic开始抢科学家了?其STEM Fellow项目正大规模招募各学科专家驻场办公,补齐AI最后一块短板:判断力。