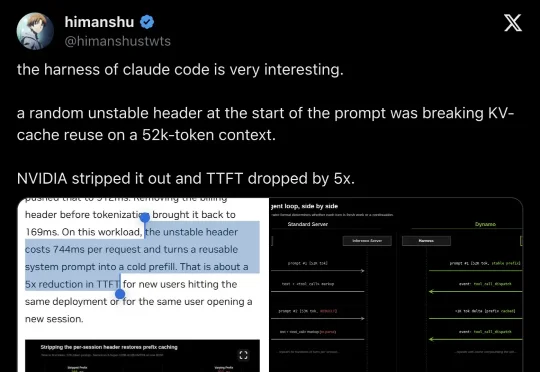

Claude Code 每条请求暗藏一行「有毒」header,52K 上下文推理被拖慢 5 倍!NVIDIA 一个 flag 修好了

Claude Code 每条请求暗藏一行「有毒」header,52K 上下文推理被拖慢 5 倍!NVIDIA 一个 flag 修好了NVIDIA Dynamo 团队发现,Claude Code 向自定义端点发送请求时,prompt 最前面会带一行 session-specific billing header。这行 header 每个 session 都变,导致 52K token 的稳定前缀在 KV cache 中无法复用——TTFT 从 168ms 飙到 912ms。Dynamo 加了一个 `