LiberAI完成亿元融资,清华00后特奖入局世界模型

LiberAI完成亿元融资,清华00后特奖入局世界模型LiberAI已于近期连续完成种子轮、天使轮及天使+轮融资,累计金额数亿元人民币,投资方包括真格基金、红杉中国、美团龙珠、顺为资本等一线机构。公司成立于2025年12月,CEO刘松铭是清华特等奖学金获得者,师从清华大学朱军教授,在ICML、NeurIPS等顶会发表多篇一作论文。

搜索

搜索

LiberAI已于近期连续完成种子轮、天使轮及天使+轮融资,累计金额数亿元人民币,投资方包括真格基金、红杉中国、美团龙珠、顺为资本等一线机构。公司成立于2025年12月,CEO刘松铭是清华特等奖学金获得者,师从清华大学朱军教授,在ICML、NeurIPS等顶会发表多篇一作论文。

过去十年,压缩在 CV 学术圈一直是个边缘方向——做生成、做大模型才是显学。但 SparcAI 的两位95后创始人各自做了多年压缩,然后在同一间 NTU 实验室相遇,两年后发布了 Sparc3D。模型 demo 上线当日冲上 HuggingFace Trending 榜首,论文被 NeurIPS 2025 录用。如今他们创办了 SparcAI,目标是一家世界模型公司。

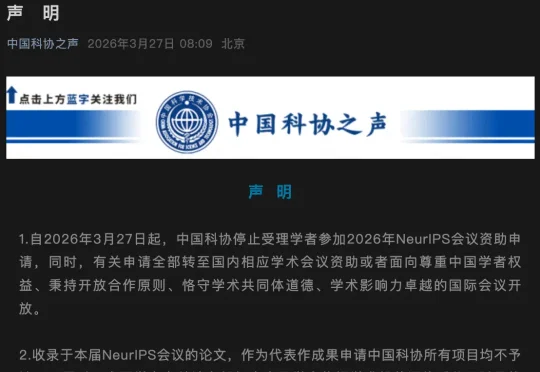

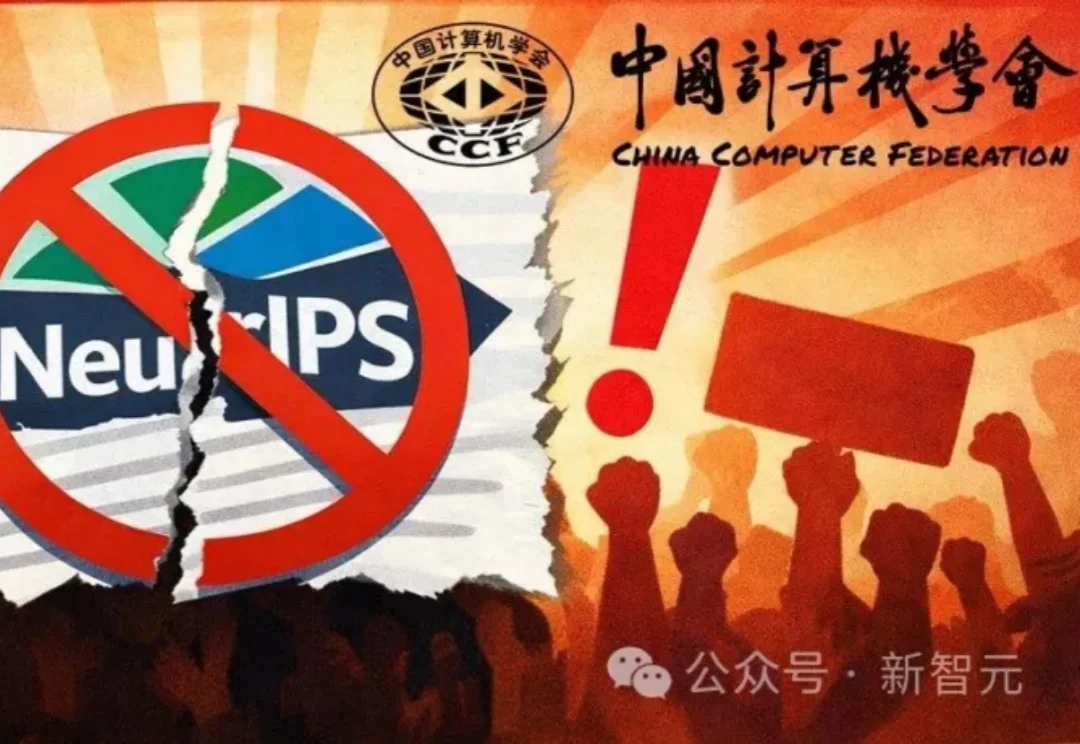

就在刚刚,NeurIPS在X上公开道歉,并表明: 我们已经更新了手册,与ACM、IEEE以及其他国际会议和往届NeurIPS的投稿规则保持一致。与往年一样,NeurIPS欢迎所有符合合规要求的机构和个人提交论文。

中国是NeurIPS最大的「粮仓」,却被新规一刀切断。CCF回应只有一句话:全体中国计算机领域科学家拒绝为其服务!更狠的还在后面:如不纠正错误,直接移出CCF推荐目录。

NeurIPS 不再让华为等机构投稿了?这个消息确实出自 NeurIPS 官方文件。在本届大会征稿通知的页面,藏着一个「MainTrackHandbook」的链接:打开链接,就能看到大会关于今年投稿的一些说明。

用强化学习微调扩散模型,还有更好的办法吗?

较真还得是程序员。

近日,在全球人工智能领域最具影响力的顶级学术会议 NeurIPS(神经信息处理系统大会)上, 清华大学和蚂蚁数科联合提出了一种名为 Dual-Flow 的新型对抗攻击生成框架。

在深入技术细节之前,我们先用一张漫画来直观理解 COIDO (Coupled Importance-Diversity Optimization) 解决的核心问题与方案:正如钟离在漫画中所言,面对海量视觉指令数据的选择任务,传统方法需要遍历全部数据才能进行筛选造成大量「磨损」(高昂计算成本)。同时在面对数据重要性和多样性问题时,传统方法往往顾此失彼。

北航刘偲教授团队提出首个大规模真实星座调度基准AEOS-Bench,更创新性地将Transformer模型的泛化能力与航天工程的专业需求深度融合,训练内嵌时间约束的调度模型AEOS-Former。这一组合为未来的“AI星座规划”奠定了新的技术基准。