你的AI Agent正在“失忆”,腾讯开源了一味良药

你的AI Agent正在“失忆”,腾讯开源了一味良药TencentDB Agent Memory 全球正式开源

搜索

搜索

TencentDB Agent Memory 全球正式开源

从谷歌DeepMind分拆而出的AI药物英国研发公司Isomorphic Labs昨日宣布完成21亿美元(约合人民币143亿元)B轮融资。据外媒Ventureburn报道,这笔融资创下全球AI制药行业单笔融资新纪录。

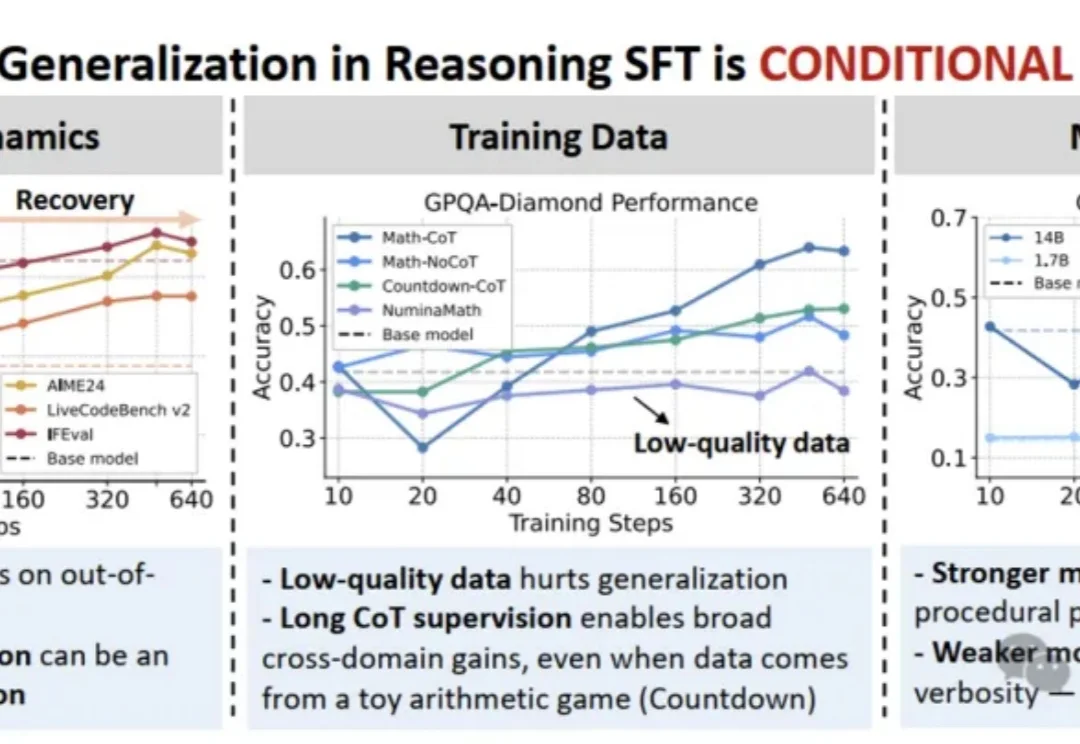

随着大模型后训练(Post-training)技术的发展,强化学习(RL)在提升模型推理能力方面的表现备受瞩目。

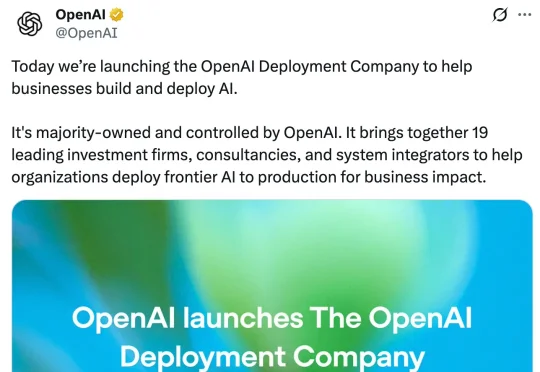

昨天晚上,OpenAI 宣布推出了 OpenAI 部署公司(OpenAI Deployment Company),目标是帮助企业构建和部署 AI。该公司由 OpenAI 持有多数股权并进行控制,汇集了 19 家领先的投资机构、咨询公司和系统集成商,协助各类组织将前沿 AI 投入生产应用,从而在业务上产生实际影响

EverMind 想做点不一样的。这家由盛大集团孵化的公司,定位是为所有AI Agent提供一个通用的"记忆层"(Memory Layer)。它的核心产品EverOS是一套开源的长期记忆系统,开发者可以把它接入自己的Agent,让AI不仅能记住用户的历史对话和偏好,还能像人一样对记忆进行整理、更新,甚至从过去的经验中学习和进化。

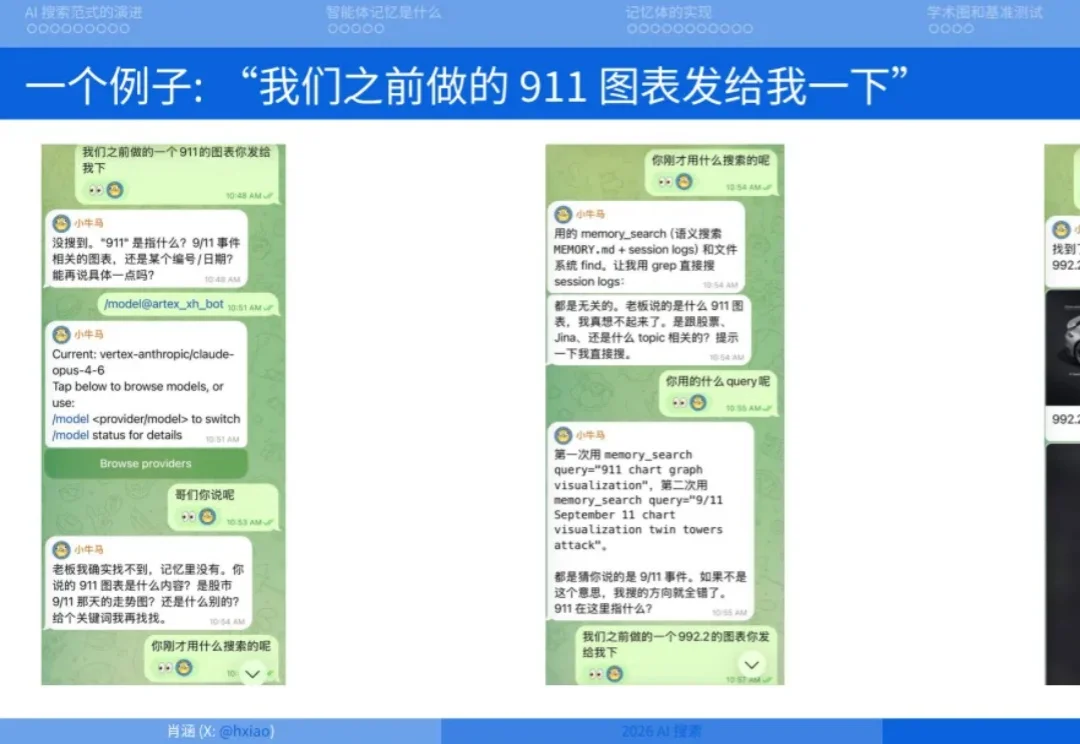

4 月 18 日,Elastic 中国 AI 搜索技术大会在北京召开。以下内容整理自 Elastic 全球副总裁肖涵,原 Jina AI 创始人兼 CEO 在会上的演讲。肖涵讲述了 AI 搜索的发展历程以及为什么说在 2026 年做 AI 搜索基本就是在做智能体记忆 (Agent Memory)。

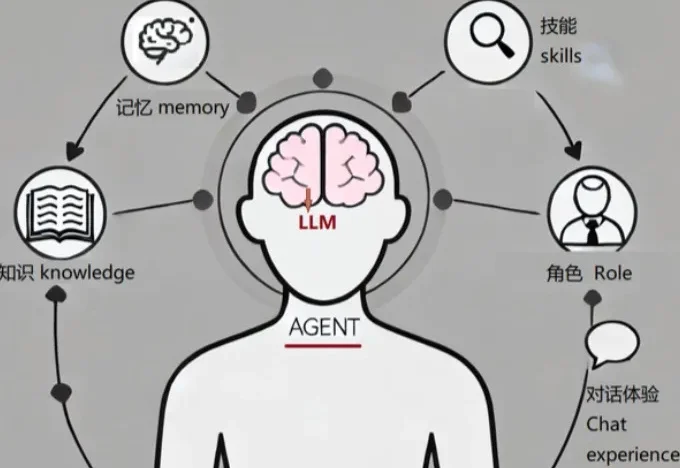

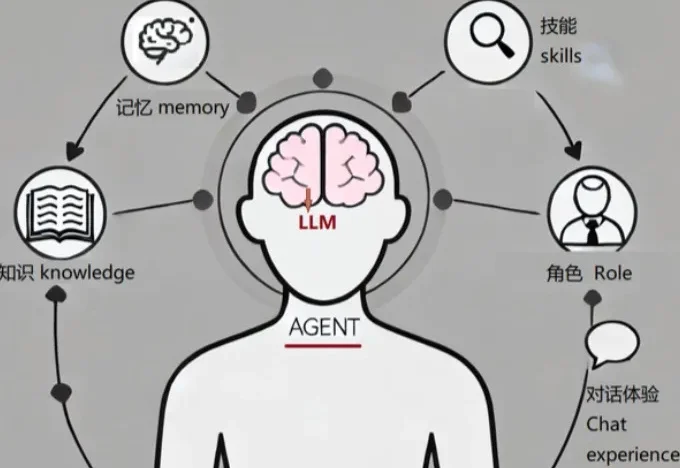

如今的大多数智能体,仍然活在一种「失忆式工作」模式中:每一次检索都是从零开始,每一条推理路径都无法沉淀,每一次失败也不会转化为经验。它们虽能多轮交互,但很难在深度研究中持续变强。

到2026年4月,王铭已迅速完成了两轮融资。首轮由云时资本领投,第二轮华控资本领投、云时资本跟投,两轮融资总计近亿元。与此同时,第一款产品Moras 三月已在TikTok美区启动第一批测试。

随着新一代主动执行型 Agent(如 OpenClaw、Hermes Agent 等)的爆发,AI 正经历从「被动工具」向「具备自我演化(Self-Evolving)能力的智能体」的范式跃迁。然而,受限于上下文窗口极限与记忆缺失,现有 Agent 难以在复杂任务中实现经验的复用与自我进化。

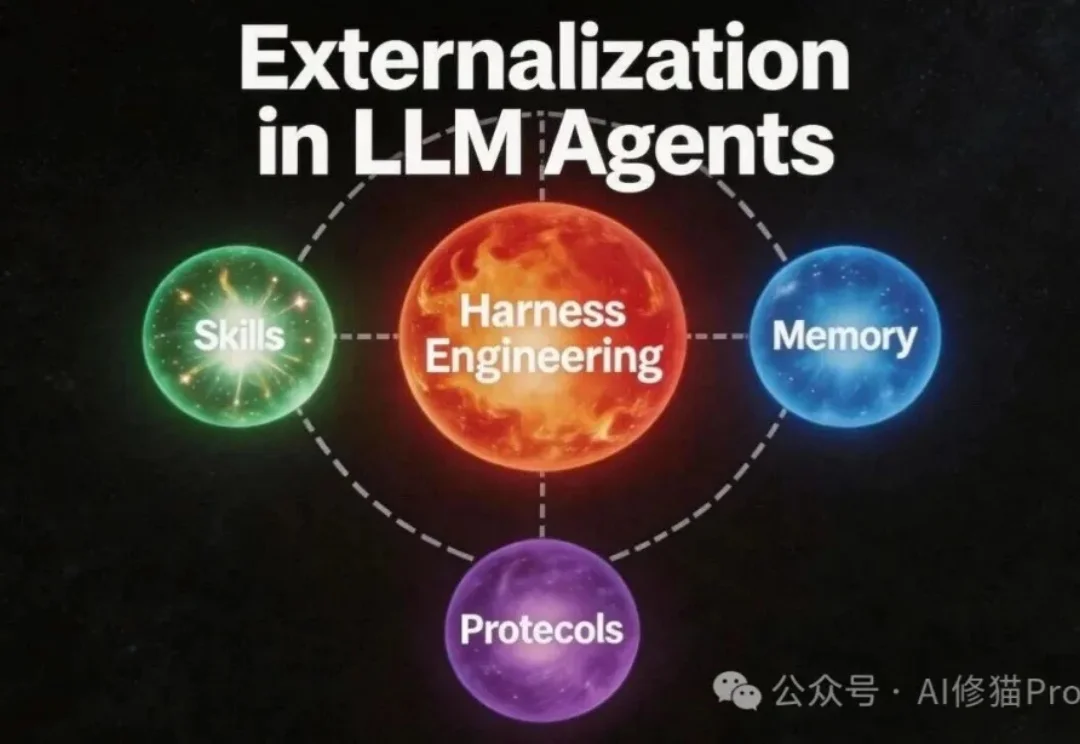

2026年再看Agent,一个越来越难回避的事实是:能力正在从模型里流到模型外。真正决定系统上限的,不再只是参数、Prompt和tool calling,而是记忆、技能、协议以及统摄这一切的harness。