小扎拆骨Thinking Machines!120亿美元AI独角兽第5位创始人跳槽Meta

小扎拆骨Thinking Machines!120亿美元AI独角兽第5位创始人跳槽Meta人才奇点先于AGI到来!Meta狂挖Mira Murati120亿估值公司,第5人正式就位。巨头不再买公司,而是直接买大脑——这场抢人大战,让所有AI创业者后背发凉。

搜索

搜索

人才奇点先于AGI到来!Meta狂挖Mira Murati120亿估值公司,第5人正式就位。巨头不再买公司,而是直接买大脑——这场抢人大战,让所有AI创业者后背发凉。

近日,AI内容电商OS K2Lab宣布再次完成数千万元天使轮融资,这也是K2Lab三个月以来完成的第二轮融资,本轮融资由华控资本领投、云时资本跟投,心流资本FlowCapital担任长期财务顾问。本轮融资资金将用于A2A原生电商Agent OS建设、多模态垂直模型打造、海外用户规模化增长和AI Native团队的持续建设。

独家获悉, 亲密交互人形机器人公司Somnia Lab已完成近千万美元天使轮融资,并计划于近期启动 Pre-A 轮融资。长期来看,Somnia Lab的目标并不只是打造一款人形机器人,而是推动人类文明进入人与机器协作、共生、共存的新阶段

到2026年4月,王铭已迅速完成了两轮融资。首轮由云时资本领投,第二轮华控资本领投、云时资本跟投,两轮融资总计近亿元。与此同时,第一款产品Moras 三月已在TikTok美区启动第一批测试。

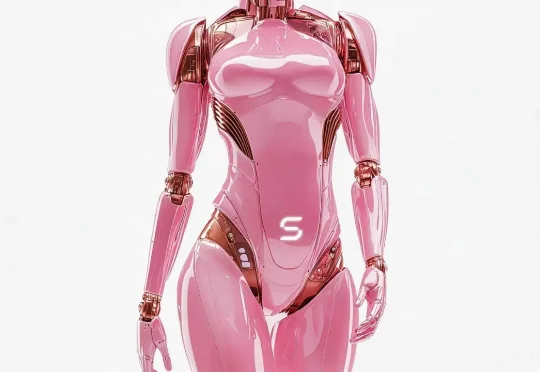

拍一圈照片,就能生成一个可交互的 3D 世界,已经不是什么新鲜话题了。但问题是如何把一个大世界塞进普通人的手机浏览器里。

距离新模型Marble 1.1&1.1-Plus发布不到一个周,李飞飞空间智能独角兽World Labs再度传来新消息—— 开源3D高斯溅射渲染引擎Spark 2.0。

南洋理工大学MMLab团队推出Hand2World,让AI世界模型真正「伸手」互动。只需在空中比划手势,模型就能生成逼真第一人称交互视频,实时响应调整。它摒弃旧有遮挡误导,用3D手部结构与射线编码解耦手与头运动,首次实现闭环持续交互。

不与世界交手,何以理解世界?

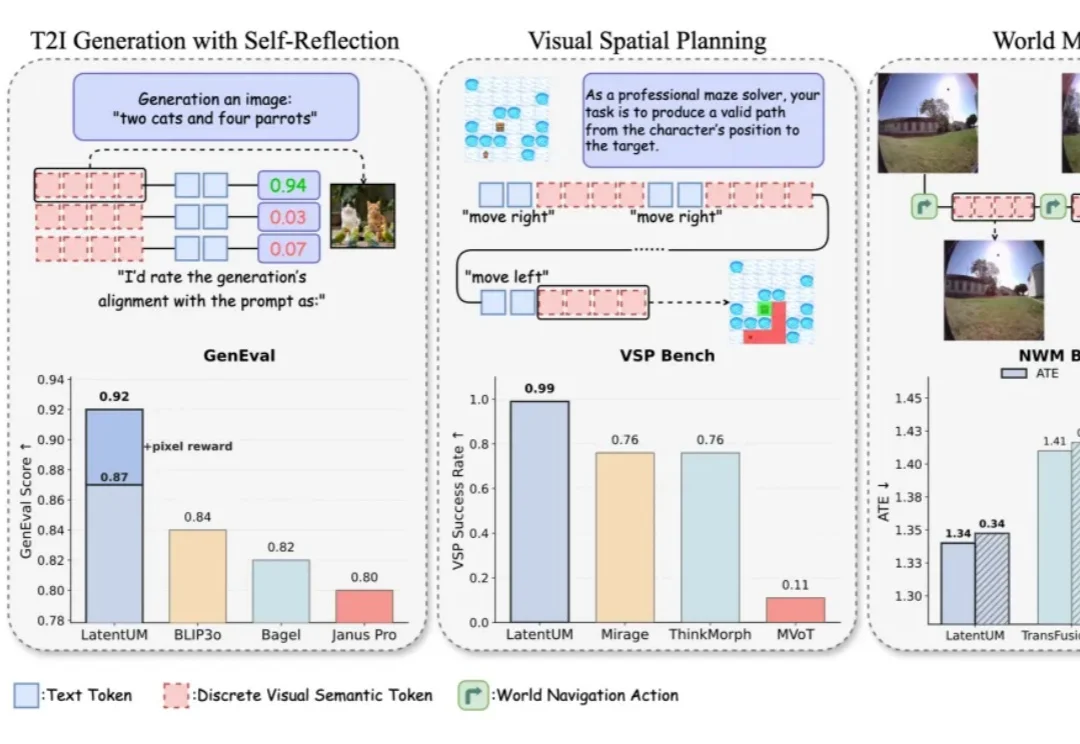

过去一段时间,生成理解统一模型(Unified Model)经常被理解成一种「既能看懂图、又能生成图」的多模态通用系统。

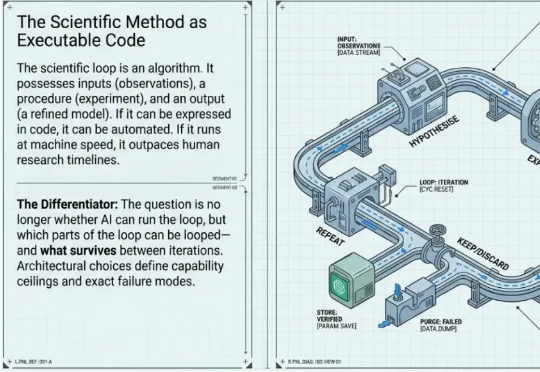

今天 Interesting Engineering++ 发了一篇长文,把这些系统放在同一个分析框架里做了横评,回答的就是这些问题。原文地址:interestingengineering.substack.com/p/the-loop-is-the-lab