大模型加持:AI电商演进路径与终局

大模型加持:AI电商演进路径与终局AI电商时代的到来给电商行业带来了巨大的变化,各种AI工具已经在电商领域广泛应用。然而,企业在迎接这个时代的挑战时需要关注算力、数据隐私、安全问题和人才培养等方面。

AI电商时代的到来给电商行业带来了巨大的变化,各种AI工具已经在电商领域广泛应用。然而,企业在迎接这个时代的挑战时需要关注算力、数据隐私、安全问题和人才培养等方面。

Meta CTO接受访谈,大谈AI开源竞争,认为AI开源将让所有参与者获益。同时,XR已经准备好利用AI搭建杀手应用,Meta最近推出的AR眼镜就是最好的例子。

游戏行业真在加速拥抱大语言模型等AI技术,不论是大厂还是独立游戏制作人,都开始依靠LLM的技术创立全新的AI NPC体验。

AI时代,中国大模型进展到哪了?12月20日,「数字力量,探索无穹」2023探索大会上,新智元创始人&CEO杨静,与百川智能技术联创陈炜鹏、商汤科技数字文娱事业部总经理栾青、蓝驰创投投资合伙人石建平共话中国大模型的创新探索。

激发大模型解决复杂问题的重要技术之一CoT,如今要被颠覆了?谷歌DeepMind斯坦福UC伯克利共同提出了「代码链」(CoC),让LLM在代码中学会了思考。

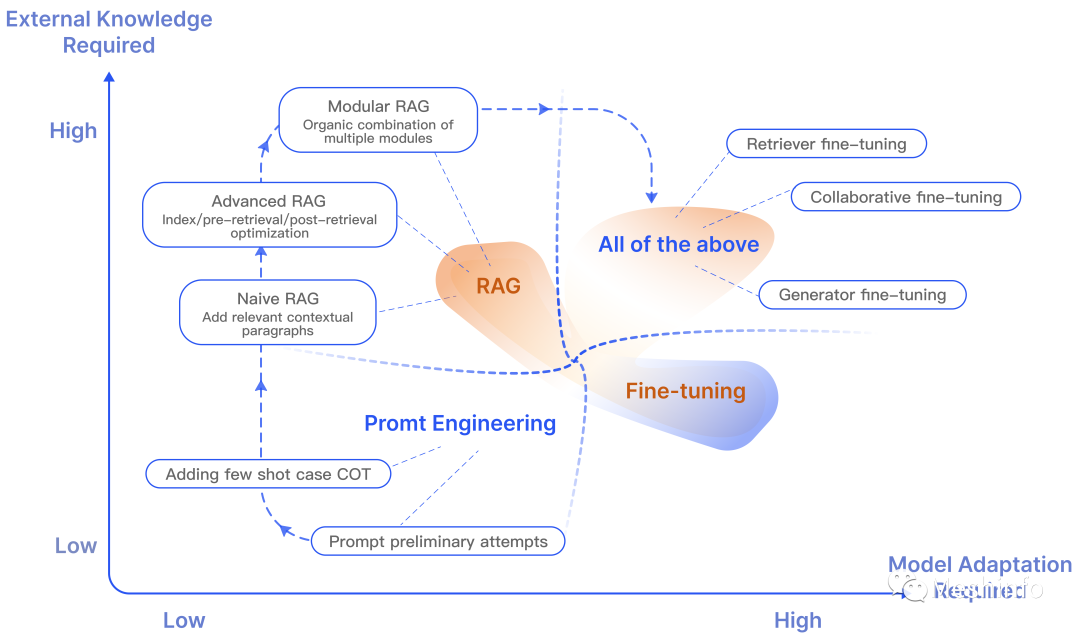

RAG没有想象中那么容易。相信这也是你会看到这篇文章的原因。

OpenAI GPT-4V 和 Google Gemini 都展现了非常强的多模态理解能力,推动了多模态大模型(MLLM)快速发展,MLLM 成为了现在业界最热的研究方向。

2023年,计算机领域都发生了哪些大事?Quanta Magazine的年终盘点来了。

全面综述近750篇「基础模型推理」论文,聚焦于各种推理任务、方法论和基准测试的最新进展,详细阐述大模型在各种推理任务上的现状、技术局限性和未来可能性。

走过了2023,ChatGPT在人们的视线中喧闹了一整年,这一年我们的人工智能经历了什么?同时对于2024的生成式AI,又有哪些期待呢?