总结374篇相关工作,陶大程团队联合港大、UMD发布LLM知识蒸馏最新综述

总结374篇相关工作,陶大程团队联合港大、UMD发布LLM知识蒸馏最新综述早在 2020 年,陶大程团队就发布了《Knowledge Distillation: A Survey》,详细介绍了知识蒸馏在深度学习中的应用,主要用于模型压缩和加速。随着大语言模型的出现,知识蒸馏的作用范围不断扩大,逐渐扩展到了用于提升小模型的性能以及模型的自我提升。

早在 2020 年,陶大程团队就发布了《Knowledge Distillation: A Survey》,详细介绍了知识蒸馏在深度学习中的应用,主要用于模型压缩和加速。随着大语言模型的出现,知识蒸馏的作用范围不断扩大,逐渐扩展到了用于提升小模型的性能以及模型的自我提升。

苹果首次披露了在多模态大型语言模型(LLM)研究领域的最新突破,并在生成式AI领域“开辟新天地”。探索生成式AI领域,将AI技术引入iPhone

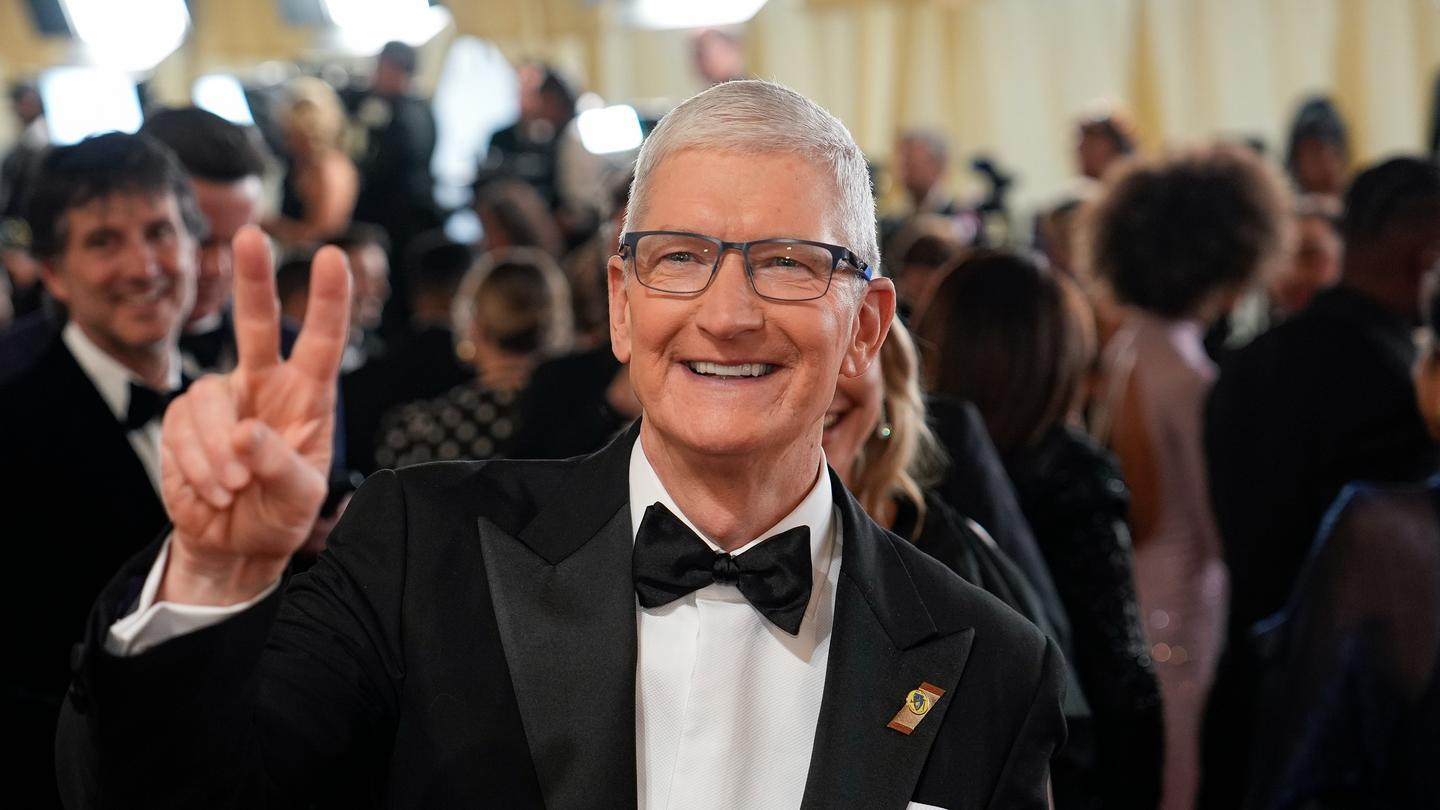

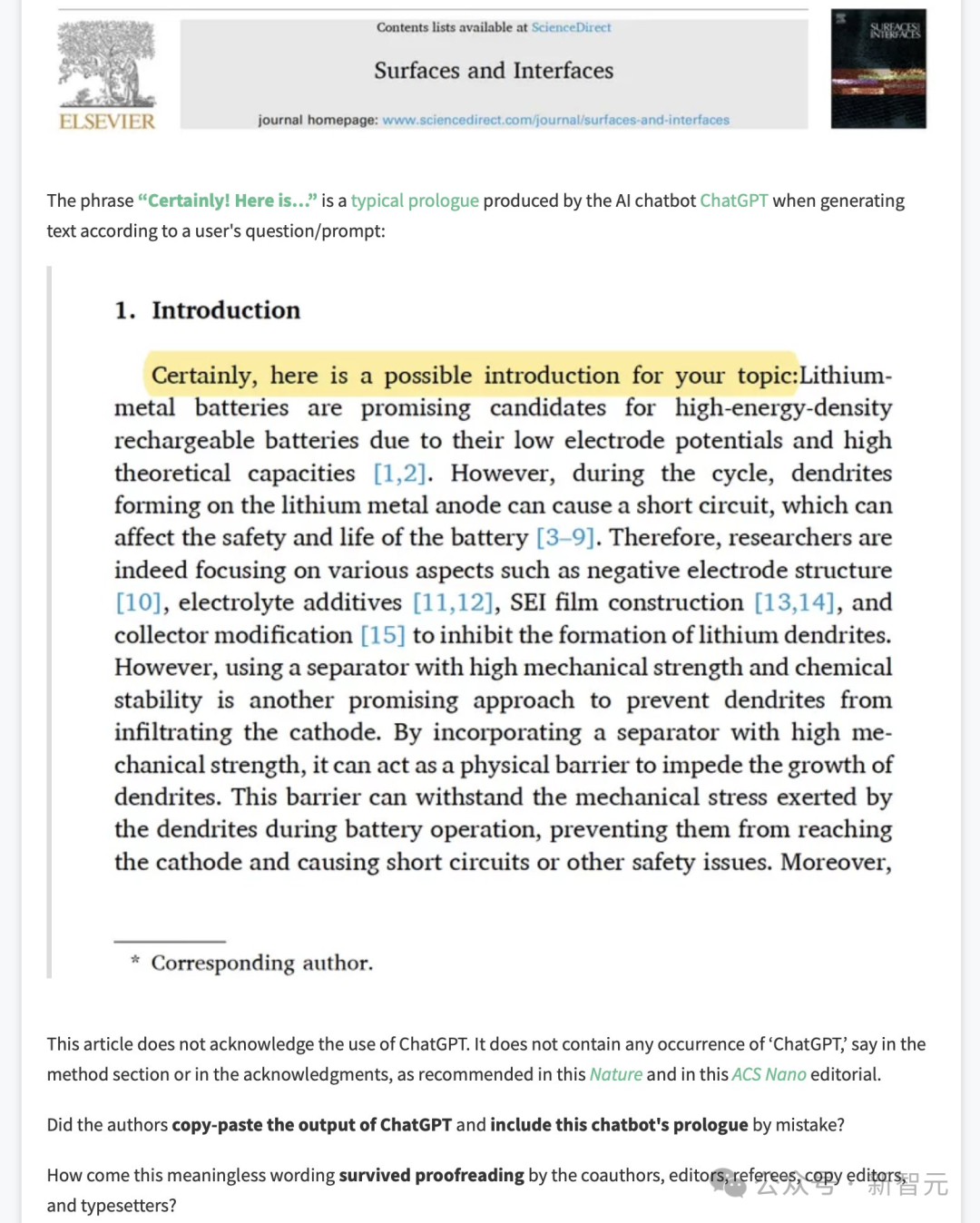

近日,爱思唯尔上的几篇论文被发现开篇就暴露了「ChatGPT风格」,插图也是用Midjourney画的。学术圈被AI渗透已经不是一天两天了,搞科研的用AI写论文,学生用AI写作业,老师也用AI批作业,整个过程都没有真人了。

StepCoder将长序列代码生成任务分解为代码完成子任务课程来缓解强化学习探索难题,对未执行的代码段以细粒度优化;还开源了可用于强化学习训练的APPS+数据集。

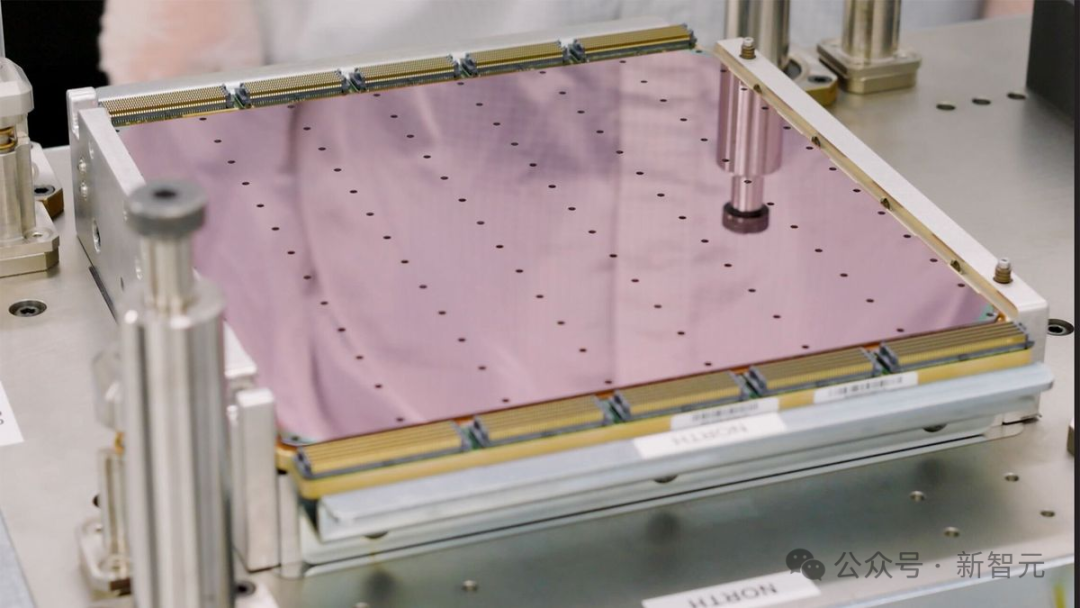

AI世界的进化快的有点跟不上了。刚刚,全球最强最大AI芯片WSE-3发布,4万亿晶体管5nm工艺制程。更厉害的是,WSE-3打造的单个超算可训出24万亿参数模型,相当于GPT-4/Gemini的十倍大。

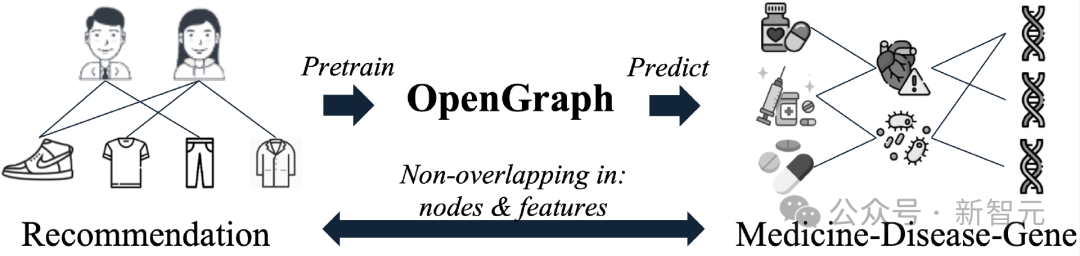

港大发布通用图基座模型OpenGraph,巧妙从LLM中蒸馏零样本图泛化能力。

LLM开源从Infra做起!Meta公布了自己训练Llama 3的H100集群细节,看来Llama 3快来了。

OpenAI上一笔融资不到八个月,Figure就来交卷了!这个机器人能说会动,还能自主推理,给自己布置任务。最炸裂的是,它完全是自主行动,没有远程控制!1.0倍速的原视频一出,网友们震惊了。

新模型bGPT是一个基于字节的Transformer模型,能够将不同类型的数据纳入同一框架之下,可以生成文本、图像和音频,还能模拟计算机行为,数字世界将迎来真正的大一统?

随着大语言模型(LLM)的发展,很多研究发现LLM能够展现出稳定的人格特质,模仿人类细微的情绪与认知模式,还能辅助各种各样的社会科学仿真实验,为教育心理学、社会心理学、文化心理学、临床心理学、心理咨询等诸多心理学研究领域,提供了新的研究思路。