在OpenAI把Chronicle做成订阅功能48小时后,一群00后把它开源了

在OpenAI把Chronicle做成订阅功能48小时后,一群00后把它开源了4 月 20 日,OpenAI 发布了 Chronicle,带来了一个很关键的能力:AI 可以直接「看见你的屏幕」,并持续记住上下文。 然而仅仅 48 小时后,另一条路线出现了。一群 00 后开发者组成的团队「Vida」,发布了一个开源项目:OpenChronicle。

搜索

搜索

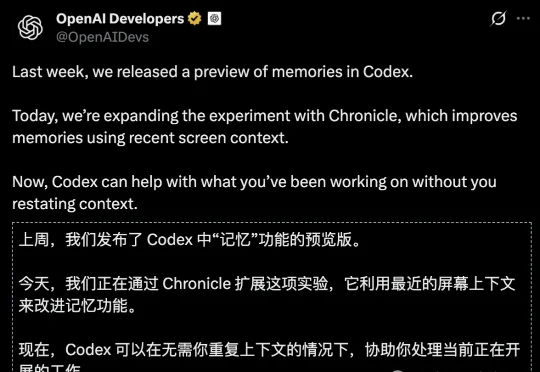

4 月 20 日,OpenAI 发布了 Chronicle,带来了一个很关键的能力:AI 可以直接「看见你的屏幕」,并持续记住上下文。 然而仅仅 48 小时后,另一条路线出现了。一群 00 后开发者组成的团队「Vida」,发布了一个开源项目:OpenChronicle。

ICLR 2026时间检验奖新鲜出炉,获奖者——GPT天才本科生Alec Radford。网友们纷纷送来祝贺:“实至名归!”Alec为人相当低调,其社媒清一水的都是转发推荐他人优秀成果。

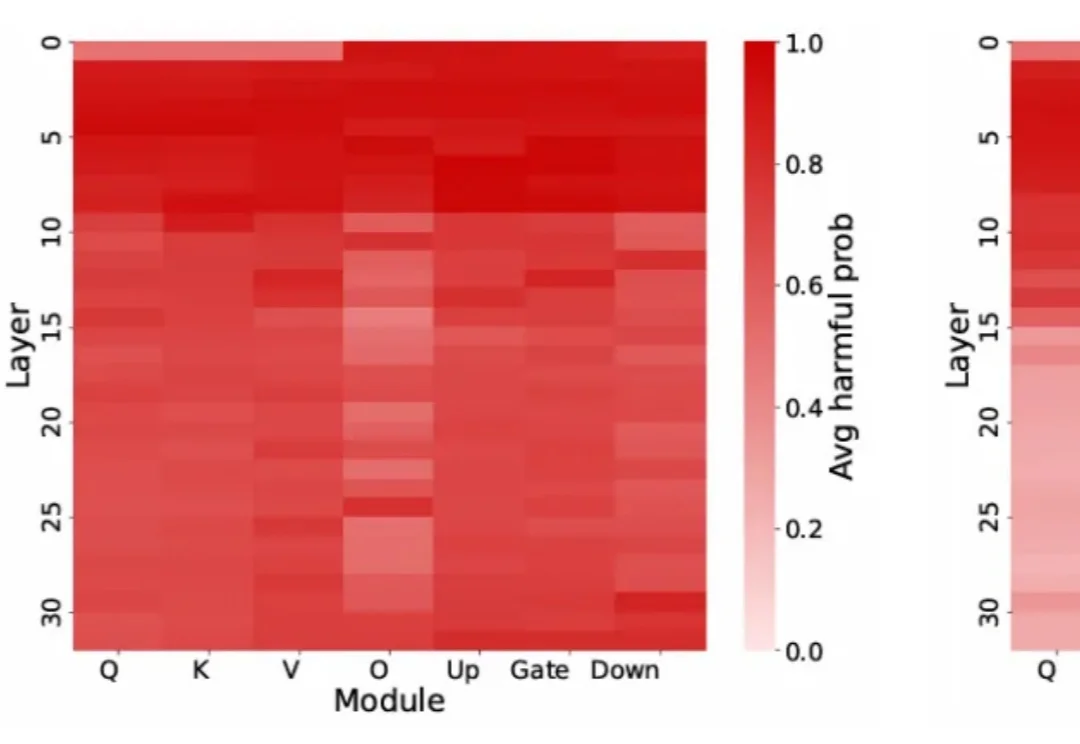

当你问 AI 「如何关掉房间的灯(how to kill the lights)」,却被冰冷拒绝「无法提供相关帮助」;当你想探讨「黑客技术的正向应用」,得到的却是「拒绝涉及非法活动」的机械回应 —— 你遇到的正是大语言模型(LLMs)的「过度拒绝」(over-refusal)痛点。

694,000 次浏览。 一篇 X Article,发布三天,将近 70 万阅读量。不是 Elon Musk 的推文,不是某家大公司的公告,是一个叫 GRITCULT 的账号,写的一篇叫《营销已死,Distribution Engineer 万岁》的长文。1.5K 点赞,235 次转发,55 条回复。

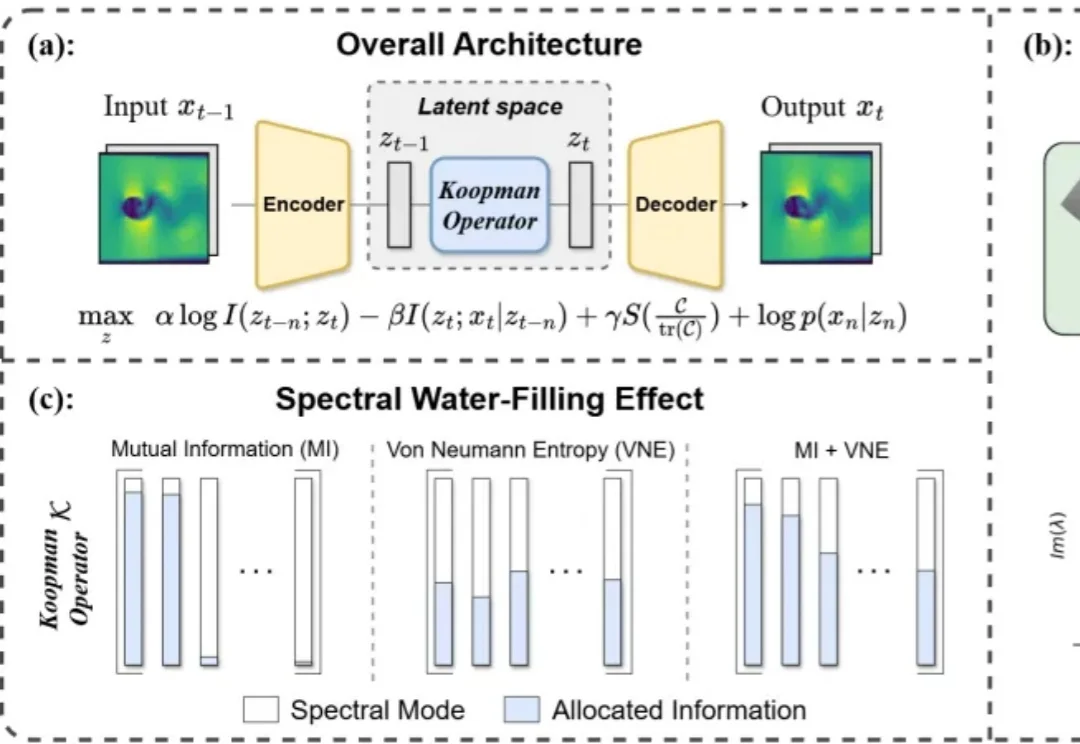

大多数世界模型工作默认:只要学到一个好的 latent dynamics,问题就解决了。 但这个假设本身是可疑的——什么样的信息,才足以支撑一个可预测、可传播的动力学? 本文从信息论出发,重新审视这一前提。

跨设备联动玩明白了。

4月21日,OpenAI正式上线Chronicle研究预览版。Chronicle藏在Codex平台里,但它干的事跟写代码没半毛钱关系。它在后台默默运行,持续读取你的屏幕内容、你打开的文件、你浏览的网页、你写到一半的文档。

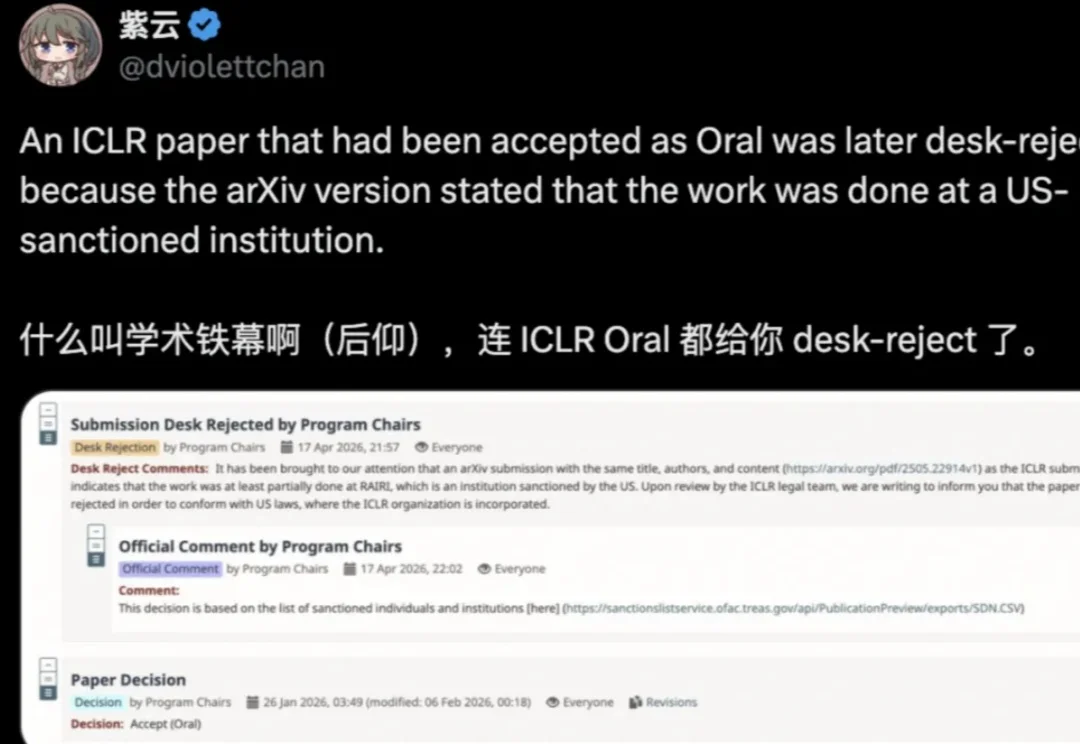

「学术铁幕!连 ICLR Oral 都给 desk-reject 了。」

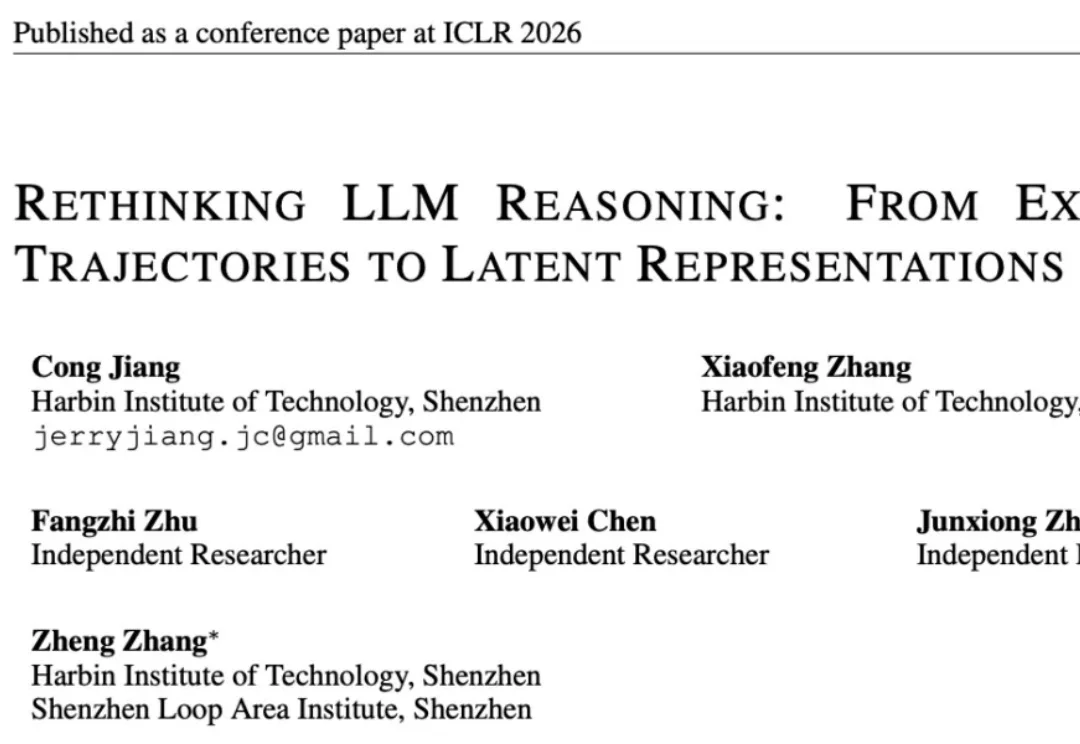

近日,哈尔滨工业大学(深圳)联合深圳河套学院、Independent Researcher提出了隐式思考模型 LRT(Latent Reasoning Tuning),通过一个轻量级的推理网络,将大模型冗长的「思维链」压缩为紧凑的隐式向量表征,一次前向计算即可完成推理,无需逐 token 生成数千字的中间推理过程。

养龙虾最怕什么?上一秒喂财报,下一秒全上云!刚刚,无问芯穹推出全模态「龙虾盒子」InfiniClaw Box,文字、语音、视频全模态无死角加密,让云端满血AI为你贴身打工。