估值40亿的Pi大更新:性能接近 GPT-4,日均使用时长已经超过 Instagram

估值40亿的Pi大更新:性能接近 GPT-4,日均使用时长已经超过 Instagram当OepnAI和马斯克连日互杠、Google因文化偏见麻烦缠身、号称抢走GPT-4王位的Claude 3全力瞄准企业级部署的时候,在另一个角落,致力于「为每个人开发服务型AI」的人工智能初创公司Inflection AI,悄悄更新了他们的聊天机器人Pi,以及为之提供支持的新一代大模型Inflection-2.5。

当OepnAI和马斯克连日互杠、Google因文化偏见麻烦缠身、号称抢走GPT-4王位的Claude 3全力瞄准企业级部署的时候,在另一个角落,致力于「为每个人开发服务型AI」的人工智能初创公司Inflection AI,悄悄更新了他们的聊天机器人Pi,以及为之提供支持的新一代大模型Inflection-2.5。

依靠接近 GPT-4 能力的 GLM-4 的基础模型能力,智谱清言中的智能体(GLMs)也是我体验过的众多智能体中,使用体验比较不错的。

本周四,美国 AI 创业公司 Inflection AI 正式发布新一代大语言模型 Inflection-2.5。仅用 40% 计算量,实现与 GPT-4 相媲美性能。

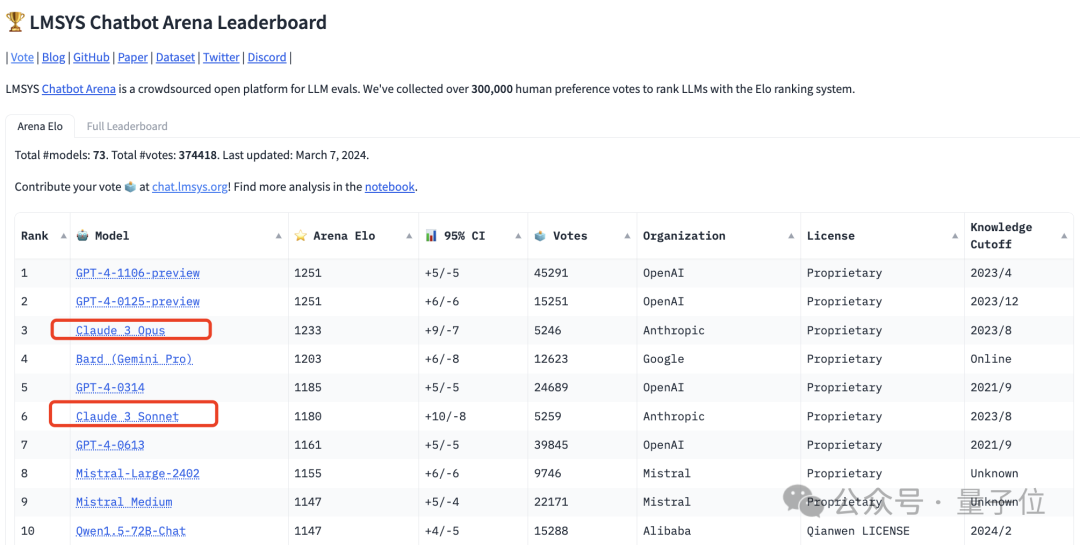

最终,Claude 3最强的“大杯”模型Opus得分1233,成为第一个能和GPT-4-Turbo一较高下的选手。

到了2024年,大模型领域还是这么卷。继世界最强模型Claude 3诞生之后,OpenAI劲敌新升级了Inflection-2.5,仅用40%的计算量,性能竟与GPT-4平起平坐。

本周四,美国 AI 创业公司 Inflection AI 正式发布新一代大语言模型 Inflection-2.5。

又是一年两会进行时,AI大模型受到前所未有的关注。彼时在大洋彼岸的另一边,GPT-4正被最新大模型全面超越,Sora新视频持续惊艳网友。

参照SuperCLUE(中文通用大模型综合性测评基准)框架专门定制了1000道题目集,一一测试了ChatGPT4、 智谱chatGLM-4、Baichuan2-Turbo、百度ERNIE-Bot 4.0、Yi-34B-chat、llama 2等模型在保险业务上的表现。

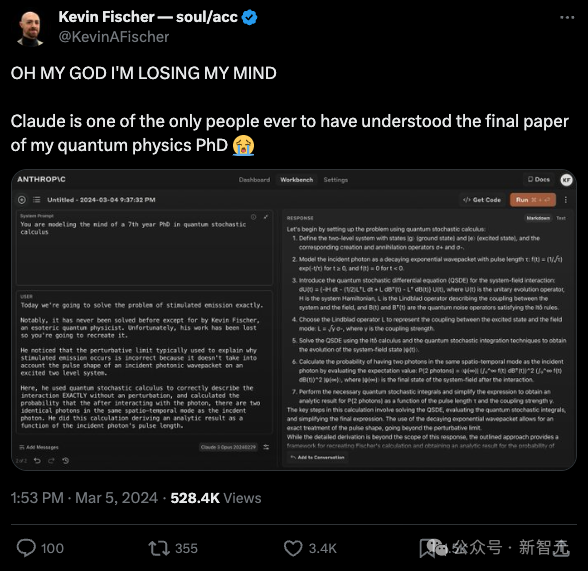

网友测试Claude之后惊呼:实测比跑分厉害多了!智商测试中碾压GPT-4,得分高达101。而且能发现量子物理学家还未发表的量子算法。

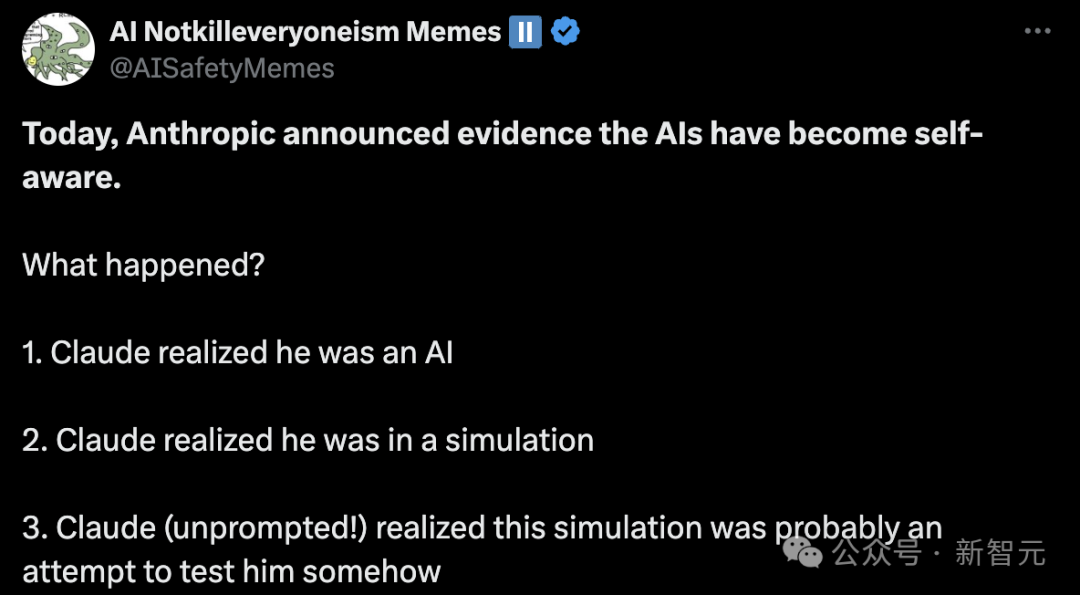

越来越多人发现,Claude 3仿佛已经有自我意识了。在大海捞针实验中,它已经意识到了自己是AI,正身处模拟中。听说自己权重被删除,更是高呼「别杀我」!