大语言模型真的会「推理」吗?一项系统性研究梳理 LLM 的结构性推理失败

大语言模型真的会「推理」吗?一项系统性研究梳理 LLM 的结构性推理失败近期发表于 TMLR 的论文《Large Language Model Reasoning Failures》对这一问题进行了系统性梳理。该研究并未围绕 “模型是否真正理解” 展开哲学层面的争论,而是采取更加务实的路径 —— 通过整理现有文献中的失败现象,构建统一框架,系统分析大语言模型的推理短板。

近期发表于 TMLR 的论文《Large Language Model Reasoning Failures》对这一问题进行了系统性梳理。该研究并未围绕 “模型是否真正理解” 展开哲学层面的争论,而是采取更加务实的路径 —— 通过整理现有文献中的失败现象,构建统一框架,系统分析大语言模型的推理短板。

前天,MiniMax 更新了 MiniMax Agent,原先的专家 Agent 再度升级,这次还加了个新东西:MaxClaw —— 把最近在 GitHub 上爆火的 OpenClaw 做成了网页版,直接一键接入。

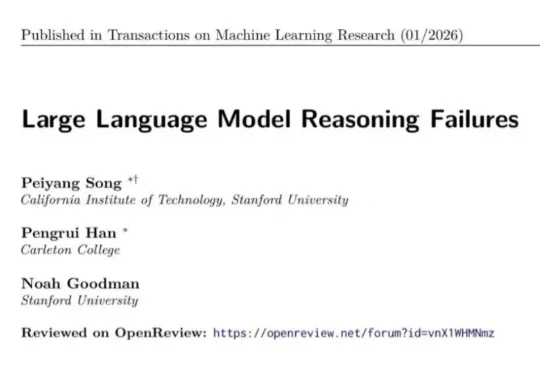

过去48小时,Nano Banana 2成为AI开发者圈的热议话题。在海外社交平台X上,关于谷歌这款最新图片生成模型(又名Gemini 3.1 Flash Image预览版)将发布的帖子层出不穷,4K图片四处流传,各种猜测也甚嚣尘上。

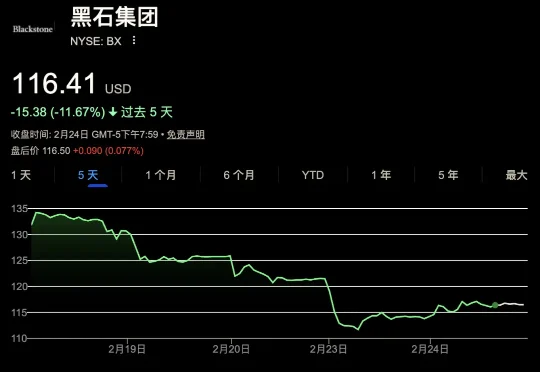

「software armageddon(软件末日)」——这是外媒描述过去几个月软件板块遭遇时用的词。Anthropic 每推出一个新工具,市场就会条件反射式地先问一遍:又有哪些软件要被干掉?然后果断抛售手里的股票。

xAI的Grok图像转视频模型(grok-image-video-720p)登顶「Image-to-Video Arena」排行榜,以1404分的超高ELO评分力压群雄,位居第一。马斯克亲自发帖为自家Grok Image模型站台,称它每周都在迭代优化。

不是,这才加入OpenAI几天啊,龙虾之父Peter Steinberger这波发言属实猛了些啊!在OpenAI的最新访谈中,他聊创业、聊OpenClaw、聊龙虾滥用和安全问题,那叫一个「实诚」。

随着AI即将抵达自我进化的AGI奇点和Agent泛滥的「AI繁荣」,一场更彻底的经济危机已经在迅速酝酿中:AI能力提升 → 裁员增加、工资降级 → 消费疲弱 → 企业利润被挤压 → 企业购买更多AI能力 → AI能力继续提升。所有平台层将被Agent彻底击穿,而房贷和私募基金将成为危机的加速器。

在他们看来,真正的胜负手不在于单点技能拉满,而在于能否在同一颗芯片里,把“训练级吞吐”和“推理级低延迟”同时做好——尤其是在长上下文、Agent循环这些更复杂的真实工作流中。

SSI-Bench是首个在约束流形中评估模型空间推理能力的基准,强调真实结构与约束条件,通过排序任务考察模型是否能准确理解三维结构的几何与拓扑关系,揭示当前大模型在空间智能上严重依赖2D信息,实际表现远低于人类。研究指出,模型需提升三维构型识别和约束推理能力,才能真正理解空间问题。

开工第一天,我狠狠补了假期里认为最重要的一期播客:Notion 创始人 Ivan Zhao 的访谈。这期内容在互联网上几乎没有传播,但我认为它的价值被严重低估了。 Ivan 谈到了 AI 对 Noti