打破长视频理解瓶颈:HoPE混合位置编码提升VLM长度泛化能力

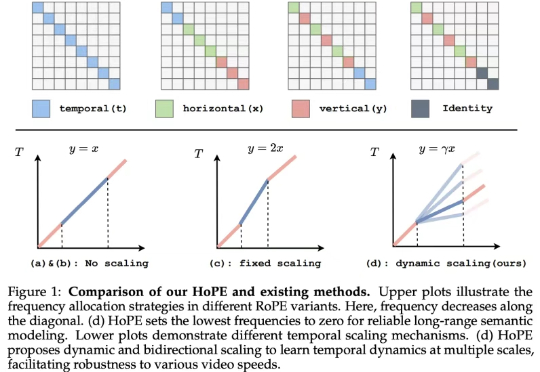

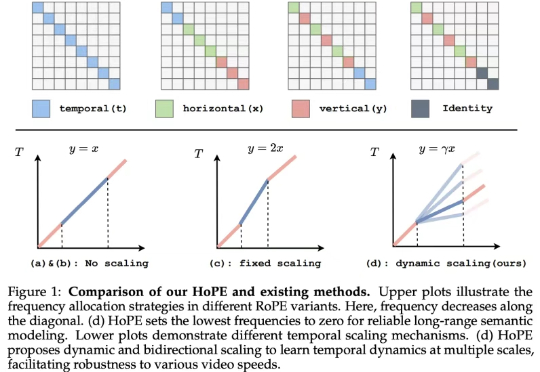

打破长视频理解瓶颈:HoPE混合位置编码提升VLM长度泛化能力如今的视觉语言模型 (VLM, Vision Language Models) 已经在视觉问答、图像描述等多模态任务上取得了卓越的表现。然而,它们在长视频理解和检索等长上下文任务中仍表现不佳。

如今的视觉语言模型 (VLM, Vision Language Models) 已经在视觉问答、图像描述等多模态任务上取得了卓越的表现。然而,它们在长视频理解和检索等长上下文任务中仍表现不佳。

Agent Infra是AI时代的新热点,涉及为Agent重建基础设施以适应其与人类的根本差异,包括交互方式、学习模式、责任界定等。核心是创建安全环境如E2B沙盒和Browserbase浏览器工具,支持Agent反馈循环和多任务协作,预计Browser Use市场将大幅增长,开发者需聚焦差异场景提升价值。

在经过深度思考后,我有了一个大胆的猜想:我们一直在用错误的框架理解它,大家都把它当作"更好的编程工具",但我越用越觉得,这根本不是一个编程工具,而是一个披着终端外衣的通用 AI agent。正好周末看了Anthropic 产品负责人 Michael Gerstenhaber 的最新一期访谈,

最近,Kimi Researcher(深度研究)开启内测。根据官方介绍,其定位并非一个简单的“搜索工具”,而是一个能够生成带引用来源的深度研究报告的AI Agent。

这是我关于「AI Native 系列」的第二篇文章,主题是:行动闭环。在上一篇里,我讲了什么样的产品才算得上真正的 AI Native,分享了我对 MCP 协议、AI 架构原生性和任务闭环的理解。

6 月 27 日,腾讯混元宣布开源首个混合推理 MoE 模型 Hunyuan-A13B,总参数 80B,激活参数仅 13B,效果比肩同等架构领先开源模型,但是推理速度更快,性价比更高。模型已经在 Github 和 Huggingface 等开源社区上线,同时模型 API 也在腾讯云官网正式上线,支持快速接入部署。

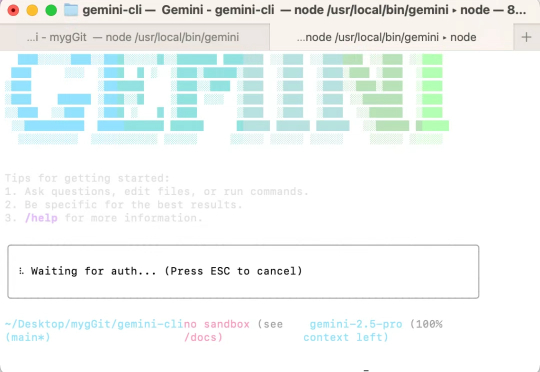

带着最新最强的模型,走向最热门的赛道,这用来形容 Google 昨天推出的 Gemini CLI 最合适不过了。

前天分享了一篇介绍Gemini CLI的文章《谷歌杀疯了!免费2.5 Pro+开源Gemini CLI,就是要卷死所有AI编程工具..》 没想到还有点小火...这篇文章,我带大家来解决一下这个登录不上的问题。另外,Gemini CLI的Github上提的问题太多了。。。目前已经有516个Issues

随着大模型能力的突破,“可调用工具的智能体”已经迅速从实验室概念走向应用落地,成为继大模型之后的又一爆发点。

只需一眨眼的功夫,Mercury 就把任务完成了。「我们非常高兴地推出 Mercury,这是首款专为聊天应用量身定制的商业级扩散 LLM!Mercury 速度超快,效率超高,能够为对话带来实时响应,就像 Mercury Coder 为代码带来的体验一样。」